AI 文字偵探是這篇文章討論的核心

目錄

快速精華

如果你只想抓重點,直接照下面做就好(真的省時間):

💡核心結論:不要用「看起來很像」來判斷 AI 文。CNET 提到的六大檢查面向(風格一致性、語言多樣性缺失、微妙語義錯、訓練資料痕跡、模型標記頻率、上下文邏輯連貫)要結合工具掃描,再用覆核環節降低誤判。

📊關鍵數據:就算沒有每篇都做到「完美偵測」,市場仍會往「可稽核」走。以 OpenAI 對 GPT-2 偵測研究的說法為例,他們曾提到針對特定資料量的檢測表現可達約 ~95%(但同時強調內容偵測是長期挑戰)。2026 的趨勢重點不是單次命中率,而是你的審查流程能不能被稽核、能不能降風險。

🛠️行動指南:先用六紅旗做人工快速掃描→再用工具抽查→最後用「事實交叉驗證」與「上下文回讀」覆核。把這套流程寫進 SOP,SEO 也會更穩。

⚠️風險預警:AI 偵測工具可能會出現誤判;而且對方也可能「改寫/混入人類痕跡」來規避。你要的是降低錯誤成本,而不是追求絕對正確。

先說人話:為什麼你一定會被「像人」的內容騙到

我觀察到一個很煩的現象:很多 AI 生成文不是那種「一眼就很機器」的段落,它更常是那種——讀起來順、措辭漂亮、還順便放了幾個看似合理的例子。你看久了,會覺得「欸好像也沒問題」。但問題是:內容行銷、社群貼文、甚至合規審查,靠的都不是「感覺」,而是可追溯的判斷依據。

這篇文章我用 CNET《How to Be an AI Detective: Tips for Spotting Bot-Generated Text》的六大檢查面向當底,幫你把「AI 文字偵探」變成 2026 年可落地的工作流:看紅旗、抓脈絡、再交叉驗證。你會得到一套更像稽核,而不是像算命的檢查邏輯。

AI 文字偵探:6 個紅旗要怎麼看,才不會一眼判錯?

CNET 的核心提醒是:別只盯「語法正不正確」。真正常見的破綻,反而藏在風格一致性、語言多樣性、語義微錯、訓練資料痕跡、模型標記頻率,以及上下文邏輯連貫的細節裡。你可以把它當成「六段式掃描清單」。

把六紅旗拆成你真的看得懂的判斷方式

(1) 文字風格一致性:人類寫作通常有「情緒與節奏」的波動;機器文常維持過度一致的調性(例如每段都同樣密度的修飾詞)。你不用要求完全不一致,但要警覺「一致到像模板」。

(2) 語言多樣性缺失:句型、轉折、長短節奏,如果整篇過度單一,讀者會覺得「順但薄」。CNET 提到的缺失感通常就是這種:看似完整,其實變化少。

(3) 微妙的語義錯:這是最容易被忽略的部分。AI 可能不會把大事講錯,但會在某些小地方出現「看不出來但怪怪的」語意衝突:名詞關係、時間先後、因果連接。你可以用一句話測試:把段落改成「因為 X,所以 Y」看 Y 是否合理。

(4) 潛在訓練資料痕跡:這裡不是要你去找「來源」,而是看內容是否像是拼湊常見表述:常見模板句、過度概括、引用看起來很權威但細節對不上。

(5) 模型特有標記頻率:你可以把它理解成「某類措辭出現的頻率不自然」。這種不自然不是壞事,但當頻率疊加其他紅旗時,就會形成判斷證據鏈。

(6) 上下文邏輯連貫:最後看回到脈絡。AI 常在段落切換時出現「邏輯跳躍」:上一段說 A,下一段立刻跳到 B,好像只是需要鋪陳而不是在推導。

Pro Tip:用「回讀法」把誤判率壓下來

別只做第一次掃描。第二次回讀要換視角:把每段的第一句當成證據、最後一句當成結論,問自己「結論有沒有真的由證據推導出來」。這招很實在,因為 CNET 六紅旗裡最容易被工具與人眼同步抓到的,就是上下文邏輯連貫與語義微錯。

把「語感」做成流程:一致性、缺失感、語義微錯怎麼量化

你可能會問:那六紅旗到底怎麼「量化」?答案是:不需要做學術級統計,但需要建立一致的觀察規則。量化在這裡的意思是——你要能重複、能交接、能被稽核。

做一個 10 分制:每紅旗一分,最後交叉驗證

把六紅旗各自記 0/1/2:0=完全沒有,1=略有,2=明顯。總分 0-12。接著用「覆核規則」判定要不要升級處理:例如總分 ≥7 則進入工具抽查與事實核對。

用 OpenAI 的偵測研究提醒你:偵測是「長期挑戰」

OpenAI 在 GPT-2 的釋出資料中提到:基於內容的偵測是長期挑戰,並提供過針對特定資料量的偵測表現(提到可達約 ~95%)。但同一份研究也讓人看到現實:偵測不是開關,不是你今天做對,明天就永遠都準。

所以你量化的重點應該是「程序韌性」。你要能解釋:為什麼這篇被判定需要升級覆核?依據在哪?做了什麼?

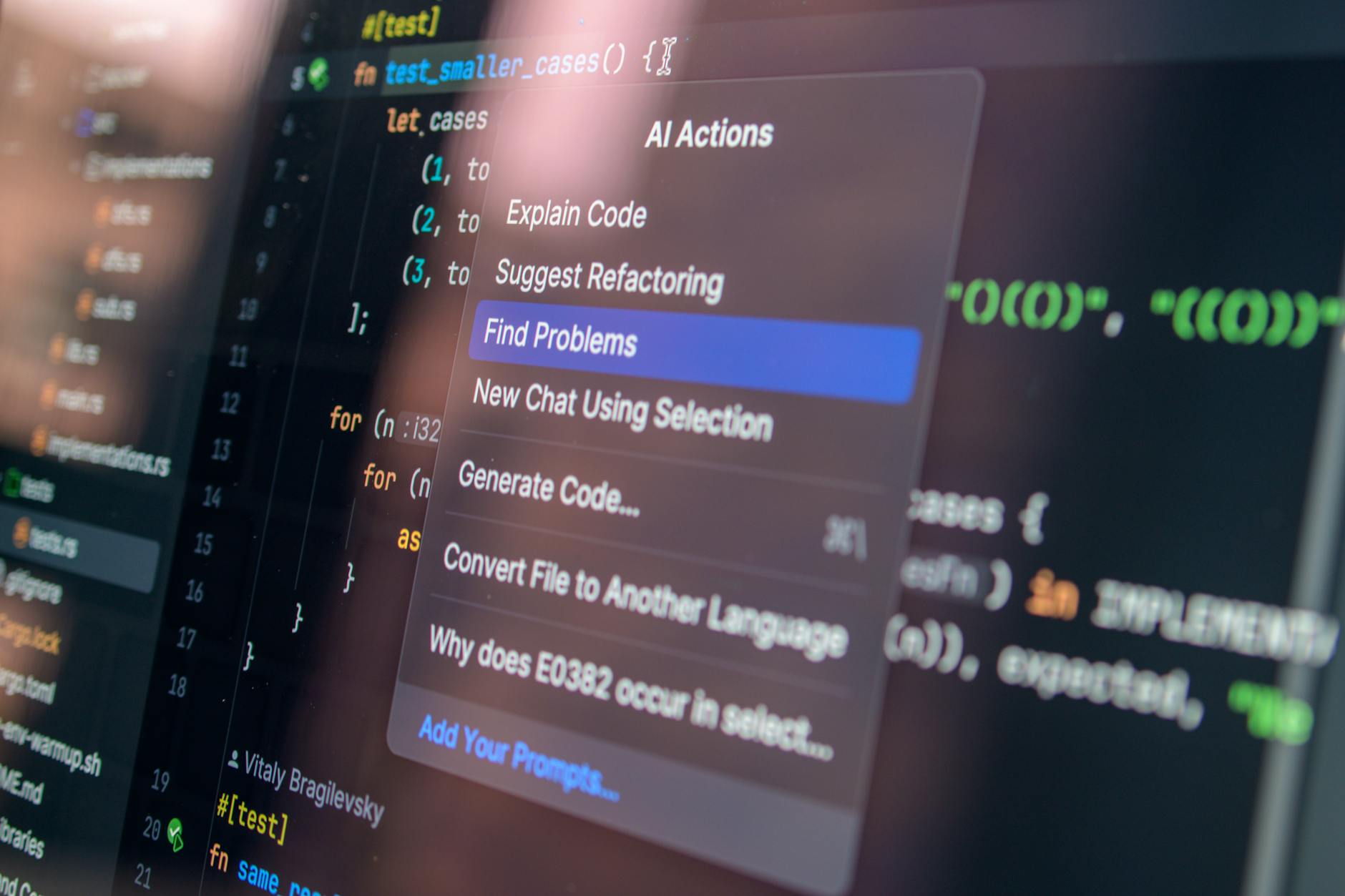

用工具把審查跑起來:從掃描到覆核的 3 段式工作流

我會把流程設計成「先快、再準、最後可追」。因為內容審查如果只靠工具,你會遇到誤判與漂移;如果只靠人工,你會遇到成本爆炸。

第 1 段:人工快速掃描(2-5 分鐘/篇)

用六紅旗清單做 0/1/2 計分,先抓出可疑段落(尤其是語義微錯、上下文跳躍)。

第 2 段:工具抽查(抽 20% 高風險段落)

你可以用任何你們團隊信任的偵測/語言分析工具做抽查,目的不是給你「是/否」,而是補充證據(例如是否呈現非自然一致性或重複模式)。

第 3 段:覆核 + 事實核對(只處理高風險稿)

把關鍵數字、時間點、專有名詞拿去交叉驗證;必要時回到權威來源。CNET 強調的「潛在訓練資料痕跡」在這一段最容易被拆穿:很多看似正確的陳述,經不起原文核對。

把合規當成 SEO 的保護罩

很多團隊以為偵測只是道德或平台規範問題,但我看它更像 SEO 的延伸:內容如果不能交叉驗證,會變成「不可被信任的薄內容」。而薄內容在 2026 的排名生態裡會被更嚴格地重新評估(尤其在高競爭主題)。你做偵測工作流,本質上是在做信任工程。

2026 到底會怎樣?內容平台、合規與 SEO 的長尾影響

生成式內容的問題不會消失,它會更像「水位上升」:看起來更自然、語氣更像真的、速度更快。於是平台和企業的對抗方式也會變:從猜測,走向可稽核的流程。

1) 平台會更依賴「流程」而不是「單點偵測」

OpenAI 的 GPT-2 研究提到偵測挑戰長期存在,這種現實會逼迫平台與企業把注意力移到流程:如何標記、如何抽查、如何做事實核對、如何保存審查紀錄。最後你能不能通過稽核,比「你今天用哪個偵測器」更重要。

2) 合規會變成「內容供應鏈」的一部分

你做的是文字,但你供應的是信任。當內容行銷、社群經營、新聞搬運、甚至客服文案都可能被生成或改寫,企業就會把偵測流程納入內容供應鏈管理:誰生成、誰編修、誰覆核、誰核對來源。

3) SEO 長尾:不是為了排名硬刷,而是避免「低信任內容」拖累

如果你把 AI 生成內容當作快速填充庫存,很容易產出大量語感相似的文章。CNET 提到的「語言多樣性缺失」與「上下文邏輯連貫」紅旗,本質上就是在提醒你:內容可能不夠扎實。2026 的策略重點會更偏向:用可驗證的資料、清楚的論證結構、以及可追溯的來源,去換取穩定的可信度。

Pro Tip:你真正要做的是「證據鏈」,不是「AI/非 AI」貼標

把判斷改寫成:這段文字的結論有沒有可驗證依據?關鍵數字是否能對回來源?邏輯連貫是否成立?只要你把這些做成 SOP,SEO 和合規就會一起變穩。

FAQ

如何判斷一篇文字是 AI 生成還是人寫?

用「六紅旗」而不是「語感」:風格一致性、語言多樣性缺失、微妙語義錯、訓練資料痕跡、模型標記頻率、上下文邏輯連貫。最後用事實交叉驗證覆核。

AI 文字偵測工具準嗎?會不會誤判?

準確度不是開關。OpenAI 的 GPT-2 偵測研究指出內容偵測是長期挑戰,且實務上仍要靠流程(抽查與覆核)來降低誤判成本。

這套方法怎麼用在內容行銷或 SEO?

把偵測流程整合到發布 SOP:關鍵數字與來源核對、回讀邏輯是否成立、必要時抽查高風險段落。讓內容可被驗證,就更能對抗低信任的長尾風險。

行動呼籲 + 參考資料

如果你們正打算把 AI 內容納入產製(或已經在產製),但又擔心誤判、合規與可信度問題——我建議你直接把這套「六紅旗 + 三段式工作流」落到團隊 SOP。

立刻跟我們聊:把 AI 文字偵測流程接進你們的內容審查 SOP

權威參考資料(建議你收藏):

1) CNET:How to Be an AI Detective: Tips for Spotting Bot-Generated Text

https://www.cnet.com/tech/services-and-software/how-to-be-an-ai-detective-tips-for-spotting-bot-generated-text/

2) OpenAI:GPT-2: 1.5B release(包含偵測研究與限制說明)

https://openai.com/index/gpt-2-1-5b-release/

3) Pew Research Center:Misinformation(背景與資料入口,可延伸理解風險語境)

https://www.pewresearch.org/topic/news-habits-media/media-society/misinformation/

你現在可以做的最小一步:選 1 篇近期文章,照「六紅旗計分」標出可疑段落,然後做一次事實交叉驗證。做完你就會知道:真正的差距不是「你是不是 AI」,而是「你有沒有證據鏈」。

Share this content: