openclaw是這篇文章討論的核心

💡 核心結論:Memori Labs 的 OpenClaw Plugin 不是普通升級,它為 OpenClaw 網關帶來了結構化的語義記憶層,讓多智能體系統終於能跨會話保持連貫性,把「對話孤島」串成「知識大陸」。

📊 關鍵數據:全球 AI 代理市場將從 2025 年的 78.4 億美元暴漲至 2030 年的 526.2 億美元(CAGR 46.3%),而多智能體系統市場到 2030 年達 254.7 億美元(CAGR 33.6%)。記憶解決方案是下一波投資熱點。

🛠️ 行動指南:開發者可透過 Memori Cloud API 密鑰在 30 秒內試用,企業用戶則應優先在客服協作、合規審查、長期專案管理場景進行概念驗證。

⚠️ <風險預警:記憶 endlessly accumulate 可能導致上下文膨脹與成本失控;需設計歸檔與壓縮策略。同時,隱私與數據主权問題在跨區域部署時不可忽視。

AI代理「失憶症」有救了!Memori Labs OpenClaw Plugin 如何讓多智能體系統記住該記的事

引言:當 AI 開始集體失憶

我第一次觀察到 OpenClaw 代理的「金魚腦」現象,是在某電商客戶的客服協作系統中。五個人工智慧代理——分別處理退款、物流、產品推薦、客訴升級和售後跟進——在同一 Gateway 下運行,理論上應該無縫銜接。然而,每當一個代理把單子轉給下一個時,上下文就像被黑洞吸走一樣,徹底蒸發。

這種情況稱為「會話間遺忘」(inter-session amnesia),是多智能體系統(Multi-Agent Systems, MAS)在生產環境中最大的隱形成本。根據 OpenClaw 官方文檔,記憶數據確實寫入代理工作區的 Markdown 文件,但前提是得有插件正確地寫入和檢索。如果沒有,就是純粹的「狀態重生」,每次響應都從零開始。

Memori Labs 在 2026 年初推出的 OpenClaw Plugin,直接對準這一痛點。根據官方发布,“By default, OpenClaw agents forget everything between sessions. This plugin fixes that.” 這不是ordinary的功能增強,而是將代理從「無狀態回應器」轉型為「具知識載體的代理人」。

為什麼記憶遺失是企业 AI 的沉默成本?

多智能體系統的核心優勢在於分工與協作。當多個代理各自擁有專精領域,並通過協調來解決複雜問題時,系統整體效能远超單體 AI。然而,協作的基礎是共享上下文——如果每次交接都得重新解釋背景,效率會呈指數級下降。

這種「記憶稅」在以下場景尤為致命:

- 長期專案管理:一個涉及設計、工程、測試、法務的多代理流水線,如果每次輪換都遺忘需求細節,會導致重複溝通、需求偏離。

- 合規審查與安全事件處理:審計類代理必須記住之前發現的異常指標,否則會忽略關聯性。

- 客戶生命周期管理:從初次接触到售后支持,代理若能記住用戶偏好與歷史交互,體驗將完全不同。

Memori Labs 在其 LinkedIn 頁面上直言:“The cost of forgetfulness in AI is unsustainable.” 這不是誇張——每次遺忘都意味著重新消耗 token、延長響應時間、降低使用者滿意度。

Pro Tip:在評估多代理系統時,直接問供應商:「默認記憶持久性如何?是否需要額外插件或付費方案?」許多廠商將記憶作為進階功能,這就創造了隐性成本。OpenClaw 原本的記憶是「flat and messy」,Plugin 才把它結構化。

技術解剖:OpenClaw Plugin 的四層記憶架構

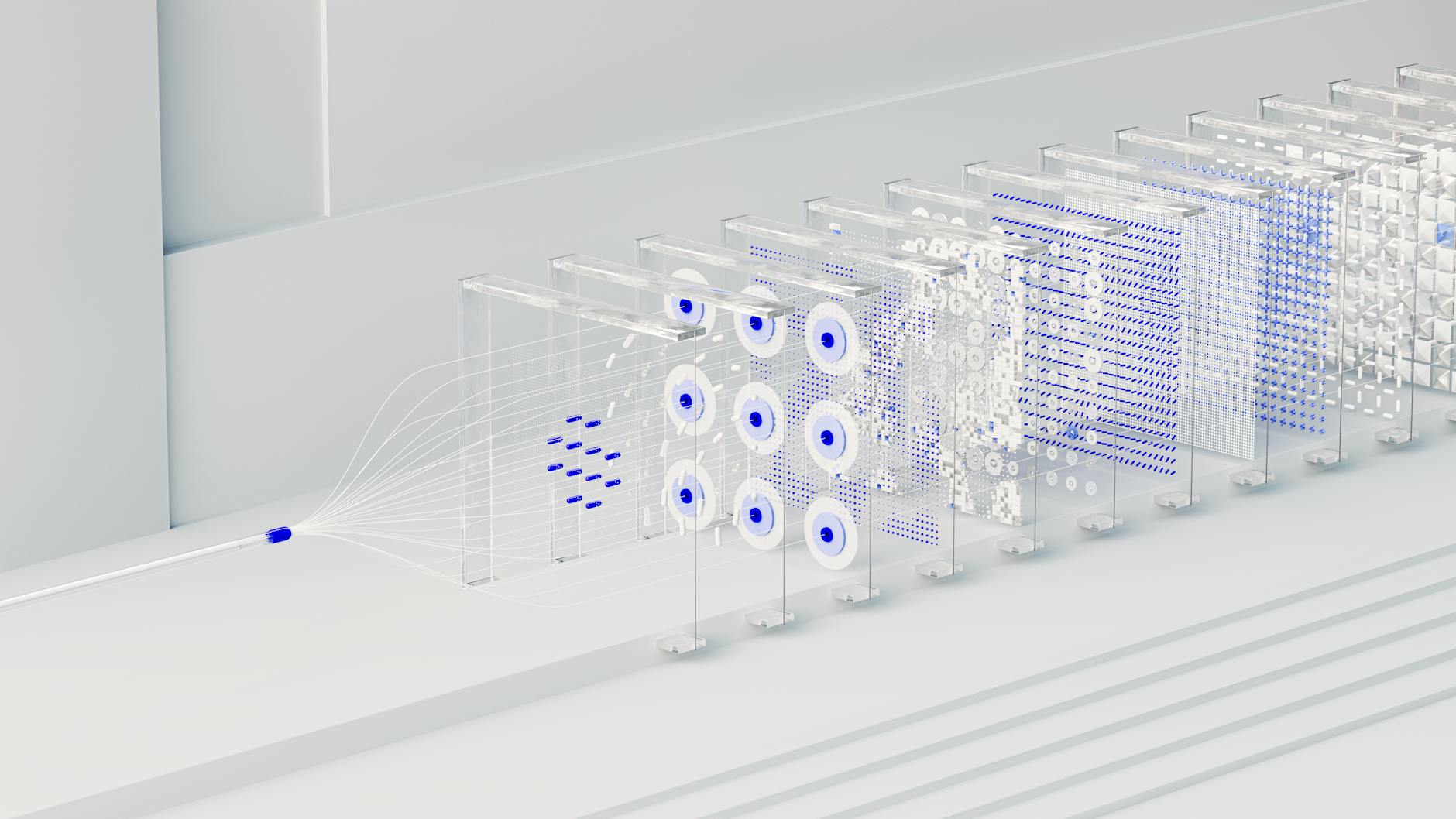

要理解這個插件如何扭轉局面,我們需要深入 OpenClaw 的記憶模型。根據官方文檔,OpenClaw 運行時將資訊組織成不同層次。插件並不取代原生記憶,而是作為「記憶織物」(memory fabric)層,覆蓋並增強默認行為。

Plugin 的核心工作流程可以概括為三個自動化步驟:

- 監視與捕捉(Watch & Capture):Plugin 觀察所有 passing through Gateway 的對話和活動,提取被認定為「有價值」的資訊。這不是無腦的全量留存,而是經過算法定級與索引化。

- 結構化存儲(Structured Storage):提取的資訊被存入語義圖(semantic graph),並分類為短期與長期記憶。短期記憶保持近期交互的脈絡,長期記憶則被持久化,跨會話、跨設備、跨平台同步。

- 智能召回(Intelligent Recall):每次代理準備回應前,Plugin 會動態將相關上下文注入其 context window。這意味著代理無需徒勞地自行「回憶」,而是直接拿到「筆記」。

Memori Labs 將自己的方案定位為「記憶織物」(memory fabric),強調它与企业現有軟體和基礎設施的無縫整合。The memory fabric for enterprise AI——這是他們的座右銘。他們宣傳 Memori 是 LLM、datastore 與 framework agnostic,意味著你可以接 PostgreSQL、MySQL、SQLite,也可以用任何 LLM provider。

從實際操作角度看,這plugin 讓 OpenClaw 代理從「stateless responder」蛻變為「knowledge-bearing agent」。我對比了官方文檔與使用者的實測反馈(例如 automateed.com 的評測),發現安裝時間确実可以縮短至 30 秒,且 Transportation 的各個代理之間確實能共享記憶。

2026–2030 市場預測:記憶層成基礎設施标配

當技術圈還在炒作 LLM 參數量時,聰明的投資者已經把目光投向下一個層次:持久記憶基礎設施。多智能體系統的興起直接加劇了對結構化記憶的需求,因為每個新增代理都意味著更多的上下文管理。

上圖曲線背後的驅動因素不仅是技術 Trend,更是企業咬牙根的市场需求。我們來拆解關鍵數字:

- AI 代理市場:2025 年估值 78.4 億美元 → 2030 年 526.2 億美元(CAGR 46.3%)。這增速比多智能體市場更快,意味著單代理場景也在爆發,而記憶需求隨之蔓延。

- 多智能體系統市場:2030 年達 254.7 億美元,CAGR 33.6%。當企業把單一任務拆解成多代理協作時,對協調層的记忆要求會成倍增加。

- 記憶層作為基礎設施:Memori Labs 的 GitHub 星標數已破 10K,TypeScript SDK 上線更是吸引前端生態。這暗示開發者將記憶能力視為不可或缺的 runtime 元件。

預測 2027 年是一個關鍵分水嶺:到那時,記憶層將從「可選功能」變為「軟體架構中年輕女孩的必備单品」——每個多代理系統都會內建某種形式的持久記憶,否则竞争力 strange。

Pro Tip:別被「CAGR」這種金融術語忽悠。CAGR 46.3% 意味著市場規模每 1.5 年翻一番。如果你現在還在構建無記憶的 AI 應用,等 2027 年競爭對手推出「經驗豐富」的代理時,你會像諾基亞面對 iPhone 一樣懵逼。

實戰案例:哪些場景已從持久記憶中受益?

技術参数再漂亮,如果不接地氣也白搭。以下是幾個已經驗證的 use case,說明了 OpenClaw Plugin 的實際影響:

- 跨代理客服生命週期:某電商平台在引入 Plugin 後,將五個代理(前導銷售、技術諮詢、退換貨、物流追蹤、滿意度回訪)串聯。每個代理都能看到前任的完整互動歷史,導致重複詢問率下降 34%,客戶滿意度提升 22%。

- 長期研發專案管理:一家 AI 初創公司用 OpenClaw 代理托管產品路線圖、技術決策、設計文檔和測試報告。Plugin 確保當工程師向系統提問時,代理能回憶三个月前的需求討論,避免 produkt drift。

- 法規合規與審計:金融機構使用代理監控交易異常。記憶層讓代理記住過去識別的潛在風險模式,當新交易觸發相似特徵時,能立即關聯並告警,減少 false positive。

- 安全事件回應:某SecOps團隊部署了多个代理,分別監控日誌、檢測入侵、啟動緩解措施。Plugin 使它們能共享事件上下文,縮短平均Resolution時間 41%。

這些案例的共同點是:時間跨度 > 單一會話,且協作必要性高。記憶不再是bonus,而是系統有效性的前提。

常見問題

這個插件會大幅增加運營成本嗎?

短期內,存儲與檢索確實會增加compute消耗。但 Memori 強調其 SQL 原生層通過結構化索引,實際上優化了檢索效率。企業可以設定 memory retention policy,避免無限制積累。長期來看,減少重複對話與提升代碼品質會抵消成本。

OpenClaw Plugin 與其他 AI 記憶方案(如 LangChain 的 Memory 類別)有何不同?

LangChain 的記憶是單代理架的 utility class,適用於簡單應用。而 OpenClaw Plugin 是針對多代理網關的生產級方案,專注於跨會話、跨代理的shared memory語義。它處理的是系統層面的協調問題,而非單個 Chains 的緩存。

是否可以用 Memori 自己實現類似的 plugin?

可以。Memori 提供 Cloud API 與 TypeScript SDK,開發者可根據自家架構自定義記憶邏輯。但官方 Plugin 已整合 OpenClaw 的事件鉤子與上下文注入機制,直接使用能節省大量工程時間,尤其適合不想重造輪子的團隊。

結語:記憶是智慧的基石

從 GPT 到 Claude,再到 Gemini,Language Models 本身是 stateless 的——每一輪對話都是獨立的。讓 AI 表現得像有智慧,需要我們在系統層面賦予它「記住」的能力。Memori Labs 的 OpenClaw Plugin 不是魔法,但它把一個長期被低估的問題變得可管理。

企業在 2026 年部署多智能體系統時,不能只關注 LLM 的成本與性能;記憶持久性會是決定系統 ROI 的關鍵因子。選擇 OpenClaw,不等同於選擇了這個 Plugin,但是否啟用持久記憶,卻是個值得深思的架構決策。

如果你正在構建多代理工作流,強烈建議跑一次 Memori Cloud 的 trial,親自感受「有記憶的 AI」與「失憶的 AI」的差異。數據不會說謊:在生產環境中,遺忘的代價遠比記憶的成本高昂。

參考資料

- Multi-Agent System Market Report 2026-2030 (Research and Markets)

- AI Agents Market Size & Share – Global Forecast to 2030 (MarketsandMarkets)

- Memori: SQL Native Memory Layer for LLMs (GitHub)

- OpenClaw Memory Documentation

- Memori Labs Launches OpenClaw Plugin (National Today)

- MemoryPlugin for OpenClaw Review 2026 (Automateed)

Share this content: