API 組合選擇方案是這篇文章討論的核心

目錄

快速精華:💡核心結論、📊關鍵數據、🛠️行動指南、⚠️風險預警

💡核心結論:2026 年選 AI 不該只看「誰最會回答」,而是看這套堆疊能不能長期維護:成本曲線、延遲 SLA、隱私/合規、以及你是否能快速替換模型。

📊關鍵數據(2027 與未來預測量級):Gartner 預估 2026 年全球 AI 支出約 2.5 兆美元,並在 2027 年繼續上揚;同時 Bain & Company 指出 AI 相關硬體與軟體市場可能在 2027 年達到約 7800 億至 9900 億美元 的量級。換句話說,你不是在選一個模型,而是在承擔一整條產業鏈的採購與工程成本。

🛠️行動指南:先定義任務分層(文字/圖像/檢查)、再挑選候選模型(GPT‑5、Claude‑3、以及新興多模態如 Mixtral‑7B、Mistral‑7B),最後用 n8n 或 vibe coding 把「路由 + 測試 + 自動化質檢」變成 CI/CD。

⚠️風險預警:盲追最強模型會導致:吞吐不穩(延遲飄移)、成本不可控(單次推理費爆表)、資料外流風險(隱私策略沒做隔離)、以及維護成本失控(模型版本/接口漂移時你很難回頭)。

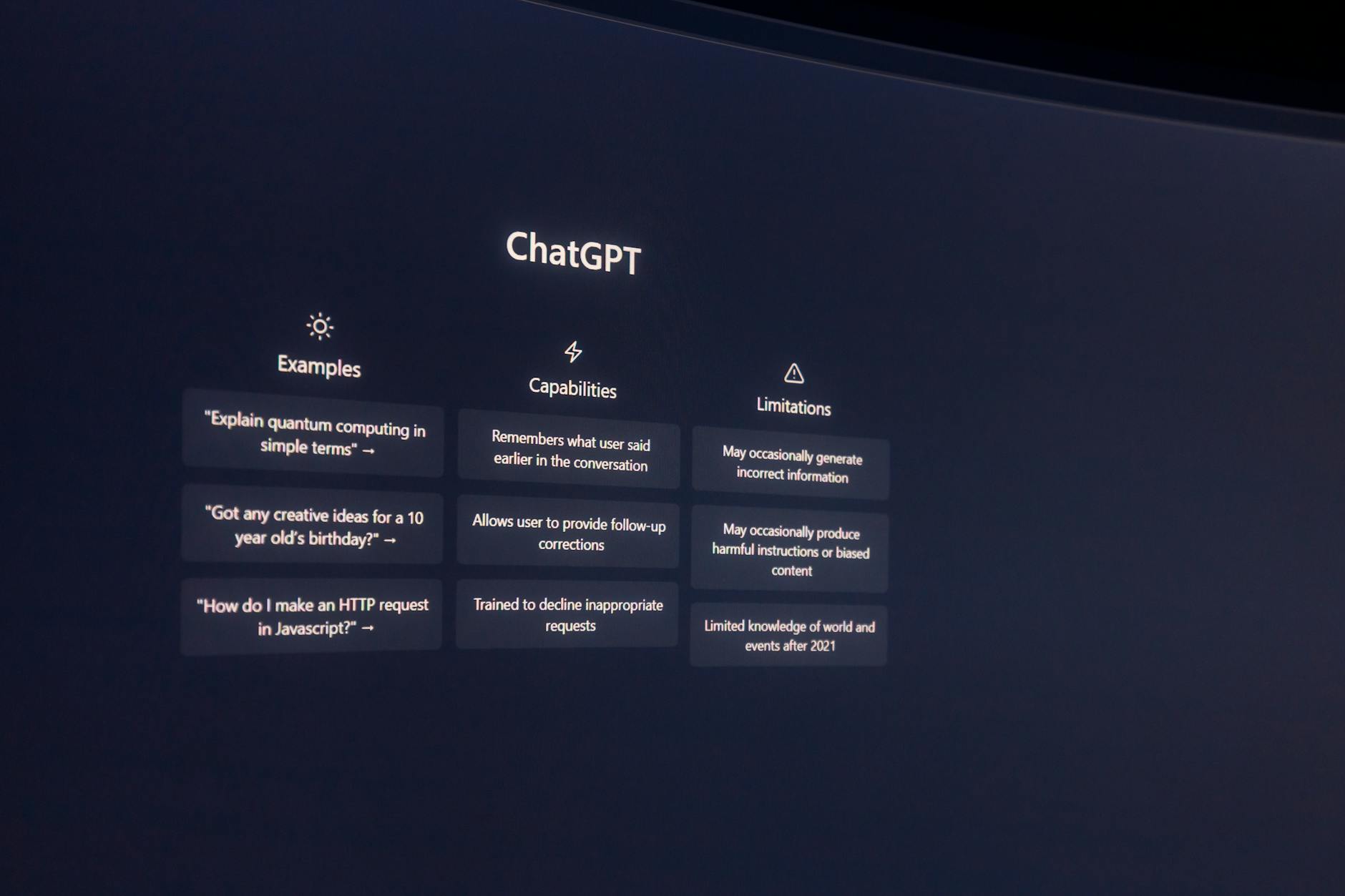

引言:我觀察到開發者最常踩的坑(不是靠實測,是靠反覆看到的模式)

2026 年我在不同團隊的討論裡一直看到同一件事:大家很快就把 API Key 當成捷徑,下一步就是「把最強那台直接接上去」。但實際上,我更像是在觀察到一種通病——當模型選型不跟工程化流程一起走,系統就會慢慢變成「看起來很會、但你不敢改」。

參考你提供的新聞重點:它不是在神化 GPT‑5 或 Claude‑3,而是提醒開發者要回到堆疊思維,去衡量參數量、推理速度、成本以及資料隱私,並且比較開源與專有方案的成本效益。同時它也點名一個更現實的解法:價值即是可擴展性,你得用 n8n 或 vibe coding,把「模型組合」做成可以迭代的 CI/CD 流程,再加上低延遲場景下的量化微調。

所以這篇文章,我會把那個觀念拆成你能落地的選型清單:你該怎麼挑模型、怎麼避免帳單爆炸、以及怎麼把堆疊變成團隊能繼續活下去的工程資產。

2026:為什麼「最強模型」不是答案,而是你的堆疊生存率?

新聞裡的核心主張很直接:別只想著「哪個模型最猛」,要問的是:它在你的產品裡,能不能長期維持可擴展性。可擴展性不是口號,落到工程上通常會拆成四個指標:延遲(速度)、成本(錢)、隱私(風險)、以及可替換性(維護)。

舉例來說,同樣是聊天或文件摘要任務,如果你把 GPT‑5/Claude‑3 當成唯一輸出來源,你的系統就被「單點模型策略」綁死。一旦你遇到版本更新、接口調整、或供應策略變動,CI/CD 沒跟上,你就只能硬改業務邏輯——這就是維護性崩壞的來源。

Pro Tip 的意思是:用堆疊把模型能力拆開來用。你不需要所有任務都用同一個最強模型。新聞也提到多模型組合的做法,目的就是讓系統更像一個產品,而不是一個「模型 demo」。

開源 vs 專有:成本效益怎麼算才不會被帳單背刺?

新聞重點之一是比較開源與專有模型的成本效益。這裡我建議你採用「帳單視角」而不是「模型排行榜視角」。你要算的不只是每次 token 的價格,而是單次任務的端到端成本:包含前處理(embedding/檢索)、推理、後處理(格式化/校驗)、以及失敗重試成本。

以開源模型來說,優勢通常在可控成本與部署彈性;但你需要算上:推理服務維運、人力、以及隨著資料與場景變化的微調/更新成本。專有模型則常見優勢是上手快、性能穩定,但在流量擴張時,單次推理費用可能讓你覺得自己在替別人的基礎建設買單。

新聞也提到一個方向:用低延遲場景下的量化微調來降低資源消耗。這跟開源/專有的策略可以合併成一個「彈性成本模型」。簡單說:把高昂的昂貴推理留給需要高品質的任務,其餘交給低成本但足夠的版本。

Pro Tip(專家見解):不要把「開源或專有」當成宗教。你要做的是建立成本預算:例如為每個任務類型設上限(每次回覆的成本上限、最大重試次數、最大 context 長度)。然後讓堆疊用規則或簡單路由決定:哪些任務用哪些模型。這樣你的系統才會長得像可擴展產品,而不是一張永遠無法預測的支出曲線。

低延遲怎麼辦?量化微調讓吞吐回到正軌

你如果有做過產品層面的 AI 串接,大概懂那種感覺:延遲不是體驗而已,它會把整套流程打散。使用者開始刷新、排隊、重試;你後端的佇列越堆越多,成本也會一起上升。

新聞裡特別提到「在低延遲場景下使用量化微調」。量化微調的核心價值是:讓模型在維持可接受品質的前提下,使用更少的算力,從而改善推理速度與吞吐。你可以把它想成:用工程手段把模型從「很會想」調整成「很會快回」。

在做選型時,你可以把它當成策略:不是所有模型都需要上量化微調;但只要你的某些端(例如客服即時回覆、表單即時校驗)對延遲敏感,就值得把它納入堆疊設計。

把模型組成 CI/CD:用 n8n 或 vibe coding 讓堆疊可維護

新聞給了一個非常工程導向的建議:利用 n8n 或 Vibe coding 框架將選定模型組合成 CI/CD 流程,快速交付文字生成、圖像生成及自動化質檢。

我會把它翻譯成更像你能直接開工的落地步驟:

- 路由層(Model Router):依任務類型(文字/圖像/檢查)與風險等級決定使用哪個模型。

- 驗證層(Quality Gate):加入自動化質檢,例如格式符合性、引用/事實一致性、敏感內容過濾。

- 釋出層(Release Pipeline):把提示模板、模型版本、參數設定納入版本管理;每次調整都走同樣的測試流程。

- 回滾層(Rollback):當品質下降或成本暴增,能一鍵回到上一版堆疊配置。

這時候 n8n 的價值是:它能視覺化工作流,讓路由、測試、報表輸出變成團隊可理解的「流程圖」。n8n 官方文件在這裡:https://docs.n8n.io/(你可以用它去對照節點/觸發器的實作方式)。

至於 vibe coding 框架,你可以參考相關說明文件(例如:Vibe Coding Framework 文件,以及更實作導向的指南:vibe-coding-guide(GitHub))。

FAQ:你最可能在意的 3 件事

2026 選模型時,最優先評估哪些指標?

延遲/速度、端到端成本、資料隱私/合規風險、以及可替換性(版本/接口變動時能不能快速回滾)。

開源模型是不是一定比專有更省錢?

不一定。要把維運、人力、微調更新、品質波動成本一起算進去;通常用任務分層路由最務實。

怎麼把「模型選型」變成可長期維護的流程?

把堆疊納入 CI/CD:路由、品質門控、測試回歸,再到版本化釋出與回滾。

CTA 與參考資料:把堆疊落地,別只停在選型焦慮

如果你想讓 2026 的 AI 堆疊真的「能跑、能改、能控成本」,下一步就是把你的任務分層、模型路由、品質門控與 CI/CD 流程串起來。我們可以一起把你現有的系統補齊成可擴展版本(含選型評估表與自動化測試方案)。

權威參考資料(用來對齊市場規模與實作文件):

- Gartner:2026 年全球 AI 支出約 2.5 兆美元

- Bain & Company:AI 產品與服務市場可能在 2027 年達到約 7800 億至 9900 億美元

- n8n 官方文件

- Vibe Coding Framework 文件

補充:你提供的參考新聞主軸(選型評估、開源/專有成本效益、低延遲量化微調、用 n8n 或 vibe coding 組 CI/CD、以及「價值即可擴展性」的警示)已被整合到本篇的結構與建議中。

Share this content: