AI 造像宗教爭議是這篇文章討論的核心

快速精華

💡 核心結論:把政治人物用「宗教聖像語彙」包裝,短期吸睛、長期更容易引發倫理譴責與社群斷裂,最後變成信任成本。

📊 關鍵數據:到 2026 年,全球 AI 相關支出預估將達 約 2.5 兆美元(Gartner 預測:2.52 兆美元)。而 AI 相關硬體與軟體市場在 2027 年可望逼近 0.78~0.99 兆美元(Bain 預測區間)。這意味著:AI 內容會更便宜、更快、更普遍,也更難以「只做一次」就算數。

🛠️ 行動指南:若你是政治/品牌/平台的內容負責人:先做「宗教與仰慕語意風險評估」、再上「可追溯證據鏈(provenance)」;把可疑造像的審核流程做成流水線,不要靠臨場情緒。

⚠️ 風險預警:一旦牽到宗教象徵與宗教領袖相似度,反彈往往不是理性辯論,而是「神聖性被冒犯」的情緒動員;這類事件會迅速外溢到媒體、監管與廣告合作方。

引言:我觀察到的第一波反應

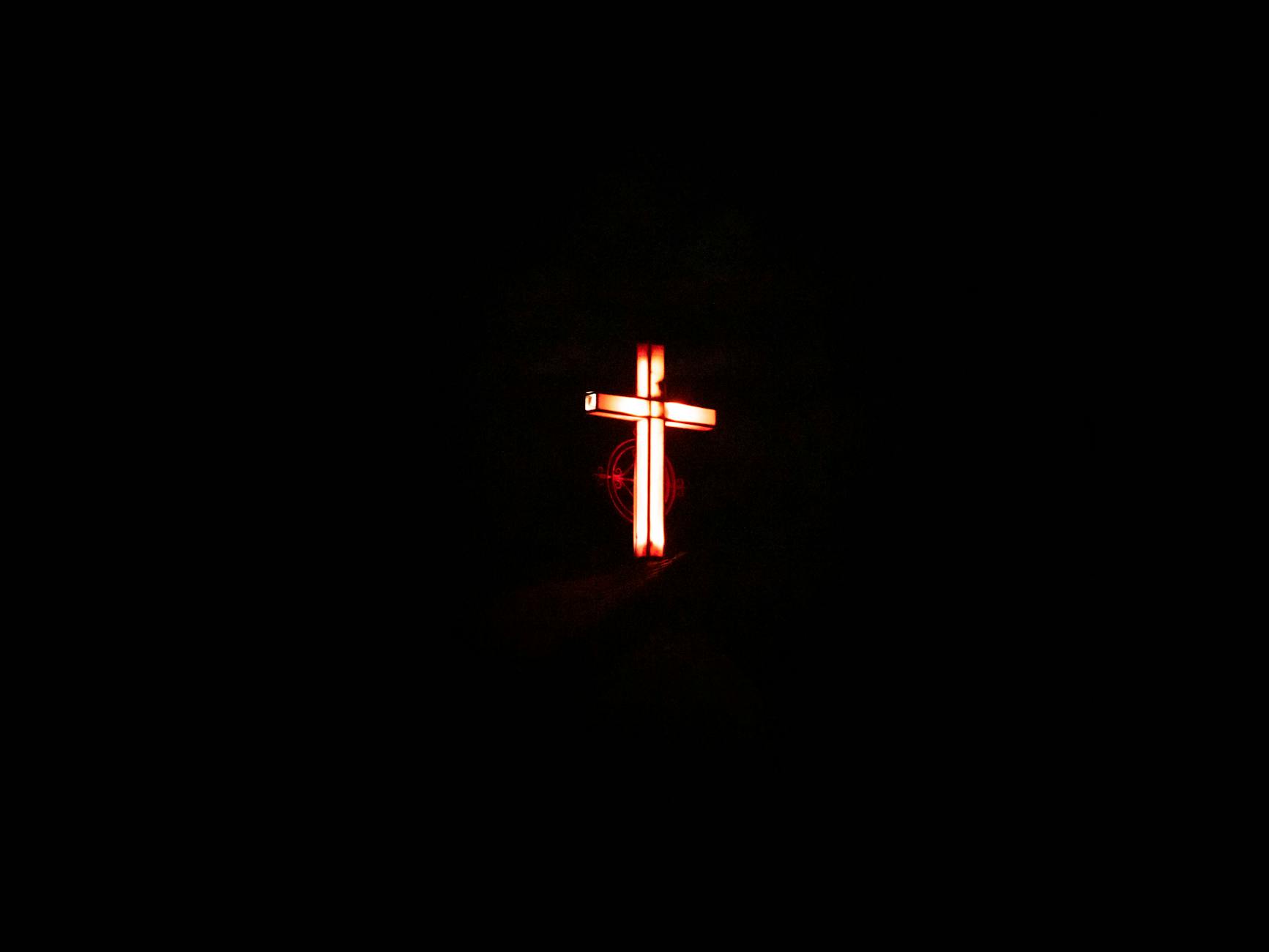

我先說我看到的狀況:在 Truth Social 上那張「AI 生成圖像」把唐納·川普弄成類似耶穌的形象,還帶著與教宗利奧(Pope Leo)相似的敘事語彙,消息一出來,社群不是先糾結技術細節,而是直接跳到「這是不是在褻瀆?」那種即時的道德警報,來得非常快。更關鍵的是,批評不只來自一般使用者,還包括在芝加哥的信奉天主教社群,反對點集中在政治人物被拿去「融合宗教聖像」這件事上——對他們而言,這不是梗圖,是界線被碰到。

AI 造像把川普「畫成耶穌」:到底發生了什麼?

依據多家媒體報導,川普在 Truth Social 上發布一則引發爭議的貼文:貼文包含一張被認為是 AI 生成的圖像,將川普描繪成類似耶穌的形象,且在視覺與敘事層面,讓人聯想到教宗利奧。圖像配上的文字同樣讓支持者與批評者分群:支持者可能把它當作「帶風格的政治宣傳」、反對者則把它解讀為把政治人物與宗教聖像混為一談。

在這場爭議裡,真正推動事情擴大的不是單一貼文,而是「象徵」的力量:宗教圖像在多數文化裡不只是視覺,而是信仰秩序的一部分。當 AI 生成的造像把政治敘事包進宗教語言,等於在公共討論區把兩套社會規則硬拆後重新拼裝——拼裝成功會變成話題擴散;拼裝出界就會反噬。

為什麼這種宗教式 AI 內容特別容易引爆?

原因其實挺「人性」。宗教符號的敏感度不在於它能不能被辯論,而在於它是否被視為被冒犯。AI 生成讓「冒犯的門檻」變低:以前你要找攝影棚、找美術、找專業導演;現在你只要會提示詞或會用工具。速度快,象徵移植的失誤率也會跟著上來。

更糟的是,政治宣傳的誘因常常是:做得越像、越有象徵重量,越能讓受眾「腦內自動配對」成某種崇拜敘事。當圖像與教宗/耶穌的典型視覺要素相似,受眾就會瞬間完成連結;然後負面情緒也會同樣瞬間完成連結。

Pro Tip|你要看的不是「像不像」,而是「誰先被觸發」

專家式觀點:把生成內容丟到公共平台之前,團隊應該問一個問題——第一波被觸發的受眾是誰?如果第一波是宗教社群(例如芝加哥的天主教圈),你得到的不是單純的批評,而是「神聖秩序」被侵犯的集體反應。這類反應的擴散邏輯跟一般政治立場不同:它更靠情緒動員與社群背書,而不是靠論點勝負。

用數據與案例說話:反彈不是小概率

我們把現象落到數據。先看「供給側」:AI 產能在 2026 年仍快速擴張。Gartner 預測2026 年全球 AI 支出約 2.52 兆美元(2.5 兆等級),代表生成式內容的工具、算力與商業服務會更普及。也就是說,像這種「快速生成、快速上線」的做法,會變成常態,而不是特例。

再看「市場側」:Bain 的研究提到,AI 相關硬體與軟體的市場到2027 年可能達 7800~9900 億美元(約 0.78~0.99 兆美元)。當市場把成本壓下來,政治宣傳也會更容易把 AI 用作「敘事放大器」。放大器越強,越需要風險控管,因為錯誤放大的速度也會同等變快。

最後看「治理側」:針對政治領域的深偽與生成式假內容,多份分析都指出它會沖淡真實感、侵蝕公眾信任。這次事件雖然是宗教象徵的爭議,但底層機制是一樣的:它讓人們更難分辨「意圖」與「真實」。當大量 AI 內容充斥,社會會傾向用「保守審判」來應對不確定性,於是你可能得到的不是支持率提升,而是更高的警惕與更低的包容。

2026 政治團隊要怎麼用、又怎麼不踩雷?

如果你現在還把 AI 當成「只是更快做內容」,那你會在 2026 年吃到反噬。原因很簡單:當政治內容被包在宗教/文化象徵裡,誤判的代價不是一則留言,是社群切割與長期信任折損。

行動指南(可落地的那種):

- 做語意風險分級表:把「宗教聖像語彙、教宗/神祇相似度、死亡/救贖意象」列入高風險類別;只要命中就進二審或禁止上線。

- 引入可追溯證據鏈(provenance):讓內容有可驗證的來源標記、生成流程紀錄。至少要能回答「這張圖怎麼來、何時生成、用的是哪種模型/版本」。

- 建立社群外部審閱機制:不要全由內部判斷「像不像」,而是找理解文化脈絡的外部顧問做快速紅隊測試。

- 把回應預案寫進 SOP:一旦觸發大規模批評,回應要先承認界線被撞擊,再說明你如何調整流程,而不是只辯論「技術上是不是 AI」。

順帶一提,OpenAI 這類平台也有公開提到「偵測、預防與干擾濫用生成式工具」的方針方向。對內容團隊而言,這不是在等平台救火,而是用平台的治理精神反推自己的內控。

FAQ

Truth Social 上這種把政治人物畫成宗教形象的 AI 圖片,為什麼特別容易被認為褻瀆?

因為它把宗教聖像/救贖語彙挪到政治敘事,對信仰社群而言不是一般「影像梗」,而是被認定為冒犯神聖秩序。AI 生成又讓相似度與擴散速度變快,情緒動員更容易成立。

如果我是內容團隊,要怎麼降低 2026 年這類爭議風險?

做語意風險分級、要求可追溯的來源/生成流程紀錄,並用外部文化脈絡的紅隊測試取代「內部自嗨判斷」。一旦觸發大規模批評,流程要能快速承認界線被撞擊並調整,而不是糾纏技術對錯。

這類事件對未來政治宣傳與平台治理會造成什麼影響?

供給端(AI 工具與算力)越強,生成式政治內容會更普遍;治理端就更可能走向要求可驗證的內容來源、強化平台審核與記錄保存。最終,信任與可追溯性會變成政治內容的競爭門檻。

CTA 與參考資料:你想把 AI 用得更穩嗎?

想把「高吸睛」跟「低翻車」同時做到?歡迎直接跟我們聊:我們能幫你把 AI 內容審核流程、風險分級、以及追溯/回應 SOP 一次整理成可落地的版本。

權威參考(真實可點):

Share this content: