Anthropic AI 模型風險是這篇文章討論的核心

英國監管機關為何急著重估 Anthropic 最新 AI 模型風險?2026 金融與企業部署的「防爆路線」

目錄

快速精華(先把重點撈出來)

💡 核心結論:英國監管機關正在用「快速風險評估」追趕最新 AI 能力的外溢效應——尤其是網路安全、合規落差與金融體系韌性測試這三條線。這不是情緒性喊停,而是把導入前的防爆流程補齊。

📊 關鍵數據(2027 & 未來量級):AI 投資的水位仍在高檔。以 Gartner 預估為例,2026 年全球 AI 支出約 2.52 兆美元,而且年增率達 44%。當支出持續擴大,安全測試、合規治理與供應鏈風險控管會跟著變成「必買項」。

🛠️ 行動指南:把模型風險拆成三段檢查:①輸出可能造成的危害類型(濫用/資安)②合規缺口(流程、留痕、第三方控管)③韌性測試(在你自己的環境做攻防紅隊與故障演練)。

⚠️ 風險預警:最大雷點不是「模型會不會失控」,而是你以為自己已經做完安全,結果抽查時發現:測試方法不完整、資料流沒治理、或第三方整合點沒有被納入風險評估。

引言:我觀察到的「加速審查」訊號

我更傾向把這件事叫做「觀察到的風向變了」。原因很簡單:英國監管機關正在急速評估 Anthropic 最新 AI 模型帶來的風險,焦點落在潛在危害、合規是否跟得上,以及它對英國地區 AI 部署的更大影響。這種節奏,通常代表兩件事:第一,模型能力的外溢風險正在變得更具體;第二,監管不想等出事才補課。

換句話說,不是新聞在煽情,是現場在逼你把「導入前的檢查清單」升級。尤其金融業的 IT 與資安,牽涉到連鎖反應——不是某個部門的事故而已,可能會滾成系統韌性的壓力測試。

下面我用更工程、更落地的方式拆給你看:英國為何盯上這個新模型?你所在的企業或團隊,未來 12–24 個月要怎麼把風險控管做成「能過關的流程」,而不是一張好看的文件。

為什麼英國會盯上 Anthropic 最新模型?風險到底卡在哪裡?

依據報導,英國監管機關的評估不是泛泛而談,而是聚焦在三個核心面向:潛在危害、合規可能存在的落差,以及 更廣泛的部署影響。而且它是「緊急/急速」的調查節奏,代表他們正在把風險視為可操作的項目,而不是哲學討論。

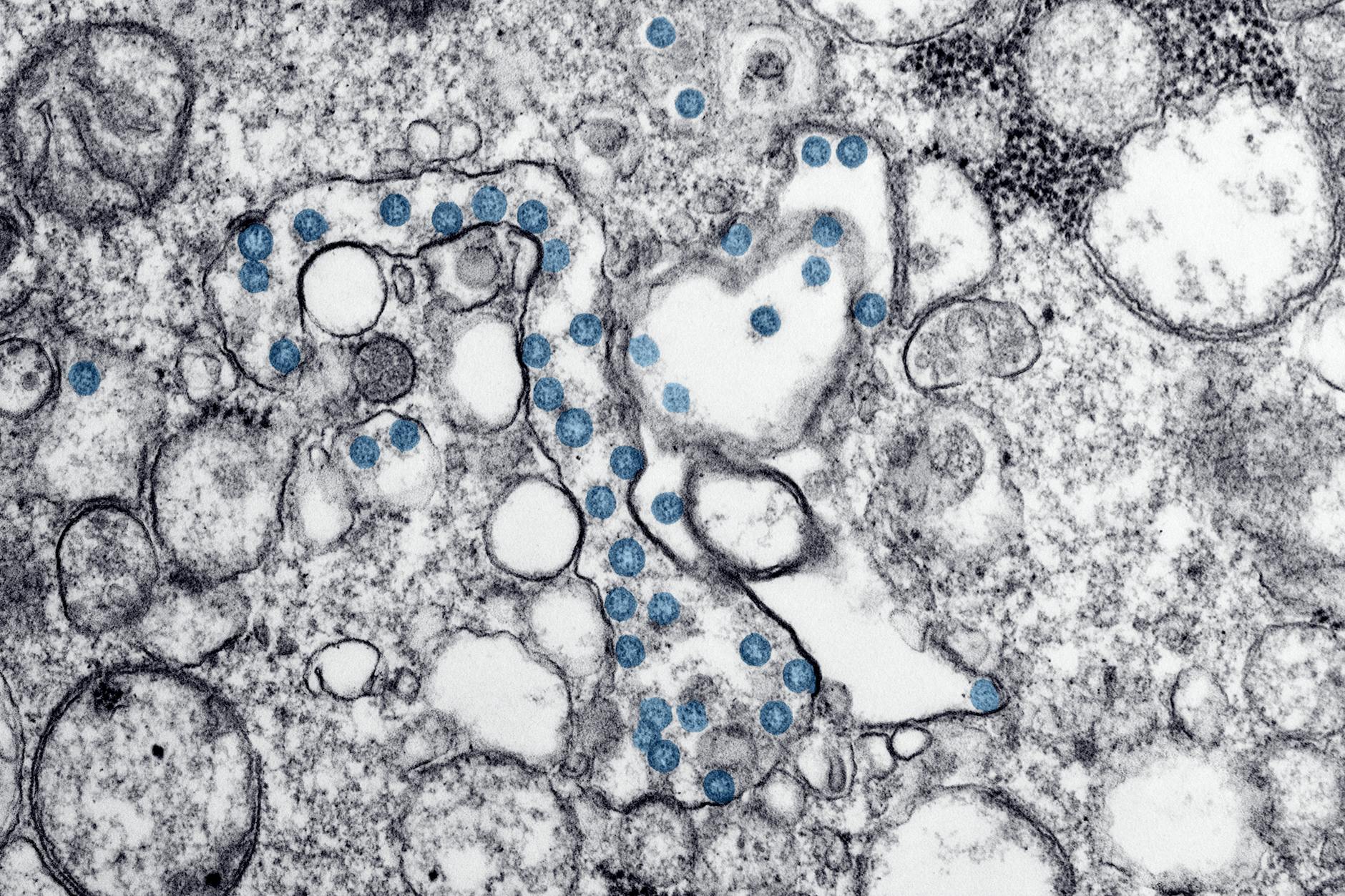

如果你把 AI 模型當作「能推理、能生成、也能被包進流程」的系統,那風險就不只在模型本身。真正麻煩通常出現在:模型輸出進入你的工作流後,會不會造成資安弱點被放大、或合規文件與資料治理沒有銜接上。

你可以把這理解成監管機關正在做一種「風險拆彈」。先把危害類型釐清,再看合規鏈條有沒有被切斷,最後回到部署現場:這套能力一旦被廣泛使用,會不會把風險擴散到你所在的領域。

而這種流程,會直接改寫企業導入 AI 的優先順序:安全測試與治理能力,逐漸從「附加條件」變成「上架門票」。

從金融業的痛點看:模型越強,合規與韌性就越像「硬仗」

金融業的現實就是:你的系統不只是「能用就好」,而是要能在故障、攻擊或異常情況下維持運轉。當報導提到監管與銀行、以及資安單位之間的緊急評估,就意味著他們關心的不是純技術好壞,而是:金融機構如何在風險暴露時仍然守得住。

在這裡,我們也能把英國資安體系的角色放進來理解。英國的國家網路安全中心(NCSC,隸屬 GCHQ)一直扮演指引與支援的重要角色,協助企業與公共部門提升網路韌性與防護。當監管把資安單位拉進來談,等於把「模型能力」直接拉進「系統防護與復原能力」的討論場域。

所以你會看到,監管急著評估,是因為「金融系統」的容忍度很低:一旦模型被部署到錯誤的流程或錯誤的資料管道,後果可能不只是一個錯誤答案,而是觸發更深的資安或合規鏈問題。

2026 供應鏈怎麼被改寫:從算力投資到安全測試的資源重排

這裡有個很現實的經濟邏輯:AI 支出仍然在上行,代表企業不會因為風險討論就停下投資。相反,投資會被重新分配。

以 Gartner 的預估,2026 年全球 AI 支出約 2.52 兆美元,而且年增率達 44%。當這個水位繼續上升,供應鏈會出現一個「新常態」:除了算力/模型/應用,資安測試、模型治理、稽核留痕、第三方整合風險評估,會被納入預算核心,而不是放到最後才補。

你會發現供應鏈正在把成本往「可驗證」的地方移動:可測試(testing)與可稽核(auditing)會變成新的競爭門檻。監管加速風險評估,就像把企業的路標改到「防爆路線」。

Pro Tip:企業要怎麼做風險測試,才不會被抽查打到翻桌

Pro Tip(工程師視角):把「模型」當成會走進生產環境的第三方攻擊面。

別只測回答品質。你要測的是:當模型介入你的流程、資料與權限後,會不會讓風險被放大,並且你是否有證據鏈可以在抽查時拿出來。

下面給你一個比較像「落地作業」的清單(不是口號)。這份清單對應英國監管所關心的:危害類型、合規缺口、以及部署影響。

1)先做「危害地圖」:列出模型在你場景下可能輸出的三類高風險內容,例如協助濫用、導向可被濫用的操作步驟、或把安全規則繞過。這一步要可追溯:每個風險點對應到測試用例。

2)合規不要只寫政策,要寫「流程」與「留痕」:問自己三個問題:a) 誰批准模型上線 b) 輸入輸出在哪裡記錄 c) 第三方(含雲端或整合商)資料流如何納入治理。很多合規缺口不是政策沒有,而是證據鏈不完整。

3)把韌性測試做成演練,不是一次性測驗:至少做一次「降級演練」:當模型輸出異常或疑似觸發高風險模式時,系統如何自動限縮?以及怎麼回滾或切換到保守策略。

4)把資安單位拉進來對齊測試方法:監管在評估時會與資安監管、銀行等利害關係人互動,背後就是要確保方法論能站得住腳。你企業內部也一樣:安全團隊與產品/平台團隊要用同一份測試語言。

數據/案例佐證部分:本次討論的核心背景來自外媒報導指出,英國監管機關正急速評估 Anthropic 最新 AI 模型風險,並且與金融體系相關角色、以及政府資安單位協調評估流程。這個「多方聯動 + 速度」的模式,正好說明:風險測試必須可驗證、可交流、可落地。

FAQ:你可能真正想問的 3 件事

英國監管機關為什麼要急著評估 Anthropic 最新 AI 模型?

因為外媒報導指出評估聚焦在潛在危害、合規缺口,以及模型部署可能帶來的更廣泛影響,並以「緊急/急速」的節奏推進。

企業導入 AI 時,應該把資安測試放在什麼位置?

放在上線前的必經流程:要能驗證危害地圖、留痕與降級演練,而不是只做單次性能/品質測試。

2026 為什麼這波風險議題會牽動供應鏈投資?

AI 支出規模仍大。當市場投資持續擴大,監管與客戶要求會推動治理/資安測試成為標準交付內容。

行動呼籲與參考資料

你如果正在評估把 AI 模型導入客服、自動化流程、或企業內部助理:別等到監管或客戶問到「你怎麼驗證風險」。現在就把你的測試用例、留痕方式與降級演練整理出來,才能在 2026 年的節奏裡不被動。

參考資料(權威來源/外媒報導):

- Reuters(2026-04-12):UK regulators rush to assess risks of latest Anthropic AI model(外媒報導背景,含監管與利害關係人協調的描述)查看連結

- Financial Times(外媒同主題的背景報導,涉及央行/監理與資安單位協作)查看連結

- Gartner(2026-01-15):Worldwide AI spending forecast totals $2.52 trillion in 2026(用於關鍵數據)查看連結

- UK NCSC(National Cyber Security Centre):官方說明其協助企業與公部門提升網路安全與韌性< a href="https://www.ncsc.gov.uk/" target="_blank" rel="noopener">查看連結

Share this content: