xAI承諾透明度是這篇文章討論的核心

馬斯克與xAI的「唯一承諾」到底有多透明?——2026年AGI安全監管的硬仗怎麼開始

自動導航目錄

快速精華

這篇不是在吵「誰比較會講願景」。真正的戰場,是:AI開發者與投資方能不能把安全承諾變成能被外界檢驗的流程與報告。

- 💡核心結論:當公眾與投資者開始要求「風險披露、實施透明、排除隱藏用途」的證據時,AGI相關公司會被推進一種新的競爭規則:不只比模型強度,還要比治理強度。

- 📊關鍵數據(2027年及未來預測量級):全球AI市場規模在 2027 年可望跨到 數兆美元等級(不同機構口徑略有差異,但趨勢一致:超大規模滲透到產業採購與公共服務)。

對應到你我最在意的「透明度」:越大規模,就越容易觸發監管、訴訟與採購風險,因為資料、能源與影響面同時放大。 - 🛠️行動指南:看一家公司是否真的負責,別只看宣言,請用這4步:

1) 安全承諾的 可驗證指標(不是口號);2) 風險披露的 週期與範圍;3) 外部監督的 實權;4) 對高風險情境的 限制與審計。 - ⚠️風險預警:缺少透明流程時,最常出現的是「承諾說了、但落地無法追溯」:外界會只能靠傳聞或零碎文件推測,最後變成社會成本(爭議、延誤、法律風險)由產業鏈一起吞。

引言:我們在等的不是口號,是可驗證的承諾

我看了一則來自《每日孟菲斯人》的專欄,作者 Calkins 的主張很直接:當 Elon Musk 與新創 xAI 的 AI 願景引起關注時,公眾與投資者不該只被「願景」牽著走,而要追問他們所作的「唯一承諾」到底有沒有被具體落實、是否透明、是否做了風險披露、會不會有潛在隱藏用途。

這裡我不講自己有沒有「實測」模型安全性,因為新聞本身是從社會觀察與治理要求切入的;比較合理的是把它當作一種 觀察:當市場估值與監管注意力同步升溫,外界開始用更硬的方式檢驗 AI 公司的承諾。

為什麼「透明度」會變成xAI與投資人共同的風險?

透明度在 2026/2027 的意義,早就不是「你有沒有公開聲明」而已。它會直接影響投資人如何做風險定價,也影響企業採購、政府招標、以及供應鏈的合規成本。

以 Calkins 的批評框架來看,核心問題是:安全承諾如果不配套透明的實施機制,外界就無法判斷它是真在降低風險,還是只是降低爭議。

所以你會看到,這不只是 xAI 的問題,而是投資端如何要求管理層提供可審計資訊;同時也會變成產業端採購條件的一部分:越來越多企業會把「治理與透明度」當成供應商評分項。

Pro Tip:把「透明度」翻譯成可驗證輸出

對投資人或採購方來說,最有效的提問不是「你們承諾什麼」,而是:你們願意提供哪些可審計的輸出?例如風險評估的更新頻率、模型/系統的限制清單、重大事件回溯流程、以及外部審核的授權範圍。

只要能把它寫成制度流程,透明度就不會只剩公關語言。

風險披露缺口怎麼卡住監管?看懂「隱藏用途」的結構

Calkins 的指責重點之一,是「缺乏合法監管、缺失風險披露與潛在隱藏用途」的疑慮。這句話背後有一個結構:風險披露越弱,監管就越難用合理方式介入;監管越難介入,外界就更容易把疑慮升級成更大的制度要求。

用比較直白的方式講:當外界看不到明確的風險清單與處置策略,就會假設「最壞的情境」仍可能發生;而「假設最壞」本身就會推高外部成本——包含合規、法律風險、以及公共信任的折扣。

你在看新聞時,可以把「透明度」拆成兩種:

(1) 內容透明:你說你做了哪些安全措施?

(2) 流程透明:你怎麼證明你真的做了?有沒有審計、有沒有回溯、是否能在重大事件後交代。

回到新聞的語氣:當 Calkins 呼籲股東與社會監督,就等於在要求流程透明。這也是為什麼「合法監管」與「風險披露」會被捆在一起:沒有披露就無法監管;沒有監管又容易把承諾推成口號。

AGI路線的責任分工:股東監督、社會回饋、技術落地

有趣的是,這類爭論很快會被誤解成「陰謀論 vs 科技樂觀」。但真正可操作的討論其實是治理設計:誰有責任?責任如何被執行?執行如何被追蹤?

Calkins 在專欄中點出:公眾與投資者要要求透明度與實施,並促發更負責任的 AGI 發展路線。把它翻成實務,就是把責任從「口頭承諾」搬到「可檢驗制度」。

Pro Tip:用「審計」而不是「信任」來做決策

對董事會與重大投資案,建議用「里程碑式」治理:每個關鍵階段(例如高風險能力測試、部署前審查、重大事故後)都要求外部或第三方可讀的證據。

這樣即使外界立場不同,也能用同一套證據標準對齊。

這裡我也補一個可落地參考:一些權威倡議/組織會把安全與治理寫成「章程(charter)」形式,目的就是把承諾制度化。例如 OpenAI 的 OpenAI Charter,用於表述使命與安全原則、以及如何在不確定性下仍追求一致的治理方向。

注意:這不是要你拿某一家公司的文字當作免責符,而是說明「章程化」能讓外界更容易抓住同一把尺,而不是只能靠情緒評論。

2026年產業鏈會怎麼被改寫:模型、算力、合規與採購

接下來談最關鍵的:這場爭論會怎麼滲透到 2026 年後的產業鏈?

如果透明度與風險披露變成採購條件,那你會看到供應鏈分工重新洗牌:

- 模型供應端:不只提供能力,還要提供風險評估與限制清單(例如高風險用例的排除/審核方式)。

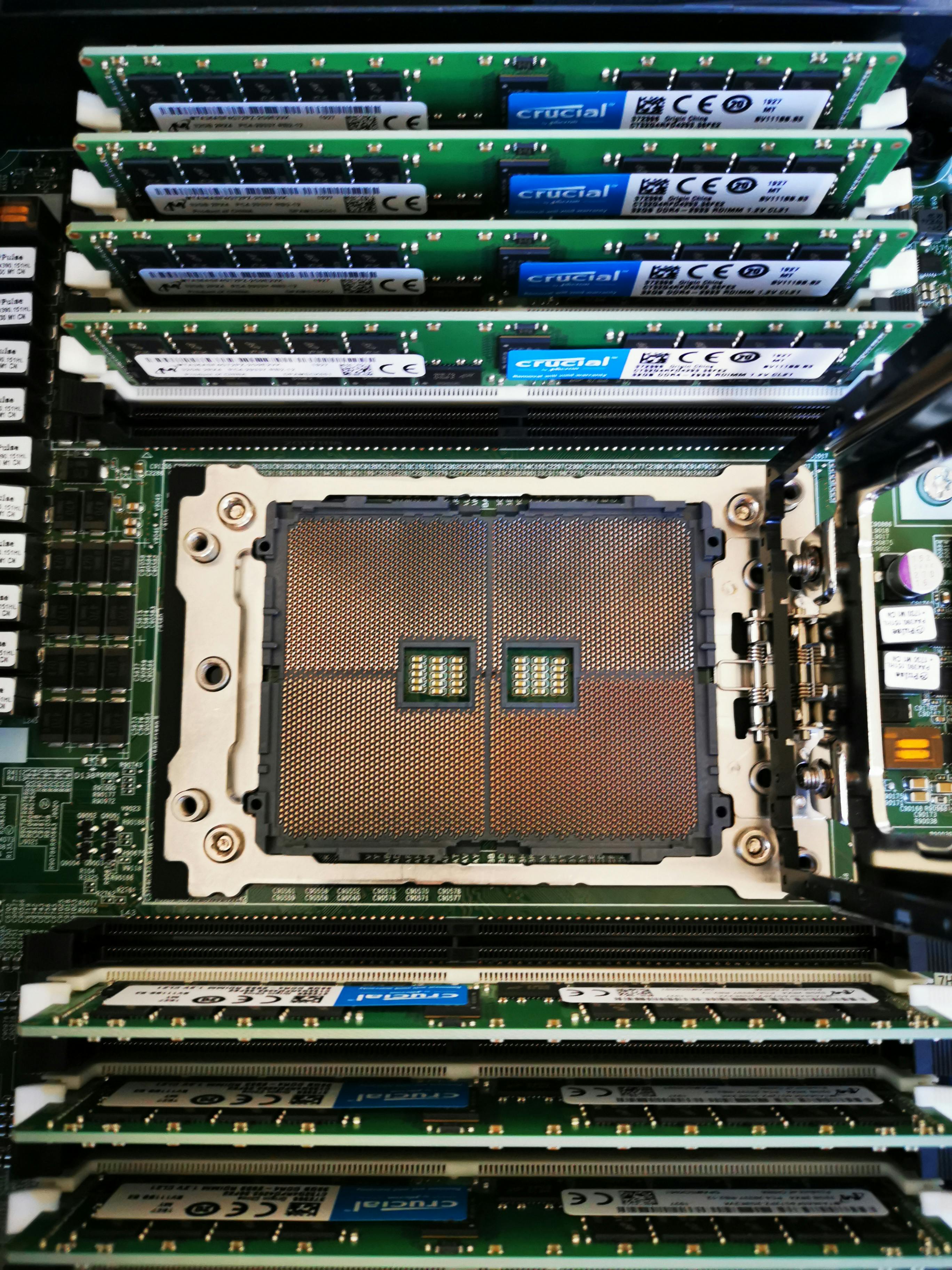

- 算力與資料端:資料來源、能源使用、與安全處置也會被納入審計範圍(因為這些都影響風險外溢)。

- 整合商/系統商:會被要求提供「可追溯責任」,避免把風險甩給終端使用者。

- 採購與法遵團隊:會更早介入產品規劃,把「可驗證透明」寫進合約。

你可能會問:那「數字」在哪?簡單說,當 AI 市場在 2027 年朝數兆美元規模滲透時(大量投資與部署勢必同步擴張),每一家企業都會用更嚴格的方式處理供應商風險。這就是為什麼我們會看到治理、透明度、風險披露逐漸變成一種「成本結構」而不是「價值宣言」。

簡而言之,2026 年之後你會更常遇到這種情況:供應商不是輸在技術,而是輸在治理證據鏈不夠完整。這也是 Calkins 呼籲監督的長遠影響:它把「責任」從道德層面推回制度層面。

FAQ:你在查的其實是同一件事——如何判斷承諾是否真

新聞在講的「唯一承諾」要怎麼理解?

從Calkins的專欄脈絡來看,關鍵不在於口號本身,而在於外界要求它能被具體落實並提供可驗證的透明流程與風險披露。

普通消費者或企業要怎麼判斷一家AI公司有沒有在做負責任治理?

看可審計的指標、限制/審核流程、以及外部監督或第三方可讀的審核證據;能把承諾翻成制度流程的,比只會講願景的更可靠。

如果風險披露不足,最直接的影響會是什麼?

通常是外部成本上升:採購與合規難度變高、監管介入更慢更保守,社會爭議與法律風險更容易累積。

行動呼籲與參考資料

如果你是企業採購、投資或法遵相關的人,現在就可以把這套「透明度=可驗證流程」當作內部提案模板:要求供應商提供可審計的風險披露與治理證據鏈。

權威文獻/參考:

- 《每日孟菲斯人》Calkins 專欄(來源新聞):https://dailymemphian.com/subscriber/article/61763/

- OpenAI Charter(章程化安全與治理的參考):https://openai.com/charter/

- (補充讀)OpenAI Files(關於安全文化與承諾落地的討論脈絡):https://www.openaifiles.org/vision-for-change

最後一句不繞:2026 年以後,你看見的不是更多「AI 口號」,而是更多「證據要求」。誰能把承諾變成可驗證流程,誰就比較有機會把風險成本留在自己手上。

Share this content: