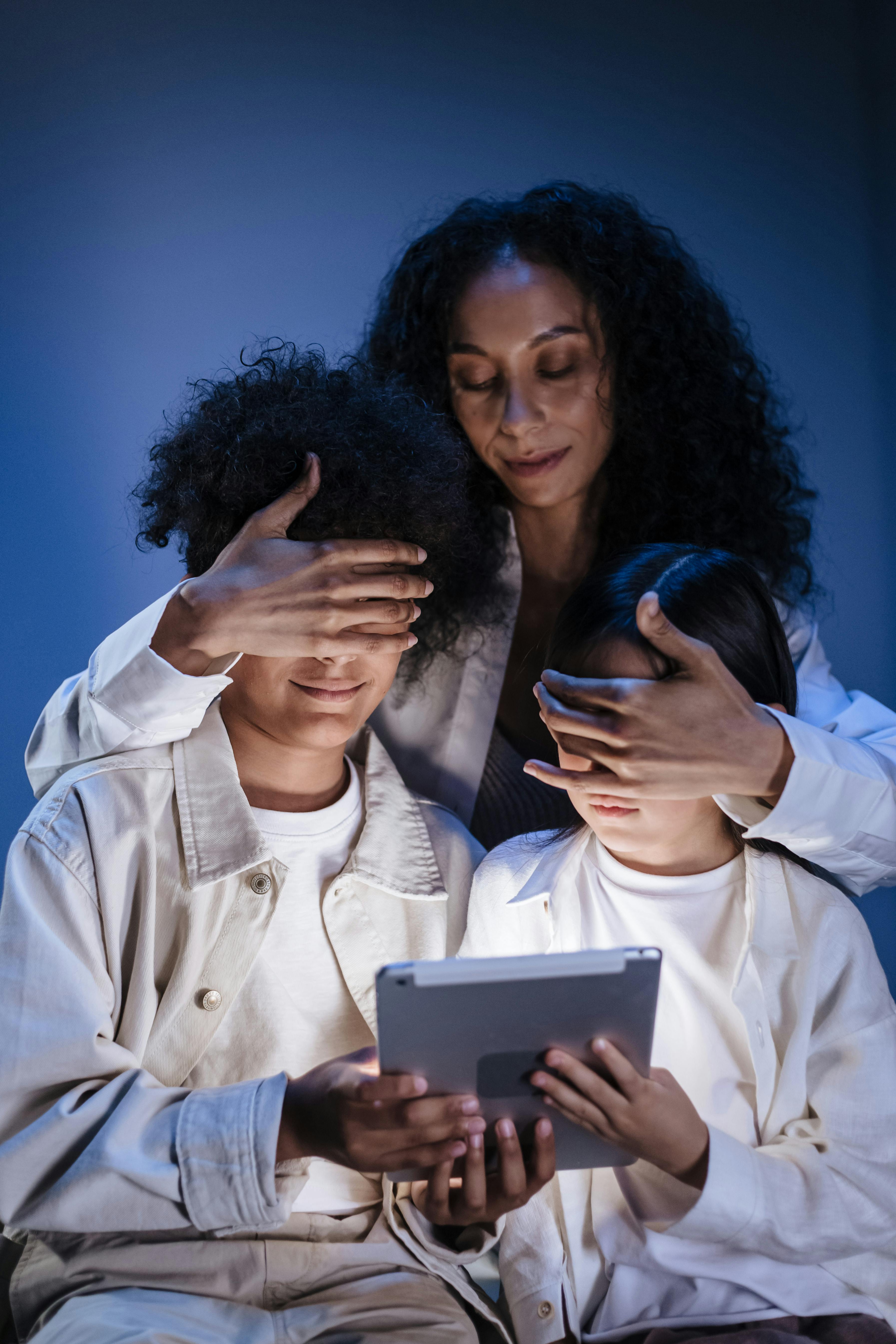

ai-ad-ban是這篇文章討論的核心

快速精華

- 💡 核心結論:明尼蘇達州新AI法標誌著美國兒童數位隱私監管的重大轉向,將影響全國乃至全球AI業務模式。

- 📊 關鍵數據:2026年全球AI支出預計達2.52兆美元(Gartner),其中兒童市場在教育和娛樂領域佔據可觀份額。新法可能阻斷價值數億美元的兒童精準廣告。

- 🛠️ 行動指南:企業應立即審查AI系統,部署年齡驗證工具,建立家長同意框架,並準備透明度報告以符合要求。

- ⚠️ 風險預警:未合規可能面臨明尼蘇達州總檢察長的法律行動,每次違規最高可處以數千美元罰款,且需承擔損害賠償及名譽損失。

觀察到明尼蘇達州於2024年通過的一系列AI限制法規,我們注意到這項立法不僅是對聯邦COPPA的補充,更是在科技巨頭頻頻侵犯兒童隱私的背景下,一項歷史性的轉折。該法規涵蓋AI驅動廣告、家長同意機制以及有害內容生成三大範疇,並將於2025年7月31日生效,直接影響2026年及之後的商業模式。本文將基於公開資料與產業數據,深入剖析其對全球AI生態系統的長遠影響。

明尼蘇達州AI限制法的背景與核心內容是什麼?

明尼蘇達州的AI監管努力始於對人工智慧在執法部門及兒童使用中潛在風險的擔憂,並獲得了跨黨派支持。2024年通過的《Minnesota Consumer Data Privacy Act》(MNCDPA)及其修正條款,明確禁止針對未成年人的AI驅動廣告,要求對涉及隱私敏感數據的AI服務取得家長同意,並限制可能傷害兒童的內容生成。此外,AI提供商必須披露數據使用方式並實施保障措施,以確保透明度和問責制。

根據該法,符合以下門檻的企業必須遵守:年營業額超過2500萬美元、每年處理至少10萬名明尼蘇達居民的個人信息,或從銷售個人數據獲得超過50%的收入。法律還賦予消費者質疑AI剖析結果的權利,要求企業解釋決策邏輯並提供人工審核選項。

關鍵生效日期為2025年7月31日,這意味著2026年市場將完全處於新規管轄之下。

AI廣告禁令將如何影響兒童市場的生態?

兒童數字廣告是一個價值數十億美元的產業。根據美國參議院數據,2022年社交媒體平台從兒童和青少年廣告中獲得了驚人的110億美元收入。明尼蘇達州的新規直接禁止AI驅動的定向廣告針對未成年人,這將迫使平台重新設計其廣告投放邏輯,或在州內徹底放棄兒童市場區隔。

從全國視角看,這項法案可能引發連鎖效應。維吉尼亞州已於2024年通過類似COPPA的禁令,加州也正在討論禁止對16歲以下兒童進行定向廣告。如果更多州立法,企業可能面臨一個碎片化的監管環境,最終需要重建全國標準。

此外,禁止兒童AI廣告將對EdTech(教育科技)產業產生重大影響。許多學習平台依靠個性化推薦來提升學習體驗,現在必須在兒童用戶中切換到非個性化模式或取得家長同意——這過程中的摩擦可能導致用戶流失。

家長同意制在AI服務中的實務挑戰有哪些?

MNCDPA將「已知兒童」的數據定義為敏感數據,要求企業在處理前獲得家長或法定监护人的可驗證同意。這聽起來簡單,但執行起來卻充滿挑戰,尤其是在AI系統常規運作中持續收集數據的情況下。

年齡驗證本身就是一個難題。過於寬鬆的驗證會讓未成年人輕易繞過,過於嚴格的驗證則會造成用戶流失。企業需要部署年齡估算工具(如生日選擇器)並在懷疑用戶年齡時觸發家長同意流程。此外,對13-16歲青少年,部分州法規要求他們自己提供同意,這增加了複雜性。

維持同意記錄也是不可或缺的一環。企業必須保存同意的時間、方式以及家長身份證明,以備監管審查。這不僅涉及數據存儲安全,還需建立流程以處理家長撤回同意的請求——那意味著必須立即停止數據收集並刪除既有數據。

這些措施將顯著增加合規成本,尤其是對中小型AI開發商而言。然而,提早建立信任也可能成為市場競爭優勢。

限制有害AI內容生成的措施能奏效嗎?

明尼蘇達州不僅限制廣告,還將手伸向AI生成內容本身。2024年提出的SB1577法案擬將AI生成的兒童性虐待材料(CSAM)納入現有刑法,懲罰創建、持有或分發此類內容的行為,視為重罪。這與加州最近通過的INSIGHT相呼应,顯示全美對兒童AI滥用的零容忍態度。

問題的緊迫性不容忽視。根據Scientific American報導,Internet Watch Foundation在2025年上半年記錄了210個包含AI生成深偽兒童色情內容的網頁,較2024年同期飆升400%。這表明技術的濫用正在迅速擴散,法律制裁可能成為唯一的威懾。

然而,執法面臨巨大挑戰。AI生成的內容往往難以追溯其源頭,尤其是當模型權重被公開發布或透過API被濫用时。MNCDPA要求AI提供商披露數據使用和保障措施,這有助於提高透明性,但最終效果仍有賴於跨州乃至國際合作。

更廣泛的有害內容,如霸凌、仇恨言論或潛在誘拐信息,也可被視為對兒童的風險。企業應將兒童安全納入AI系統的價值對齊策略,確保輸出符合兒童最佳利益。

企業如何合規?2026年AI法規應對策略

面對層出不窮的AI法規,企業不能等待罰款發生才行動。我們建議以下合規路線圖:

- 數據映射: 梳理AI系統處理的所有個人數據,尤其是標記為「兒童」或可能涉及未成人的數據流。

- 影響評估: 根據MNCDPA要求,對涉及兒童數據的處理活動進行數據保護影響評估,識別風險並制定緩釋措施。

- 技術設計: 在產品開發初期嵌入隱私保護預設,例如年齡驗證、家長同意界面、及限制兒童數據用於訓練模型。

- 透明度提升: 更新隱私政策,清晰說明AI如何使用兒童數據、誰有權訪問,以及兒童/家長可行使的權利。

- 監控與審計: 建立持續監控機制,確保AI模型的輸出不會偏離合規要求,並定期進行第三方審計。

市場規模Impact:根據Gartner預測,2026年全球AI支出將達2.52兆美元,而企業在合規上的投入預計占AI專案的5-10%。長期來看,建立信任將帶來更大的用戶忠誠度和市場份額。

常見問題

誰需要遵守明尼蘇達州AI兒童保護新規?

任何在明尼蘇達州經營、且符合以下任一條件的企業:年營業額超過2500萬美元;每年處理至少10萬名居民的個人信息;或從銷售個人數據獲得超過50%的收入。若涉及兒童數據,更需嚴格遵守。

家長同意制有哪些合規工具可用?

企業可採用FTC認可的驗證方式,如父母信用卡驗證、政府核發的身份證明文件核對、或多步驟驗證流程。此外,可加入年齡gate技術、提供清晰隱私政策,並建立家長控制面板。

違反法規會面臨什麼處罰?

明尼蘇達州總檢察長可對每項違規提起訴訟,每筆違規可能導致數千美元的行政罰款,且受害兒童的家長亦可提起集體訴訟。未合規企業還需承擔損害賠償、律師費及名譽損失。

參考資料

Share this content: