Groq 3 LPX 晶片是這篇文章討論的核心

快速精華

💡 核心結論:NVIDIA 正從「訓練王者」轉型為「推論霸主」,透過 Groq 3 LPX 專用晶片搶攻低延遲、高效能的邊緣推論市場,目標在 2027 年前實現 1 兆美元營收。

📊 關鍵數據:AI 推論市場從 2025 年的 1060 億美元,預計成長至 2030 年的 2550 億美元;2026 年推論工作量將佔所有 AI 運算的三分之二,遠高於 2023 年的三分之一。

🛠️ 行動指南:企業應評估導入專用推論硬體的成本效益,特別是即時互動型 AI 服務;開發者需掌握低延遲推論架構的優化技巧。

⚠️ 風險預警:競爭對手(Cerebras、SambaNova)仍具技術優勢;供應鏈產能與客戶接受度仍存變數。

目錄導航

引言:從訓練到推論的典範轉移

2026 年 3 月的聖荷西,NVIDIA GTC 大會現場氣氛詭譎又興奮。執行長黃仁勳站在舞台上,背後大螢幕秀出一串讓全場倒抽一口氣的數字:「1 兆美元」——這不是某個虛無縹緲的市場預測,而是 NVIDIA 為旗下 Blackwell 和 Rubin 晶片設下的 2027 年營收目標。

但真正讓產業觀察者眼睛一亮的消息,藏在技術細節裡:NVIDIA 宣佈推出 Groq 3 LPX,這是該公司首款非 GPU 架構的專用推論機櫃。這顆晶片源自 NVIDIA 以 200 億美元「人才與授權交易」併購的新創 Groq 的技術,專為低延遲、大語言模型的即時推論設計。

說白了,NVIDIA 不只想當「AI 訓練的王者」,它要連「AI 推論的霸主」寶座一起搶下來。

這篇觀察筆記會帶你深入拆解:為什麼 NVIDIA 要大動作轉向推論戰場?Groq 3 LPX 的技術亮點是什麼?以及這場變局對 2026 年之後的產業鏈會掀起什麼樣的漣漪?

什麼是 Groq 3 LPX?NVIDIA 首款非 GPU 推論機櫃

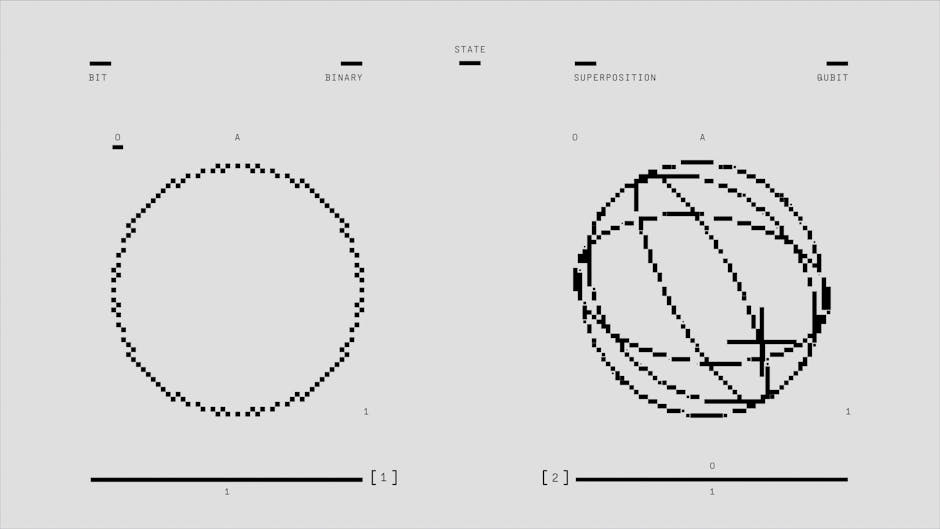

先釐清一個關鍵概念:推論vs. 訓練。訓練是「教 AI 模型學會東西」,需要大量算力、大量資料;推論則是「讓訓練好的模型去幹活」,強調速度、延遲與成本。過去幾年,NVIDIA 的 GPU 幾乎壟斷了 AI 訓練市場,但推論領域卻是另一片戰場——講究的是「算得快、反應快、成本低」。

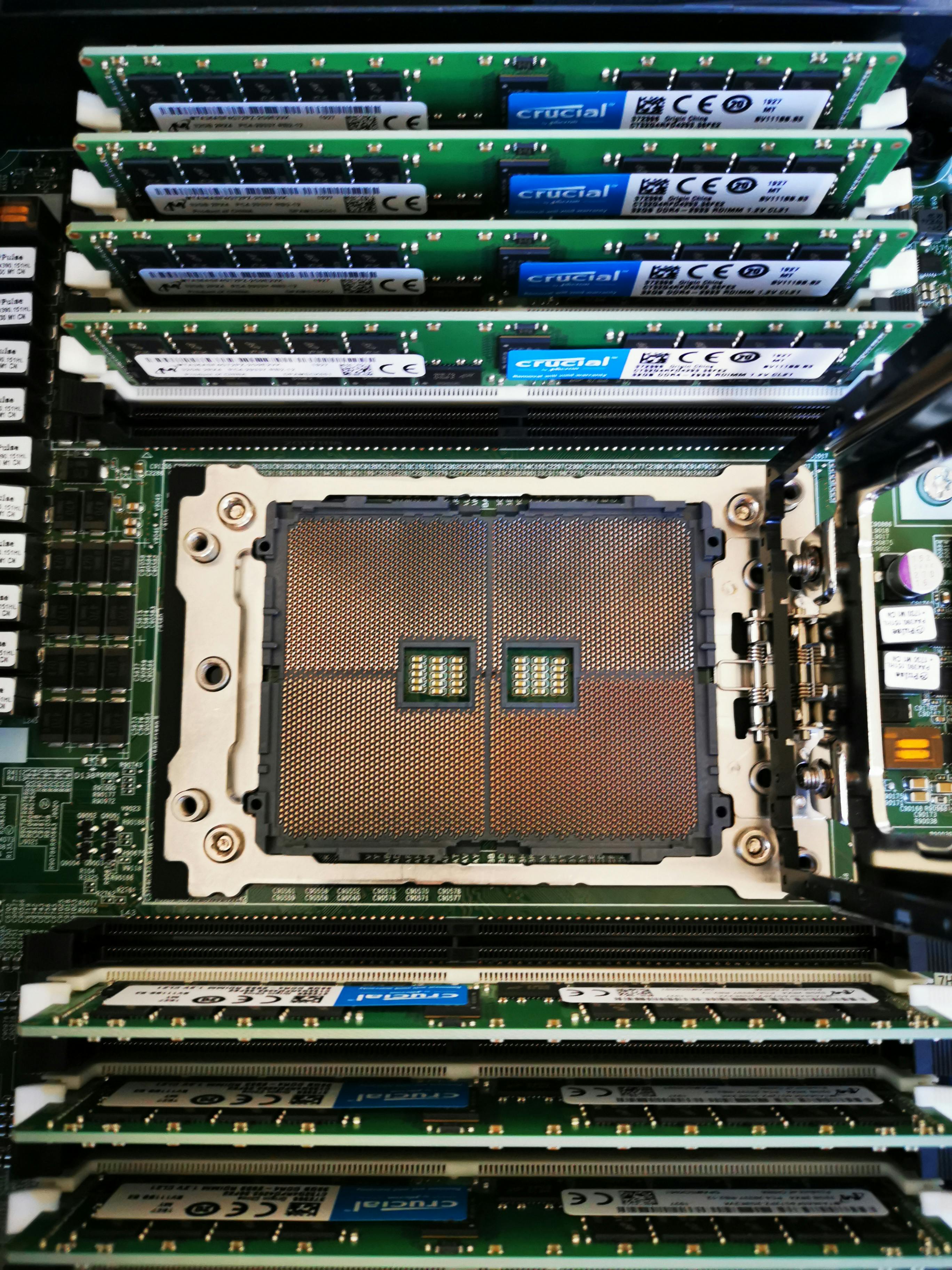

Groq 3 LPX 就是 NVIDIA 專為這片戰場打造的「新武器」。它不是 GPU,而是所謂的 LPU(Language Processing Unit,語言處理單元)。每個 LPX 機櫃塞進了 256 顆 LPU,配備 128GB 的片上 SRAM,擁有 640 TB/s 的Scale-up 頻寬。官方宣稱,相較於前一代 Blackwell 架構,LPX 在處理「兆級參數模型」時能實現 35 倍的吞吐量提升。

用更直白的說法:如果你的 AI 服務需要即時回應使用者(比如語音助理、即時翻譯、自動駕駛決策),那傳統 GPU 架構可能會讓你「等得心焦」。LPX 的設計邏輯,就是把那些會拖慢速度的瓶頸(比如記憶體頻寬、資料搬移)統統砍掉,讓模型推理像是「在晶片內部的高速公路上狂飆」。

💡 Pro Tip:為什麼「低延遲」這麼重要?

在 AI 服務的戰場上,延遲往往決定生死。試想,你的語音助手如果每句話都要「想」個 2 秒才回應,使用者體驗簡直是災難。更別提自駕車、工業自動化這類應用,延遲可能就是安全與事故的差別。Groq 的技術核心在於「確定性執行」——它不像 GPU 那樣會有執行時間的波動,能穩定地以極低延遲輸出結果。這對「即時互動型 AI」來說,根本就是開外掛。

為何推論市場是下一個兆級戰場?

要理解 NVIDIA 為何如此急切地轉向推論戰場,我們得先看幾個數字。

根據 Deloitte 的報告,2025 年 AI 推論工作量已佔所有 AI 運算的 50%,而這個數字在 2026 年將跳升到 三分之二。這不是小變化,這是「典範轉移」等級的結構性變化。

換句話說,企業對 AI 的投資,正在從「蓋模型」轉向「用模型」。這背後的邏輯很簡單:模型訓練一次就夠了(或者說,訓練頻率相對低),但模型推論可是每天都在跑、每秒鐘都在算。誰能把推論做得更快、更便宜,誰就能吃到這塊市場的大餅。

市場研究機構 Introl 的數據顯示,AI 推論市場將從 2025 年的 1060 億美元,成長至 2030 年的 2550 億美元,年複合成長率高達 19.2%。而 NVIDIA 執行長黃仁勳顯然對這個數字有更大的想像——他在 GTC 2026 直接喊出 「2027 年前實現 1 兆美元的 AI 晶片營收」。

這不是空口說白話。NVIDIA 的算盤是:訓練市場他們已經吃得差不多了(市佔率超過 80%),但推論市場還是一片「戰國時代」。Groq、Cerebras、SambaNova 這些新創各有各的技術路線,雲端巨頭(Google TPU、AWS Inferentia)也都有自己的專用晶片。NVIDIA 現在要做的,就是把 Groq 的技術「正規化」、「規模化」,變成企業可以放心採用的標準方案。

技術剖析:LPX 如何實現 35 倍吞吐量提升?

接下來,我們來聊聊 Groq 3 LPX 到底「強在哪裡」。

首先,它不是 GPU。這一點很重要。GPU 的設計初衷是「平行運算」,擅長同時處理大量資料。但這種設計有個副作用:執行時間不確定。同樣的運算任務,在不同條件下可能花費不同時間——這對講究「即時反應」的推論場景來說,就是個頭痛問題。

Groq 的 LPU 採用完全不同的設計哲學:確定性執行架構。它把神經網路的運算拆解成極細緻的「時序指令」,每個運算步驟的時間都精確可預測。這意味著,你可以準確知道「這個模型推論會花多少毫秒」——這對即時互動應用來說,根本是夢寐以求的特性。

再來是片上記憶體(SRAM)的配置。傳統 GPU 的運算瓶頸,往往卡在「資料要從記憶體搬進搬出」。LPX 直接把 128GB 的 SRAM 塞進晶片裡,讓模型參數和計算單元「住在一起」,大幅降低資料搬移的延遲。

最後是Scale-up 頻寬。單一機櫃擁有 640 TB/s 的內部頻寬,這讓多顆 LPU 之間的協作變得極其流暢。官方數據顯示,LPX 在處理「兆級參數模型」時,每瓦特能提供的吞吐量是 Blackwell 的 35 倍。

用個比喻:如果說傳統 GPU 是「高速公路」,那 LPX 就是「磁浮列車」。同樣是載運算力,但速度、穩定性、能效都上了一個檔次。

💡 Pro Tip:為什麼「兆級參數模型」是關鍵戰場?

2026 年的 AI 模型,早已突破「千億參數」的門檻。GPT-4、Gemini 這類模型的參數量都在「兆級」徘徊。這類模型的推論成本,往往是企業最頭痛的問題。LPX 針對這類模型做硬體級優化,等於是直接對準「最痛的痛點」開藥方。

產業鏈重組:從雲端到邊緣的算力洗牌

NVIDIA 這步棋,影響的不只是晶片市場,而是整個 AI 產業鏈的算力分配邏輯。

首先是雲端服務商的選擇難題。過去,AWS、Google Cloud、Azure 都在開發自己的推論晶片(比如 AWS Inferentia、Google TPU)。但 NVIDIA 現在端出一個「通用性高、生態完整」的推論方案,雲端巨頭要不要買單?這會是個有趣的博弈。

其次是邊緣運算的起飛。低延遲推論晶片,讓「把 AI 模型塞進終端裝置」變得更可行。試想,智慧工廠的即時品檢、自駕車的決策系統、智慧醫療的即時診斷——這些應用都需要「算得快、反應快」的推論能力。LPX 的技術路線,讓這些應用從「概念」走向「實戰」。

再來是企業 AI 策略的調整。過去,企業導入 AI 的瓶頸往往在「推論成本太高」。如果 LPX 能把推論成本壓低一個數量級,那企業的 AI 應用場景會大幅擴張。從「只敢在核心業務用 AI」到「到處都能塞進 AI」,這中間的差距,就是市場機會。

最後是競爭格局的變化。Groq、Cerebras、SambaNova 這些新創,原本在「低延遲推論」這塊小眾市場各有優勢。但 NVIDIA 現在帶著完整的硬體生態、軟體支援(CUDA)、以及龐大的客戶群殺進來,這些新創的生存空間會被壓縮到什麼程度?值得持續觀察。

常見問題 FAQ

Groq 3 LPX 跟傳統 GPU 有什麼不同?

Groq 3 LPX 採用 LPU(語言處理單元)架構,專為 AI 推論設計,具備「確定性執行」特性,能精確預測運算時間。相較之下,傳統 GPU 擅長平行運算,但執行時間會有波動。LPX 還配備 128GB 片上 SRAM,大幅降低資料搬移延遲。

為什麼 NVIDIA 要佈局推論市場?

根據產業報告,2026 年 AI 推論工作量將佔所有 AI 運算的三分之二,市場規模預計從 2025 年的 1060 億美元成長至 2030 年的 2550 億美元。NVIDIA 在訓練市場已佔據超過 80% 市佔,轉向推論是擴大市場版圖的必然戰略。

一般企業何時能用到 LPX 的技術?

根據 NVIDIA 官方時程,首批 Groq 3 LPX 機櫃預計在 2026 年第四季開始出貨。企業可透過雲端服務商或直接採購硬體導入。對於即時互動型 AI 服務(如語音助理、即時翻譯、邊緣 AI 應用),LPX 能顯著降低延遲與成本。

結論與行動呼籲

NVIDIA 的 Groq 3 LPX,標誌著 AI 產業從「訓練競賽」走向「推論競賽」的關鍵轉折點。1 兆美元的營收目標或許聽起來狂妄,但背後的市場邏輯卻相當紮實:推論才是 AI 商業化的主戰場。

對企業來說,這意味著什麼?

首先,重新評估你的 AI 硬體策略。如果你的 AI 服務需要即時互動,傳統 GPU 可能不再是最佳選擇。專用推論晶片(如 LPX)能提供更好的成本效益與使用者體驗。

其次,關注邊緣 AI 的發展。低延遲推論技術成熟,會讓更多「終端裝置上的 AI」變得可行。這會打開一整片新的應用藍海。

最後,思考你的 AI 應用場景。當推論成本大幅下降,原本「太貴而無法實現」的 AI 應用,可能突然變得可行。這中間的落差,就是創新機會。

想進一步探討如何為你的企業制定 AI 推論策略?歡迎與我們團隊聯繫。

延伸閱讀與參考資料

Share this content: