Edge AI是這篇文章討論的核心

💡 核心結論

MSI 在 Embedded World 2026 推出完整的 Edge AI 生態系統,標誌著邊緣人工智慧從概念驗證走向大規模商業部署的關鍵轉折點。整合硬體、SDK 和雲端協同服務,為工業自動化、智慧城市和物聯網提供低延遲、高能效的 AI 解決方案。

📊 關鍵數據

- Edge AI 市場規模:2025 年約 256-358 億美元,2030 年預估達 890-1,050 億美元,2034 年有望突破 1,430-3,858 億美元

- 年複合成長率 (CAGR):21%-33%

- 延遲優勢:邊緣處理比雲端平均減少 30-50ms,關鍵應用可達 <10ms 響應

- 頻寬節省:工業物聯網部署可減少 35-40% 頻寬消耗

- 展會規模:Embedded World 2026 吸引超過 1,100 家參展商,約 31,787 名參觀者

🛠️ 行動指南

開發者應立即掌握 NVIDIA Jetson 平台與 MSI Edge AI SDK,優先在低延遲、高可靠性的工业場景部署试点项目,並利用云端协同工具進行模型優化與遠程管理。

⚠️ 風險預警

邊緣 AI 部署面臨硬體相容性挑戰、散熱設計限制、初期開發門檻高,以及供應鏈不確定性。企業需評估長期技術支援與設備生命週期管理策略。

引言:邊緣 AI 的臨門一腳

人工智慧的浪潮從雲端湧向邊緣,這不是會不會發生的問題,而是什麼時候席捲每條生產線、每台感測器和每輛移動設備的問題。2026 年三月在德國紐倫堡舉辦的 Embedded World 展會上,MSI 正式亮相交乘的 Edge AI 生態系統,恰好證明了邊緣 AI 已經過了实验室階段,開始真正進軍 industrial-grade 的應用場域。

觀察展場動向可以看出,硬體廠商不再只是賣計算 box,而是試圖提供從晶片一致性到雲端協同的完整解決方案。MSI 的佈局顯示,邊緣 AI 的競爭將從單點性能轉向生態系統整合,這將影響後續數年產業鏈的分工與價值分配。

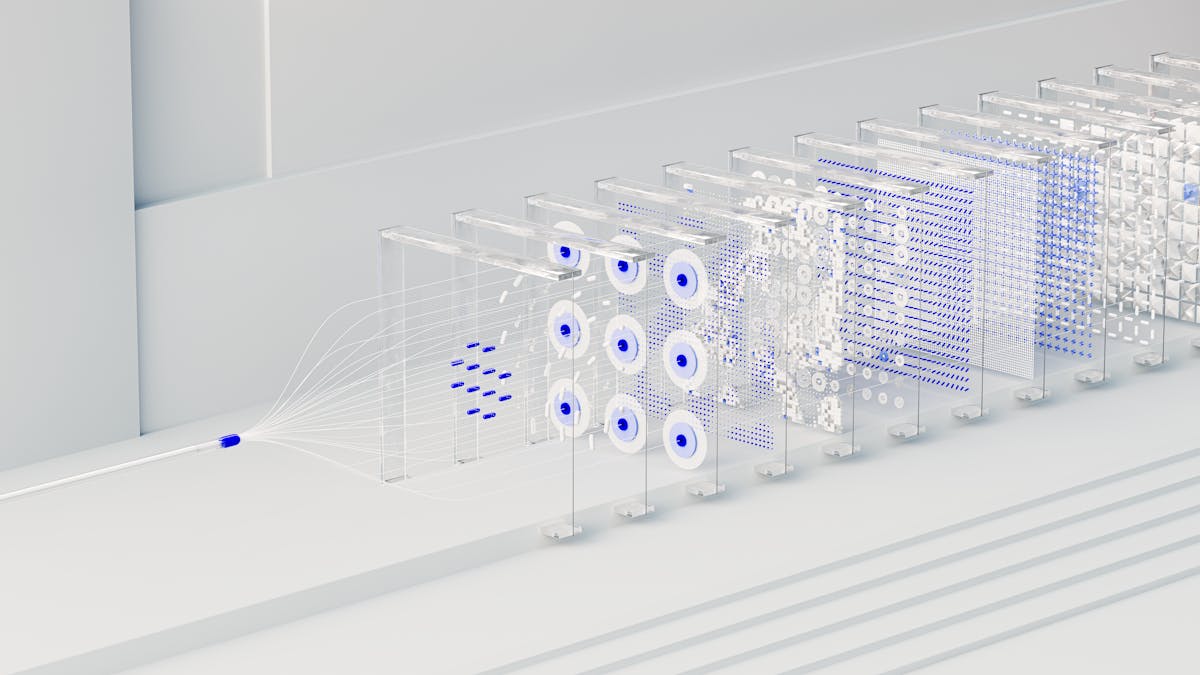

技術架構深度解構:從晶片到雲端的全鏈路

MSI 在展會展示的 Edge AI 生態系統,核心在於把算力、工具鏈和部署管道做成”一站式”服務。這不是簡單的硬體堆砌,而是針對邊緣場景的特殊限制——包括電源預算、散熱條件、震動 tolerance 和長生命週期要求——做出的系統性優化。

硬體層:工業級可靠性設計

MSI 的 Edge AI Box 產品線(如 MS-C910E)採用 Intel Raptor Lake-S 處理器,支援最高 96GB DDR5-5600 RAM,在緊湊外殼內塞入工作站級算力。關鍵在於其工業 grade 設計:

- 寬溫operation:-40°C 至 85°C 工作範圍

- 抗振動:符合 MIL-STD-810G 標準

- 長生命週期:5-7 年的供貨穩定度

- 靈活擴展:多個 M.2、PCIe 和 USB 接口,支援 GPU 加速卡

Pro Tip:邊緣硬體的關鍵指標

選用邊緣 AI 硬體時,TOPS (Tera Operations Per Second) 只是入場券。更重要的是能持續輸出的 power envelope、軟體生態完整性(如是否支援 CUDA、TensorRT)、以及供貨穩定性。NVIDIA Jetson AGX Orin 提供 200 TOPS,而 MSI 的設計則在功耗與效能之間取得平衡,通常在 15-60W 區間內維持稳定 inference。

軟體層:SDK 與開發工具的細膩度

硬體再強,沒有 toolchain 也難成大器。MSI 提供的專屬 SDK 整合了 AI 模型優化、邊端推理引擎和遠端監控功能。这类工具链通常借鉴 NVIDIA JetPack 的理念,提供从模型转换、性能剖析到OTA更新的完整流程。

以 Jetson 平台為例,JetPack 6.0 afx的 CUDA、TensorRT、cuDNN 和 DeepStream 套件,讓開發者能將 PyTorch 或 TensorFlow 模型轉換為優化的邊端推論引擎。MSI 在此基礎上,針對自己的硬體進行驅動校調,並加入企業級管理功能。

雲端協同:從單機智能到 swarm intelligence

邊緣 AI 不是要取代雲端,而是讓計算更接近數據源。MSI 的雲端協同服務允許:

- 集中式模型訓練與版本管理

- 邊端设备的 OTA 更新

- 分散式 inferencing 的負載平衡與故障轉移

- 數據回傳以持續改進模型

產業應用場景落地:從智慧工廠到智慧城市

Edge AI 的价值不在於其ooky的算力數字,而在於它能解決哪些真實世界的痛點。MSI 在 Embedded World 展示的解決方案,涵蓋了最具商業潛力的幾個垂直領域。

智慧工廠:品質檢測與預測性維護

在製造業,AI 視覺檢測已從optional變成must-have。傳統的瑕疵檢測依賴肉眼,不仅效率低,且一致性差。邊緣 AI 系統可直接安裝在生產線末端,每分鐘處理超過 100 件產品,自動剔除瑕疵品,即時回饋給上游工序。

更重要的是預測性維護。 vibration、溫度、電流等感測器數據在邊端進行即時分析,能提前數小時甚至數天預警設備故障,避免非計劃停機。這種應用對延遲極度敏感(通常要求 <50ms),必須在邊緣完成推理。

Pro Tip:工業 AI 的 triplet 要求

成功的工業 AI 方案必須同時滿足三點:精度 (precision) >99.5%、延遲 (latency) <50ms、可靠性 (uptime) >99.9%。任何一項不達標,都很難通過工廠的驗證。MSI 的工業 PC 設計 purposely 針對這三項指標進行優化。

智慧城市:交通優化與公共安全

城市裡的 AI 應用通常涉及大量攝像頭和感測器。若所有影片都上傳至雲端處理,頻寬成本會非常驚人,且隱私問題難以控制。邊緣 AI 能在本地進行物體偵測、車牌識別、異常行為分析,僅將結構化事件數據上傳。

例如交通流量優化:路口的邊緣設備即時分析車流,動態調整紅燈時序,能有效減少 15-20% 的平均等待時間。這種 control loop 必須在本地完成,不可能等待雲端回應。

物聯網與零售:個性化體驗與運營效率

在零售場景,邊緣 AI 可用於顧客行為分析、熱點圖生成、自動結帳等。這些涉及個人隱私的數據,就地處理能符合 GDPR 等法規要求。同時,庫存管理機器人依賴即时的視覺SLAM (Simultaneous Localization and Mapping),必須在设备端運行。

數據來源:多家市場研究機構對 Edge AI 市場規模的預測存在差異,主要源自定義範圍不同(軟體 vs 硬體 vs 全生态)。然而共識是:Edge AI 在未來十年將以超過 20% 的 CAGR 強勢成長,成為 AI 應用的主力形態之一。

開發工具與生態整合:降低部署門檻的關鍵

邊緣 AI 的普及程度不僅取決於硬體性價比,更關鍵在於開發流程是否順暢。MSI 的 SDK 策略瞄準的是”從雲端到邊端”的無縫遷移體驗。

SDK 的三大支柱

- 模型優化:支援 TensorFlow、PyTorch 模型的量化 (quantization)、剪枝 (pruning) 和編譯優化,確保模型能在有限算力下跑出最佳效能。

- 推理引擎:整合 TensorRT、OpenVINO 等主流推理框架, abstract adapter 層讓開發者不需為不同硬體重寫推理程式。

- 部署管理:提供 OTA 更新、遠程效能監控、A/B 測試等企業級功能,這對於大規模部署至關重要。

與 NVIDIA Jetson 生態的相容性

NVIDIA Jetson 系列(Orin Nano、AGX Orin)已成為邊緣 AI 的 facto standard。MSI 的許多產品直接採用 Jetson 模組,或與 Jetson 生態系統深度整合。這意味著開發者可以享受:

- 豐富的 pretrained 模型庫 (NVIDIA NGC)

- 成熟的容器化部署工具 (Docker, L4T)

- 活躍的開發者社群與技術支持

MSI 在此基礎上,強調自己的工业级质量和長期供貨保證,補足了 Jetson 原本偏重原型開發的短板。

雲端協同服務:管理千台設備的實用方案

真正的痛點在於管理規模。當企業部署了數百甚至數千個邊緣節點,如何統一向後端推送模型版本、監控健康狀態、收集 inference metrics,就成了必須自動化的流程。

MSI 的雲端平台提供儀表板顯示全體設備的 running state、模型版本分佈、錯誤率監控等。管理員可以選擇性地推送更新,或針對特定批次進行 A/B 測試,這種 NoOps 體驗是邊緣 AI 規模化的關鍵。

技術挑戰與未來展望:邊緣 AI 還有多長的路要走?

儘管市場一片叫好,邊緣 AI 仍面臨若干根本性挑戰,這些將影響其 2026 年以後的發展軌跡。

硬體限制與效能取捨

功耗、散熱、成本構成了鐵三角。更高的 TOPS 通常伴隨更高的 TDP,在密閉的工業環境中,散熱設計可能成為瓶頸。此外,邊緣硬體的生命週期通常比消費級產品長(5-10 年),但 AI 晶片的迭代速度快,如何確保長期供應而不 obsoleted,是 OEM 廠商必須與半導體供應商協商的條款。

軟體碎片化與標準缺失

每家硬體廠商都推自己的 SDK,導致開發者需要為不同平台做 porting 工作。Although ONNX 試圖建立標準,實務上各家的推理優化 converters 仍有差異。真正的互通性仍有距離。

Pro Tip:評估邊緣 AI 解決方案的檢查清單

- 硬體是否支援模型需要的運算精度 (FP16, INT8)?

- SDK 是否提供性能剖析工具,能定位 bottle neck?

- 供應商能否保證至少 5 年的供貨與驅動支援?

- 是否支援遙測數據的批量導出與第三方分析平台整合?

- 是否有實地部署的 reference case,而非僅有 lab demo?

安全與合規:邊緣不是法外之地

邊緣設備更容易遭受物理攻擊,且通常分布在缺乏專業 IT 管理師資的場域。設備身份驗證、模型權限控制、安全啟動、加密儲存等安全機制必須內建。Meanwhile,GDPR、HIPAA 等資料保護法規,要求個人數據不出本地,這反而成了邊緣 AI 的竞争优势——數據不离开工廠或醫院,就能完成 AI 分析。

未來趨勢:生成式 AI 與 TinyML 的交會

2026 年之後,我們會看到兩條路線的融合:

- 強大的邊緣伺服器(如搭載 Jetson AGX Orin)開始運行 locally-hosted LLM 或 VLM,用於自然語言指令、複雜推理任務。

- 極度低功耗的微控制器 (MCU) 上運行 TinyML,用於電池供電的感測器節點,實現 perpetually-on 的感測。

MSI 若能橫跨這兩條路線(從高性能 Edge AI Box 到 fanless industrial motherboards),就能守住整個邊緣 AI 價值鏈。

FAQ:edge AI 常見問題解答

什麼是 Edge AI?它和雲端 AI 有什麼差別?

Edge AI 指的是將人工智慧推理部署在靠近數據產生的設備上(如工廠的機器、城市的攝像頭、車輛的感測器),而非依賴遠端雲端伺服器。主要差別在於:邊緣 AI 提供更低的延遲(常常 <10ms)、更高的資料隱私性(數據不離開本地)、以及更低的頻寬消耗(只上傳結構化結果)。代價是邊端設備的算力受限,複雜模型仍需在雲端訓練。

MSI 的 Edge AI 生態系統包含哪些核心組件?

MSI 的 Edge AI 生態系統包含三大支柱: (1) 硬體層:工业級 Edge AI Box、Industrial PC、嵌入了 Intel 或 NVIDIA 晶片的計算平台;(2) 軟體層:MSI 專屬 SDK、驅動程式、AI 模型優化工具、與主流框架 (TensorRT, OpenVINO) 的整合;(3) 服務層:雲端協同平台、OTA 更新、遠端監控與裝置管理。此生態系統讓開發者能從模型訓練一路到邊端部署,擁有完整工具鏈。

企業應該何时部署 Edge AI?

當您的 AI 應用滿足以下任一條件時,就應該考慮 Edge AI: (a) 延遲要求 <50ms(如即時控制、自動駕駛、高頻交易)。(b) 數據隱私或合規要求數據不離場(如醫療、金融、工廠機密)。(c) 頻寬成本成為瓶頸(如大量高清影像流)。(d) 網路連接不穩定或中斷代價高(如礦井、遠程設施)。Embedded World 2026 上展示的案例顯示,製造業、運輸業和智慧城市是 Edge AI 部署最成熟的三個垂直領域。

結語:Edge AI 不是替代,而是延伸

MSI 在 Embedded World 2026 的佈局,反映了一個確立的趨勢:AI 的計算重心正在從集中走向分散。邊緣不會取代雲端,而是成為雲端的 natural extension,共同構成"雲-邊-端"的協同架構。對於企業而言,現在要思考的不再是"要不要做 Edge AI",而是"哪些場景最適合優先導入"。

參考資料

Share this content: