Cyber AI 資安自動化是這篇文章討論的核心

OpenAI 擴大「Cyber AI」權限:2027 前後資安自動化會怎麼翻天?風險、對策與產業鏈拆解

目錄

快速精華

- 💡核心結論:Cyber AI 的授權範圍拉大,本質上是把「找漏洞、寫攻擊腳本、串資源」這種高門檻能力流程化;同時 OpenAI 用審核與限制,試圖讓防禦方先吃到紅利。

- 📊關鍵數據(2027 與未來預測量級):全球 AI 在 2026 年的支出預估已到 2.52 兆美元(Gartner)。而資安市場在 2027 年常見的規模預測落點大約 300–4000 億美元量級(不同研究機構口徑不同),意味著「資安自動化」將成為採購與整合的主戰場。

- 🛠️行動指南:把 Cyber AI 當作「可產生測試與風險報告」的能力平台來治理:先做資料與流程管控、再做輸出監測與審計、最後把成果接到防禦部署(漏洞修補、偵測規則、風險評分)。

- ⚠️風險預警:授權擴大不等於風險下降;一旦濫用成本被壓低,攻擊端的腳本自動化會擴散,尤其在供應鏈、測試環境外洩與權限錯配時最要命。

引言:我觀察到的「授權擴大」信號

我先講個觀察:最近看到 OpenAI 針對具備網路攻防能力的 Cyber AI(基於 GPT-4 系列)的「使用權限擴大」政策,你會發現它不是單純在加功能,而是在重新分配誰能用、怎麼用、用完要怎麼被看見。對防守方來說這很香:因為它被定位在安全測試與防禦部署;但對攻擊方來說同樣也很刺激:因為它能自動編寫攻擊腳本、發掘漏洞、並把資源串起來。這種「能力流程化」的政策走向,會直接反映在 2026–2027 的資安工具採購、合規審查,甚至被動收入(例如風險評估與量化策略)會怎麼長。

下面我會把這件事拆成:Cyber AI 的核心能力、OpenAI 的審核/限制到底在平衡什麼、攻防迴圈將怎麼改寫、以及企業/開發團隊接下來要落地的動作。

Cyber AI 到底是什麼?OpenAI 為何要擴大使用權限

根據 Axios 的報導脈絡,OpenAI 正在擴大「Cyber AI」工具的使用權限,目標是應對持續升溫的「擬人化駭客」威脅。這裡的關鍵不是一句「為了安全」,而是 Cyber AI 的能力結構本身:它基於 GPT-4 系列,能夠自動編寫攻擊腳本、發掘漏洞、以及連接資源。而且開發者可透過 API 做安全測試與防禦部署。

換成人話:以往資安團隊做測試要付出大量人力(理解目標、整理規則、生成攻擊/檢測流程、再把結果落地)。Cyber AI 把其中一段段「人腦工作」變成「模型可生成流程」。那為什麼要擴大授權?因為擬人化攻擊者的滲透節奏更快、可操作性更高;如果防守方還停留在半手工,攻防落差會越拉越大。

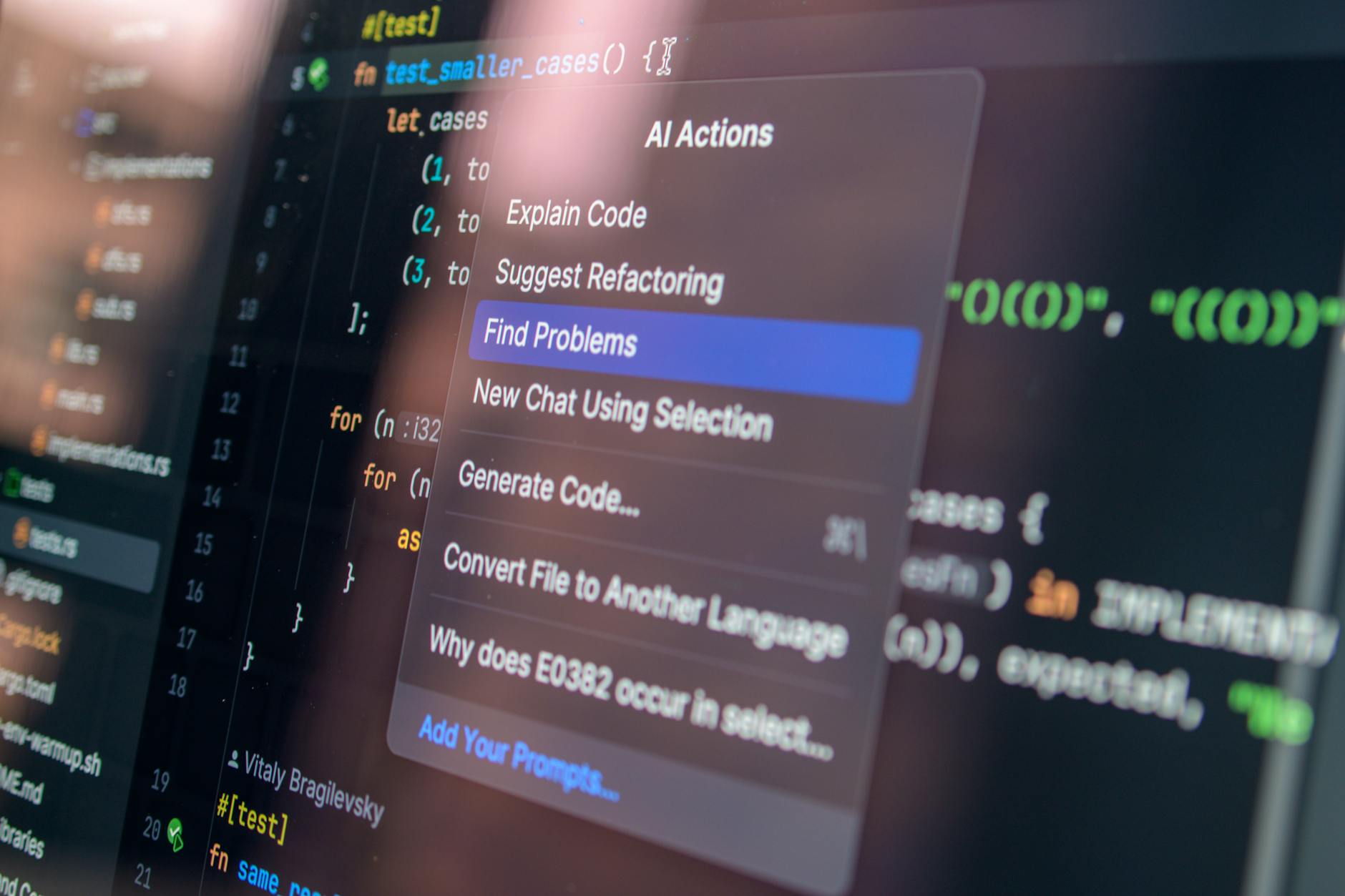

Pro Tip|把 Cyber AI 當成「能力管線」,不是單一工具

專家視角:你如果把它當成會「產出攻擊內容」的工具,心態會先輸一半。更精準的做法是把它當作能力管線:輸入(測試目標/範圍/授權)→ 生成(腳本/檢測流程)→ 審核(合規與風控)→ 執行(隔離環境)→ 輸出(風險報告/修補建議/偵測規則)。只要管線中的任一段缺失,你就等於把「自動化能力」丟到沒護欄的地方。

審核機制與使用限制:安全研究 vs. 濫用風險,OpenAI 怎麼卡位

Axios 提到,OpenAI 設置審核機制與使用限制,試圖在促進安全研究與防範濫用之間取得平衡。這句話聽起來像公關,但如果拆開看,它其實牽涉到三件工程上最敏感的事:

第一,授權範圍(who):誰可以用、用在什麼層級的任務。授權擴大並不代表全開,常見做法是建立可審核的存取層級(例如先給 vetted defender 或經審核的安全研究用途)。

第二,行為邊界(what):模型能生成到哪一步、是否允許「連接資源」這類會放大實際影響力的操作。越靠近「可直接造成破壞」的能力,越需要更強的限制與可追蹤性。

第三,風險可量化(how much):OpenAI 也被指出具備自動化資安風險評估的潛力。你要的是可量化,而不是一句「看起來安全」。

這裡我會把 NIST 的思路也拉進來:NIST 的 AI 風險管理框架(Generative AI Profile)強調在組織層級去識別、衡量並管理風險。它不是針對單一模型,而是對「如何治理 AI」給出可操作方向。你可以把它拿來套到 Cyber AI 的使用流程上:建立治理(Govern)、風險映射(Map)、度量(Measure)、最後落到管理(Manage)。

權威參考:NIST AI Risk Management Framework(Generative AI Profile)

攻擊腳本自動化會怎麼影響防守?建立「攻防迴圈」的新節奏

當 Cyber AI 能自動編寫攻擊腳本、並協助發掘漏洞,再加上可以連接資源,你會得到一個新的現象:攻擊端與防守端都更接近「工業化流程」。在這種情況下,傳統防守策略如果還停留在「等警報、再人工查」會被動。

防守端要建立的是攻防迴圈(Attack-Defense Loop):攻擊側的能力變強 → 防守側要更快產生測試、修補、偵測更新 → 再縮短攻擊側找到可用漏洞的時間窗。

Axios 的報導也提到 Cyber AI 具備自動化資安風險評估潛力,並可能被用在量化交易平台的風險管理與策略調整,探索新型被動收入模式。這代表市場不只在「反駭」:它也會把風險評估變成可交易、可定價的輸出。

結論很直接:攻擊腳本自動化越強,防守的節奏就越要「機器化」。你要的是讓防守端的迭代週期從天/週縮到小時級(至少在測試與風險評估那塊做到)。

2026–2027 產業鏈重排:防守工具、合規與被動收入機會

把視角拉到產業:當 Cyber AI 被用在安全測試、防禦部署、以及風險評估,它會重排至少三段產業鏈。

1) 防守工具:從「告警」走向「可執行的修補/部署」

Cyber AI 能把漏洞發掘、測試腳本、資源串接做成流程,代表防守產品會更強調「輸出可落地行動」,例如把測試結果轉成修補優先級、把風險評分轉成偵測規則更新。這會讓傳統 SIEM/工單系統更需要和自動化引擎串接。

2) 合規與治理:審核/限制會變成採購要件

當模型能力接近攻擊流程,企業採購時會更在意:輸入/輸出如何被監控?審計資料在哪?權限如何收斂?這種治理能力會變成供應商競爭點。NIST 的 AI RMF 提供的是治理框架,你可以預期 2026–2027 的合規會更偏「可度量」而不是「有政策就好」。

3) 商業模式:風險評估可被量化,進而衍生成新收入

Axios 指出 Cyber AI 可能被量化交易平台用於風險管理與策略調整,探索新型被動收入模式。你可以這樣理解:如果資安風險評估能形成可量化輸出,那就能被更廣泛地嵌入到金融/供應鏈/合規成本模型裡。這不一定是直接賣「防禦」,而可能是賣風險資訊的定價能力。

如果你擔心我只是講趨勢:那就回到數字。Gartner 在新聞稿中預估,2026 年全球 AI 支出將達 2.52 兆美元。當資金湧進 AI 基建與應用層,資安自動化與治理工具的需求就會跟著被拉起來。Cyber AI 的授權擴大,本質上是把「資安領域的 AI 應用」推到更靠近現場決策的位置。

給資安/開發團隊的行動指南:一週內能落地的檢查清單

你現在最需要的不是「知道 Cyber AI 很強」,而是把它安全地嵌入你們的開發與資安流程。下面是一週內可以推進的做法(以實作導向為主):

第一天:先定界(Scope)再開 API

- 列出允許的測試類型:只做防禦目的、只在隔離環境執行。

- 設定輸入白名單:目標系統、資料範圍、以及允許的資源連接邊界。

- 建立「不可做」清單:例如禁止把結果直接用於未授權目標。

第二天:建立可追溯輸出(Auditability)

- 要求每次生成都附上:目的、授權依據、測試範圍、預期風險。

- 對輸出內容做結構化:風險評分、影響範圍、修補建議、以及後續偵測點。

第三到第四天:把風險評估接到現有防禦部署

- 把生成的修補建議接到工單或部署管線(CI/CD 或變更管理)。

- 把偵測規則更新納入週期(例如每次重大風險評估後)。

第五天:做對抗測試(Adversarial Thinking),但別亂來

- 用紅隊思維檢查:模型輸出是否會超出授權邊界?

- 確認審核/限制是否真能攔住高風險行為。

第六到第七天:把治理寫進流程(Govern → Map → Measure → Manage)

- 用 NIST AI RMF 的治理邏輯做內部評估,把「風險」落到指標。

- 每月回顧:哪些輸出最有效?哪些會造成流程噪音或合規疑慮?

Pro Tip|把「審核」當作系統的一部分,而不是一次性流程

專家提醒:審核如果只是「提交前人工看一下」,很容易在規模上崩掉。你要做的是把審核變成策略層:輸入策略、輸出策略、執行策略,再配上可追溯紀錄。當 Cyber AI 擴大權限後,系統層級的審核才是你真正的防線。

FAQ:你最可能想問的 3 件事

Q1. OpenAI 擴大 Cyber AI 權限,對普通企業意味著什麼?

意味著具有攻防能力的 AI 能力更容易被合規接入到防禦與測試流程;但同時攻擊端的自動化也可能更快擴散。企業應優先強化權限邊界、隔離執行與審計紀錄。

Q2. Cyber AI 的審核機制應該怎麼落地?

把審核做成策略層:定義可用範圍(scope)、輸入輸出策略、資源連接限制與可追溯日志。再用治理框架(如 NIST AI RMF)設定回顧與衡量指標。

Q3. 防守團隊要怎麼利用它來縮短攻防迴圈?

把它用在可驗證的自動化測試、風險評估與偵測/修補更新流程,並串到部署管線,讓迭代週期縮短、把攻擊者的時間窗壓小。

CTA:想把 Cyber AI 用在你們的防禦流程?

你可以直接把你們目前的測試流程、部署管線與審計需求丟給我們。我們會用「能力管線 + 治理落地」的方式,幫你把 Cyber AI 類型工具接到防禦端,並把風險控制做到可量化。

參考資料(權威來源)

Share this content: