AI 安全落地策略是這篇文章討論的核心

📊關鍵數據:2026 年全球 AI 相關支出預估可達約 $2.52 兆美元(Gartner 口徑),到 2027 年市場機會仍有望衝到 $0.78–0.99 兆美元(Bain 的區間說法)。當資金與研發加速,資料外流的「破窗效應」也會更快擴散。

🛠️行動指南:把資料權限、外部協作、模型訓練管線、以及可稽核的導出/複製路徑,做成工程檢核點;不是靠教育訓練或口頭承諾。

⚠️風險預警:最大漏洞通常不在「你以為的攻擊者」,而在「你以為的內部流程」—例如未授權的文件匯出、審批缺失、或跨境合作沒有完成等級化管控與留痕。

案件到底在說什麼:AI 機密外流如何被定罪

最近這起美國聯邦法院判決,主角是一名前 Google 工程師(Linwei Ding,亦被稱 Leon Ding)。法院判定他向中國相關公司/方向轉交 AI 研發資料,包含技術文件與程式碼等內容,目的在於協助提升中國企業的人工智慧研發能力;而這些行為落在「商業機密侵權」的框架裡,不是單純的職務爭議或跳槽糾紛。

從司法脈絡看,重點不是「AI 資料是否很厲害」,而是「那份資料是不是被依法/合約/流程合理地當作機密保護」。依照美國《經濟間諜法》(Economic Espionage Act of 1996)的核心精神,商業機密包含各種財務、商業、科學、技術、工程等資訊,只要權利人已採取合理措施維護其秘密性,且該資訊從未公開或難以透過正當方式取得,就可能構成刑事層級的保護對象(你可以把它理解成:不是你說它重要就算,還要看你有沒有真的把它「鎖起來」)。

在本案中,DOJ 訊息提到陪審團對相關經濟間諜與商業機密竊取的指控成立(經濟間諜與商業機密竊取的多項罪名都被裁定),法院最後給到具體刑罰:一年監禁與罰款。這種「量刑落點」對企業很直接:一旦公司能證明資料被合理保護、且行為有針對性與受益指向,就算你主張自己是出於技術交流,法院也可能照樣把它當成刑事違法。

換句話講:你如果做的是 R&D 管線,手上摸到的 codebase、模型權重訓練配方、資料處理步驟、加速器/晶片相關的內部文件,都可能在某一天被定義成「商業機密」。而一旦有人把它當作可自由移動的資產,法院就不會用「好心」來替你翻譯。

為什麼這案子會卡到 2026 的 AI 供應鏈?

這案子看似是個人層級的犯罪,但它會在 2026 被放大,原因很現實:AI 產業鏈的投入速度太快,資料流通路徑也太多。你要招人、要外包、要合作做 PoC、要把成果接到雲端或設備端,結果「機密」開始分散在 Git、工單、雲端儲存、模型訓練任務、以及各種協作工具中。

更要命的是市場規模在擴張:Gartner 預估 2026 年全球 AI 支出可達約 $2.52 兆美元;而像 Bain 也提到 2027 年 AI 產品與服務市場可能落在 $780–9900 億美元的區間。金額越大,資料與演算法的「可替代性」越低,盜用成本看似降低、但損失上限反而更高。這就是供應鏈事件會越來越像「連鎖反應」的原因。

下圖用一個偏工程師視角的模型,示意你在 2026 最可能遇到的「機密外流路徑」:從內部研發到外部協作,再到跨境/跨實體傳輸,最後落在可以被「重現」或「快速複製」的資產上。

所以你會看到,供應鏈不只是 IT 事,它會直接影響法律風險與品牌信任。因為一旦出事,你的證據鏈要能回答:誰在什麼時間、用什麼方式、把什麼內容、交給誰。

Pro Tip:把「不該外傳」變成工程流程,而不是口號

我會直接用「可稽核」這三個字打底。因為在商業機密侵權案件裡,法院在意的是合理保護措施,而不是你口頭上說你很重視安全。

Pro Tip 1:做資料分級 + 導出路徑盤點。把機密按「可重現價值」分級:例如訓練配方、關鍵 code 模組、特定數據集處理流程、以及與硬體/晶片相關的內部文件。每一級都要有不同的導出策略(下載、分享連結、API 匯出、快照、權重轉移)。

Pro Tip 2:把審批做成條件式控制,而不是表單收件。跨團隊、跨雲、跨境的協作要觸發不同控制:例如強制簽核、限制下載、啟用水印/指紋、對第三方環境做隔離。最怕的是「流程存在但技術沒實施」。

Pro Tip 3:留痕要做到能講故事。你要能把時間線拼起來:從存取請求、權限變更、到匯出/複製事件。當有人問「為什麼你以為他沒有外傳」,你要拿得出證據而不是猜。

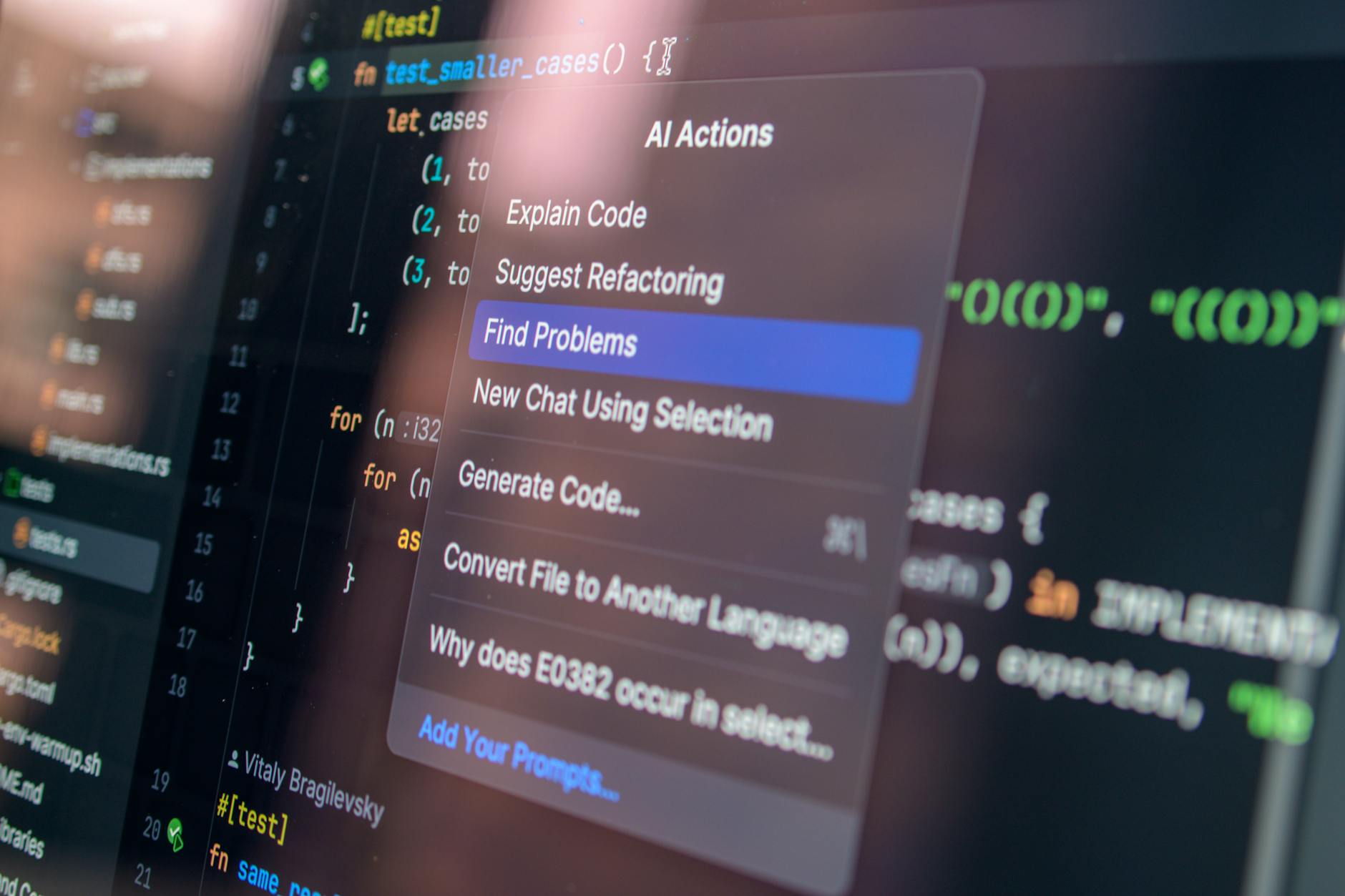

為了讓你更容易落地,下面這張圖把控制點對應到你最常見的工作流:從提交(commit)到訓練(train)到部署(deploy),中間最容易漏的就是「文件匯出與權限漂移」。

⚠️ 企業風險預警清單(含你現在就能做的)

我把風險拆成三層:人、流程、技術。因為「只補技術」會留下流程漏洞;「只寫政策」又會讓技術繼續默認放行。

1)人:跨團隊流動與外部協作的灰區

你要盤點:離職前後的資料存取、轉交給第三方的範圍、以及員工是否對「機密等級」有一致理解。這類案件往往不是單次爆雷,而是長期順路做了幾次看似合理的搬運。

2)流程:審批缺失與權限漂移

常見狀況是:最小授權沒有落實;專案需要導出時,流程可以走但技術沒有真正收斂。結果就是你以為審批存在,系統端仍允許未授權的匯出或複製。

3)技術:導出通道與可稽核性

不要只做「檔案下載阻擋」。更要管:分享連結、API 匯出、訓練快照、權重重新打包、以及第三方環境的落地副本。最終要能回答:這份內容是怎麼被帶出去、在什麼時間、由誰發起。

在你開始補洞之前,建議你做一輪「機密路徑盤點」:列出目前研發到部署的每個階段可能產生的輸出物,並標註「誰能看」「誰能拿走」「怎麼記錄」。做完你就會發現,很多漏洞不是來自攻擊,而是來自你內部流程太鬆。

FAQ

Q:這案子對跨國合作是不是「打擊」?

A:不是否定合作,而是逼你把跨境協作變得可控、可稽核。你仍可以合作,但必須先把資料分級、審批條件與導出限制做完。

Q:如果是研究交流,還是會有刑事風險嗎?

A:可能會。法院的判斷會看資料是否被合理保護、行為是否具有針對性與受益指向,以及是否符合適用的法律要件。

Q:最有效的防護優先順序是什麼?

A:先做資料與導出路徑盤點(知道什麼能被帶走),再做最小授權與審批條件式控制,最後把留痕做成能用來還原時間線的證據鏈。

行動呼籲與參考資料

你現在就可以做的一件事:把你們 AI/ML 研發的「機密導出清單」整理出來(包含檔案、快照、權重、文件與任何能讓人快速複製成果的輸出),然後對照現有權限與審批流程,看看哪裡是「技術默認放行」。

想要我們幫你做 AI 機密防護/合規流程盤點?先聯絡 siuleeboss

權威參考資料(建議收藏):

- 美國司法部(DOJ)新聞稿:Former Google Engineer Found Guilty Of Economic Espionage And Theft Of Confidential AI(含案件核心事實)https://www.justice.gov/usao-ndca/pr/former-google-engineer-found-guilty-economic-espionage-and-theft-confidential-ai

- 《經濟間諜法》(Economic Espionage Act of 1996)背景與「trade secret」保護邏輯(維基百科彙整詞條)https://en.wikipedia.org/wiki/Economic_Espionage_Act_of_1996

- Gartner:Gartner Says Worldwide AI Spending Will Total $2.5 Trillion in 2026(市場規模基準)https://www.gartner.com/en/newsroom/press-releases/2026-1-15-gartner-says-worldwide-ai-spending-will-total-2-point-5-trillion-dollars-in-2026

- Bain:AI’s Trillion-Dollar Opportunity(2027 市場區間)https://www.bain.com/insights/ais-trillion-dollar-opportunity-tech-report-2024/

Share this content: