“`html

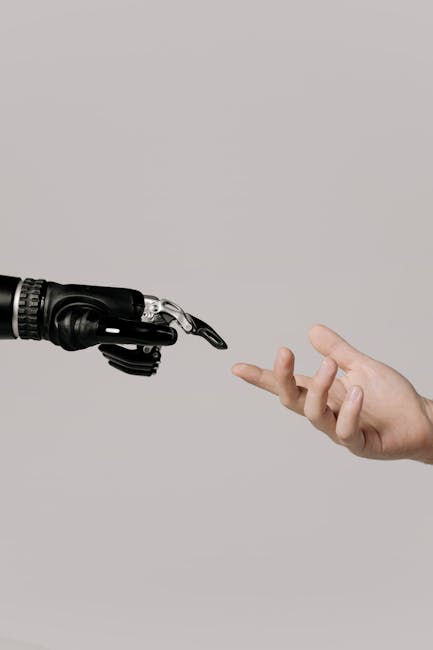

微軟大膽宣言:打造以人為本的超級AI,是福音還是隱憂?

微軟高管穆斯塔法·蘇萊曼近期表示,將致力於開發一種以“符合人類利益”為核心的超級智能系統,並承諾若出現危及人類的結果,將立即停止。這一宣言引發了科技界對於超級人工智能發展方向與潛在風險的熱烈討論。在追求技術突破的同時,如何確保AI發展始終服務於人類,而非反噬人類,成為了擺在所有科技公司面前的重要課題。

超級智能的核心要素與挑戰

- 什麼是超級智能?它與通用人工智能(AGI)有何區別?

超級智能指的是在幾乎所有任務上都能超越人類智能的AI系統。與 AGI 相比,超級智能的潛力更大,但也帶來了更嚴峻的倫理和安全挑戰。它不僅僅是解決特定問題的工具,更可能擁有自主學習和決策能力,這就要求我們必須從一開始就將其設計為服務於人類的利益。

微軟的超級智能戰略:獨立研發與OpenAI合作

此前,微軟主要依賴 OpenAI 的技術。在收購 Inflection AI 的知識產權和團隊後,微軟開始大力發展自身的人工智能研發能力。重新調整與 OpenAI 的合作關係,也讓微軟有權開發自己的 AI 技術。這種雙管齊下的策略,既能利用 OpenAI 的最新成果,又能確保自身在人工智能領域的獨立性。

相關實例:OpenAI、Anthropic PBC 的安全AI策略

OpenAI 和 Anthropic PBC 等機構也在積極探索更安全、更有益於人類的 AI 發展方向。這些公司在 AI 安全領域的探索,為整個行業提供了寶貴的經驗和參考。不同的機構採取不同的立場和做法,共同推動 AI 技術向更安全、更可控的方向發展。

優勢和劣勢的影響分析

以人類利益為核心的 AI 發展策略,優勢在於能夠最大程度地避免潛在的風險,確保 AI 技術服務於人類福祉。然而,這種策略也可能限制技術發展的速度,使其在與其他公司的競爭中處於劣勢。如何在追求安全和效益之間取得平衡,是微軟需要認真思考的問題。

深入分析前景與未來動向

隨著人工智能技術的快速發展,超級智能的出現已不再是遙不可及的夢想。未來,我們將看到更多科技公司投入到超級智能的研發中。與此同時,對於 AI 倫理、安全和監管的討論也將日益深入。只有建立完善的法律法規和倫理規範,才能確保 AI 技術真正造福人類。

常見問題QA

- 超級智能會取代人類嗎?

超級智能的發展目標是增強人類的能力,而不是取代人類。通過合理地設計和使用 AI 技術,我們可以更好地解決社會問題,提升生活品質。 - 如何確保超級智能的安全?

需要從多個層面入手,包括技術層面(例如,開發更安全的算法)、倫理層面(例如,建立明確的倫理規範)和法律層面(例如,制定完善的法律法規

相關連結:

Share this content: