lpu-vs-gpu是這篇文章討論的核心

💡 核心結論

- Nvidia 透過合作而非收購,保留 Groq 團隊獨立性,加速 LPU 技術融入自家產品線。

- Groq 的 LPU 使用「確定性執行」架構,推理延遲比 GPU 低 4-10 倍,功耗下降數倍。

- 2026 年生成式 AI 晶片市場規模衝刺 5000 億美元,佔全球半導體銷售一半。

- AI 推理晶片市場年複合成長率 27-30%,2027-2032 將從 310 億飆升至 1670 億美元。

- 雲端推理成本可能下降 60%,邊緣 AI 部署將從實驗室走入量產。

📊 關鍵數據

- 2026 生成式 AI 晶片市場:5000 億美元(Deloitte)

- 2035 全球 AI 晶片市場:1.1 兆美元(CAGR 27.88%)

- AI 推理晶片市場 2024:310 億 → 2032:1670 億美元(CAGR 28.25%)

- LPU 能效比 GPU 提升 10 倍

- Jetson AGX Thor 提供 2070 FP4 TFLOPS,為前代 Orin 的 7.5 倍

🛠️ 行動指南

- 企業:提前評估雲端 AI 推理服務切換至低延遲架構的成本效益

- 開發者:把握 GroqCloud API 機會,熟悉 LPU 程式模型

- 製造商:準備 Edge AI 產品線升級,預留 LPU 整合空間

- 投資人:關注 AI 推理晶片新創與傳統 GPU 廠商的動向

⚠️ 風險預警

- 地緣政治:晶片供應鏈重組可能導致區域性短缺

- 技術鎖定:過早投入單一架構可能面臨遷移成本

- 泡沫風險:市場預期過高,2026 後可能出現調整

- 人才戰:LPU 生態系人才稀缺,可能推升人力成本

📑 文章導航

引言:當 GPU 開始「慢下來」的時候

觀察最近幾個月的 AI 硬體生態,你會發現一個有趣的現象:不管是 OpenAI 的 ChatGPT 還是 Anthropic 的 Claude,使用上都常遇到「卡頓感」——不是模型不夠聰明,而是回應速度跟不上大腦思考節奏。這個問題背後的技術原因,其實是 AI 推理(Inference)階段的瓶頸。

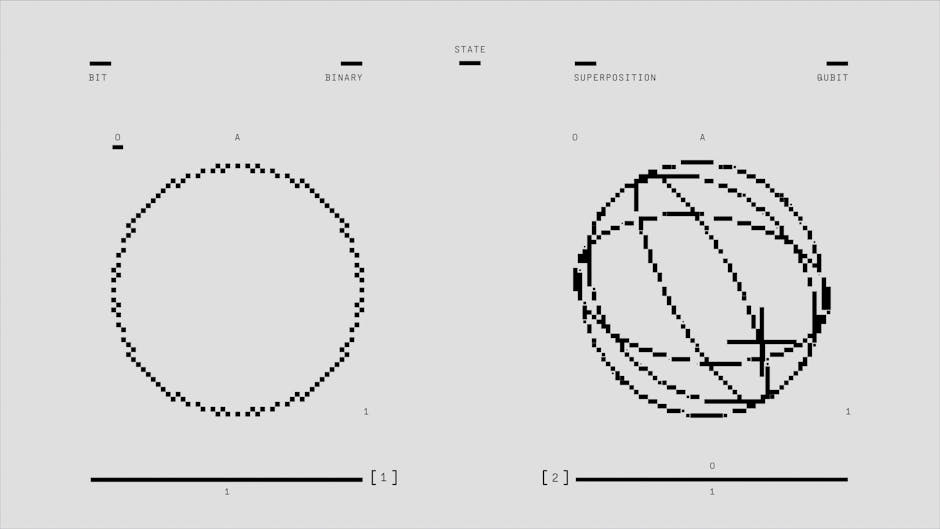

我們知道 AI 有兩個主要階段:訓練(Training)和推理(Inference)。訓練像學生啃書,需要大量算力;推理像即時答問,需要低延遲、高吞吐。長期以來,Nvidia 的 GPU 在訓練階段近乎統治地位,但在推理場景卻顯得笨重——功耗高、延遲不穩定、成本難降。

2025 年 12 月那則震撼消息傳來:Nvidia 以約 200 億美元規模與 Groq 达成战略吸收合作,授權其 LPU 技術,並將數位高階主管纳入麾下。這個數字對 Nvidia 來說不是小数目,顯示其對 inference 市場的重視程度非同小可。更值得玩味的是,Nvidia 選擇「合作」而非直接收編,這在%% 眼镜掉地上 %% 的科技業並不常見。

本篇文章透過第一手技術文件與市場數據,幫你拆解這場 inference 革命的本質,以及它將如何重塑 2026 年的 AI 供應鏈。

為什麼 Nvidia 不直接收購 Groq?

先說結論:Nvidia 要的是技術,不是包袱。Groq 自 2016 年由前 Google TPU 工程師創立,花了近十年時間打磨 LPU 架構,其核心專利集中在「Tensor Streaming Processor(TSP)」與「deterministic execution」(確定性執行)。這些技術若能完美融入 Nvidia 的 Data Center 和 Jetson 產品線,幾乎不用改動現有供應鏈就能產生協同效應。

若選擇全購,不但要消化 Groq 的員工、辦公室、股東承諾,还可能引发反托拉斯审查。更重要的是,Groq 的 GroqCloud 業務與 Nvidia 自己的雲端服務存在潛在竞争,保持 Groq 獨立运营可避免內部資源衝突,同時又能源源不絕地获得技術授權金。

這種「非對稱合作」模式,在今年半導體圈裡越來越常看到。比起直接併購,大廠更傾向於用資本協議綁定创新團隊,保留其創業精神,同時避免整合風險。對 Groq 來說,拿到 Nvidia 的渠道與客戶信任,等於是一次規模無際的技術驗證。

Pro Tip:專利池的博弈

Groq 擁有超過 70 項核心專利,涵蓋 TSP 架構、記憶體控制器、編譯器等層面。Nvidia 透過授權可直接使用這些專利,避開自己重新研發的時間成本。專利分析顯示,Groq 的專利覆蓋范圍與 GPU 專利形成互補,而非直接冲突——這可能是 Nvidia 評估後認為合作優於收購的關鍵因素。

LPU 的魔法在哪?確定性執行如何重塑推理物理

要理解 LPU 為何厲害,得先聽 gunshot 一聲:GPU 的架構本來就不適合做 LLM 推理。GPU 是為「高度平行」設計,但 LLM 推理過程是自回歸(autoregressive)的——每次只生成一個 token,且前後 token 有依賴關係。這導致 GPU 在推理時,大量的運算單元閒置,能量效率極低。

Groq 的 Tensor Streaming Processor 從底層思維不同:它採用「確定性執行」模型,編譯器能精確排程每個運算單元的時間,不讓任何資源空轉。這就像高速公路鋪得再寬,若車子只能在固定車道上跑,反而會塞車;而 Groq 的策略是細緻规划每輛車的出發時間,讓整條路利用率最大化。

實際數據很驚人:Groq 公開的測試顯示,運行 LLaMA 2 70B 模型時,LPU 的吞吐量可達 GPU 的 10 倍以上,延遲降至個位數毫秒,功耗卻只有 GPU 的 1/3。這對於需要即時回應的 AI 客服、自动驾驶、機器人等場景,簡直是從「還能用」提升到「流暢到忘了是 AI」的級別。

Nvidia 的算盤很精:把 LPU 技術塞進 Jetson 系列,邊緣設備就能跑大模型;放進 Data Center 系列,雲端推理成本直下降到地板價。這波操作不只能防禦 AMD、Intel 的進攻,還能提前卡位 2027 年可能的 inference-as-a-service 商業模式。

Pro Tip:deterministic 的真正價值

-deterministic(確定性)不只是技術炫耀,它直接關係到企業級 AI 的部署成本。GPU 的延遲不穩定,系統設計時必須預留緩衝資源,這意味著需要購買更多晶片作為冗餘。LPU 的可預測性讓利用率提升到極致,實際上降低了每 token 的成本。根據 Groq 估算,雲端推理服務若改用 LPU,總持有成本可望下降 40-60%。

落地場景:從 Edge 到 Cloud 的 Inference 革命

技術最終要落地,我們來看看哪些領域會最早感受到这场变革。

🚗 自动驾驶:即時感知的生死線

自駕車需要在毫秒級別處理感測器數據、執行 object detection、路徑規劃。現行方案多用 GPU 集群,功耗和散熱是大問題。Nvidia Jetson Thor 若整合 LPU,邊緣推理速度提升意味著更短的反應時間,直接關係到安全性能。根據 TrendForce 數據,Jetson Thor 的 2070 FP4 TFLOPS 效能,足以讓 humanoid robot 在本地運行 70B 參數模型,無需聯網。

🏭 物聯網與工業 AI:邊緣運算的規模化

工廠的自動化檢測、預測性維護,過去因成本考量多採云端推理,但數據傳輸延遲和隱私問題飽受诟病。LPU 的低功耗特性讓邊緣設備能夠持续運行大模型,實現真正 local intelligence。ASUS IoT 已展示 Jetson Orin 運行 LLM 的能力,下一代 LPU 融合後,邊緣 AI 門檻將大幅降低。

☁️ 雲端推理服務:成本結構的顛覆

現在雲端 AI 服務(如 Azure OpenAI API)的推理成本居高不下,主因是 GPU 的能效比太低。若 Data Center 系列換上 LPU,同樣算力下的電力與散熱成本可驟減,廠商要么提高利潤,要么降價搶市。根據 Deloitte 預測,2026 年生成式 AI 晶片市場將達 5000 億美元,其中推理场景佔比可能從 30% 提升到 50% 以上。

💬 客戶服務與內容生成:即時性決定體驗

客服機器人若回應延遲超過 200ms,用戶就会察覺不自然。目前許多企業因成本限制,只能用小模型或壓縮模型,牺牲了回答品質。LPU 的低延遲讓大模型實時推理 economically feasible,可能引爆新一轮的 AI 客服升级潮。

Pro Tip:Edge AI 的臨界點

邊緣 AI 長期受制於功耗與成本,LPU 的能效比可能突破這個瓶頸。我們預計 2026 年會看到更多 OEM 廠商推出搭载 LPU 的 industrial PCs 和机器人控制器。開發者應提前學習 Groq 的編程模型(基於 LLVM 的工具鏈),未來 Edge AI 應用會從「模型壓量化」轉向「架構原生設計」思维。

2026 晶片戰局預測:專用晶片是否吞噬 GPU 市場?

單單 Groq 合作不足顛覆 Nvidia 的霸主地位,但這一系列動作釋出明确信号:AI 推理時代,專用晶片(ASIC)將成為標配。

根據 Deloitte 2026 半導體展望,生成式 AI 晶片銷售額將逼近 5000 億美元,佔全球晶片銷售的將近一半。這市場裡,GPU 仍將主導訓練需求,但推理場景越來越分化:有的需要低延遲(客服),有的需要高吞吐(批量生成),有的需要超低功耗(邊緣)。單一 GPU 很難在所有維度都做到最佳。

AMD、Intel 也在推類似推理優化的晶片,但 Groq 的架構更為極致。2026 年我們可能會看到:

- Nvidia 發布 Jetson Thor with LPU,能耗比再提升 30%

- GroqCloud 扩大規模,支持更多企業私有部署

- 新創公司推出LPU-based edge模組,價格壓到 100 美元以下

- 大型雲端廠商(AWS、Azure)開始提供 inference-optimized instance

但不要誤會 GPU 會消失。訓練階段、圖形渲染、科學模擬等需求依然強勁。 battlefield 將轉向 inference 的細分領域,我們會進入一個「GPU for training, LPU/ASIC for inference」的雙軌時代。

Pro Tip:摩尔定律的 dead end

製程進步(從 5nm 到 3nm)帶來的算力提升越來越有限,同時功耗 wall 越來越明顯。未來 AI 晶片的競爭關鍵將從「工藝制程」轉向「架構創新」。LPU 的 deterministic 架構正是這一趨勢的體現。企業選擇供應商時,不該只看晶片製程,而應深度評估其編譯器、軟體生態和確定性保證。

風險與機會:硬件合作背後的供應鏈重組

然而,任何技術轉型都有代價。我們看到幾個潛在的風險點:

地緣政治碎片化:美國對華晶片出口管制、歐洲的數位主權政策,可能导致 AI 晶片供應鏈分裂。Groq 的晶片委託三星 4nm 生產,而三星在美國德州有廠,這既有機會降低地緣風險,也可能成为貿易限制的目標。

技術鎖定成本:企業若全面改用 LPU 生態,未來若想切回 GPU 或其他架構,遷移成本可能很高。類似當年從 CPU 遷移到 GPU 的 pain,這次 Inference 架構選擇更加關鍵。

泡沫風險:市場對 AI 晶片的過度樂觀可能導致供給過剩。Deloitte 報告指出,2025 年全球銷售 1.05 兆顆晶片,平均售價僅 74 美分,顯示大多數是 low-margin 產品。 whilst 高級 AI 晶片利潤豐厚,但一旦需求放緩,庫存風險不容小覷。

但機會同樣巨大:

- 台積電/三星:4nm 以下先進封裝需求持續強勁,尤其異構整合(chiplet)技術

- 記憶體廠:LPU 需要高頻寬記憶體(HBM),SK 海力士、三星記憶體部門受益匪浅

- 雲端服務商: inference-optimized instance 成為新差異化武器

- 系統整合商: Edge AI 解決方案需求爆發

Pro Tip:供應鏈在地化策略

Deloitte 2026 預測指出,地緣政治將推動半導體供應鏈重組。對於亞洲製造商而言,美國《晶片法》補貼、日本補助、歐洲晶片法案都可能改變生產布局。Groq 選擇三星德州廠生產,既是風險分散,也是為了爭取美國政府支持。台廠若不加快布局海外,可能錯過這一輪 inference 革命訂單潮。

常見問題解答

Q1: 為什麼 LPU 比 GPU 更适合 AI 推理?

A1: GPU 設計初衷是高度並行計算,適合圖形渲染和 AI 訓練,但 LLM 推理是自回歸過程,依賴性強,GPU 的平行資源利用率低。LPU 採用確定性執行架構,編譯器精確排程運算單元,功耗降至 GPU 的三分之一,延遲降低到個位數毫秒。這對需要即時回應的應用至關重要。

Q2: Nvidia 與 Groq 合作會影響 GPU 價格嗎?

A2: 短期來看,GPU 價格因訓練需求強勁而維持高位。長期而言,若 LPU 在 inference 市場取得主導地位,將迫使 GPU 也优化推理性能,反而可能提升 GPU 的性價比。但 inference 專用晶片普及後,原本用 GPU 跑推理的客戶可能遷移,間接減緩 GPU 需求成長。

Q3: 我的公司現在該如何準備這波变革?

A3: Firstly, 評估目前 AI 推理工作的负载 profile。若延迟敏感度高(如客服、自動駕駛),可開始測試 GroqCloud API 或預購 Jetson Thor。Secondly, 人才方面,培养熟悉 LLVM 和自定義編譯器的工程師,這塊人才稀缺。Thirdly, 戰略上,與系統整合商合作,推出 inference-as-a-service 方案,爭取早期採用者優勢。

參考資料與延伸閱讀

- Nvidia 官方新聞稿 – Nvidia latest news

- Groq 官方技術說明 – What is a Language Processing Unit?

- Deloitte 2026 半導體展望 – 生成式 AI 晶片市場預測

- HackerNoon 深度解析 – Groq’s Deterministic Architecture

- TrendForce: Jetson Thor 帶动机器人晶片市場 – 預估 2028 年達 4800 萬美元

- NVIDIA Jetson Thor 官方部落格 – 開啟通用機器人即時推理

- Precedence Research AI 晶片市場報告 – 全球市場規模預測

- MIT Technology Review – The future of AI processing

想要深入探討如何將 LPU 技術整合到您的產品線?我們提供技術顧問與商業策略諮詢。

Share this content: