神經計算機工程路線圖是這篇文章討論的核心

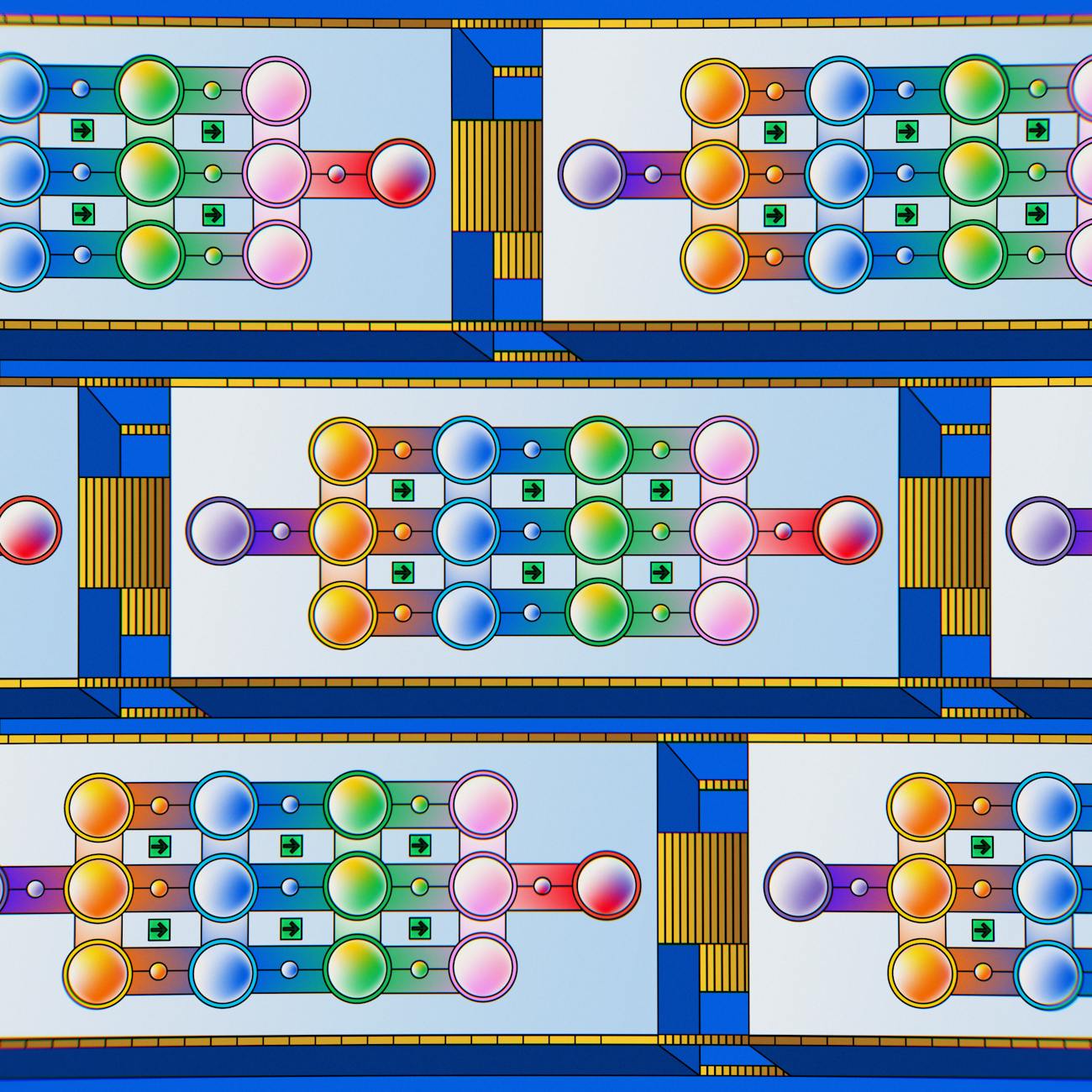

Meta AI x KAUST 的「完全神經計算機工程路線圖」:把神經網路推理直接搬進硬體,2026 之前你會先看到哪些變化?

01. 你以為是神經科學貼紙?其實 Meta AI x KAUST 在工程上要解的是什麼「推理硬體」問題?

我第一眼看到《完全神經計算機工程路線圖》的描述時,直覺反應是:又是一個用「神經形態」包裝的工程願景。後來我換個角度去看——這篇其實更像是「怎麼把神經網路推理落地到硬體」的拆解清單:該選脈衝神經網路當計算語言、該怎麼做存儲‑計算耦合把資料搬運成本降到最低、以及類比訊號處理要在哪些模組扮演關鍵角色。

這裡有個很務實的背景:如果你一直把推理卡在傳統的算力管線(資料在記憶體與計算單元間來回搬),延遲與功耗就很難真正下去。脈衝神經網路的事件驅動特性,本來就更適合把「只有需要的時候才算」變成工程上的常態;再搭上存儲‑計算耦合,就等於你不用一直搬同一份資料到遠端算。

而 Meta AI 與 KAUST 強調的,是一個「可以直接執行神經網路推理」的硬體構建路線,意思是:不是只做概念架構或訓練展示,而是要走到能跑、能量化、能對比的系統層級。

02. 完全神經計算機路線圖:脈衝神經網路、存儲‑計算耦合、類比訊號處理到底怎麼搭在一起?

把它當成一台「神經計算機」而不是「神經網路在電腦上跑」會比較貼近它想表達的重點。工程上通常會分成三段:計算語言(spiking)、記憶/運算靠近(存儲‑計算耦合)、以及訊號落地(類比處理)。路線圖把這三段一起談,才有辦法降低延遲與功耗。

(1)脈衝神經網路:把推理變成事件觸發

脈衝神經網路用「發放脈衝」描述神經元狀態,計算不是每個時刻都做滿,而是根據事件稀疏性觸發更新。這在推理階段特別關鍵:模型如果能在事件層級保持效率,你的系統就能少做很多「其實對結果貢獻不大的運算」。

(2)存儲‑計算耦合:把帶寬壓力變成局部運算

你可以把它理解成:權重/狀態不必一直從記憶體搬去計算單元。當你把存取與計算揉在同一個物理位置或同一個硬體模組附近,瓶頸往往會從「搬運」變成更可控的「局部耦合與校正」。這也是能效路線會一直被提的原因——因為搬運通常就是功耗大戶。

(3)類比訊號處理:讓物理層直接參與運算

類比不只是「用類比電路做加減乘」,而是把訊號路徑設計成能承擔神經運算的部分功能。對工程團隊來說,類比可能意味著更高的能效潛力,但也更需要對噪聲、漂移與一致性做工程管理。

路線圖整合的關鍵就在這裡:它不是把脈衝與存儲‑計算耦合、類比處理各做各的,而是把它們當成同一台硬體平台的「共同設計約束」。你要降低延遲與功耗,就必須讓資料流、事件流、訊號流一起對齊。

03. 數據/案例佐證:為什麼脈衝 + 類比 + 交叉陣列被反覆驗證是「能效路線」?

我這段不打算用「感覺會有效」來糊弄你。脈衝/類比神經硬體之所以被持續研究,原因通常落在三個可檢驗方向:(a)稀疏事件帶來的運算減量、(b)記憶體與計算靠近帶來的搬運減量、以及(c)透過物理計算/電路加速縮短延遲鏈。

例如在學術社群裡,memristor(類阻變/電阻式記憶)與 spiking 系統常被拿來做能效證明。以 Science Advances 的研究為例,研究者實作「全 memristive 的脈衝神經網路」用於圖問題,並以「高能效」作為核心結論之一(你可以把它當成同類技術的代表案例)。類似脈衝神經網路在神經形態硬體上的整合實作,也常見於 Nature/期刊論文與工程平台報告中。

另外,KAUST 本身在神經形態/脈衝神經網路的研究領域確實有明確資源與主題頁面可追蹤;以 KAUST 的工程學科主題列表來看,可以作為你「這不是憑空講講」的信號:KAUST Electrical and Computer Engineering:Spiking neural networks。

04. 對 2026 與未來供應鏈的長尾影響:哪些環節會先被重寫?

如果《完全神經計算機工程路線圖》走到「可擴展、可驗證」的程度,對供應鏈的影響不會只停在某顆晶片。它更像把重心往「端到端推理效率」移動:從模型、到編譯/映射工具鏈、到硬體封裝與測試流程,再到系統層的功耗管理與運維。

(1)GPU 之外的推理型硬體會更快被要求“能跑且划算”

2026 前後,市場對 AI 基礎設施的採購會更現實:不是只看峰值算力,而是看「同一個工作量的每秒成本」。當脈衝/類比/耦合能把延遲與功耗壓下來,推理型硬體的 ROI 論述會變得更硬。

(2)編譯器與映射(mapping)工具鏈成為核心護城河

脈衝網路到實體電路的映射不是一行指令就完事。你需要把模型轉成硬體能接受的脈衝規格、權重表示、以及電路可接受的動作範圍;還要處理噪聲與漂移下的穩定性。換句話說,未來「軟硬協同」會比「只賣硬體」更能決定成敗。

(3)邊緣端即時推理的商業化會更自然

當延遲成本下降,你的產品就更敢把推理放進更靠近使用者的位置,例如互動式視覺、即時語音摘要、或需要低能耗的感測融合。這類應用的爆點常常不是模型多厲害,而是系統整體反應速度與功耗能不能跟上。

(4)研究平台的角色從“論文 demo”轉向“可量化基準”

路線圖強調工程建構,意味著會更重視可對比的指標:同等任務下的延遲、功耗、吞吐、以及在規模化後是否崩潰。對產業來說,這是能讓採購方有信心的要素。

05. Pro Tip + 風險預警:你該怎麼判斷一個脈衝硬體方案能不能量產?

Pro Tip(專家見解區)

看脈衝/類比硬體時,別先問「它能不能跑模型」,要先問三個工程問題:1)它的事件/脈衝參數在硬體上的誤差範圍是多少,是否有可重現的校正流程?2)存儲‑計算耦合的資料流是否能在規模增加時維持吞吐(不是小規模好看,大規模就掉鏈)?3)延遲降低是來自真正的物理路徑縮短,還是只是 demo 中某些不計成本的前後處理沒算進去?只要回答這三個問題,你就能提前避開“看起來很強,但部署會哭”的陷阱。

接著是風險預警(很重要,我會講得直白點):類比訊號處理與脈衝架構會讓系統對製程一致性與噪聲容忍度更敏感;如果你只把它當成「演算法」問題,最後你會發現硬體校正、漂移補償、測試成本會吞掉本來要省下的功耗/延遲優勢。還有一個常見雷點是工具鏈:沒有成熟的 mapping 與編譯器支持,你的模型很可能在硬體限制下被迫大幅妥協。

那要怎麼避免?實務上你可以用「基準測試」的方式倒逼方案:用同一任務、同一輸入分佈,比延遲、比功耗、比吞吐,同時記錄校正開銷與重訓/重校頻率。能量產的系統通常不會怕測試,它怕的是你沒有把測試設計成“真實部署”。

FAQ

什麼是「完全神經計算機工程路線圖」在講的核心?

它聚焦如何把神經網路推理直接構建到硬體端可執行的平台:整合脈衝神經網路、存儲‑計算耦合與類比訊號處理,以降低延遲與功耗,支撐大規模神經科學 AI 的落地。

脈衝神經網路為什麼常被拿來做能效硬體?

因為脈衝架構能利用事件驅動與稀疏更新的特性,讓推理不必在每個時刻都做滿運算;若再搭配存儲‑計算耦合,就能把資料搬運的功耗壓低。

我該怎麼判斷這類硬體方案是否能量產?

重點看可量化基準:硬體上的校正/漂移補償是否可重現、吞吐能否在規模增加後維持、以及延遲/功耗是否包含真實前後處理成本;沒有成熟工具鏈(mapping/編譯)也通常會拖慢落地。

現在就把這題落到你的產品:下一步怎麼做?

如果你在做 AI 產品、研究平台,或正在評估推理硬體方向,別只看標題。把你目前的瓶頸拆開,對應到「事件/稀疏性」「資料搬運」「硬體映射」三件事。這樣你才會知道你要的是演算法突破、還是工程路線圖那種可執行架構。

參考資料(權威來源):

Science Advances:Fully memristive spiking neural network for energy-efficient graph … 、

KAUST ECE:Spiking neural networks

Share this content: