google turboquant triggers panic是這篇文章討論的核心

文章導航目錄

快速精華

- 💡核心結論:美光股價從高點下修逾20%進入技術性熊市,但公司已簽署五年策略性協議,2026年高階記憶體訂單全數售罄,短期波動不掩長期價值。

- 📊關鍵數據:全球AI市場預估將於2027年達到7,800億至9,900億美元規模,HBM市場以26.8%年複合成長率擴張,2030年上看98.4億美元。記憶體短缺預計持續至2027年。

- 🛠️行動指南:投資者應密切關注美光資本支出執行進度、HBM4技術量產時程,以及TurboQuant等演算法對實際記憶體需求的影響。

- ⚠️風險預警:前瞻本益比降至4.5倍反映市場對AI需求觸頂的擔憂,Google TurboQuant可能降低6倍記憶體使用量,短期股價波動可能加劇。

引言:一場演算法引發的記憶體風暴

說真的,當我看到美光股價從高點狂瀉超過20%、正式墜入技術性熊市那一刻,腦海中閃過的第一個念頭是:「這不就是半導體週期的經典劇本嗎?」但這次不太一樣。觀察過去一年AI資料中心投資狂潮帶動的高階記憶體需求爆炸,市場情緒從「買不到」瞬間轉向「賣不掉」的恐慌,背後的導火線竟是一個名為TurboQuant的演算法。

這不是單純的股價修正,而是一場關於AI運算效率與記憶體需求之間的深層博弈。美光管理層大膽將2026財年資本支出預期從200億美元拉高至250億美元,同時宣佈已與大客戶簽署為期五年的策略性協議,記憶體訂單售罄至2026年——這樣的「豪賭」在TurboQuant衝擊波下顯得格外耐人尋味。

作為標普500指數中前瞻本益比僅4.5倍、堪稱「最便宜標的」的記憶體大廠,美光的處境折射出整個AI供應鏈的矛盾與機遇。究竟這場風暴是短暫的市場過度反應,還是AI記憶體需求觸頂的預警訊號?我們需要深入剖析。

Google TurboQuant演算法為何讓記憶體產業恐慌?

Google Research在2026年3月發布的TurboQuant演算法,堪稱AI壓縮技術的一次「範式轉移」。這套訓練免費的壓縮演算法能將大型語言模型(LLM)的鍵值快取記憶體使用量降低至少6倍,在H100 GPU上甚至實現高達8倍的加速效果,且不會造成任何模型準確度損失。

簡單來說,TurboQuant解決了一個關鍵痛點:AI模型推理過程中,「工作記憶體」往往佔據大量GPU資源。透過將鍵值快取量化至僅3位元,這套演算法直接衝擊了「AI需要海量記憶體」的既有假設。TechCrunch甚至戲稱,如果Google的AI研究員有幽默感,這項技術應該被命名為「Pied Piper」——矽谷影集中那個以壓縮技術聞名的虛構公司。

Ars Technica報導指出,TurboQuant讓AI模型更高效運行,卻不會像其他壓縮方法那樣犧牲輸出品質。這對於依賴高階記憶體(特別是高頻寬記憶體HBM)的AI數據中心來說,可能意味著硬體採購週期的重新評估。

Pro Tip 專家見解:Forbes分析指出,TurboQuant這類壓縮技術的普及,短期可能壓抑單一AI模型的記憶體需求,但長期反而可能透過降低AI部署門檻,刺激更多AI應用落地,進而推升整體記憶體消費量。換言之,效率提升與總需求增長並不矛盾,這正是Jevons悖論在AI領域的體現。

市場對TurboQuant的反應近乎恐慌。美光、三星、SK海力士等記憶體類股全面走跌,投資人擔心AI資料中心的記憶體需求增長曲線被這項技術「折彎」。但這種擔憂是否過度?我們需要更全面的數據支撐判斷。

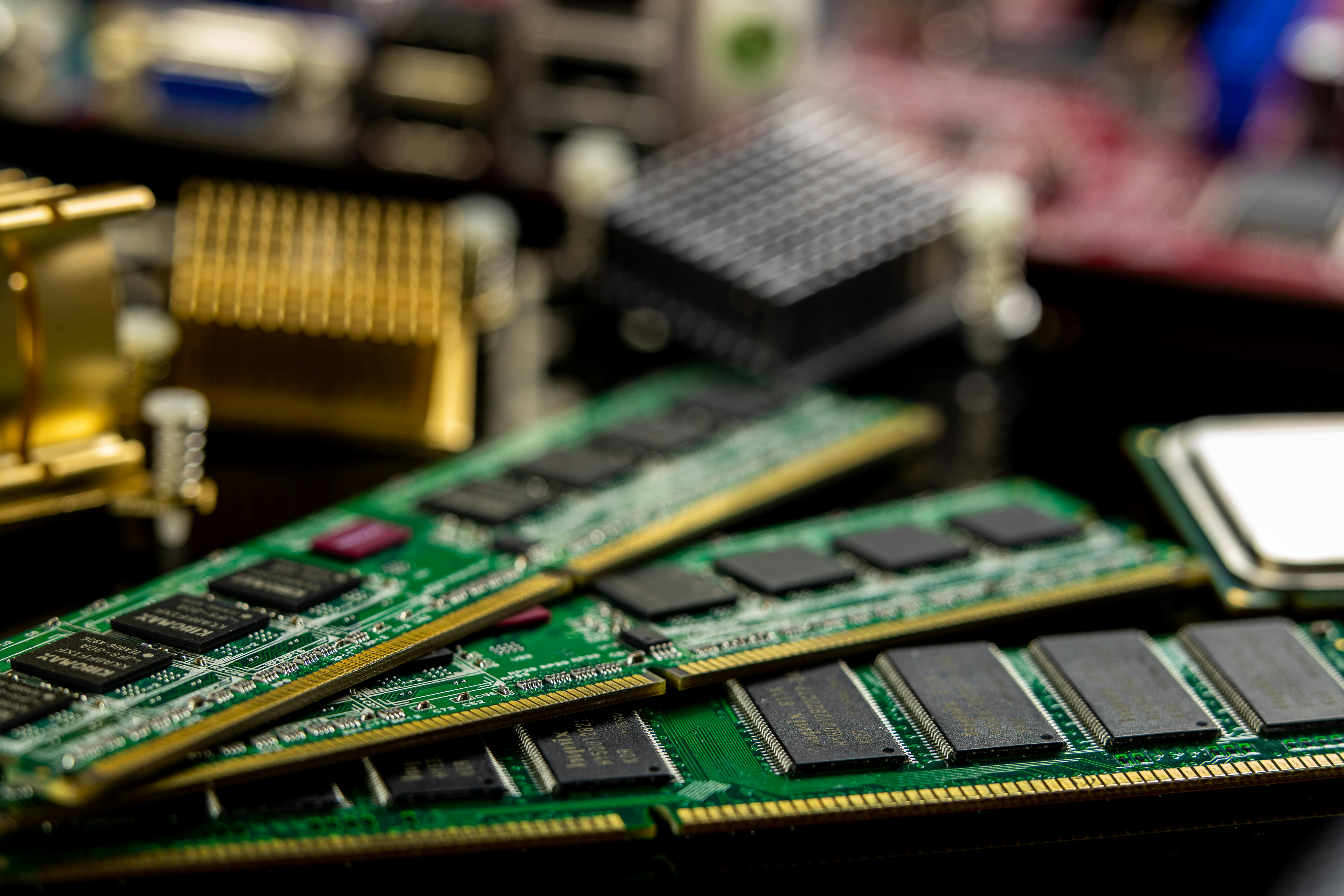

美光250億美元豪賭:逆向投資還是精準佈局?

當市場因TurboQuant而拋售記憶體股時,美光卻選擇逆勢加碼。公司將2026財年資本支出預期從原先的200億美元大幅提升至250億美元以上,年增幅超過100億美元,理由明確:擴建愛達荷州與紐約州的潔淨室設施,並透過台灣據點加速產能擴張。

TrendForce報導指出,美光更簽署了其歷史上首份五年策略性客戶協議,預付訂金鎖定產能,2026年高階記憶體訂單已全數售罄。這意味著,即便TurboQuant降低單一模型記憶體需求,大型雲端服務供應商仍願意以長約形式確保供應。

這背後的邏輯值得深究。根據IDC與Gartner的分析,全球記憶體短缺預計將持續至2027年,AI資料中心需求持續超越供給。Omdia與TrendForce的報告更警告,HBM與傳統DRAM的短缺將至少延續至2027年底。

CNBC報導稱,三大記憶體供應商——美光、SK海力士與三星——幾乎壟斷全球RAM市場,且因短缺而受益。美光的五年長約策略,本質上是將「短缺紅利」提前鎖定,同時以產能擴張搶佔HBM4等下一代技術的制高點。

根據The Business Research Company的數據,HBM市場預計將以26.8%的年複合成長率擴張,2030年達98.4億美元規模。美光若能在HBM4時代取得20-25%的市場份額(如AInvest所預測),其投資回報將相當可觀。

Pro Tip 專家見解:AInvest分析指出,美光2025年Q3毛利率達39%,Q4更攀升至44.5%,反映高階記憶體產品的定價能力。HBM3E需求持續超越供給,HBM4(速度提升60%)將於2026年進入量產,這解釋了美光為何敢在股價低迷期大舉投資。高毛利產品組合轉型,是其自信的根源。

然而,風險同樣不容忽視。250億美元的資本支出意味著沉重的現金流壓力,若AI需求真的因TurboQuant等技術而降溫,美光可能面臨產能過剩危機。這正是市場拋售的核心邏輯:擔心美光「看錯週期」。

2026-2027 AI記憶體短缺危機:兆美元市場的供需博弈

要判斷美光的豪賭是否合理,我們必須將視角拉高到全球AI產業的供需格局。Bain & Company的報告預測,全球AI相關產品與服務市場將從2025年的1,850億美元,成長至2027年的7,800億至9,900億美元,年成長率達40-55%。

NVIDIA執行長黃仁勳更在GTC大會上宣佈,預計透過AI處理器銷售創造1兆美元營收(至2027年)。雖然Bloomberg報導指出,市場對此預測的反應相對平淡(股價當日下跌0.9%),但這凸顯了AI基礎設施投資的規模。

問題在於:供給能否跟上?IDC的報告直言,全球記憶體短缺可能持續至2027年,AI資料中心需求持續超越供給。Gartner更預測,記憶體成本攀升將導致2026年全球PC出貨量減少10.4%、智慧型手機出貨量減少8.4%,顯示短缺已外溢至消費電子市場。

EnkiAI的報告指出,2026年消費電子市場的風險並非缺乏半導體產能,而是產能被「策略性重分配」至高毛利的HBM與AI資料中心記憶體。三大供應商已預售2026年的HBM供給,消費市場只能接受價格上漲或供給減少的現實。

在這樣的供需格局下,TurboQuant的影響需要重新評估。PCMag提出了一個關鍵問題:TurboQuant能否解決「RAM危機」?答案可能是「部分解決」。VentureBeat報導指出,TurboQuant將AI記憶體速度提升8倍、成本降低50%,但這主要針對推理階段的鍵值快取,而非訓練階段的海量記憶體需求。

Pro Tip 專家見解:Tom’s Hardware分析指出,TurboQuant將LLM鍵值快取壓縮至3位元且無精度損失,這對於大型AI模型的部署成本確實有顯著影響。然而,AI訓練階段的記憶體需求仍持續攀升,且隨著模型規模擴大(參數量從數十億邁向數千億),訓練所需的HBM容量只會增加。壓縮演算法改變的是「使用效率」,而非「總需求趨勢」。

Avnet的產業分析將2026年定義為「AI驅動的超級週期」,記憶體與儲存市場進入多年增長軌道。Bank of America預測DRAM營收將大幅增長,HBM引領的記憶體週期將持續至2027年以後。

投資者該如何解讀:熊市中的佈局契機?

回到美光的股價表現,前瞻本益比僅4.5倍,在標普500指數中堪稱「地板價」。Zacks報導指出,美光2025年股價大漲239%,但當前估值反映市場對AI需求觸頂的極度悲觀預期。

然而,這種悲觀是否合理?Benzinga的分析顯示,分析師對美光2026、2030年的股價預測存在巨大分歧,從保守的200美元到樂觀的500美元以上皆有。這反映市場對「AI週期何時反轉」缺乏共識。

觀察幾個關鍵指標:

- 需求端:五年策略性協議與2026年訂單售罄,顯示大型雲端客戶對供應安全的重視勝過壓縮演算法的潛在影響。

- 供給端:250億美元資本支出意味著2027年後產能將大幅釋出,屆時供需可能反轉。

- 技術端:HBM4量產時程與良率將決定美光能否在高端市場取得優勢。

- 政策端:美國CHIPS法案補貼與對華出口管制,影響美光在中國市場的競爭力。

The Motley Fool的報導指出,美光2026財年第三季資本支出預計約70億美元,全年超過250億美元,2027財年還將進一步提升。這樣的投資強度,若遇上AI需求降溫,確實可能導致現金流壓力。

但反過來看,若AI短缺持續至2027年(如IDC、Omdia等機構預測),美光的五年長約與產能擴張將使其成為最大受益者之一。Seeking Alpha的分析強調,美光在DRAM與NAND領域的供需緊平衡中具備定價能力。

對於投資者而言,美光當前的「熊市」狀態可能同時蘊含風險與機遇。關鍵在於判斷TurboQuant等演算法的實際影響,以及AI記憶體需求的真實持續性。

常見問題解答

什麼是TurboQuant演算法?它如何影響AI記憶體需求?

TurboQuant是Google Research於2026年3月發布的AI壓縮演算法,能將大型語言模型的鍵值快取記憶體使用量降低至少6倍,在H100 GPU上實現高達8倍加速,且不會造成任何準確度損失。它主要影響AI推理階段的「工作記憶體」需求,對訓練階段影響較小。市場擔心這會降低AI資料中心的記憶體採購需求,但專家認為效率提升可能反而刺激更多AI應用落地,長期推升總記憶體消費。

美光為何在股價低迷時大幅提升資本支出?

美光將2026財年資本支出從200億美元提升至250億美元以上,主要基於兩個考量:一是已簽署五年策略性協議,2026年高階記憶體訂單全數售罄;二是產業分析普遍預測AI記憶體短缺將持續至2027年,公司希望透過產能擴張搶佔HBM4等下一代技術的市場份額。管理層判斷短期的演算法衝擊不會改變長期的AI基礎設施投資趨勢。

2026-2027年全球AI記憶體市場的供需預測為何?

根據IDC、Omdia、TrendForce等機構的分析,全球AI記憶體短缺預計將持續至2027年,HBM與DRAM的供需缺口可能進一步擴大。全球AI市場規模預估將從2025年的1,850億美元成長至2027年的7,800-9,900億美元,年成長率40-55%。HBM市場預計以26.8%年複合成長率擴張,2030年達98.4億美元。三大供應商(美光、SK海力士、三星)已預售2026年HBM供給,消費電子市場面臨價格上漲壓力。

結語:在波動中尋找確定性

美光股價進入技術性熊市,反映了市場對AI記憶體需求觸頂的擔憂,TurboQuant演算法的發布成為壓垮駱駝的最後一根稻草。然而,當我們深入剖析供需數據、美光的五年長約策略,以及AI市場的兆美元規模預測,會發現「悲觀」可能過度反應。

AI記憶體需求的真實趨勢,不會因單一演算法而逆轉。TurboQuant提升的是「使用效率」,而非「總需求」;壓縮技術降低邊際成本,反而可能刺激更多AI應用落地。美光的250億美元豪賭,本質上是對「短缺紅利」的提前鎖定,以及對HBM4時代市場份額的戰略佈局。

對於投資者與產業觀察者而言,關鍵在於區分「短期波動」與「長期趨勢」。前瞻本益比4.5倍的美光,究竟是「價值陷阱」還是「佈局契機」,取決於你對AI基礎設施投資週期的判斷。而這場記憶體風暴,最終將在2026-2027年的供需博弈中找到答案。

參考資料

- Google Research: TurboQuant: Redefining AI efficiency with extreme compression

- Ars Technica: Google’s TurboQuant AI-compression algorithm can reduce LLM memory usage by 6x

- TechCrunch: Google unveils TurboQuant, a lossless AI memory compression algorithm

- Forbes: Google’s TurboQuant Compression Could Increase Demand For AI Memory

- Tom’s Hardware: Google’s TurboQuant reduces AI LLM cache memory capacity requirements

- VentureBeat: Google’s new TurboQuant algorithm speeds up AI memory 8x, cutting costs by 50%

- TrendForce: Micron Ramps FY26 Capex to $25B, Signs First 5-Year Customer Deal

- The Motley Fool: Micron (MU) Q2 2026 Earnings Call Transcript

- IDC: Global Memory Shortage Crisis: Market Analysis and the Potential Impact

- Bain & Company: AI’s Trillion-Dollar Opportunity

- CNBC: AI memory is sold out, causing an unprecedented surge in prices

- The Business Research Company: High Bandwidth Memory (HBM) Market Report 2026

- Avnet: Riding the AI Supercycle: Navigating the 2026 Memory & Storage Market

Share this content: