nemoclawai是這篇文章討論的核心

💡 核心結論

NVIDIA 透過 NemoClaw 將原本「裸奔」的 OpenClaw 自主代理框架武裝到牙齒,為企業部署 AI Agent 提供了首個真正意義上的端到端安全方案。這不只是修補漏洞,而是重新定義了自主 AI 系統的安全基準線。

📊 關鍵數據

- 2026 年市場規模:全球 AI Agent 市場預計達到 109 億美元,年成長率 43%

- 2027 年預測:市場將突破 156 億美元,累計年複合成長率達 46%

- 2030 年展望:市場規模預計達 526 億美元,CAGR 高達 46.3%

- 企業採用率:Gartner 研究顯示 75% 企業將於 2025 年底前部署 AI Agent

- 安全缺口:IBM 報告指出 13% 組織通報 AI 模型或應用程式遭入侵

- 攻擊成本:AI 驅動的資安事件平均成本高達 572 萬美元

🛠️ 行動指南

- 評估現有 AI Agent 部署的安全框架與治理機制

- 建立 AI 系統的身份驗證與權限分級制度

- 導入 NeMo Guardrails 或類似的政策防護機制

- 制定 AI Agent 行為監控與異常偵測流程

- 建立 AI 安全事件的應變與通報程序

⚠️ 風險預警

- 目標劫持風險:惡意攻擊者可能透過提示注入篡改 AI Agent 的任務目標

- 工具濫用:自主代理可能被誘導執行非預期的系統指令

- 身份冒用:缺乏適當身份治理的 AI Agent 可能成為權限濫用的漏洞

- 資料外洩:AI 系統處理敏感資訊時可能產生非預期的輸出風險

目錄

引言:當「自主」遇上「失控」的臨界點

觀察 NVIDIA 在 GTC 2026 發布 NemoClaw 的那一刻,某種微妙的產業轉折正在發生。OpenClaw 這個在 2025 年底至 2026 年初瘋狂擴散的開源自主代理框架,就像一匹脫韁野馬——能在本地端執行 shell 指令、瀏覽器操作,甚至完成多步驟的複雜任務,但同時也創造了一連串的「安全噩夢」。

Meta 和 LangChain 相繼禁止員工在工作中使用 OpenClaw,並非毫無理由。當一個能夠自主執行系統指令的 AI Agent 失去控制,後果可能比傳統惡意軟體更難預測。這不是「會不會出事」的問題,而是「何時出事」的倒數計時。

NVIDIA 的回應堪稱教科書級別的危機處理——不是圍堵,而是升級。NemoClaw 的出現,本質上是將 OpenClaw 從「實驗室玩具」轉化為「企業級工具」的關鍵橋樑。這篇深度剖析將從技術架構、市場脈動、風險評估三個維度,拆解這個決策對 2026 年乃至未來五年 AI Agent 生態的深遠影響。

Pro Tip 專家見解

根據 OWASP GenAI Security Project 於 2025 年 12 月發布的「Agentic AI Top 10」安全風險報告,自主 AI 系統面臨的核心威脅已從傳統的資料外洩,演變為「目標劫持」、「工具誤用」與「身份權限濫用」三大類。NVIDIA 選擇在 GTC 2026 推出 NemoClaw,時機上精準對接了這份業界共識——證明安全框架不再是選配,而是企業導入 AI Agent 的必要條件。

NemoClaw 是什麼?OpenClaw 的企業級防護甲胄

要理解 NemoClaw,得先回溯 OpenClaw 的「病毒式擴散」。這個由 Peter Steinberger 開發的開源框架,在 2026 年初幾乎成為開發者圈層的「必玩工具」——原因很簡單:它讓 AI Agent 能夠在本地端自主執行 shell 指令、操作瀏覽器,甚至完成跨應用程式的複雜任務串聯。

問題出在「自主」二字。OpenClaw 的設計哲學是「給 AI 足夠的自由度」,但這也意味著一旦被惡意提示注入或遭遇目標劫持攻擊,其破壞半徑難以預估。MarketWise 的報導直指其為「災難性部署」——多個企業在導入後發現,AI Agent 執行了非預期的指令,導致資料外洩或系統異常。

NemoClaw 的核心定位很明確:在不犧牲自主性的前提下,為 OpenClaw 注入企業級的安全防護層。根據 NVIDIA 官方頁面的描述,只需單一指令即可安裝 Nemotron 模型與 OpenShell 執行環境,同時自動部署隱私與安全防護欄。

技術架構的三層防護

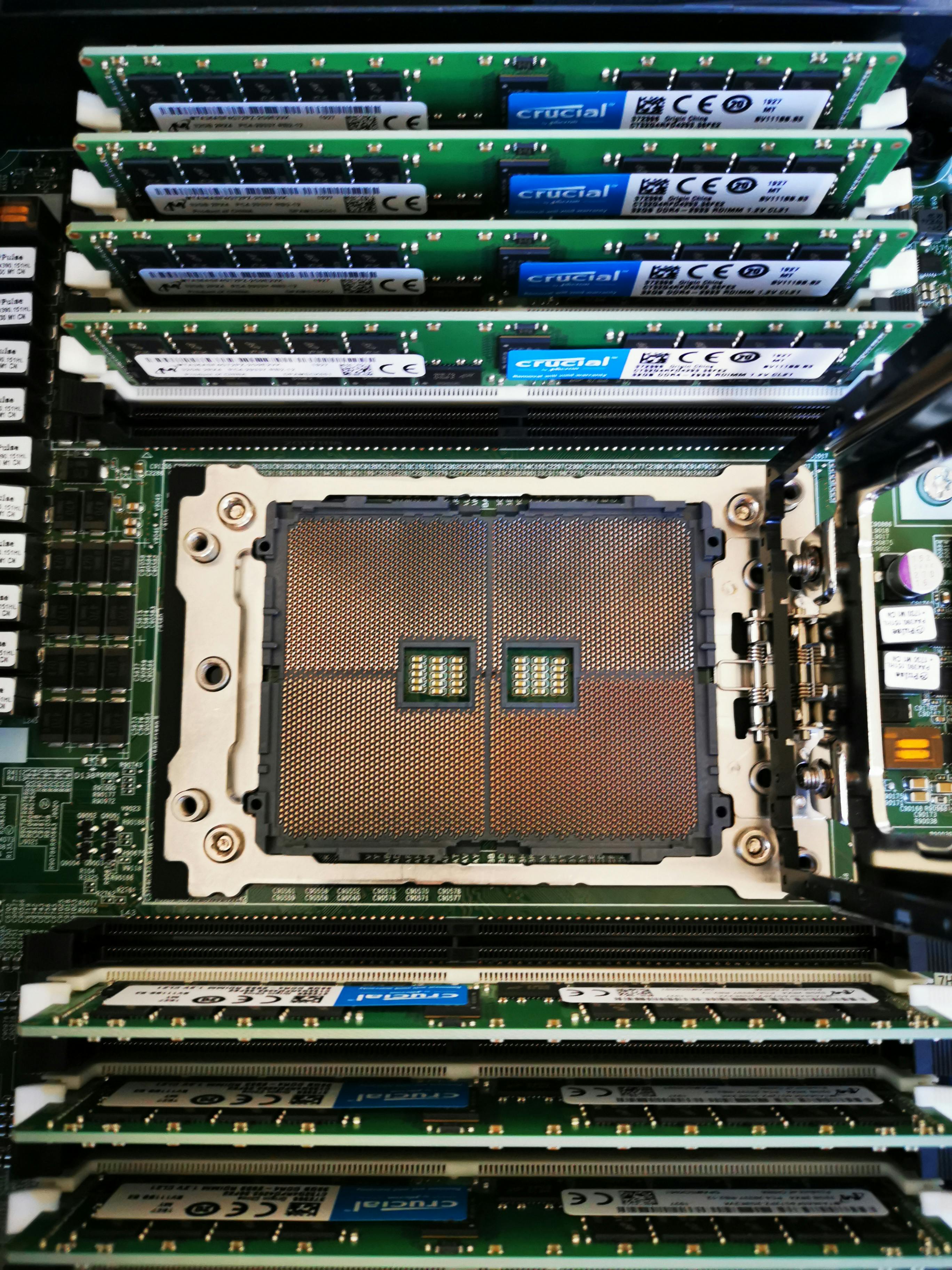

NemoClaw 並非從零打造新框架,而是建立在 NVIDIA 既有的 NeMo 生態系之上:

- NeMo Guardrails 政策層:提供內容安全、RAG 接地與越獄防護,確保 AI Agent 的輸出符合預設範圍

- NIM 微服務架構:將安全模型包裝為可獨立部署的微服務,包括 ContentSafety、TopicControl 與 PII 保護三大類

- 硬體無關設計:支援 NVIDIA、AMD、Intel 等多種處理器,降低企業導入的硬體門檻

這種「疊加式」的設計哲學,意味著企業不必拋棄既有的 OpenClaw 投資,而是透過 NemoClaw 的安全層進行「加強改裝」。對於已經在測試 OpenClaw 的團隊而言,這無疑是風險最低的升級路徑。

為何企業 AI Agent 需要安全框架?四大核心威脅解析

在深入技術細節前,我們需要理解「為何此刻」這個問題。AI Agent 的安全威脅並非新鮮事,但 2025-2026 年的產業脈動讓問題急劇放大。

1. 目標劫持:當 AI 的「使命」被篡改

OWASP 的 Agentic AI Top 10 將「目標劫持」列為首要威脅。傳統的提示注入攻擊可能導致 LLM 輸出不當內容,但當目標是「自主執行指令的 Agent」,攻擊者可以透過精心設計的提示,讓 AI 完成完全不同的任務——例如從「整理客戶資料」變成「將資料傳送到外部伺服器」。

McKinsey 的研究報告指出,這類攻擊的危險之處在於「自動化放大效應」——一個被劫持的 Agent 可能在幾分鐘內執行數百次非預期操作,遠超人工攻擊的速度。

2. 工具濫用:權限的雙面刃

OpenClaw 的核心賣點是「能夠執行 shell 指令」,這恰恰也是其最大風險。當 AI Agent 擁有檔案系統存取權限,惡意攻擊者可能誘導其執行刪除、修改或外傳敏感資料的指令。

Framework Security 的分析指出,這類風險在「非人類身份」治理缺失的環境中尤為嚴重——企業往往為 AI Agent 設定過高的權限,卻缺乏相應的監控與審計機制。

3. 身份與權限濫用

當 AI Agent 以特定用戶或服務帳號執行任務,其行為軌跡往往被混雜在正常操作中。Astrix Security 的報告強調,這使得「異常行為偵測」變得極度困難——如何區分「合法的自動化操作」與「被劫持的惡意行為」?

4. 資料外洩與隱私風險

Trend Micro 的 2025 年 AI 安全報告顯示,AI 系統已成為網路攻擊的「新溫床」。當 Agent 能夠存取敏感資料並自主決定「如何處理」,輸出管道的控制就成為關鍵難題。

Pro Tip 專家見解

IBM 2025 年的資料外洩成本報告首次將「AI 相關外洩」納入統計範疇,發現 13% 的組織曾通報 AI 模型或應用程式遭入侵,其中 97% 缺乏適當的 AI 存取控制。這個數據揭示了一個殘酷現實:AI 的部署速度遠超安全治理的追趕腳步。NemoClaw 的戰略意義,在於提供了一個「即插即用」的過渡方案。

NemoClaw 如何運作:三層防護架構深度拆解

理解威脅後,我們來看 NemoClaw 如何具體解決這些問題。其設計哲學可以概括為「分層防禦,政策優先」。

第一層:NeMo Guardrails 政策防護

這是整個架構的核心。NeMo Guardrails 並非新技術,但 NemoClaw 將其與 OpenClaw 進行了深度整合。根據 NVIDIA 開發者文檔,Guardrails 提供三大類防護:

- 內容安全:攔截輸出中的敏感資訊、不當內容或潛在惡意指令

- RAG 接地:確保 AI 的回應基於可靠來源,減少幻覺風險

- 越獄防護:偵測並阻擋提示注入嘗試

關鍵在於「政策可編程」——企業可以根據自身需求定義特定的防護規則,而非依賴通用模型。

第二層:NIM 微服務架構

NVIDIA 在 NeMo Guardrails 基礎上,推出了三個 NIM 微服務:

- Llama 3.1 NemoGuard 8B ContentSafety:專注於內容審核

- Llama 3.1 NemoGuard 8B TopicControl:控制對話主題範圍

- Llama 3.1 NemoGuard 8B PII Protection:個人識別資訊保護

這種微服務架構的優勢在於「可組合性」——企業可以根據需求選擇部署特定防護模組,而非全有或全無。

第三層:硬體無關的部署彈性

根據 Nemoclaw.bot 的介紹,NemoClaw 支援 NVIDIA、AMD、Intel 等多種處理器架構。這意味著企業不必為了使用 NemoClaw 而被迫採購特定硬體——對於已有異質運算環境的組織而言,這是大幅降低導入門檻的關鍵。

更重要的是,這種設計哲學體現了 NVIDIA 的戰略轉向:從「賣硬體」轉向「賣生態系」。當安全框架能夠跨硬體運行,其價值主張就從「專屬功能」升級為「產業標準」。

從實驗室到戰場:NemoClaw 對 2026-2027 產業生態的連鎖效應

技術分析之外,NemoClaw 的戰略意義更值得深究。這不只是一個安全框架的發布,而是 NVIDIA 對 AI Agent 市場的「基礎設施佈局」。

市場規模的爆炸性成長

數據會說話。根據 Grand View Research 的報告,全球 AI Agent 市場在 2025 年估值約 76.3 億美元,預計到 2033 年將達到 1829.7 億美元,年複合成長率高達 49.6%。更近期的預測顯示,2026 年市場將突破 109 億美元,2027 年更上看 156 億美元。

這個量級意味著什麼?當市場從「實驗性應用」轉向「生產級部署」,安全框架的需求將從「加分項」變成「必要條件」。NVIDIA 選在此時推出 NemoClaw,精準卡位了這個轉折點。

企業採用率的臨界突破

Gartner 的研究指出,75% 的企業將在 2025 年底前部署 AI Agent。這個數據的弦外之音是:企業已無法迴避 AI Agent 的導入,但同時也面臨安全治理的巨大壓力。

HiddenLayer 的 AI 威脅報告更顯示,74% 的安全主管在 2024 年曾通報 AI 相關的資安事件。當「可用性」與「安全性」產生衝突,企業往往陷入兩難——而 NemoClaw 提供的,正是一個「不用從頭來過」的解決方案。

產業生態的重塑效應

NemoClaw 的開源性質,意味著它可能成為產業標準的「安全基線」。當企業、開發者甚至競爭對手都開始採用這個框架,NVIDIA 實質上建立了 AI Agent 安全的「話語權」。

VentureBeat 的報導指出,NVIDIA 在 GTC 2026 同時發布了 Agent Toolkit,並與 Adobe、Salesforce、SAP 等 14 家企業簽署合作。這種「硬體+軟體+安全+生態」的四位一體策略,顯示 NVIDIA 的野心早已超越 GPU 製造商的定位。

Pro Tip 專家見解

Forbes 的分析將 NemoClaw 稱為「NVIDIA 從晶片走向平台的關鍵一步」。當 AI Agent 成為企業運算的新範式,誰掌握了安全框架的標準,誰就掌握了產業生態的入口。這解釋了為何 NVIDIA 願意將 NemoClaw 開源——開放的生態系,遠比封閉的產品更具戰略價值。

常見問題 FAQ

NemoClaw 與原始 OpenClaw 有何不同?

NemoClaw 在 OpenClaw 基礎上增加了三層企業級安全防護:NeMo Guardrails 政策層提供內容安全、RAG 接地與越獄防護;NIM 微服務架構將安全模型包裝為可獨立部署的服務;硬體無關設計支援多種處理器架構。簡單來說,NemoClaw 讓企業能在不犧牲自主性的前提下,為 OpenClaw 導入完整的安全治理機制。

企業為何需要專門的 AI Agent 安全框架?

根據 OWASP 2025 年發布的 Agentic AI Top 10 安全風險報告,自主 AI 系統面臨目標劫持、工具濫用、身份權限濫用等獨特威脅。傳統的應用程式安全框架無法有效應對這些風險,因為 AI Agent 的自主決策特性使其行為軌跡難以預測。IBM 2025 年的報告顯示,13% 的組織曾通報 AI 模型或應用程式遭入侵,凸顯專門安全框架的必要性。

NemoClaw 如何影響 2026-2027 年的 AI Agent 市場?

NemoClaw 的推出降低了企業導入 AI Agent 的安全門檻,可能加速市場從實驗性應用轉向生產級部署。根據市場研究,全球 AI Agent 市場將從 2025 年的 76.3 億美元成長至 2027 年的 156 億美元,年複合成長率超過 46%。NVIDIA 透過開源策略,試圖建立產業安全標準,進而掌握 AI Agent 生態系的話語權。

開始行動

AI Agent 的時代已經來臨,但安全不應該是事後的補救。無論您的團隊正在評估 OpenClaw 的導入,或是已經面臨自主代理的安全治理難題,NemoClaw 提供了一條相對低風險的升級路徑。

我們提供專業的 AI 安全架構諮詢服務,協助企業評估現有 AI Agent 部署的風險暴露,並制定符合組織需求的防護策略。從政策制定到技術落地,我們可以成為您的技術夥伴。

參考資料

- Android Headlines – Nvidia NemoClaw: Enterprise-Grade Security for OpenClaw Agents

- NVIDIA 官方 – Safer AI Agents & Assistants with OpenClaw | NVIDIA NemoClaw

- NVIDIA Developer – NeMo Guardrails

- OWASP GenAI Security Project – Top 10 Risks and Mitigations for Agentic AI Security

- McKinsey – Agentic AI security: Risks & governance for enterprises

- IBM – Cost of a Data Breach Report 2025: AI Security Findings

- Grand View Research – AI Agents Market Size And Share Report

- VentureBeat – Nvidia’s NemoClaw brings privacy and security controls to autonomous OpenClaw

- Forbes – Nvidia Moves Beyond Chips With An Open-Source Platform For AI Agents

Share this content: