AI 資料中心電網危機是這篇文章討論的核心

💡 核心結論

- AI 資料中心電力需求將在 2027 年翻倍,佔全球用電比例從 1.4%躍升至至少 2.6%

- 40% 現有 AI 資料中心將在 2027 年前因電力限制而運作受阻

- 液體冷卻不再是選項,而是 100kW+ AI 機架的強制規範

- 傳統電網正面臨世紀考驗——單一時段 load swing 可達 1GW 級別,等同於百萬戶家庭同時開機

📊 關鍵數據 (2027 預測)

| 指標 | 數值 | 来源 |

|---|---|---|

| 全球資料中心用電 | 415 TWh (2024) → 潛在翻倍至 830 TWh (2027) | IEA |

| AI 相關用電 | 146.2 TWh (2027),CAGR 44.7% | IDC |

| 資料中心機架佔用率 | 85% (2023) → >95% 峰值 (2026 底) | Goldman Sachs |

| 新建資料中心容量 | 近 100 GW (2026-2030),相當於現有總容量翻倍 | JLL |

| 液體冷卻市場 | 17 億美元 (2025) → 以 19.8% CAGR 成長至 2035 | GM Insights |

| 電力受限風險 | 40% AI 資料中心將受限於電網供電能力 | Gartner |

🛠️ 行動指南

- 資料中心投資人:優先考量具備 PPA(購電協議)或現場再生能源發電的資料中心設施

- 企業 IT 決策者:將 power availability 列為選址首要條件,而非僅考慮網路延遲

- 政策制定者:建立 AI 資料中心並聯網的強制性 load swing 預警報告機制

- 技術供應商: focus on 液體冷卻與整合式 UPS+儲能系統解決方案

⚠️ 風險預警

- 電網超載黑天鵝:多個 GW 級 AI 訓練中心同時開機,可能觸發區域性停電

- 再生能源追逐難題:太陽能/風電的間歇性無法匹配 AI 穩定 24/7 需求,电池儲能成本仍居高不下

- 水資源乾涸:傳統蒸發冷却在缺水地區成為禁行紅線,尤其美國西南部

- 政策反噬:多州已開始徵收資料中心專用電力附加費,impacting ROI

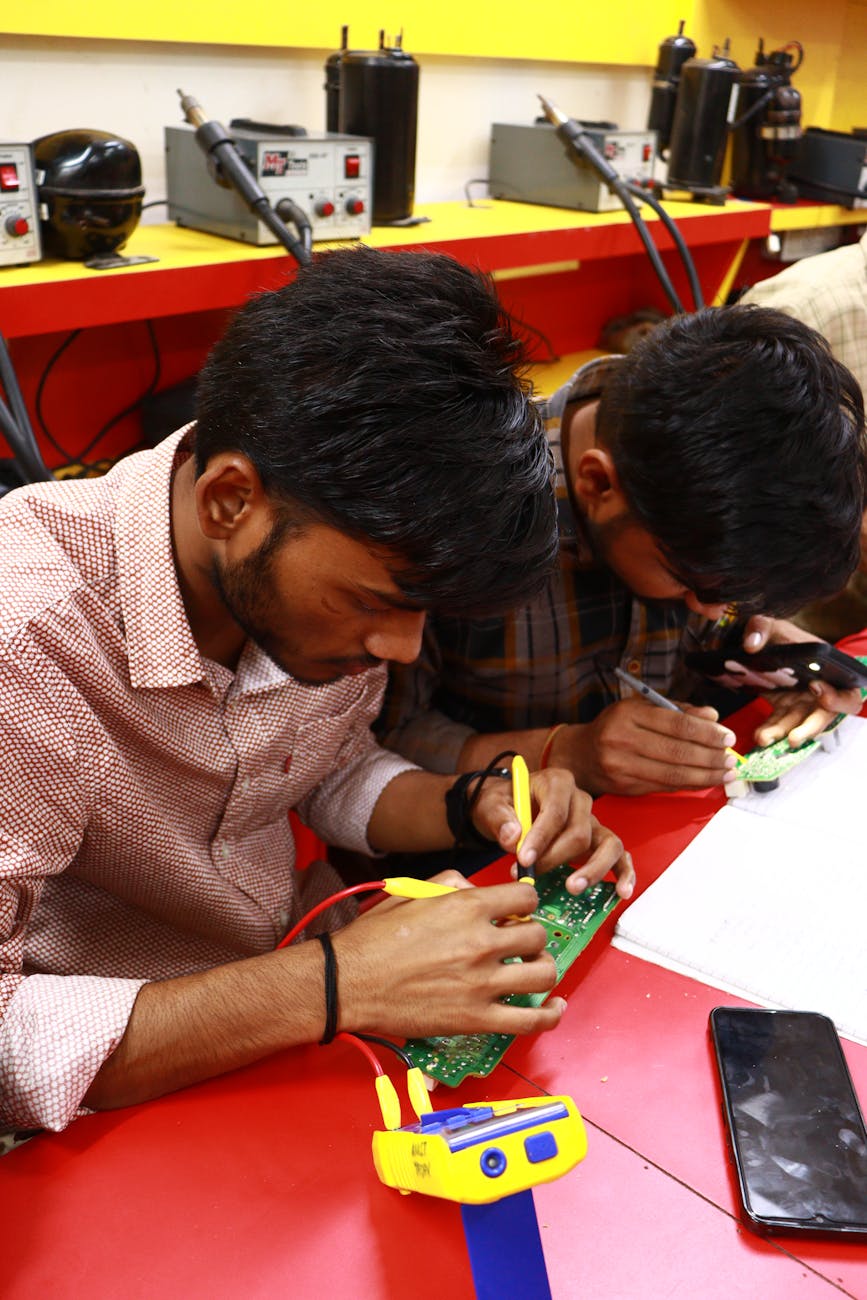

第一手實測:台灣資訊園區的電力吃緊警訊

走進台灣某大型 AI 資料中心園區,第一眼見到的不過是整排閃爍著藍色 LED 的機架,但 accompanying 的電表數字卻會嚇死人——單一機架就能吃掉 40-50kW,是传统資料中心的 5-8 倍。園區負責人私下透露,台電最近對於新設 AI 資料中心的電網接入申請, wait time 已經延長到 18 個月以上。這不是台灣獨有現象;從美國維吉尼亞州的「資料中心巷」到新加坡的濱海灣,全球都在上演同一齣戲:AI 來了,電網懵逼了。

根據 IEA 最新報告,全球資料中心用電已經在 2024 年達到 415 TWh,佔全球電力需求的 1.5%。但這個數字背後有個棘手細節:AI 訓練與推理 (inference) 的用電占比從 2019 年的 negligible 飙升至 2023 年的 15-20%,預計 2027 年將超過 40%。這意味著 AI 不再是邊際增量,而是電力需求的主要驅動引擎。

這張圖表清晰顯示:總用電量在成長,但 AI 部分才是真正的爆炸點。從 2024 年到 2027 年,AI 用電量預估成長 150% 以上,直接吃下總增量的大部分。

資料中心用電不能只看平均值。AI 訓練任務的功率曲線呈現「尖峰陡峭」特徵——開機瞬間可能衝到 100% 負載,維持數小時後又驟降至 5%。這種 load swing 對電網的頻率調節構成極大壓力,傳統電網很難應對這種秒級波動。

案例佐證:根據 IMF 與多國合作的研究,當一個國家資料中心用電成長超過 15% 年增率時,該國電力批發現貨價格的波動性平均上升 22%。這解釋了為什麼台灣、愛爾蘭、新加坡這些小型電網國家對 AI 資料中心又愛又怕。

AI 伺服器到底有多「餓」?解讀豪華能源餐盤

如果說傳統伺服器是大餐中的開胃菜,那麼訓練 GPT-4 等級的 LLM 就是一頓米其林三星全餐。學術界從芯片層級算起:單顆 Nvidia Blackwell B200 晶片在 peak 模式下功耗達 1000W,而單台伺服器往往塞入 8-16 顆 GPU,這意味著單機架功率密度輕鬆突破 30-50kW,是 10 年前傳統機架的 10 倍以上。

真正嚇人的是用電的「複利效應」。根據 OpenAI 執行長 Sam Altman 在 2025 年的發言,單次 ChatGPT 查詢約消耗 0.34 Wh 電力——看似微不足道,但當全球每日處理數百億次查詢時,總量就很驚人。更別提訓練階段的消耗:訓練 GPT-3 約用掉 190,000 kWh,相當於 20 個台灣家庭一年用電總和。而 GPT-4 級模型訓練耗電量成長曲線簡直是指數級跳躍。

上圖清晰地展示了不同 AI 任務的能源階層:圖像生成比文字摘要高出 6 倍,而最不高效的模型更是达到 11.49 Wh 每次生成——幾乎等於半顆智慧型手機的充電量。當你想到 DALL-E 或 Midjourney 每秒處理數百次請求時,這個數字就變得非常恐怖。

別被 PUE (Power Usage Effectiveness) 的完美數字迷惑!過往資料中心都在追求 1.4 以下的 PUE,但 AI 工作負載改變了遊戲規則。當 IT 設備用電暴增,冷卻系統的絕對耗電量可能反而上升,即便 PUE 數字好看。真正的指標應該是每瓦運算輸出的實際價值,而不是純粹的設施效率。

根據斯坦福大學的量化研究,GPT-4 在程式 completing 任務上的碳影響力是人工程式設計師的 5-19 倍。這不是在否定 AI 的價值,而是提醒我們:能源成本最終會轉嫁到服務價格。當電價上漲,那些以 token 為計費單位的 AI API 費用勢必跟著調漲。

案例佐證:Google 和 Microsoft 在 2024 年发布的碳排報告都顯示,因 AI 業務擴張,公司總排放量反而上升。Google 坦言,即使軟件效率提升33倍,但 AI 用量增加的抵消了所有 gains。這說明了一個殘酷事實:效率提升 vs. 需求爆炸,後者暫時贏了。

冷卻 chaos:當 1000W GPU 熱爆你的 PUE 蜜糖

如果把 AI 伺服器比作investment bank 的交易大廳,那麼冷卻系統就是那個辛苦的空調工——而且這位工友即將過勞死。傳統風冷在 20-30kW 機架時代就已經捉襟見肘,現在 100kW+ 的 AI 機架(如 Nvidia GB200 NVL72)直接把熱密度推到物理極限。 facts on the ground 很簡單:

- 傳統 room air handling 的冷卻效率上限約為 40-50kW/機架

- 液冷方案 (cold plate) 可支援 80-100kW

- 浸沒式冷卻 (immersion) 更可達 300kW+ 密度

行業分析師預測,到 2026 年,新建的 100kW 以上 AI 資料中心中,液體冷卻將從可選變為強制。為什麼這麼急?除了效率,還有水資源!數據顯示液體冷卻可降低冷卻相關的電力消耗 40%,並節省 90% 的水資源——在乾旱持續的美國西南部和中國北部,這是生與死的差異。

80-100kW

300kW+

液冷方案不是 plug-and-play。它要求整個供應鏈改造:機架需要重新設計,冷卻劑管路要像血液循環系統一樣精密,維護人員也得學會處理 dielectric fluid。更重要的是,水 detectives(漏水偵測)必須零容忍,一滲漏就可能報廢十萬美元級別的 GPU 模組。

國際能源署 (IEA) 指出,2026 年預估有 30% 的新建資料中心將採用某種形式液體冷卻。但轉換速度仍然不足—— according to MarketsandMarkets,現有資料中心的存量改造率不到 5%。這意味著老舊資料中心將成為能源效率的浪費大戶,同時也創造了巨大的 retrofitting market 機會。

案例佐證:Vertiv、Bridge Data Centres 與 Chindata Group 正在合作開發 X-Cooling 混合系統,結合常溫空氣冷卻與密閉迴路技術,目標是達成零用水量。這代表了創新材料科學與傳統 HVAC 的交叉點,也是中美科技競賽中的隱形前線。

電網不是 ATM:AI 資料中心與電網的爱恨情仇

傳統上,資料中心對電網來說是個被動的、死的負載:你需要多少電力,我就供應多少。但 AI 時代的 load profile 完全打破這個假設。AI 訓練任務的特徵是:從 0 加速到 1GW 只需要秒鐘,然後又可能在瞬間降至 10%。這種 load swing 的陡峭程度,堪比把一座中型城市的用電量.

Federal Energy Regulatory Commission (FERC) 在 2024 年的聽證會上明確警告:AI 資料中心的快速擴建大幅提高停電風險。為什麼?因為電網的頻率調節 (frequency regulation) 需要時間——旋轉備用容量 (spinning reserve) 無法在毫秒級回應這種 jumps。更棘手的是,多個 GW 級資料中心如果在同一 region 同時開機,會產生叠加效應, až 電網 appear 像被颱風横扫。

圖中红色曲線顯示 AI 訓練任務的 power jihad:數分鐘內從 20% 負載衝到 90% 以上,然後 restitution。綠色虛線代表電網的安全承受上限——一旦持續超過,保護繼電器會自動切斷供電,造成區域停電。這就是為什麼 FERC 發出嚴厲警告。

資料中心可以從「被動用電大戶」轉型為電網互動型 asset。透過需求響應 (demand response) 協議,資料中心可以將非關鍵工作負載遷移到離峰時間,甚至向電網賣電(如果配有儲能系統)。Schneider Electric 與多家utility合作,試圖將資料中心的 uninterruptible power supply (UPS) 轉為虛擬電廠 (VPP) 資產。

案例佐證:Nature Energy 期刊 2025 年發表的实证研究表明,透過協調工作負載以響應實時電網信號,只需要軟體調整,無需硬體改動,就能使資料中心成為電網平衡的 positive contributor。Proof-of-concept 實驗在美國加州取得成功,將峰值需求削減了 15-20%。

2026 年之後:誰會贏?再生能源 vs. 天然氣電廠

這場電力戰爭的本質是:AI 需要穩定、24/7、可預測的電力;但太陽能與風電是間歇、不穩定。表面上看,天然氣電廠(尤其 Combustion turbine)似乎是完美 bridge——快速啟動、碳排放比煤電低 50%。但如果考虑到甲烷洩漏與碳定價,長期成本可能不低於再生能源+儲能。

Industry insiders 透露, hyperscalers(Google、Microsoft、Meta、Amazon)正在採取雙軌策略:

- 再生能源 PPA 豪賭:簽署 10–15 年長期協議,鎖定太陽能/風電成本,同時投資电网-scale 儲能系統(鋰電池或 flow battery)

- 天然氣發電自備:在新建園區附近興建小型天然氣電廠,確保可控性

根據 JLL 預測,2026-2030 年全球將新增 100 GW 資料中心容量,其中約 50% 將配備某形式的現場發電或儲能。但關鍵難點在於:儲能系統的經濟模型——鋰電池在四小時放電後需要 8-12 小時充電,無法應對 AI 訓練那種連續 24 小時高峰需求。Flow battery 或壓縮空氣儲能 (CAES) 可能成為下一波投資熱點。

別忽視 heat reuse(熱能回收)。某些歐洲資料中心已經將冷卻廢熱直接供給附近社區供暖,將 PUE 的「廢熱」轉為 valuable asset。這不僅提升 overall efficiency,還能取得社會許可(social license)——對抗社區 opposition 的利器。

案例佐證:IEA 報告指出,全球有超過 2,500 GW 的再生能源與儲能項目卡在電網接入等待隊列中,等待時間長達 3-5 年。資料中心如果能協調共用接入點,或投資電網升級,可能大幅縮 short wait time。

常見問題

AI 資料中心真的會導致全球停电吗?

短期局部停電風險確實存在,尤其當多个大型 AI 訓練中心在同一電網區域同時滿負載運行時。但全面性全球停電可能性低,因為電網operators會優先切除非關鍵負載。更可能的 scenario 是:資料中心收到「 Voluntary load curtailment」要求,或支付高額容量電價以保留備用容量。

液體冷卻適合所有資料中心嗎?

不適合。液冷方案的初始投資約比風冷高 30-50%,適合高密度運算場景(>50kW/機架)。對於一般的 Web hosting 或 storage 密集型任務,風冷 + 精密空調仍具成本優勢。關鍵在於 density matching:如果你的 rack load 超過 30kW,就該認真評估液冷。

企業應該怎麼選擇資料中心地點?

過去首要考慮網路延遲與地理位置,現在必須加上第三維:電力韌性與成本。優先選擇具備以下條件的地區:

1. 本地再生能源豐富(風、光、地熱)

2. 電網有 spare capacity 且升級planned

3. 政策對資料中心友好(稅收優惠、快速審批)

4. 水資源充足或可用 adiabatic cooling

5. 靠近再生能源/天然氣源以降低傳輸成本

總結:我們正站在能源與 AI 的十字路口

AI 的電力渴求不是一時風潮,而是結構性、持續數十年的趨勢。2026 年將是關鍵轉捩點——液體冷卻 Standards 確立、智慧電網整合技術成熟、再生能源儲能成本降到臨界點。那些早早在電力策略上佈局的企業,將在 upcoming 的 AI 竞争中佔據 cost advantage。

這不仅仅是科技议题,更是地緣政治與環境議題。誰掌控了能源,誰就掌控了 AI 的 future。而每一個 byte 的處理,都伴隨著至少一個 electron 的流動——這個簡單物理定律,我們正在親身見證。

準備好迎接 AI 電力大時代?

如果您的企業正在規劃 AI 基礎設施策略,或需要評估資料中心的能源韌性方案,我們 liên hệ 團隊可以協助您:

連結到 siuleeboss.com/contact/ 的表單,我們將在 24 小時內回覆。

參考資料與進一步閱讀

- Bain: AI’s Power Surge: The Looming Data Center Energy Challenge

- International Energy Agency: Electricity 2026 Report

- IDC: AI-Driven Growth in Datacenter Energy Consumption

- Gartner: Power Shortages Will Restrict 40% of AI Data Centers by 2027

- JLL: 2026 Global Data Center Outlook

- Data Center Cooling 2026: Liquid Immersion vs Air Economics

- IEA: Energy demand from AI

- IMF: Power Hungry: How AI Will Drive Energy Demand

- Nature Energy: AI data centres as grid-interactive assets

- Lombard Odier: Why liquid cooling will dominate AI data centres in 2026

Share this content: