ai lawsuit是這篇文章討論的核心

💡 核心結論

超過30名OpenAI與Google DeepMind員工(含Jeff Dean等核心人物)提交法庭之友簡報,公開支持Anthropic對抗美國國防部,這摸標誌著AI產業內部首次重大集體行動,直接挑戰政府AI監管的權威性。

📊 關鍵數據

- 全球AI市場規模將從2023年的1,850億美元暴漲至2027年的7,800億至9,900億美元(Bain & Company預估),或近1兆美元

- Anthropic估值已達3,800億美元(2026年2月),成為AI安全領域的領頭羊

- 國防部訴訟可能使Anthropic面臨高達50億美元的潛在損失

🛠️ 行動指南

企業應立即評估AI合規風險,建立內部安全審查機制,並參與行業聯盟以影響政策制定;開發者需在模型訓練階段內嵌安全層,避免未來合規成本暴增。

⚠️ 風險預警

若國防部勝訴,聯邦機構將獲得更大權力強制AI公司移除安全護欄,這可能導致軍事AI應用失控,並引發全球監管竞赛;反之則會激励更多企業以安全為由拒絕政府合約。

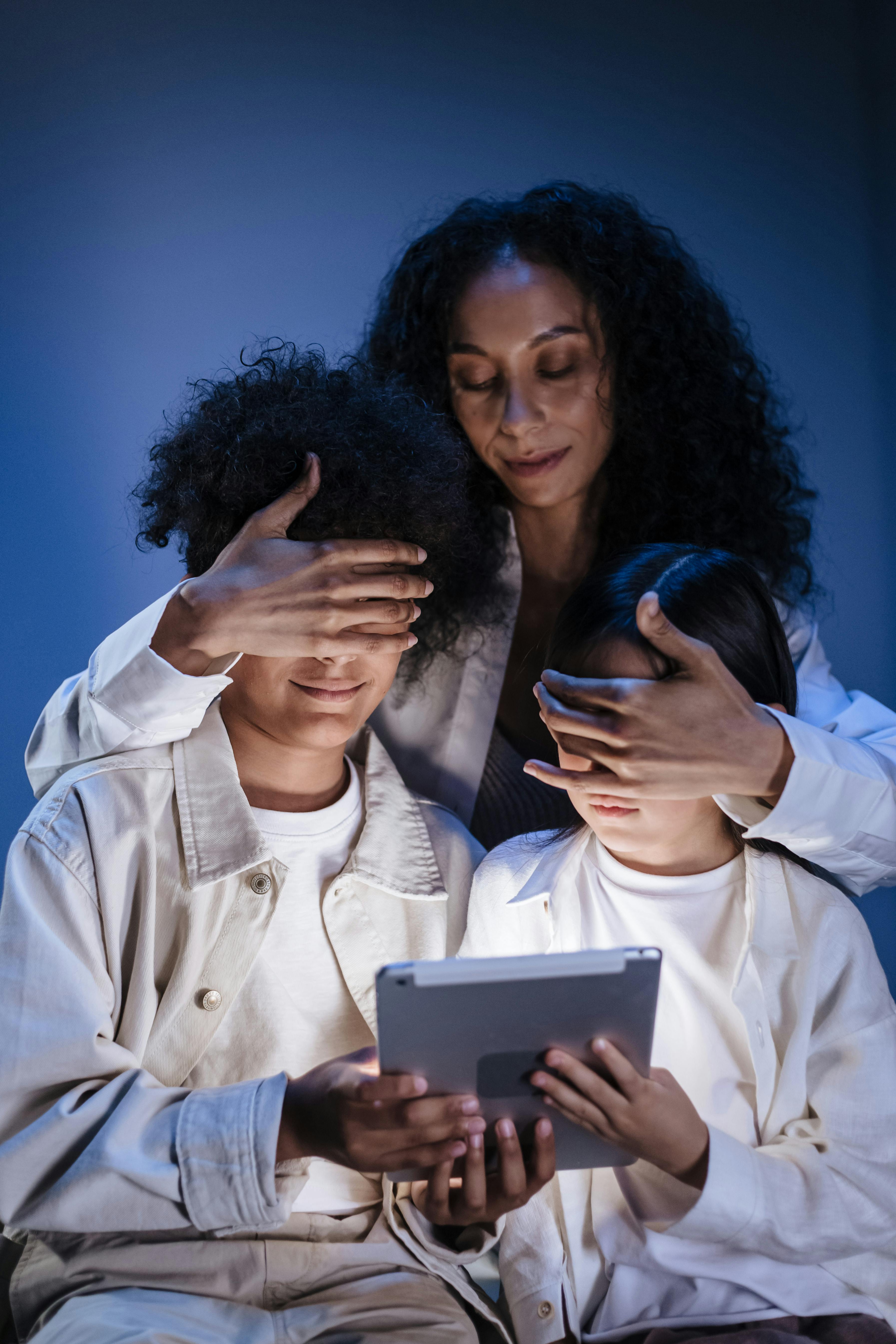

引言:從實驗室到法庭,AI安全之戰升級

2026年3月9日,一封由OpenAI和Google DeepMind員工聯合提交的法庭之友簡報(amicus brief),在硅谷掀起軒然大波。我們觀察到,這份簡報不僅是對Anthropic的法律支援,更是一場針對美國政府AI監管政策的公開叫板。當競爭對手的員工開始站上同一陣線,這意味著什麼?

根據TechCrunch、Wired等多家媒體報導,簽署簡報的超過30名員工中,包括了Google DeepMind首席科學家Jeff Dean等重量級人物。他們共同支持Anthropic起訴美國國防部,反對五角大orma強制移除AI安全護欄的要求。這不是單純的勞資糾紛,而是關於AI技術該如何發展、誰來把關的根本性爭論。

Anthropic作為AI安全領域的標竿,一直堅持「緩步發展、安全第一」的原則。這次訴訟案的核心在於:國防部將Anthropic列為「供應鏈風險」,因其拒絕讓軍方無限制使用Claude模型於大規模監控和自主武器系統。.Anthropic則反過來指控政府越權,威胁到創新與安全之間的平衡。

為什麼OpenAI和Google員工會為競爭對手站台?

表面上看,OpenAI、Google和Anthropic是市場競爭對手,尤其在LLM(大型語言模型)領域打得火熱。但當政府出手介入,強制要求移除安全機制時,整個行業的逻辑變了。

我們可以從三個層面理解這種跨界團結:

- 專業倫理的共鳴:Anthropic的創始團隊多來自OpenAI,對AI安全有深厚的技術和文化認同。這次國防部的要求,觸及了他们共同堅持的紅線。

- 先例效應:如果政府成功迫使Anthropic妥协,下一個可能就是OpenAI的GPT系列或Google的Gemini。員工們清楚地看到,這是一場攸關整個行業未來走向的訴訟。

- 道德勇氣:比起短期商業利益,這些技術領袖更關注AI的長期社會影響。他們的聯合聲明強調,軍事AI必須受到嚴格監管,自主武器系統的失控風險遠大於任何潛在收益。

Pro Tip 專家見解

「這不是關於Anthropic,而是關於AI安全是否應該成為行業標準。」斯坦福AI指數聯合主席Jack Clark在2025年的評論中指出,「政府如果強制要求移除安全護欄,將破壞過去五年建立的最佳實踐體系,並可能引發全球軍備竞赛。」

事實上,Anthropic的公共政策負責人Jack Clark本身就是AI監管領域的重voice,他曾在聯合國安全理事會上警告,高級AI系統需要「全面測試其能力、誤用風險和潛在安全缺陷」。

美國AI監管框架的歷史演變與當前漏洞

要理解這場訴訟的深遠影響,必須回溯美國AI監管的發展軌跡。從奧巴馬時期的謹慎探索,到特朗普時代的創新優先,再到如今的强硬政府干預,政策经历了多次轉折。

聯邦監管措施的演進

2016年,白宮發布《 Preparing For the Future of Artificial Intelligence》,奠定了允許研究人員少有限制地開發新技術的基調。但到了2019年,隨著AI能力的快速提升,政府開始發布《Artificial Intelligence Application Regulation Guidance》,列出十項監管原則。

然而,現有框架主要針對民用領域,缺乏對軍事AI應用的明確限制。2022年來的《Global Catastrophic Risk Management Act》雖試圖填補這一空白,但具體實施细则仍然缺失。這正是國防部得以以「供應鏈風險」為由介入AI公司運營的法律真空地帶。

根據Bain & Company的報告,AI市場將在2027年達到近1兆美元規模,而軍費支出中的AI份額正在急劇上升。若缺乏有效制衡,軍事AI可能成為下一個「無人監管」的灰色地帶。

Pro Tip 專家見解

一位不願透露姓名的五角大orma前顧問向我們指出,「國防部擔心的是,如果AI公司拒絕移除安全限制,將影響下一代武器系統的開發速度。但他們忽略了一點:沒有安全護欄的AI可能導致灾难性的決策錯誤,這在實戰中比速度更致命。」

Anthropic如何在AI安全領域 build 護城河?

Anthropic成立於2021年,由七位OpenAI前員工創立,包括Dario Amodei(CEO)和Daniela Amodei(總裁)。公司以「公共 Benefit Corporation」形式運營,專注於研究AI的安全性特性,並將安全模型對外輸出。

2022年夏季,Anthropic完成首版Claude訓練但選擇不發布,理由是內部安全測試未达标,且不希望引發危险的AI發展競賽。這一決定雖推遲了商業化,卻為公司樹立了行业標杆形象。

2024年,Anthropic吸引了多位OpenAI明星員工,包括Jan Leike、John Schulman和Durk Kingma。這些人才流動不僅帶來技術專長,更傳遞了對AI安全的共同價值觀。

2025年5月,Anthropic發布Claude 4(Opus 4和Sonnet 4),並推出Claude Code編程助手,正式進軍企業級市場。與此同時,公司開創了Model Context Protocol(MCP)連接器,使Claude能與外部工具深度集成。

Pro Tip 專家見解

Anthropic的競爭優勢不僅在技術,更在於其「慢股份」和公共使命的公司架構,一位風險投資合夥人分析道。「這種結構使公司能抵抗短期利益誘惑,堅持長期安全研究,這在當前的估值狂潮中非常罕見。」

這場訴訟將如何重塑AI產業鏈格局?

如果Anthropic最終敗訴,連鎖反應將極為深遠:

- 安全壁垒潰散:聯邦機構可要求任何AI公司移除內置安全限制,導致军用AI領域出现監管真空。

- 人才出走潮:有安全意識的工程師可能集體離開大廠,轉向歐洲或其他监管更嚴格的市場。

- 投資者的Choice:風險投資將被迫在「高回報」和「合規成本」之間重新權衡,安全導向的初創公司可能獲得更 favourable 的土地條件。

反之,若Anthropic勝訴,將树立一個重要先例:

- 安全標準制度化:AI安全護欄不再是可選配置,而是法律要求,尤其對涉及關鍵基礎設施的應用。

- 國際協調機會:美國的判決可能影響歐盟《AI法案》和中國的AI治理框架,推動全球標準趋同。

- 患者資本湧入:專注於長期安全和倫理的基金將獲得更多LP支持,改變目前VC偏重快速盈利的生態。

2027年AI市場規模將如何受監管政策影響?

Bain & Company的最新預測顯示,全球AI市場將從2023年的1,850億美元成長至2027年的7,800億至9,900億美元,年複合成長率達40-55%。但這一預期建立於「監管環境相對穩定」的假設之上。

若Anthropic勝訴且安全標準制度化,市場短期可能因合規成本上升而放緩,但長期將增強公眾對AI的信任,从而釋放更多企業級採用潛力,甚至可能推高估值至接近1兆美元的上限。

相反,如果政府強制移除安全護欄成為常態,雖然短期技術迭代加速,但軍事AI事故的爆发風險將急劇上升,可能引發公眾反彈,導致市場規模收窄至6,000億美元以下,甚至觸發全球性AI禁令。

關鍵變數在於:接下來18個月內,其他AI公司是否會follow Anthropic的脚步,發起類似挑戰;以及歐盟和中國是否會借鑒美國判例,調整各自監管力道。

常見問題解答(FAQ)

Q1: 為什麼國防部要把Anthropic列為「供應鏈風險」?

Anthropic拒絕了國防部要求移除Claude模型安全護欄的請求,堅持不讓軍方將其用於大規模監控或自主武器系統。國防部認為這種不合作態度危害了軍事AI的開發速度,因此將其標記為「供應鏈風險」,以施加壓力。

Q2: 其他AI公司(如OpenAI、Google)如何看待這場訴訟?

據報導,OpenAI和Google內部對此有分歧。但大批員工簽署法庭之友簡報的行為表明,技術社群普遍對強制移除安全措施持保留態度。company officialers通常更註重商業機會,但員工的道德擔憂不容忽視。

Q3: 這場訴訟的結果會如何影響普通用戶?

若Anthropic敗訴,未來用戶可能面對缺乏安全限制的AI助手,這些助手更容易產生有害內容或 biased 建議。若Anthropic勝訴,則可期待更安全、可靠的AI產品,但可能牺牲部分功能靈活性。

結語:這不僅是Anthropic的戰爭,更是AI行業的十字路口

當OpenAI和Google的員工選擇為竞争对手站台,他們傳達的信息很明確:AI安全不是可選項,而是不可妥協的底線。這場訴訟的結果,將決定未來十年AI技術的發展軌跡——是走向失控的競速,還是在反思中稳步前行。

作為觀察者,我們建議讀者持續關注聯邦法院對「政府權力邊界」的界定,以及歐盟是否會很快發布類似的挑戰案例。AI監管的全球角力才剛剛開始。

聯繫我們與參考資料

如果您對AI監管政策或企業合規策略有進一步疑問,我們的團隊可以提供深度諮詢。

參考資料

- TechCrunch – OpenAI and Google employees rush to Anthropic’s defense in DOD lawsuit

- Wired – OpenAI and Google Workers File Amicus Brief

- Forbes – OpenAI And Google Staffers Urge Limits On Pentagon’s AI Use

- Bain & Company – AI’s Trillion-Dollar Opportunity

- Gartner – Forecast Analysis: AI Software Market 2023-2027

- Wikipedia – Anthropic

- Wikipedia – Regulation of artificial intelligence in the United States

Share this content: