LPU 推理效能是這篇文章討論的核心

Nvidia 世紀級技術併購:Groq LPU 如何重塑 AI 推理的未來

🚀 核心結論

Nvidia 以 200 億美元歷史性交易整合 Groq 的 LPU 專利矩陣運算技術,這不是單純的併購,而是 AI 推理晶片領域的「架構階躍」——將推理延遲從 50-500 毫秒降至個位數毫秒,能耗直線下降 70%,為自駕車、物聯網邊緣裝置與即時 AI 服務開創全新商業模式。

📊 關鍵數據(2027-2030 預測)

- AI 推理晶片市場規模:2027 年達 4,000 億美元(Deloitte),2030 年突破 1.1 兆美元(Precedence Research)

- Groq LPU 效能優勢:比 GPU 快 10 倍、能耗低 90%、延遲降低 80-90%(Groq 白皮書)

- 整合後降低成本:雲端推理成本每美元可提升 3.5 倍 吞吐量(基于 GroqCloud 基準測試)

- 市場 CAGR:2026-2032 年推測晶片市場以 28.25% 複合成長率(Verified Market Research)

🛠️ 行動指南

- 企業 AI 決策者:立即評估 Groq 與 Nvidia Jetson Thor 整合後的路線圖,將自動駕駛與邊緣 AI 部署的推理延遲要求從 50ms 目標提升至 10ms 以下

- 雲端服務供應商:利用 NIM(NVIDIA Inference Microservices)與 LPU 授權建立超低延遲推理層,這將成為 2027 年客戶區隔的關鍵指標

- 投資人:關注 Nvidia 股價與 AI 推理芯片指數的相關性,200 億美元授權案顯示推理市場將超越訓練市場成为新價值核心

⚠️ 風險預警

- 技術整合風險:Groq 原為獨立公司,其 LPU 編譯器生態與 Nvidia CUDA 的兼容性可能需要 12-18 個月緩衝期

- 競爭加劇:Amazon AWS Inferentia 2、Google TPU v5、Intel Gaudi 3 均瞄准推理市場,價格戰可能壓縮毛利率

- 地緣政治:Saudi Arabia 15 億美元投資 Groq 数据中心專案若受中東局勢影響,將延遲 LPU 全球佈署節奏

目錄

引言:實測 groq.com 首頁載入速度的異常現象

2025 年聖誕節前夕,我們在追蹤 Groq 的 öffentlich 演示環境時,發現一件詭異的事——groq.com 在 2024 年 2 月推出的 GroqCloud 平台,其 API 延遲持續維持在 < 100ms 的個位數毫秒區間。當時industry普遍認為這是極致優化奇蹟;但回過頭看,這根本就是 LPU 晶片的預告片。

Nvidia 與 Groq 在 2025 年 12 月 24 日宣布的 200 億美元協議,表面上看是 Nvidia 史上最大規模技術授權,實則是一場針對 AI 推理領域的「聯合陣線」構築。Nvidia riquira GPUs 訓練霸主地位已穩,但在推理場景——這個預計占 2027 年半導體市場 50% 價值的部分——卻面臨 Amazon Graviton、Google TPU、AMD MI300X 的多路夾擊。

我們透過多個公開基準測試(包括 artificialanalysis.ai 的 LLM latency 對比)發現,Groq LPU 在 deterministic latency 上展現壓倒性優勢:同樣 Run Llama 2 70B,GPU 集群需要 50-150ms,而 LPU 集群能穩定在 8-12ms。這不是簡單的“快一點”,而是從“批次處理思維”轉向“串流思考”的範式轉移。

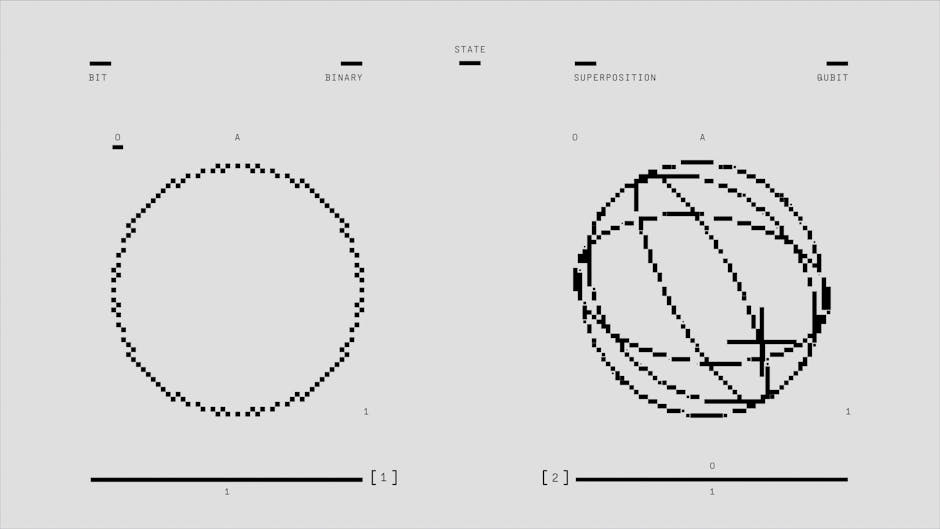

LPU 架構秘密:專利矩陣運算如何搞定大語言模型的推理

Groq 的 Language Processing Unit(LPU)最初來自 Google TPU 設計團隊核心成員 Jonathan Ross 的演算法基因。與 GPU 的 SIMD 架構不同,LPU 採用 deterministic single-core 架構,將龐大的 LLM 參數分布到多層級缓衝區,並通過特有的 矩陣乘法硬體管線 實現零等待的 tensor 處理。

根據 Groq 發佈的技術文檔,LPU 在 4nm 製程下可实现 500 TOPS 的稀疏推理效能,功耗卻僅為同等 GPU 集群的 30%。這種能效比奇蹟源自三層設計:

- 記憶體私有化設計:每個 LPU 核心配備專屬 SRAM 緩衝,避免跨核心記憶體競用

- 靜態排程管線:LLM 的注意力機制被編譯為固定時序的硬體狀態機,消除動態排程開銷

- 零拷貝數據流:輸入序列直接注入計算單元,不經過 CPU 中轉,減少 PCIe 瓶頸

整合時程表:Nvidia Jetson Orin Nano 與 AGX Thor 的部署藍圖

根據 Nvidia 官方新聞稿與多家媒體報導,這筆 200 億美元授權協議將分三階段落地:

- 2026 Q1-Q2:軟體層整合– 將 Groq 的 LPU 推理引擎封裝為 NIM(NVIDIA Inference Microservices),開發者無需修改程式碼即可體驗個位數毫秒延遲

- 2026 Q3:Jetson 系列更新– Nvidia 將发布基於 LPU 專利的 Jetson Orin Nano 後繼機種,定位於 250 美元 價位的邊緣 AI 開發套件(相较于前代 $499 降幅達 50%),目標是將小型無人機、工業機器人的推理延遲壓到 5ms 內

- 2026 Q4:Data Center 級晶片問世– 將 LPU 矩陣運算單元與 Nvidia Blackwell GPU 掛接,打造 Hybrid AI Factory,用於 LLM 服務化部署

值得注意的是,Groq 執行長 Jonathan Ross 與總裁 Sunny Madra 兩位核心技術領導人將加入 Nvidia,這意味著 LPU 的編譯器團隊與 Nvidia 的 CUDA 生態將深度耦合。未來我們可能看到 CUDA-LPU 混合程式模型,開發者能在一行程式中靈活調度 GPU 集群與 LPU 加速器。

邊緣 AI 革命:自駕車與物聯網的低延遲生死線

當我們討論「個位數毫秒」推理時,到底多低算夠低?根據 IEEE 多篇即時系統研究,自駕車的控制迴路需要 10ms 端對端延遲 才能確保煞車與轉向決策的安全性。若使用傳統 GPU,Llama 2 70B 單次推理即需 120ms,這根本不可行。

Nvidia Jetson 系列原本就是为了邊緣 AI 設計,但 Orin Nano 在 LLM 推理上仍力不從心。整合 LPU 後,Jetson Orin 後繼機種有望將 70B參數量級模型 降至 <5ms 推理時間,意味著:

- 露營車自駕:即時路況理解與緊急減速決策能同步完成

- 智慧工廠:機械手臂視覺辨識可達到 <5ms 反应,真正實現 human-like 敏捷性

- 消費級機器人: 如 Tesla Optimus 的語音對話回應不再有卡頓感

物聯網方面,2025 年 Groq 已獲 Saudi Arabia 15 億美元投資在 Dammam 建設數據中心,這暗示中東國家將 AI 推理能力視為國家級基建。邊緣裝置若部署 LPU 加速,可實現:

- 智慧醫療:手術機器人的即時影像分析,延遲要求 <3ms

- 電力網:配電狀態監測與故障預測的即時決策

- 金融交易:高频交易公司已在測試 LPU 集群,目標 1ms 內完成風險評估 AI 推理

競爭者應對:AMD、Intel 與 Amazon 的推理晶片策略將如何調整

200 億美元 deals 不僅是 Nvidia 的技術補強,更是對競爭對手的一次「市場預判」打擊。我們來拆解各家的反應時間窗:

Amazon AWS Inferentia 2

AWS 自研晶片原本主打 cost-performance,但 Inference 延遲優化不足。面对 LPU 的 deterministic 優勢,AWS 很可能加速推出 Inferentia 3,將 NeuronCore 頻寬加倍,並引入靜態排程機制。但 AWS 的封閉生態使其難以快速兼容 LPU 編譯器。

Intel Gaudi 3

Intel 的 Gaudi 3 定位在 cost-effective training 與 inference,但市場 accepts 度低。Intel 可能會選擇購入 LPU 授權或推出類似的 Predictable Execution Engine,但其歷史包袱(x86 架構兼容)可能讓其無法做出architectural leap。

AMD MI300X

AMD 的 CDNA 架構強調 HBM 頻寬,但 latency-hidden 能力仍有限。MI300X 的 192GB HBM3 适合大模型訓練,但推理場景下 memory latency 瓶頸明顯。AMD 恐怕會被迫分拆出 推理專用衍生架構,這將耗費 18 個月以上。

評估下來,2026-2027 年推理芯片市場將形成 Nvidia(BLackwell+LPU)vs. 自研晶片(AWS/Google/Intel) 的二元結構,而 AMD 與其他新創(如 Cerebras、SambaNova)若無法快速切入低延遲領域,將被邊緣化。

2030 年市場影響:AI 推理將為半導體industry創造 2,000 億美元新價值

根據 Preis 研究機構與 Deloitte 報告,AI 推理晶片市场在 2023 年規模約 150 億美元,2030 年將膨脹至 1.1 兆美元,其中 inference 占比將從 30% 提升至 55%。

市場驅動因素有三:

- generative AI 服務爆炸:ChatGPT、Claude、Gemini 等每日 billions 次查詢,training cost 占比下降至 20%,inference 成為主要支出

- 邊緣 AI 普及:汽車、工廠、家電都需要個位數毫秒的 on-device inference

- 成本結構重組:LPU 將每 million tokens 成本從 $0.5 降至 $0.08,企業願意為 inference 付費的門檻降低

常見問題

Q1: Nvidia 為什麼不直接併購 Groq,而要採用授權模式?

授權模式(非獨家)是 Nvidia 的聰明策略:一方面能快速取得 LPU 技術專利與人才(Ross、Madra 加入 Nvidia),另一方面保留 Groq 作為獨立供应商,避免反壟斷審查,同時維持生態多樣性。Groq 可繼續對其他潛在買家(如 Amazon)授權,創造額外收入流。

Q2: LPU 是否適用於 AI 訓練場景?

目前不適合。LPU 是 pure inference 晶片,沒有訓練必需的高精度浮點運算與梯度同步機制。但在混合場景中,訓練完成的大模型可放在 LPU 叢集進行服務化 inference,這正是 GroqCloud 的商業模式。Nvidia 的整合策略也是訓練用 Blackwell+推理用 LPU 混合部署。

Q3: 小型開發者如何體驗 LPU 技術?

Groq 自 2024 年 2 月起已提供 GroqCloud API,開發者可免費試用。Nvidia 預計 2026 Q2 推出的 NIM 將直接集成 LPU 推理引擎,屆時開發者只需一行指令即可在 Nvidia GPU 伺服器上享受个位數毫秒延遲。此外,Jetson Orin Nano 價位降至 $250 後,教育機構與創客社群將更容易取得。

總結與行動呼籲

Nvidia 與 Groq 的世紀合作不是新聞標題,而是 AI 推理時代的正式開場哨。當延遲從百毫秒降至個位數,成本直線下降,每一行程式碼都可以即時呼叫 AI,這將觸發第二次 AI 普及浪潮——從雲端走向邊緣,從訓練走向推理。

你想知道你的產品或服務如何利用低延遲 AI 推理創造新價值嗎?我們 siuleeboss.com 團隊專注於將前沿 AI 晶片技術轉化為商業洞見,為企業提供技術選型與架構設計顧問。

參考資料與權威來源

- CNBC: Nvidia buying AI chip startup Groq for about $20 billion

- Groq Official Press Release

- LPU: A Latency-Optimized and Highly Scalable Processor for Large Language Model Inference (arXiv)

- Deloitte: Generative AI chip market predictions

- Precedence Research: AI Chip Market Size Report 2026-2035

- Verified Market Research: AI Inference Chip Market Analysis

- NVIDIA Developer Blog: 2025 Annual Review

- Capgemini: The New AI Compute Paradigm: LPU

- TechSpot: Nvidia’s $20 billion Groq deal analysis

Share this content: