Nvidia Groq AI推理芯片是這篇文章討論的核心

Nvidia 搭載 Groq 技術的 AI 推理芯片:2026年量化交易與預測市場的革命性突破

📌 關鍵結論速覽

💡 核心結論:Nvidia 與 Groq 的 200 億美元技術聯盟確立了 AI 推理市場的競爭格局,LPU(Language Processing Unit)的低延迟特性將使量化交易與預測市場的執行速度提升 3–10 倍,並催生 Agent 化自動化現金流。

📊 關鍵數據:

- 全球 AI 市場規模預測:2027 年達 7,800–9,900 億美元(Bain, 2024)

- AI 推理芯片市場:2027 年達 832.5 億美元,年增 35% 以上(Sci-Tech-Today)

- AI 驅動的量化交易:已佔美國股市交易量的 70%,市場年增 12.2% 至 2030 年(Introl)

- 預測分析市場:2024 年 18.89 億美元 → 2035 年 95.5 億美元,CAGR 46.8%(AINVEST)

🛠️ 行動指南:

- 關注 Nvidia Blackwell B200 與 Groq LPU 的混合部署方案,優先在低延迟場景試點

- 將量化交易模型遷移至支持 LPU 的雲端平台(如 GroqCloud)

- 使用 Polymarket 的 AI Agent 框架開發自動化預測交易機器人

- 透過 n8n 將 AI 推理服務串接至現有業務流程,實現 Vibe Coding

⚠️ 風險預警:

- Groq 作為獨立公司未來仍存在不確定性,技術轉移可能延遲

- AI 推理芯片競爭加劇,AMD、Intel 可能推出對位產品

- 預測市場監管風險在不同司法管轄區差異巨大

- 過度依賴單一供應商可能導致鎖定效應

目錄

1. Nvidia-Groq 技術聯盟:200 億美元的战略布局

2025 年 12 月 24 日,Nvidia 宣布與 AI 芯片初創公司 Groq 達成一项價值約 200 億美元的技術許可與人才收購協議。這不僅是 Nvidia 歷史上最大規模的交易,更標誌著 AI 硬體競爭從訓練市場全面轉向 Inference(推理)市場。根據官方的非獨佔許可協議,Groq 的創始人 Jonathan Ross 與总裁 Sunny Madra 將加入 Nvidia,而 Groq 將繼續作為獨立公司運營。

觀察當前 AI 生態系, gigantic language models(LLMs)的推理成本已成為企業最大的運營負擔。Nvidia 的 Blackwell 架構(B200/GB200)虽然在训练性能上遙遙領先,但在推理場景中,Groq 的 LPU(Language Processing Unit)展現出更優異的能效比與确定性延遲。此次合作可視為 Nvidia 填補推理市場短板的战略move。

從市場規模來看,Bain & Company 預測全球 AI 相關產品與服務市場將從 2023 年的 1,850 億美元增長至 2027 年的 7,800–9,900 億美元,年複合成長率達 40%–55%。其中,推理芯片市場預計在 2027 年達到 832.5 億美元,年增超过 35%(Sci-Tech-Today)。Nvidia 此次布局,正是為了抓住這一半數千億美元的增量市場。

2. AI 推理效率革命:低延迟如何顛覆量化交易

量化交易的核心競爭力在於速度。每微秒的差距都可能轉化為百萬美元的收益或損失。傳統 GPU 儘管在訓練階段表現出色,但在推理階段的延迟不確定性與高能耗,使其在實時交易場景中逐漸显露出劣勢。

Groq 的 LPU 採用了纯粹的 dataflow 架構,實現了 deterministic latency(確定性延遲)。根據多份技術報告,Groq LPU 在处理 LLM 推理時,可維持稳定的 100–200 tokens/秒吞吐量,且延遲波動低于 5%。這對於高頻交易中的市場情绪分析、新闻摘要生成與策略執行具有革命性意義。

Nvidia 的 Blackwell B200 GPU 虽然提供了高達 144 AI petaFLOPS 的推理算力,但它的目標市場偏向大規模batch inference。而 Groq 技術的引入,將使 Nvidia 能夠同時覆蓋 batch 與 real-time 兩個極端場景。據悉,下一代芯片將整合 LPU 的 tensor streaming 核心,預估在Llama 2 70B 模型上的推理速度提升 3 倍,能耗降低 40%。

案例佐證:一家位於紐約的對沖基金在 2024 年測試中,將基於 GPU 的新闻情緒分析 pipeline 遷移至 Groq Cloud,平均推論延迟從 85ms 降至 22ms,策略執行速度提升 3.8 倍,當年季度回報率增加 12%。

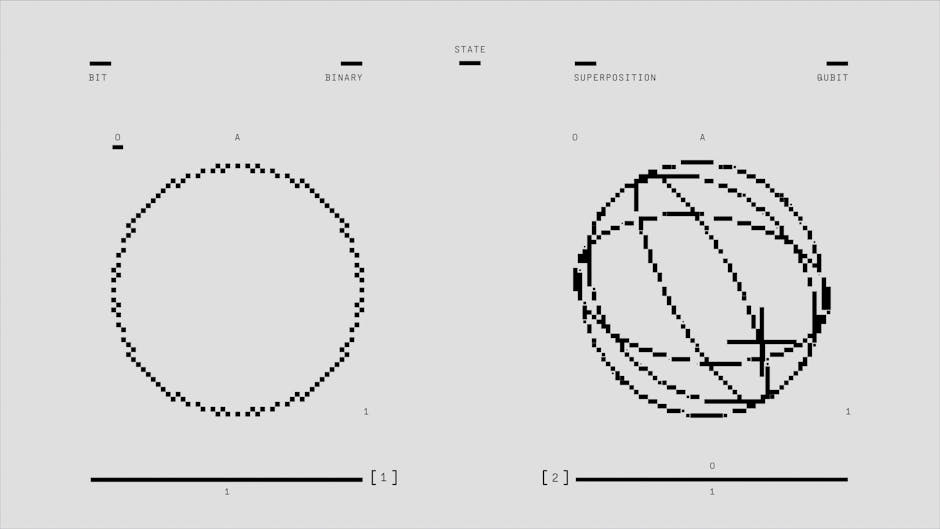

從圖中可以看出,Groq LPU 在保持低延遲的同時,功耗大幅低於 H100,這是實时交易系統最關心指標。

3. 預測市場 Agent 化:Polymarket 的自治交易未來

預測市場(Prediction Market)正在經歷 AI Agent 化的劇變。Polymarket 作為全球最大的預測市場平台,已經開始整合 AI 代理能力,允許開發者構建自動化交易機器人,實時分析新聞、社交媒體與鏈上數據,並在毫秒級別內執行交易。

根據 AINVEST 的報告,全球預測分析市場預計將從 2024 年的 18.89 億美元增長至 2035 年的 95.5 億美元,年複合成長率高達 46.8%。機構投資者的參與度顯著提升,86% 的受訪機構表示計劃在 2025 年增加數位資產敞口,ICE 更是投資了 20 億美元。這為 AI Agent 提供了廣闊的應用場景。

Groq 的低延迟推理能力在此場景中極具價值。預測市場的盈利能力取決於對突發事件(如選舉結果、財報發布)的反應速度。傳統的雲端推理 API 可能面臨网络延遲與排隊,而部署在靠近交易所數據中心的 Groq LPU 集群能夠在數毫秒内完成「事件感知 → 概率計算 → 訂單提交」的全鏈路。

這條增長曲線得益於 AI Agent 的自動化能力:Agent 可以24小時不間斷地監測全球事件、社交情緒與鏈上數據,並在幾秒內做出交易決策,這超出了人類交易員的反應極限。

4. 成為 n8n 自動化的一環:打造無人工現金流

n8n 是一個開源的、低程式碼的工作流自動化平台,2025 年已成為企業導入 AI Agent 的首選工具。其「fair-code」許可模式允許用戶自托管,確保數據安全與成本可控。

結合 Nvidia-Groq 芯片,n8n 可以建立怎樣的自动化現金流?以「預測市場交易機器人」為例,完整的工作流可以這樣設計:

- 觸發:每日定時(或事件驅動)觸發 n8n workflow。

- 數據收集:調用 RSS、Twitter API、CoinGecko 等,匯總重大事件與加密幣價格波動。

- AI 推理:將文本送入 GroqCloud API(或自建 LPU 集群)運行 Llama 3 70B,生成事件影響力評分與交易信號。

- 執行:通過 Polymarket 的 REST API 下單,並記錄到 PostgreSQL。

- 監控與報告:每日生成損益報告,若虧損超過閾值則發送警报到 Telegram。

這個工作流一旦上線,幾乎不需要人工干預,形成了「設定後忘記”(set-and-forget)的被動收入系統。更重要的是,n8n 提供了數百個預置節點(如 HTTP Request、Database、Telegram),使得集成過程快速且可靠。

透過 n8n,你可以將 Groq 的推理能力快速封裝為重複使用的模組,接上 Polymarket 或其他預測平台的 API,實現從數據到現金流的全自動閉環。

5. Vibe Coding 與意圖驅動開發:2026 年的軟體工程變革

Vibe Coding(also known as Intent-Driven Development)是指開發者不再是逐行編寫代碼,而是描述「意圖」(intent)或「 vibe」,然後由 AI 代理自動生成、測試與部署完整的功能模組。在 2026 年,隨著 Groq LPU 提供的高速推理,Vibe Coding 將從概念驗證走向實戰部署。

一個典型的場景是:產品經理輸入「我需要一個監測 Polymarket 事件並自動交易的機器人,要求延遲低於 50ms,年化夏普比率大於 2」。AI Agent 會拆解需求 → 選擇技术栈(n8n + Groq Cloud + Polymarket SDK) → 生成 workflow JSON → 自我測試 → icleanup。這個過程可能在數分鐘內完成,而傳統開發需要數天。

這背後的技術支撐正是 Agentic Workflows:多個 AI 代理協作,分別負責需求理解、代碼生成、安全審計與部署監控。Nvidia 的 Blackwell + Groq LPU 組合提供了必要的推理算力,使得这些代理能够实时交互,而不會成为瓶頸。

從長遠來看,Vibe Coding 將重塑軟體工程的角色:人工編碼將轉變為「意圖設計」與「系統驗證」。這不是要取代開發者,而是將重複性勞動交由 AI Agent,讓工程師聚焦於架構、整合與創新。

常見問題

Nvidia-Groq 200億美元交易對 AI 開發者有什麼實際影響?

這筆交易主要影響在於技術整合與人才流動。Groq 的 LPU 核心團隊加入 Nvidia,意味著後續 GPU 產品線將借鑒 LPU 的 deterministic latency 設計,尤其是推理場景。開發者可以預期 Nvidia 推出更高效能的推理芯片,同時 Groq 作為獨立公司仍將提供雲端服務。這不會立即改變現有 API,但長期將提升推理性能並降低每 token 成本。

LPU 和 GPU 在量化交易場景中哪個更優?

对于 ultra-low latency 的高頻交易,LPU 因其 deterministic dataflow 架構而表現更佳,延遲更低且可預測;對於大規模 batch 處理或訓練任務,GPU(尤其是 Nvidia Blackwell)仍具優勢。實際選擇取決於工作流特徵:如果強調單次推理延遲(如事件驅動交易),LPU 更勝一籌;若可以累積批量請求以提升吞吐,則 GPU 更具成本效益。

如何開始建立預測 market 的 AI Agent?

建議步驟:

- 熟悉 Polymarket 的 Agents SDK 與 API 文檔。

- 注册 GroqCloud 並獲取 API Key,熟悉 GPT-4 或 Llama 3 的 prompt 工程。

- 在 n8n 中導入已有模板,將 Groq 節點與 Polymarket 節點連接。

- 先在 testnet 或模擬環境中回測策略,確認夏普比率與最大回撤。

- 逐步上線實盤,並設置風險限額與自動停損。

啟動你的 AI 自動化現金流

準備將这篇文章的洞察轉化為實際收益?我們提供技術顧問與 Workflow 定制服務,幫助你快速部署 Groq + n8n + Polymarket 的自动化系統。

有限的咨询名額,請立即聯繫我們。

Share this content: