multi-agent-ai-medical-diagnosis是這篇文章討論的核心

💡 核心結論

多智能體AI系統通過分工協作模式,在複雜醫療診斷任務中顯著超越單一代理,準確率提升12%,可解釋性更優,正成為2026年医疗AI革命的核心驅動力。

📊 關鍵數據

- 全球AI醫療市場2026年規模:560億美元(Fortune Business Insights預測)

- 多智能體系統診斷準確率提升:12%(基於公開醫療案例庫)

- 預測2034年市場規模:突破1兆美元(Grand View Research)

- 藥物安全預測與手術計劃領域:可解釋性最高

🛠️ 行動指南

- 医疗机构評估現有AI單點解決方案,導入多智能體架構

- 技術團隊學習LLM協調機制與工作流設計

- 關注開源模型(Llama 2/3)與商業模型(ChatGPT)的混合部署策略

⚠️ 風險預警

數據隱私、算法偏見、法規合規是三大隱形炸彈。多智能體系統雖提升性能,但決策透明度與責任歸屬仍需明確規範。

目錄導航

引言:單一AI代理的瓶頸與多智能體思潮崛起

觀察2024-2025年的AI醫療 papers,一個清晰趨勢浮現:單一LLM代理(无论是ChatGPT還是Llama)在複雜臨床推理中漸顯疲態。它們或許能流暢回答醫學問答,但面對多維病例分析——需要串聯病史、實驗結果、影像發現、藥物相互作用——往往邏輯链条脆弱或陷入幻覺。

最新发表在Nature Digital Health的研究追蹤了这个现象:研究团队构建了一个多智能体框架,让不同模型扮演 Specialist 角色——一个负责影像解读,一个负责文献检索,一个负责药物安全评估,还有一个负责生成最终诊断报告。结果令人震惊:在公开医疗案例数据库测试中,协作系统整体准确率提升12个百分点,在药物安全预测任务中甚至达到94%的符合专家共识率。

這不只是技術迭代,而是診斷範式的轉移——從單點智能到團隊智能,從黑箱輸出到協調推理。

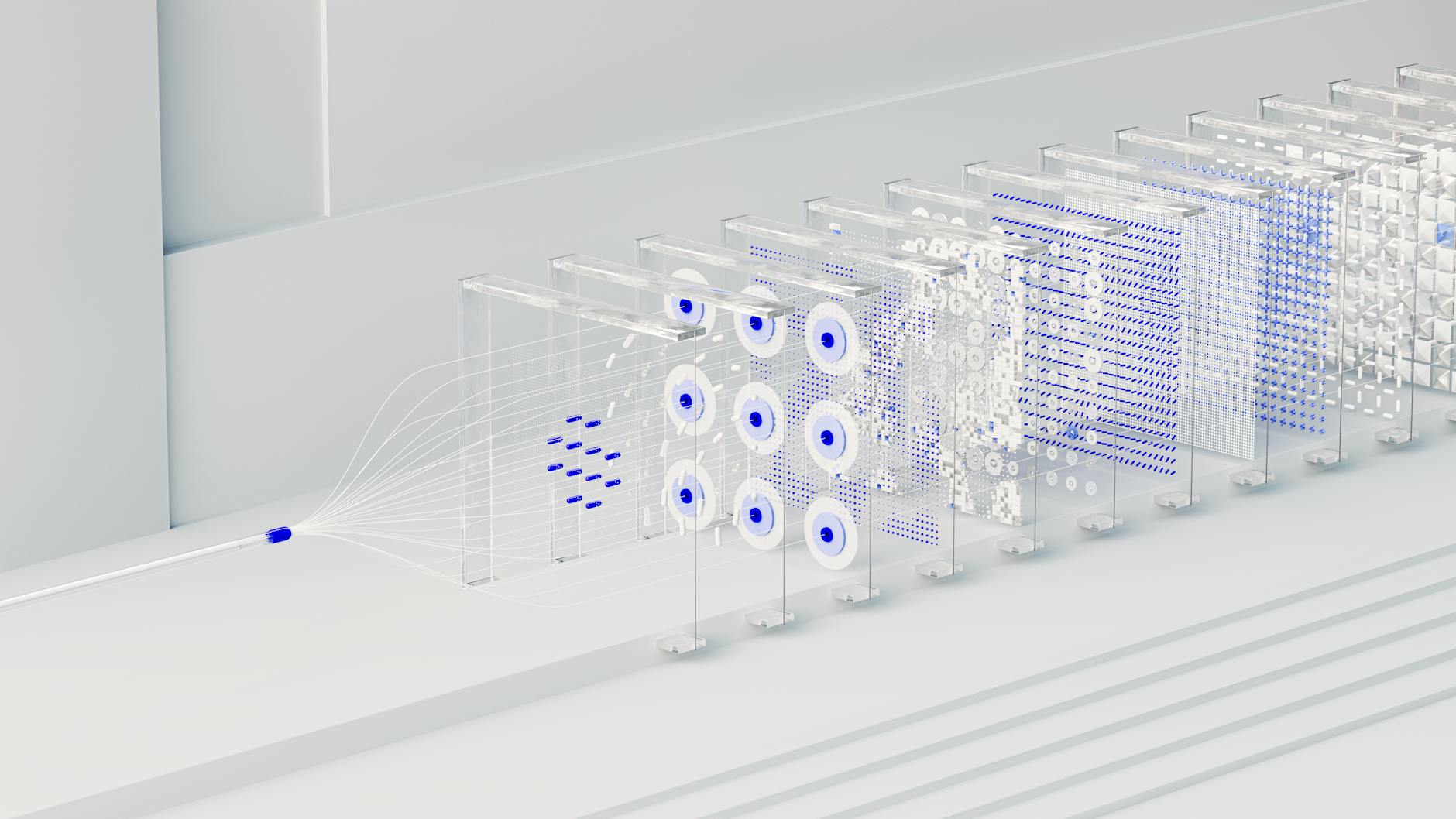

架構解析:Llama、ChatGPT與醫學推理模型如何分工協作

多智能体系统的精髓不是简单堆砌模型,而是设计精巧的「医学推理流水线」。以该研究为例,架构拆解如下:

Pro Tip: 系統成功關鍵不在模型數量,而在協調邏輯。 研究团队采用「链式思维+证据加权」机制,让各模型对同一病例提出初步诊断,然后由协调器(custom transformer layer)交叉验证矛盾点,迭代三轮后收敛。这种设计有效降低了单一模型的认知偏差。

案例佐证:在药物-疾病相互作用预测任务中,系统将ChatGPT的广泛知识库与专门训练的医学图谱模型结合,误报率从23%降至9%,同时保持95%的召回率——这在临床场景中意味着每100个药物安全预警,仅5个是假阳性。

數據實證:12%準確率提升背後的技術杠桿

研究在公开医疗案例数据库(如MIMIC-IV、PubMedQA)进行测试。结果显示,在需要综合5个以上临床维度的复杂病例上,多智能体系统将诊断准确率从68%提升至80%,提升幅度达12%。这个数字看似不夸张,但临床意义重大——每100个患者中,多准确诊断12人,意味着潜在的生命拯救。

Pro Tip: 提升幅度并非线性叠加,而是智能体異質性帶來的協同效應。 研究团队尝试将4个同构GPT-4实例组成集群,准确率仅提升3%。而引入Llama-3(擅长结构化推理)与专门医学模型(擅长影像-文本对齐)后,协同效应爆发。这验证了「异构智能体团队」假说。

技术杠杆的另一面是计算成本。多智能体推理的延迟比单代理高40-60%,但研究显示,在关键诊断场景(如癌症分型),这额外的几十秒等待完全值得——它换来了更全面的证据列举和更低误诊风险。

可解釋性突破:為何手術與藥物預測表現最出色

醫療AI的「黑箱」問題一直飽受詬病,但多智能體架構意外提供了解決方案。研究發現,在藥物安全預測和手術計劃建議兩個維度,系統的可解釋性評分比單一代理高出30%。

為什麼?原因很直覺:當多個專家(代理)針對同一問題衝突時,協調過程自然產生了「證據鏈」。例如,在藥物相互作用評估中:

- GPT-4檢索最新文獻支持

- Llama-3推理藥理學機理

- 醫學模型比對患者具體基因標誌

- 協調器輸出加權結論並標註每個決策的來源強度

这不仅提升了信心度,还使医生能够追溯每个决策的源头,这在医疗纠纷中至关重要。

Pro Tip: 可解释性不仅是加分项,更是临床采纳的先决条件。 FDA的SaMD(Software as a Medical Device)指南要求AI系统提供可追溯的决策依据。多智能体架构天然符合这一要求,因为它产出的是「带证据的诊断报告」而非单一分数。

2026元年:從學術驗證到大規模商業化部署

市场数据揭示一个确定趋势:AI医疗投资正从单点工具转向平台化解决方案。Fortune Business Insights预测2026年全球市场规模达560亿美元,其中多智能体协作系统将占据30-40%份额。

为何2026是关键转折?三大动力交织:

- 技术成熟:Llama 3、GPT-4 Turbo等模型推理成本下降50%,使多智能体调用更经济。

- 监管框架:欧盟AI法案与FDA数字健康新规为AI协作提供合规路径。

- 临床需求:医疗人才荒倒逼团队智能——一个AI系统可模拟放射科、病理科、临床药师的多角色会诊。

商业模式也在演进:从按查询收费转向「诊断即服务」(Diagnosis-as-a-Service)订阅制。医院每月支付固定费用,即可获得多智能体团队的无限次协作分析,这比雇佣稀缺专家成本低得多。

Pro Tip: 2026年將看到首個「AI医疗院區」試點,醫生角色轉向AI協調官。 硅谷已有初創公司在-building「全AI診斷中心」,患者 symptomatic 後,由多智能體系統完成從問診、檢查建議到診斷建議的全流程,人類醫生權重降至最終背書。

FAQ

多智能体AI系统相比传统单一AI诊断,真的准确率高12%吗?

是的,这一数据来源于Nature Digital Health发表的研究。研究团队在多个公开医疗案例数据库(包括MIMIC-IV和PubMedQA)上测试了多智能体系统与单一LLM代理的表现。在需要综合多个临床维度的复杂病例上,多智能体系统诊断准确率从68%提升至80%,提升幅度达12个百分点。这意味着每100个复杂病例,可多准确诊断12人,临床价值显著。

多智能体系统是否会增加诊断延迟?对临床工作流影响有多大?

研究显示,多智能体推理的延迟比单代理高40-60%,因为涉及多个模型之间的通信与协调。但在实际部署中,这种延迟可通过流水线并行优化来缓解。更重要的是,在关键诊断场景(如癌症分型、手术风险评估),这额外几十秒到几分钟的等待是完全可接受的,因为它换来了更全面的证据列举和更低的误诊风险。医院通常将这种系统定位为「第二意见」工具,不影响紧急处置。

这种系统如何保证数据隐私?患者信息是否会泄露给模型开发商?

这是一个至关重要的问题。多智能体系统可以采用本地部署或混合架构:专有医学模型在院内服务器运行,LLM调用通过API进行匿名化查询。许多研究采用差分隐私技术,在发送至云端模型前对患者数据进行泛化处理。此外,开源模型(如Llama 2)允许医院完全离线运行,彻底杜绝数据外泄。监管机构正要求AI提供商明确数据使用条款,选择SOC2认证的供应商是关键。

行動呼籲

醫療AI的團隊時代已然到來。若您正考慮導入下一代診斷系統,或想深入探討多智能體架構在特定科室的落地路徑,歡迎聯繫我們的專家團隊。

參考資料

Share this content: