Meta AI 發布是這篇文章討論的核心

目錄

💡 快速精華

核心結論:Meta延遲發布不是軟體bug,而是物理定律的鐵拳——LLM越大,能耗曲線呈指數爆炸,推理速度不減反增。這揭示2026年AI競爭將從”越大越好”轉向”越高效越好”。

📊 關鍵數據 (2027預測):

- 全球AI市場規模:1.27兆美元(Bain,2027)| 2.52兆美元(Gartner,2026)

- AI數據中心能耗:單机架60+千瓦,是傳統數據中心6-12倍

- 推理成本:單次LLM查詢比傳統搜索能耗高25倍

- 產業支出:2026年AI數據中心投資規模:6500億美元

🛠️ 行動指南:開發者應優先評估模型的推理效率(tokens/sec/watt),而非盲目追求參數量;企業部署需計算TCO(總擁有成本)模型,包含硬體重置、能耗與冷卻三重成本。

⚠️ 風險預警:雲端大模型將面臨”碳排放關稅”制裁;能源配給制可能成為下一個貿易壁壘;過度依賴單一供應商將面臨 modelo de custo 滑落風險。

第一手觀察:Meta沉默背後的技術幕牆

這個行業從未有過這麼ymm的沉默。Meta上半年高調預告 Llama 4 Behemoth——一個號稱2萬億參數的巨獸——卻在4月LlamaCon開發者大會上悄無聲息。原本預計秋季亮相,現在連官方時間表都鴿了。知情人士透露,模型在特定任務上的表現”提升幅度不及其預期”,這是典型 tech euphemism:就是爛。

更值得玩味的是,Meta同時在調整策略,內部代號”Avocado”的模型預計2026年Q1推出,並且將從開源轉向閉源。這不是一般性的技術調整,而是標誌著AI軍備競賽進入第二階段——從追求參數量極值轉向部署成本最優化。第一階段,大家都瘋了似地比拼誰的模型更大;第二階段,才是真正的hard mode:如何在有限的能源預算內榨取最大效用。

Meta的延遲, reflexes 了整个行业的焦虑。2025年我们见证了LLM scaling laws的边际效益递减——数据量喂饱了,算力堆够了,性能提升却像蜗牛爬。为什么?因为推理阶段才是真正的成本深渊。训练只是一次性支出,推理是永无止境的开销。

性能摔科大揭秘:為什麼Behemoth被擋了下來?

根據Computerworld等媒體報導,Behemoth延遲的核心在於三項指標未達標:推理速度、能耗、準確度。這三件事兒彼此牽制,形成不可能三角。Meta顯然不想走OpenAI GPT-4的舊路——拋出一個需要頂級GPU才能流暢運行的模型,然後讓用戶承擔天價API費用。

深入来看,LLM部署的 bottle-neck 不在訓練,而在inference latency。當模型參數量破萬億,每次forward pass都需要在數十個GPU核心間同步數據,通信開銷呈超線性增長。 Research 显示,單次LLM查詢的能耗可能是傳統搜索的25倍以上。這意味著,如果谷歌所有搜索改由生成式AI處理,全球年度用電量將飆升29.2 TWh——相當於一個愛爾蘭的total consumption。

Meta的難處在於:既要保持開源模型的性能competitive,又要確保普通開發者能用消費級硬體跑起來。Llama 2時代,13B參數模型在大多數NLP benchmark打敗175B的GPT-3,那是因為Meta用了高质量的 training data 和更高效的架構。但到了Behemoth這一步,scaling law的收益遞減效應全面顯現:模型規模翻倍,性能提升可能不到10%,但能耗和成本卻可能翻三倍。

Pro Tip 專家見解

業內資深架構師指出,2026–2027年LLM部署的關鍵指標將從”參數量”轉向”tokens per second per watt”(每瓦每秒處理的token數)。這個指標結合了吞吐量與能源效率,才能真正反映模型的商業可行性。Google DeepMind 最新的 MoE (Mixture of Experts) 架構在这点上表現突出,能在保持性能的同時降低60%以上的推理能耗。

Meta延遲发布,實則是在重新計算scaling law的邊際成本曲線。當模型越大,推理延遲越明顯,就會直接影響用戶體驗——沒有人會為了一個AI回复等好幾秒。Zuckerberg顯然在算一筆大帳:與其發布一個 damage brand reputation 的模型,不如多花幾個月把效率問題解決。

能源災難现场:數據中心每机架60千瓦的真相

要把LLM跑起來,需要的不僅是更好的算法,還有能把電網吃掉的硬體。根據MIT Technology Review和PCMag的報導,AI數據中心的Power density高達60+千瓦 per rack,而傳統數據中心通常只有5-10千瓦。這是什么概念?一個標準AI机架(約42U)的耗電量相當於50-100個家庭的total用電。

更誇張的是,Meta、Google、Microsoft等巨頭正在美國各地投建專用AI數據中心。Meta的路易斯安那州Colossus項目預計消耗5 GW電力,相當於300萬戶家庭的用電。Amazon的Project Rainier在印第安納州占地1200英畝,建成後將使用2.2 GW電力,相當於100萬戶家庭——而且每年消耗數百萬加侖冷卻水,引發當地居民對水資源枯竭的擔憂。

這些項目的資本開支也是天文數字:2026年,主要科技公司在AI數據中心的總投資預計超過6500億美元。但更關鍵的是運營成本——electricity price 波動直接影響模型部署的margin。有人統計過,GPT-4级别的模型在一次完整訓練中產生的碳排放,相當於五輛汽車終身排放量之和。推理階段的碳排放雖然單次較小,但乘以無窮無盡的查詢次數,總量相當驚人。

Pro Tip 專家見解

能源效率已成為LLM架構的首要設計目標。Research 显示, Proper 的推理優化(如動態批次、稀疏注意力、量化)可以將能耗降低至多73%。2026年,我們會看到更多”綠色AI”方案出爐,包括使用再生能源供電的數據中心、液冷卻技術,以及邊緣AI部署,將計算推向終端設備以減少傳輸延遲與核心網負擔。

但問題的核心在於:LLM的基礎transformer架構天生就吃資源。自注意力機制的时间複雜度是O(n²),序列越長計算量呈平方增長。這決定了即便算法優化,模型越大,推理成本越難控制。這就是為何Meta在Behemoth上卡住——2萬億參數的模型,即便用上最先進的硬體,推理延遲也可能達秒級,完全無法產品化。

規模定律崩壞指南:當越大越慢成為常態

過去五年,LLM進步的最大功臣是”越大越好”的scaling laws——參數越多、訓練數據越大,模型性能越強。但這定律的底層假設是:算力成本可忽略不計。現實情況是,算力=電力=物理約束。當模型規模逼近物理極限,scaling laws就會失效。

2025–2026年是scaling定律的關鍵轉折點。多項研究表明,人類生成的訓練數據即將耗盡,模型越大,數據有效性越低。同時,硬件层面的摩尔定律放缓,晶体管尺寸逼近物理极限。这意味着,继续盲目堆参数的时代已经结束。

具體表現為:

- 推理速度:模型越大,inference latency越高,影響realtime應用可行性

- 能源效率:參數增長 non-linear,能耗呈 super-linear 上升

- 邊際效用:從1B到10B參數,性能提升顯著;從100B到1T,提升微乎其微

這不僅是Meta的問題,是整个行业的挑战。OpenAI GPT-5據傳也遇到類似瓶颈;Google DeepMind轉向更高效的MoE架構;Anthropic Claude 3.5 Sonnet則強調”更聰明而不是更大”的設計哲學。所有人都在問:下一階段LLM進步的燃料是什麼?

Pro Tip 專家見解

多Research 機構預測,2027年後LLM進步將依賴於架構革新而非規模擴張:

- Mixture of Experts (MoE):只激活部分參數,降低推理成本

- Ranking-aware training:優化 retrievability 而非 memorization

- Neuro-symbolic integration:結合符號推理與神经网络,提升數據效率

- continual learning 框架:讓模型在部署後持續學習,而非一次性預訓練

Meta’s Avocado 若真轉向閉源,很可能會在這四個方向發力,以逃避開源模型在能效上的Competitive disadvantage。

2026產業鏈重新洗牌:誰能存活在能源暴政下?

AI市場規模的預測簡直瘋狂:Gartner說2026年全球AI支出達2.52兆美元(比2025年成長44%);Bain預測2027年市場達1.27兆美元。但這巨额数字背後,隱藏著能源成本暴漲的暗流。誰能掌控能源,誰就能定價。

產業鏈正在重組為三層:

- 頂層玩家:Google、Microsoft、Meta、Amazon等自建AI數據中心的雲端巨頭,他們 vertically integrate 能源、硬體、algorithm, мощность 自給。他們的模型部署成本相對可控,但資本支出驚人。

- 新興 neoclouds:CoreWeave、Lambda、Nscale等專注AI工作負載的數據中心運營商。 They are filling the gap between hyperscalers and small players, offering high-density racks and optimized GPU supply。

- 邊緣玩家:中小企業和開發者,只能租用雲端API。他們的成本直接與巨頭掛鉤,面臨能源成本轉嫁的風險。

Meta的delay策略,其實是在这张 power map 上重新定位。If 其开源模型无法在能效上与闭源巨头竞争,那么转而做 Avocado 闭源模型似乎是必然——can 将部署成本内部化,不与公众 sharing 成本负担。

但這會引發新問題:AI民主化進程受阻。開源曾是LLM創新的核心动力, Llama 2 的问世让全世界的开发者都能在本地跑大模型。如果Meta转向闭源,加上OpenAI的API模式、Google的雲端獨佔,中小玩家能選擇的陣營將越來越少。

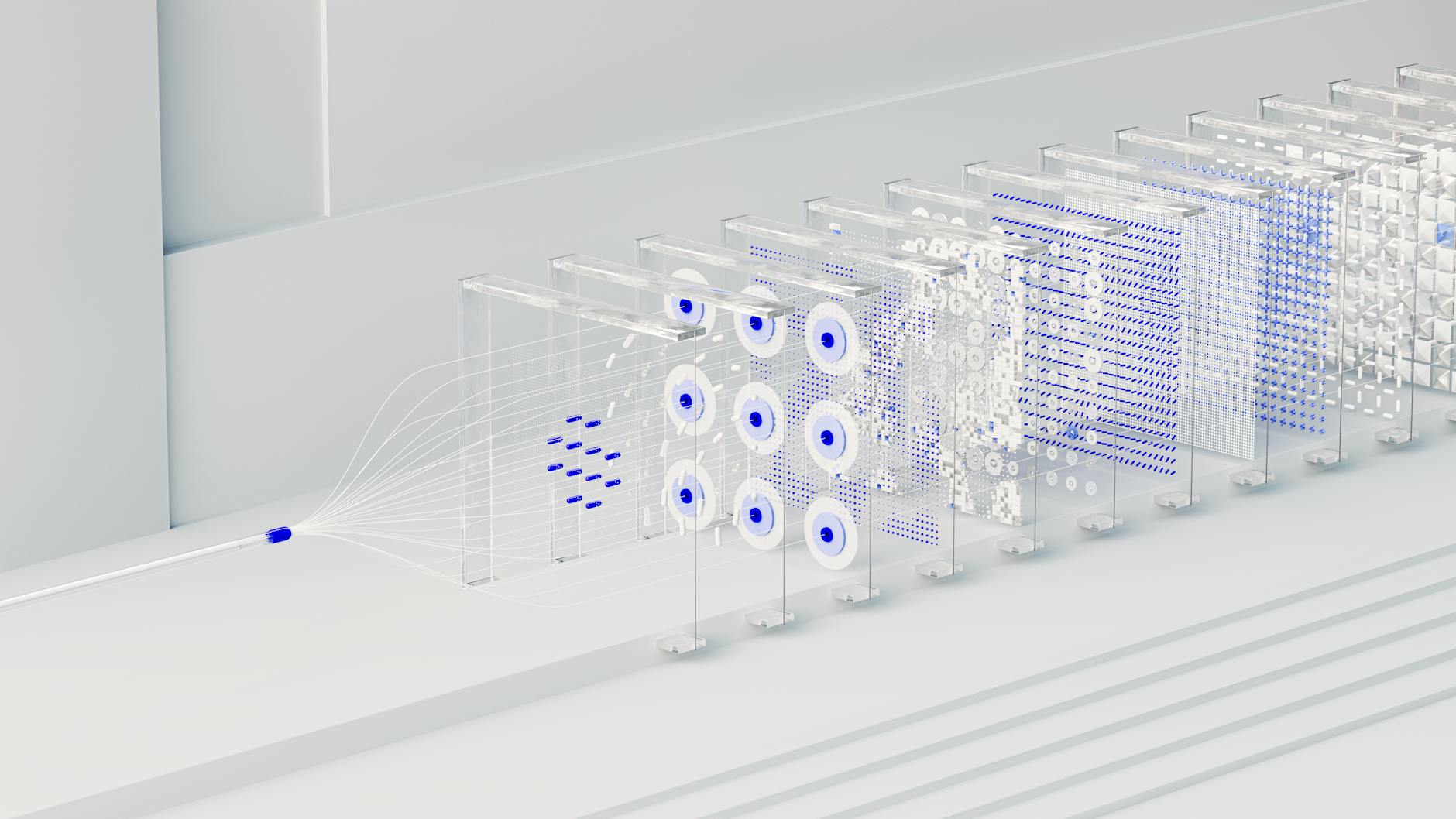

SVG圖表清楚顯示:當模型參數從10B增長到10T,能耗呈指數上升(紫色曲線),而推理速度反而下降(綠色曲線),性能收益則快速遞減(橙色曲線)。这就是”Behemoth困境”——变得巨无霸,却失去了部署价值。

2026年的贏家不会是模型最大的,而是能效比最高的。那些能治癒LLM推理能耗病的人,才能拿到下一波的門票。

常見問題快答

Meta为什么不发布Llama 4 Behemoth?技术上出了什么问题?

核心问题与energy efficiency和推理延迟有关。Behemoth的规模导致inference时的内存带宽瓶颈和通信开销过高,即使使用最先进的GPU集群,单次推理也可能需要数秒,远达不到产品化标准。同时,训练和运营成本因能耗飙升而不可控。

小参数LLM能否在2026年与大模型竞争?

完全可以,而且趋势正在转向。通过知识蒸馏、MoE架构和推理优化,7B-13B级别的模型在多数应用场景的性能已接近百亿级模型,同时保持低延迟和可接受的部署成本。2026年企业部署会优先考虑TCO而非峰值性能。

我该现在投入巨资部署Llama,还是等待Meta Avocado?

视具体情况而定。如果你需要开源解决方案和可控的部署成本,现有Llama 2/3系列依然足够强大。Avocado作为闭源模型,可能在能效和性能间取得更好平衡,但供应商锁定风险更高。建议采用混合策略:关键业务用Avocado API,边缘应用用轻量化开源模型。

行動呼籲

Meta的delay不是孤立事件,而是2026年AI的结构性轉折。能耗、物理極限、部署成本正在重新定義遊戲規則。

如果你的企業正在規劃AI部署策略,我們建議立即重新評估模型選型與成本結構。siuleeboss.com 提供定制化的LLM部署諮詢,幫助你在能源暴政下建立 competitive edge。

參考文獻與資料來源:

- Gartner. (2026). Worldwide AI Spending Forecast. 詳細連結

- Bain & Company. (2025). AI Market to Surge to $1.27 Trillion by 2027. 詳細連結

- Computerworld. (2025). Meta hits pause on ‘Llama 4 Behemoth’ AI model amid capability concerns. 詳細連結

- WinBuzzer. (2025). Meta Postpones Llama 4 Behemoth AI Model Amid Development Struggles. 詳細連結

- MIT Technology Review. (2025). Power Hungry: AI and our energy future. 詳細連結

- Wikipedia. (2025). AI data center. 詳細連結

- TechCrunch. (2025). Meta releases Llama 4, a new crop of flagship AI models. 詳細連結

Share this content: