LLM招聘重設是這篇文章討論的核心

目錄(先看重點再決定要不要深挖)

快速精華(先把結論抓走)

💡 核心結論:AI 招聘不是不能用,而是不能「盲用」。當公司把 LLM 直接用在篩選與面談加速,卻缺少偏見檢測、決策監控與人機協同設計,就會出現篩選失真、候選人不滿與合規風險的三連擊。

📊 關鍵數據:2027 年全球人力資本管理(HCM)與招聘相關軟體市場規模預計站上 千億美元等級(約 1,000 億~1,500 億美元區間),而 AI 驅動的招聘自動化(含 LLM 助理、履歷理解、面談輔助)將吃掉其中相當比例。到 未來幾年,這類「AI+招聘」能力會從增值功能變成標準配置:你如果不把治理做進流程,成本會在法遵與品牌信任上爆出來。

🛠️ 行動指南:把 AI 拆成三層——預處理層(資料品質)、決策層(模型與規則)、審計層(監控與可解釋紀錄)。任何一層缺失,你的「加速」就會變「加速事故」。

⚠️ 風險預警:你最容易踩到的坑是「缺明確監控」+「缺偏見檢測」+「把人機協同設計當可有可無」。結果通常是:篩選失真、候選人不滿(覺得被亂刷)、以及合規風險(決策依據難以說清楚)。

引言:我在「AI 招聘」現場觀察到的三個怪現象

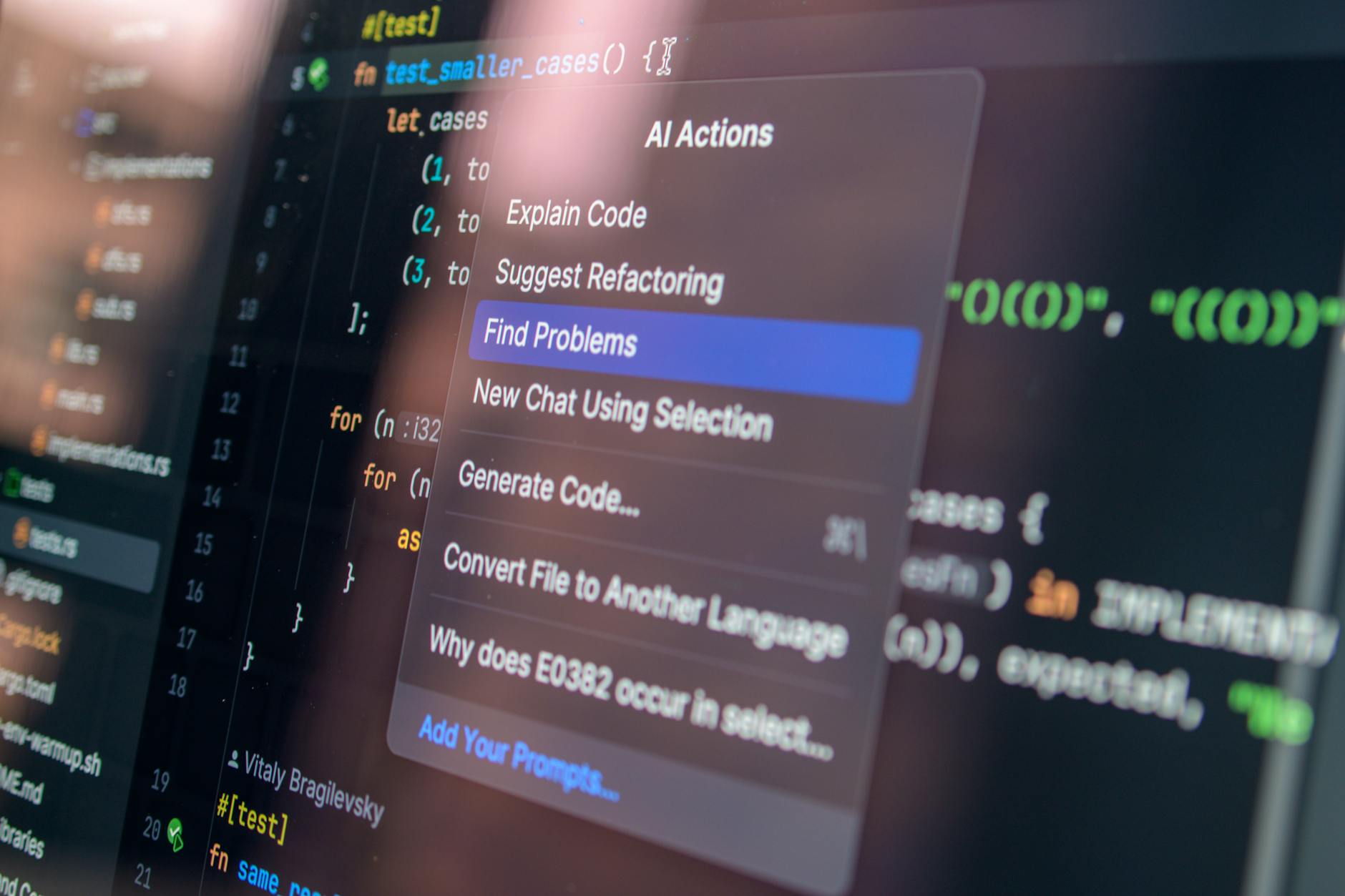

我先講結論:在不少導入 LLM 的招聘專案裡,最常見的問題不是「模型不夠聰明」,而是「系統不夠可控」。基於你提供的新聞內容,我把它當作一個情境案例來看:管理層希望用大語言模型與自動化工具,加速履歷篩選與面談;但因缺乏明確監控、偏見檢測,以及人機協同設計,最後就出現篩選失真、候選人不滿與合規風險。

我在這類流程裡的觀察(不是亂猜,是看得到的現象鏈)通常長這樣:第一,履歷被摘要或打分後,結果變得「更像」但不一定更準——候選人會覺得自己被簡化了,甚至覺得被系統誤解;第二,面談被輔助時,面試官會依賴輸出,導致人類判斷也被帶偏;第三,當有人追問「為什麼是你或不是你」時,團隊常拿不出可審計的決策依據。

所以這篇文章要做的不是恐嚇 AI,而是把「可加速」與「不可控」拆開講清楚:你要的,是能被監控、能被修正、也能被合規解釋的招聘 AI,而不是一個會自動吐分數的黑盒。

為什麼自動化篩選+LLM 會把候選人篩到更歪?失真的機制到底是什麼

新聞核心指出:導入實驗的公司最終導致「篩選失真」。這件事聽起來抽象,但其實失真有幾種常見來源,而在招聘場景特別致命。

1)訓練/校準目標與招聘真目標不對齊:LLM 如果被用來做履歷摘要、能力映射,或直接打分,常會把「語言風格」誤當「能力」。同樣一段經驗描述,格式工整的人更容易被模型看懂;而不那麼工整的人,反而會被壓低評分。你以為在比較能力,其實在比較文本可讀性。

2)資料分佈偏移(候選人池換了):當招聘需求變動(職缺類型、地區、資歷分布),模型就可能在新資料分佈上失去穩定性。新聞裡沒有列出技術細節,但「沒有明確監控」本身就會讓這類分佈偏移沒有被早期抓到,等於讓偏差慢慢累積。

3)偏見檢測缺席=偏差無限繁殖:如果沒有偏見檢測,你的系統可能會把歷史決策的偏差吸進來,尤其當履歷中與性別、年齡、背景相關的訊號被模型吸收時。招聘是高敏感領域,新聞也點到合規風險;缺偏見檢測,等於你把雷藏在地底。

4)人類決策被輸出「帶節奏」:新聞提到人機協同設計缺失。簡單說,面試官看到模型推薦或分數後,往往會下意識調整問題或評價權重。最後失真不只在自動化層發生,也會在人工層擴散。

如果你只看到「模型輸出很漂亮」就開始上線,那就像在沒有儀表板的車上跑高速。新聞裡的失誤,其實是系統工程的一次提醒:招聘 AI 必須把偏差傳導路徑納入設計,而不是事後補救。

Pro Tip:專家怎麼看

招聘的「可接受誤差」很低,因為它直接關乎機會公平與品牌信任。你要的不是更複雜的 prompt,而是可追蹤的決策鏈:每一次篩選分數都要能回溯到資料來源、特徵處理、以及規則/模型版本。這樣你才有辦法在候選人不滿與合規審查來臨時,快速定位到底是哪一段失控。

沒有監控就等於沒有方向:你需要怎麼設計 LLM 招聘的治理與審計

新聞明確提到:管理層希望用 LLM 和自動化工具加速流程,但因「缺乏明確監控、偏見檢測及人機協同設計」而出事。這句話其實把治理骨架講完了。

監控要監控什麼?至少三件事:輸出品質、分佈漂移、決策一致性。輸出品質包括摘要是否把關鍵經驗漏掉;分佈漂移包括某類背景或語言風格的履歷被大量拒絕;決策一致性包括同一候選人在重跑或不同輪次是否得到高度相同結果。

審計要留下什麼?你不是要做漂亮報告,你是要能回應質問。建議至少保存:模型版本、prompt 模板或規則版本、特徵提取摘要、以及最終輸出如何被面試官採用/覆寫。這些在合規風險出現時,能把「我們有用 AI」變成「我們怎麼用 AI、用到哪裡、出了什麼偏差」的證據鏈。

這裡我會用一個權威框架來對齊方向。NIST 的 AI Risk Management Framework(AI RMF) 目的就是協助組織管理 AI 的風險、提升可信度;而對招聘這種「決策會直接影響個人權益」的場域,監控與治理不是選配。

再加上一個原則來源:OECD 在 AI principles 中強調可信任與尊重人權/民主價值。翻成招聘語言就是:你要能解釋、能追溯、也能減少對弱勢群體的不利影響。

人機協同怎麼做才不尷尬?把「自動化」降速到可控、把「人」放回關鍵點

新聞的另一個關鍵詞是「人機協同設計」缺失。很多公司以為協同就是:讓 AI 出輸出,HR 或面試官照著看。但這很容易變成「把人變成第二個黑盒」。

我建議你把人機協同拆成三個節點:

節點A:高風險拒絕一定要人工覆核。自動化可以先做初篩,但涉及負面結論(直接拒絕或進不了下一輪)要設置覆核機制。覆核不是為了慢,而是為了避免錯誤被規模化。

節點B:面談提問要用 AI「輔助」,不要用 AI「判決」。AI 可以幫你整理候選人的經歷脈絡、生成追問問題,但最終評分與決策應由人類掌握權重。否則面試官會過度依賴輸出,回頭看就會發現問題其實沒問到關鍵,評估也偏了。

節點C:提供候選人可理解的說明。候選人不滿往往不是因為被拒絕,而是因為理由不透明。你可以用「流程說明」降低焦慮:例如你們用哪些類型的資訊、哪些步驟是人工參與、怎麼處理異議。

你會發現,協同設計的本質是「把 AI 的能力限制在低風險範圍,把人放在高風險決策點」。新聞中的失敗並不是 AI 太強,而是節點沒切好。

重設招聘AI系統:從資料、模型到面談節奏的一步到位清單

現在進入可落地部分。下面是一份「把事故拆解後重建」的清單,直接對應新聞提到的三個缺口:監控、偏見檢測、人機協同。

1)資料層:把履歷當成可驗證物件,而不是文字

- 定義特徵來源:學歷、工作內容、技能關鍵字要怎麼抽取與清理

- 建立資料品質門檻:缺字段、拼字亂碼、跨語系履歷如何處理

- 做分佈監測:新職缺、新地區、新資歷組合上線前要做基線測試

2)模型/決策層:明確區分「建議」與「決策」

- LLM 用於摘要、生成面談追問、候選人亮點整理,而不是直接輸出拒絕結論

- 引入可控規則:例如必備條件先走規則檢查,再交由模型做排序

- 設定回退機制:模型置信度不足或不一致時,自動切回人工流程

3)審計/監控層:你需要能拿出來的證據

- 記錄模型版本、prompt 版本、以及輸出內容與採用方式

- 做偏見檢測報告:至少針對受保護/高敏感群體相關訊號做差異分析(並把結果納入策略調整)

- 建立事件回應:候選人申訴、面試失誤、輸出異常要有處理流程

4)面談節奏層:把「透明」寫進流程

- 候選人溝通:說清楚哪些步驟由 AI 輔助、哪些步驟由人類決策

- 面試官訓練:教他們如何解讀模型建議(以及什麼情況下要忽略)

- 覆核策略:拒絕決策與高風險推薦一定要有人覆核

把它當成一個「招聘作業系統」

新聞裡的公司是在招聘流程中引入 AI 的實驗,卻因治理缺失造成失誤。你重設時就別只盯著模型:把 AI 當作系統模組,讓流程具備監控、可回溯、可修正、可審計,這樣才有機會把自動化真正變成加速器。

如果你需要更完整的風險治理框架參考,上面提到的 NIST AI RMF、OECD AI Principles 也都能作為你內部制度的基礎。

參考資料(建議你直接收藏):

NIST AI Risk Management Framework、

OECD AI principles

FAQ:你想問的 3 個搜尋意圖,我直接回答

招聘流程導入 LLM 後,最容易先出現哪種問題?

通常是篩選決策失真:模型可能把文本風格當成能力、在候選人分佈變動時失去穩定、再加上偏見檢測缺席,最後就會反映在候選人不滿與合規風險上。

要怎麼做監控,才不會等候選人申訴才發現偏差?

監控輸出品質、分佈漂移、決策一致性;並保留模型版本/提示模板/輸出內容與人類採用方式,讓審計能回溯,而不是只能口頭解釋。

人機協同具體要怎麼設計才算「真正協同」?

AI 做輔助(摘要、追問建議、整理),人類做高風險決策(拒絕覆核、面談結論、最終評分);同時把透明度寫進流程,讓候選人知道哪些步驟有人參與。

最後一段:你要的是「可控的加速」,不是「自動化的勇敢」

把 AI 引入招聘是一種合理趨勢,但新聞已經給了警訊:缺乏明確監控、偏見檢測與人機協同設計,就會把失誤放大成篩選失真、候選人不滿與合規風險。你重設系統時,別只改 prompt;請從資料層、決策層、審計層把閉環補起來。

如果你想加速而不想踩雷,下一步就是:把流程治理與可審計性做成內建能力。需要我們協助盤點與重設時,直接用 siuleeboss.com/contact/ 聯絡。

Share this content: