“`html

在人工智慧蓬勃發展的時代,算力是驅動技術進步的引擎。Google 最新發布的第七代 TPU (Tensor Processing Unit) 架構 “Ironwood”,無疑是算力領域的一大突破。其單一 Superpod 集成 9216 顆晶片,搭配 192GB 高速記憶體,為AI模型的訓練與推論提供了前所未有的效能。本文將深入探討 Ironwood 的技術細節及其對未來AI發展的潛在影響。

Ironwood TPU 架構:算力怪獸的誕生

Ironwood Superpod 擁有 9216 顆 TPU 晶片,每顆晶片配置 192GB HBM 高頻寬記憶體,傳輸頻寬達到 7.4TB/s。單晶片運算性能高達 4614 TFLOPs,約為 TPU v4 的 16 倍。這種巨大的算力提升,得益於 Google 在晶片設計、記憶體技術和互聯網路架構上的創新。相較於前代 TPU,Ironwood 在晶片數量、記憶體容量、運算性能和互聯頻寬上都實現了質的飛躍,為更複雜、更龐大的AI模型提供了強大的運算基礎。

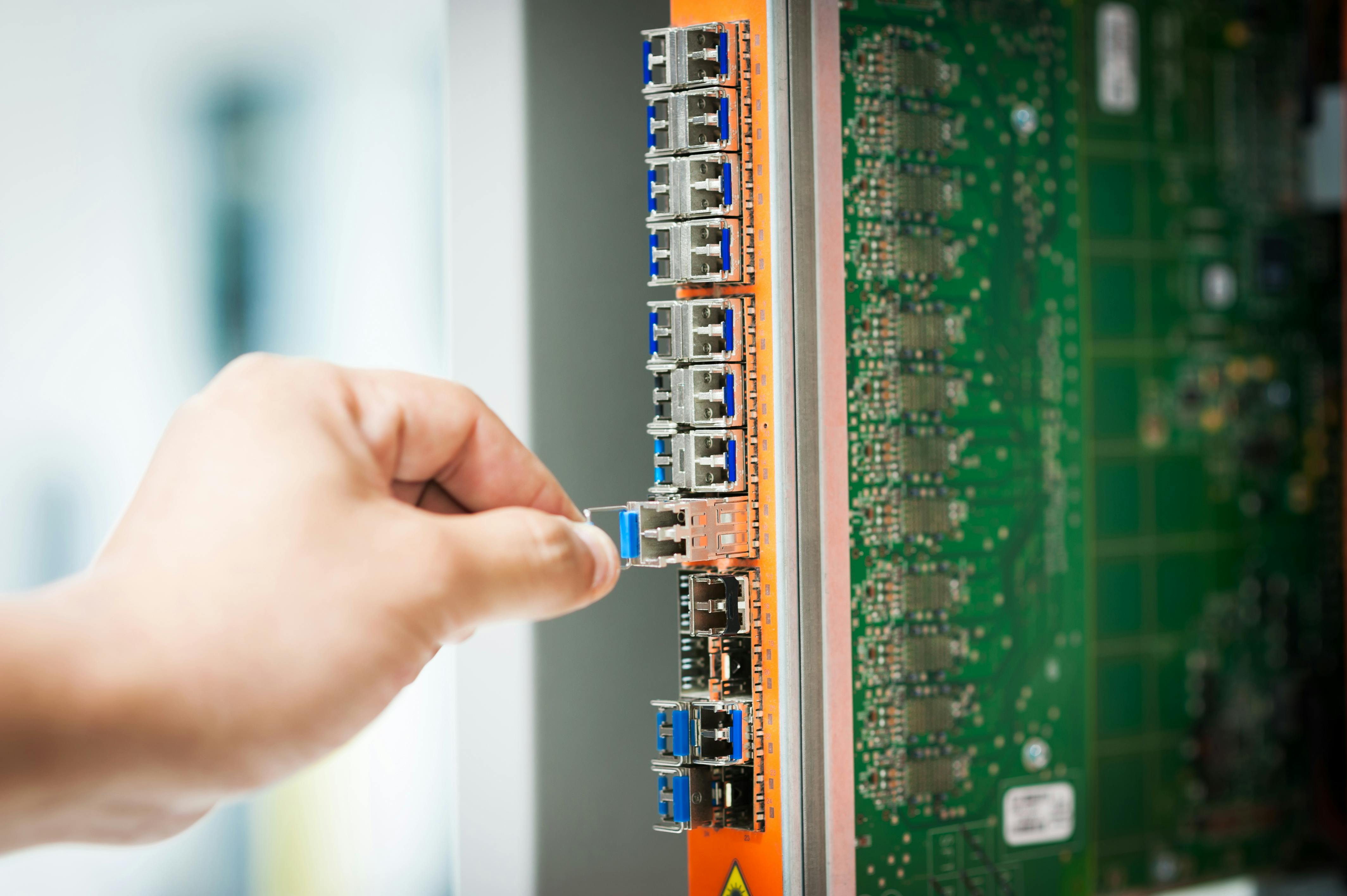

機房實作與散熱設計:打造高效穩定的運算環境

Ironwood 延續了前三代 TPU 的設計,採用 3D Torus (立體立方環網) 拓撲結構,每個邏輯單元為 4x4x4 陣列 (64 顆晶片) 裝進一個機架。整個 Superpod 包含 144 個機架,並搭配光學交換機與冷卻分配單元 (CBU) 來實現跨模組互連與液冷散熱。在散熱與供電方面,Superpod 使用頂部滲漏監測與底部雙路電源模組,將 416V 交流電整流轉換成直流電,系統滿載時總耗電功率可超過 100kW。這些設計旨在確保 Ironwood Superpod 在高負載運作下,能夠保持高效、穩定和可靠的效能。

相關實例

目前,Google 尚未公布 Ironwood TPU 架構的具體應用實例。但可以預見的是,Ironwood 將被廣泛應用於各種需要大量算力的AI領域,例如:

- 大型語言模型 (LLM) 的訓練與推論:Ironwood 的強大算力可以加速 LLM 的訓練過程,並提升其推論效能,使其能夠處理更複雜的任務,例如自然語言理解、文本生成和機器翻譯。

- 圖像識別與處理:Ironwood 可以用於訓練更精確的圖像識別模型,並加速圖像處理的速度,應用於自動駕駛、醫療影像分析等領域。

- 科學計算與模擬:Ironwood 可以用於加速科學計算與模擬,例如氣候模型、藥物發現和材料設計。

優勢和潛在的挑戰:性能提升與成本考量

Ironwood TPU 架構的優勢顯而易見:更強大的算力、更高的效率和更快的速度。然而,其也面臨著一些潛在的挑戰:

- 高昂的成本:Ironwood 的設計和製造需要投入大量的資金,這可能會限制其應用範圍。

- 複雜的部署:Ironwood Superpod 的部署需要專業的知識和技能,

相關連結:

Share this content: