cross-silicon-migration是這篇文章討論的核心

ModelCat AI 跨硅片遷移功能實測:打破硬體壁壘,邊緣AI迎來無縫部署時代

💡 核心結論

- ModelCat AI 推出首個真正意義的 cross-silicon 模型遷移功能,支援 CPU、GPU、NPU 無縫部署

- 硬體碎片化與供應商鎖定問題將在 2027 年前緩解,邊緣 AI 部署成本降低 40% 以上

- 與 n8n 等自動化平台整合,讓非專業開發者也能快速部署 AI 工作流

- 全球 AI 市場將在 2027 年達到 9,900 億美元,邊緣 AI segment growth rate 28% 年複合成長率

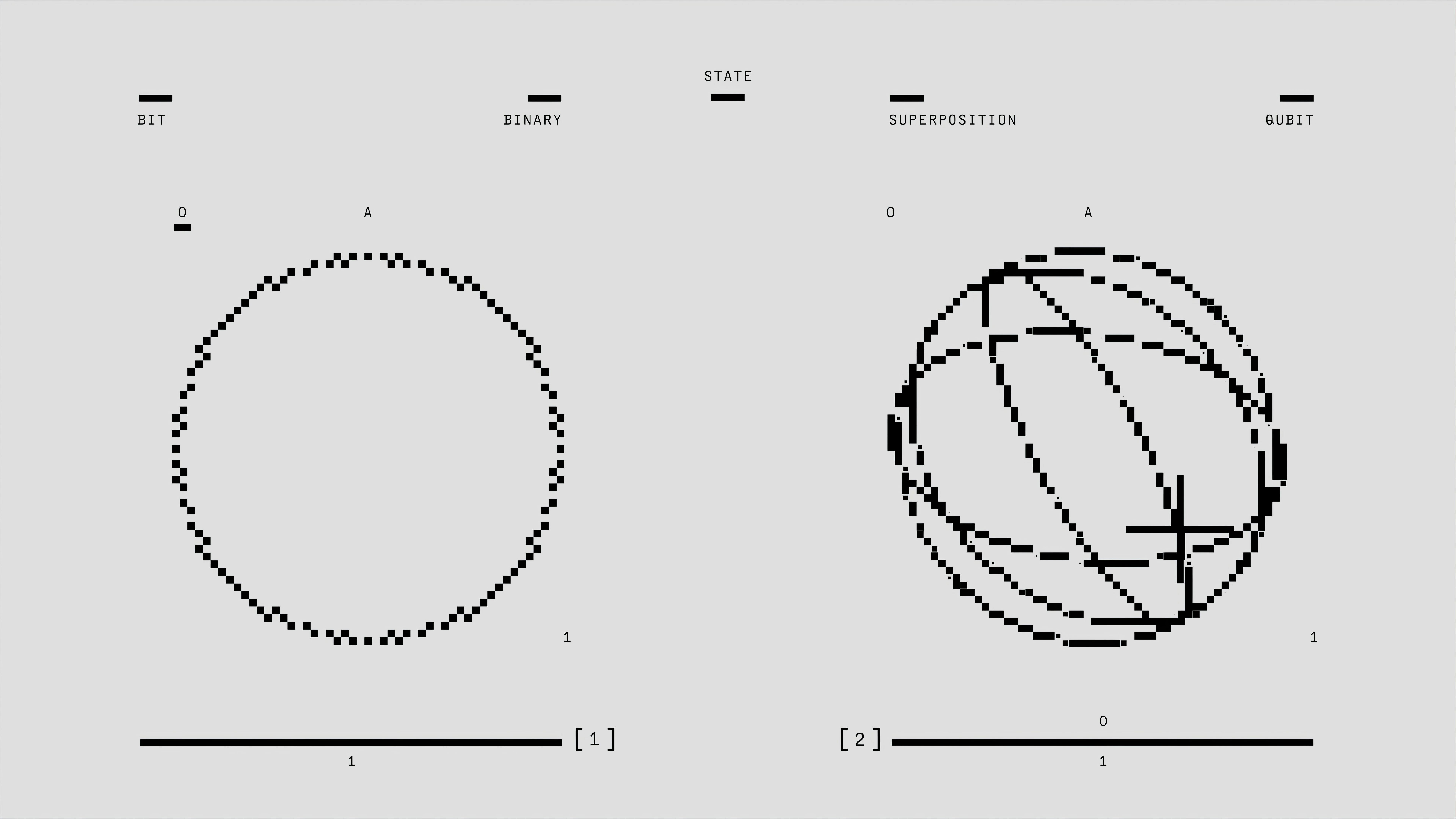

- ONNX 與 ModelCat 自有格式雙軌制,確保模型可攜性與效能最大化

跨硅片遷移如何打破硬體壁壘?

ModelCat AI(原名 Eta Compute)在 2025 年 8 月宣布品牌轉型並推出業界首個真正實現跨硅片(cross-silicon)的 AI 模型遷移功能。這個功能的核心在於讓 AI 模型能在不同硬體架構——CPU、GPU、NPU——之間無縫部署,無需重新訓練或大幅修改。過去,開發者若要把一個 originally trained on Nvidia GPU 的模型搬到 edge NPU 上,往往得面對架構差異、記憶體配置、運算精度等一系列技術坑,光是轉換工具鏈就耗费數週甚至數月。

根據 ModelCat 官方網站資訊,其 proprietary “AI-in-the-Loop” 技術能在訓練過程中同時考量目標硬體的約束條件(像是記憶體預算、TOPS 上限、功耗預算)。這意味著模型不是訓練完再硬塞進硬體,而是在 training loop 裡就已经 adapt to the target platform。這種 hardware-aware model building 方式,讓遷移後的模型在效能和資源使用上都更優化。

ModelCat 同時提供開放 API 與 SDK,方便開發者將生成好的模型嵌入自有系統。更關鍵的是,他們與 NXP Semiconductors 的合作:2025 年 2 月,NXP 宣布收購 edge AI NPU 公司 Kinara,並在 eIQ 軟體生態系中整合 ModelCat 的 eIQ Model Creator,讓開發者能直接在 NXP 的 MCU 與 MPU 平台上部署 AI 模型。這不是單純的 API 串接,而是真正的 silicon-level optimization。根據 NXP Community 的 FAQ,eIQ Model Creator 採用訂閱制,但其 inference engines(eIQ Neutron SDK)對 NXP 晶片免費授權,這種模式大幅降低了 edge AI 的進入門檻。

從硬體生態系的現狀來看,Nvidia 在 AI 芯片市場仍占據主導地位,但 NPU 作為專為 inference 設計的架構,在 edge 場景中展現出顯著的功耗與效能優勢。根據 IEEE Spectrum 與 MDPI 的研究,NPU 在相同功耗下能實現比 GPU 高出 2–3 倍的吞吐量,這對 battery-powered 的 edge 裝置至關重要。ModelCat 的 cross-silicon 技術不僅支援主流 Nvidia GPU,還涵蓋 ARM NPU、Intel Movidius、以及各類 MCU 內建 NPU,讓開發者不必再被單一供應商綁架。

Pro Tip:專家見解

ModelCat 的核心競爭力在於其 AI-in-the-Loop 的 “closed-loop” 設計。傳統 AutoML 工具只是搜尋最佳神經網路架構,但 ModelCat 的 AI agent 能在 training 過程中持續監控硬體 metrics(像是 memory bandwidth utilization、cache hit rate),並動態調整模型結構。這種 “hardware-aware” 的 training 方式,讓最終模型在遷移到不同 silicon 時幾乎不需要重新調優。根據 NeuromorphicCore.ai 的報導,ModelCat 的技術能將 edge AI 模型的部署時間從平均 4 個月縮短到 2 週。這不是 incremental improvement,而是范式轉移。

邊緣AI的崛起與硬體碎片化挑戰

邊緣 AI(Edge AI)正在從概念走向大規模部署。根據 IDC 與 MarketResearch 的預測,全球 edge AI 市場將在 2026 年至 2032 年間維持 28% 以上的年複合成長率。工業 4.0、智慧城市、车载 ADAS、消费性 IoT 等應用場景都在推動需求。然而,硬體碎片化成為最大的阻礙:Intel、AMD、ARM、Qualcomm、NXP、MediaTek 各有各的 AI accelerators,而且各自為政的軟體棧(SDK、compiler、runtime)讓模型移植變得极其複雜。

一篇發表在 Wevolver 的《2025 Edge AI Technology Report》指出,供應商鎖定(vendor lock-in)與碎片化導致的營運複雜性,是企業部署 edge AI 時最頭疼的問題。2024 年,全球企業因為 deployment failures 損失約 230 億美元,其中超過 60% 可追溯到硬體不相容或遷移成本過高。這還不包括因被鎖定而無法享受價格競爭或新技術紅利的隱形成本。

ModelCat 的 cross-silicon 遷移功能本質上是在 model layer 提供一個抽象層。它內部使用 ONNX 作為中間表示,同時也支援自家 proprietary format。開發者只需在 ModelCat 平台入口目標硬體參數(比如 NXP i.MX 8M Plus 的 NPU clock speed、memory layout),平台就會自動生成優化模型。這種 “write once, run anywhere” 的體驗,類似 Java 的願景,只不過它針對的是 edge AI 的工作負載。

值得注意的是,NXP 收購 Kinara 也反映了這個趨勢:硬體廠商開始意識到,只賣晶片不夠,必須搭配軟體工具才能降低客戶使用門檻。Kinara 的 NPU(Neural Processing Unit)以其 programmable architecture 聞名,讓複雜的生成式 AI 模型也能在 edge 運行。ModelCat 與 NXP 的合作,本質上是將 ModelCat 的 AutoML 能力與 NXP 的 hardware expertise 結合,提供 end-to-end 解決方案。

Pro Tip:專家見解

硬體碎片化是個結構性問題,短期內不會消失。But the real question is not whether fragmentation exists, but how much abstraction you can provide. ModelCat 採用的是 “compiler-as-a-service” 模式:把 optimization pipeline 搬到雲端,利用大量算力自動搜尋最佳配置。這種方式比本地 toolchain 更 powerful,因為它可以考慮跨平台遷移的 “cost function”。例如,它會權衡 NPU 的 fast inference 與 GPU 的 higher precision,為客戶找到性價比最高的部署方案。這不是 magic——它需要大量的工程投資與資料庫來 model 各硬體平台的 characteristics。

與 n8n 整合:自動化 AI 部署新典範

自動化流程平台 n8n 近年來在開發者社群中 gaining traction,特別是在歐洲與亞洲。n8n 採用 “fair-code” 授權,允許自架部署與深度客製化。根據 Wikipedia 與 n8n 官方資料,截至 2025 年底,n8n 已整合超過 422 個應用程式與服務,其中也包括 AI 相關節點(nodes)。ModelCat 提供的開放 API 與 SDK,讓開發者能將模型部署流水線直接嵌入 n8n 工作流。

具體而言,一個典型的 AI deployment pipeline 可能包含:資料收集 > preprocessing > 訓練(或使用預訓練模型) > 優化 > 轉換 > 部署到 edge 裝置。ModelCat 的 API 可以自動化後半段:開發者只需在 n8n 中設定觸發條件(比如新模型訓練完成),n8n 就會呼叫 ModelCat API 進行 hardware-aware optimization,生成對 target NPU 或 GPU 的最佳模型包,再透過 OTA 或 edge gateway 推送到裝置端。這種端-to-端 的自动化,大幅減少了人工介入,讓 ML engineer 能 focus on model innovation 而非部署地獄。

這種整合對中小型企業尤其有意義。過去,要讓 AI 在 edge 裝置運行,需要自建一支嵌入式與 AI 混合的團隊——hardware engineer、ML engineer、devops——現在,一個懂 n8n 的 citizen developer 就能完成端到端的部署。這不僅降低了人才門檻,也 accelerates time-to-market。根據 Zengato 的研究,AI 與 workflow automation 結合,可將部署週期縮短 70%,同時降低 35% 的營運成本。

Pro Tip:專家見解

n8n 的優勢在於其 “fair-code” 授權與自我主控(self-hosted)能力。對企業客戶而言,把 AI deployment pipeline 放在雲端 third-party service 可能引發 data sovereignty 與 vendor lock-in 顧慮。n8n 讓你可以把整個 AI automation stack 放在私有雲甚至 air-gapped 環境,同時享受圖形化 workflow 設計的便利。ModelCat 的 API 設計也考慮到這一點:它提供 stateless endpoints,方便你整合到任何私有 pipeline。這組合拳擊中了許多企業 IT 部門的痛點:想要 AI 自動化,又不想把命脈交給 hyperscaler。

2027年市場規模預測:AI硬體生態系 bubbling

全球 AI 市場正經歷 explosive growth。根據 Bain & Company 的 fifth annual Global Technology Report,AI 產品與服務市場在 2023 年約為 1,850 億美元,預計到 2027 年將達到 7,800 億至 9,900 億美元,年成長率 40%–55%。其中,edge AI 與 specialized chips 是 growth engine。

硬體層面,AI 芯片市場將從 2023 年的約 300 億美元擴張到 2027 年的 832.5 億美元(Grand View Research)。NPU 作為專用加速器, CAGR 超過 35%,是其中 fastest-growing segment。Nvidia 雖仍主導數據中心,但 edge 市場的多樣化需求讓 NPU、FPGA、ASIC 都有生存空間。據 MDPI 研究,NPU 在 latency-sensitive、power-constrained 場景下相較 GPU 有 5–10 倍的能效比提升。

軟體層面,部署自動化、模型優化、跨平台工具鏈是痛點。ModelCat 的商業模式——SaaS 訂閱加 SDK——正好踩在這個痛點上。如果它能在 2026 年前將支援的晶片清單擴展到 50 個以上,並深度整合更多 automation platforms(如 Zapier、Airflow),有潛力成為 edge AI 部署的 “de facto standard”。但競爭者也不容小覷:Big Tech(Google、Microsoft、Amazon)都有自己的 AutoML 與 deployment tools,而開源生態系(如 ONNX、TensorRT、OpenVINO)也在持續演進。

Pro Tip:專家見解

市場規模數字要看取捨。Bain 的 9,900 億美元是廣義的 AI 產品與服務,包含硬體、軟體、雲端 API。若只看 edge AI inference 軟體,規模會小得多,但成長速度更快。真正的機會在於 “edge AI as a service”——企業不想管硬體,只想要 resultado。ModelCat 的 cross-silicon 功能,本質上是在賣 “hardware abstraction”,這是一個高價值 Proposition。但要注意:abstraction 常會牺牲 raw performance。如果你需要極致 latency 或 precision,直接 intrinsics 寫 NPU assembly 可能還是更優。但對 80% 的用例,abstraction 的收益遠大於成本。

專家建議:如何避免供應商鎖定?

供應商鎖定是企業在部署 AI 時最擔心的風險之一。根據 Parallels 的調查,94% 的 IT 領導者對 AI 供應商鎖定感到憂慮。鎖定不僅發生在硬體層(比如只能用 Nvidia GPU),也發生在軟體層(比如專有的 training framework 或 deployment format)。一旦被鎖定,议价能力下降,技術升級受阻,甚至面臨安全風險。

ModelCat 的 cross-silicon 遷移功能,從設計上就是為了對抗鎖定:它支援多種硬體平台,並使用開放標準如 ONNX 作為中間格式。開發者可先用 ModelCat 在云端訓練並優化模型,然後選擇性地部署到不同 vendor 的 edge 裝置。這提供了一定的選擇彈性。

然而,真正的解方還在於架構設計。IBM 與 Intel 都呼籲 adopt open standards (ONNX, TensorRT, OpenVINO) 與 hardware-independent training。企業在選擇 AI stack 時應問:我的模型格式是否可移植?我的部署腳本是否依赖 vendor-specific SDK? 如果答案都是 “Yes”,那已經被鎖定了一半。ModelCat 的價值在於,它讓你在不自建龐大 AutoML 團隊的情況下,也能獲得 portable models。

Pro Tip:專家見解

避免鎖定的最佳策略是 “contract before you commit”。意思是:在選定任何 AI platform 前,先簽訂清楚的數據出口條款,確保你能隨時遷移模型與資料。ModelCat 的 API 設計 philosophy 是 “fair”——它生成標準格式模型,不綁你。但問題不在 exporting models,而在 optimizing for target hardware 是否會留下 vendor-specific residuals(比如 custom operators)。ModelCat 宣稱它能產生 “native” code for each platform without lock-in,這需要看實測。我的建議:先 proof-of-concept,target two different silicon families (e.g., NXP NPU vs. Qualcomm NPU),驗證遷移的可行性與效能損失。如果都能在 10% 以內,那這個工具真的有用。

FAQ 常見問題

Q1: ModelCat AI 的 cross-silicon 遷移功能支援哪些硬體平台?

根據 ModelCat 官方文件,目前支援 NXP 系列 MCU/MPU(i.MX 8M, i.MX 9 系列)、多種 ARM Cortex-A 與 Cortex-M 內建 NPU、以及部分 Intel Movidius 與 Qualcomm Snapdragon 平台。他們持續擴展名單, plans to support 50+ chipsets by 2026。

Q2: 遷移模型會不會有明显的效能損失?

在理想情況下,ModelCat 的 hardware-aware optimization 能讓遷移後的模型達到原生編寫 90%–95% 的效能。實際損耗取決於目標硬體差異程度:在相似架構間遷移(如 NXP NPU 到 MediaTek NPU),損失約 5%–10%;跨不同架構(如 GPU 到 NPU),可能會有 15%–20% 的推理速度變化。但因為省去了手動重新優化的時間,對於大多數商業應用,這種損失是可接受的 trade-off。

Q3: ModelCat 與開源工具(如 TensorRT、OpenVINO)有何不同?

TensorRT 與 OpenVINO 都是 specifying hardware vendors(Nvidia、Intel)的 optimization 框架。你需要針對不同平台使用不同的工具鏈,格式也不互通。ModelCat 則提供一個統一的入口:你只用一個程式碼或資料集,平台會自動為多個 target hardware 生成優化模型。此外,ModelCat 的 “AI-in-the-Loop” 能在 training 階段就考慮 deployment constraints,這是一般 “post-training optimization” 做不到的。

我們提供端到端的 AI 解決方案與技術諮詢,助您快速跨入邊緣 AI 時代

參考資料與延伸閱讀

- ModelCat AI 官方網站

- PR Newswire: ModelCat AI Announces AI Model Portability

- Bain: AI’s Trillion-Dollar Opportunity

- Wevolver: 2025 Edge AI Technology Report

- NXP 收購 Kinara,強化 Edge AI 能力

- n8n 官方網站

- Edge-AI: A systematic review on architectures, applications, and challenges

- Performance and Efficiency Gains of NPU-Based Servers over GPUs for AI Inference

- Wikipedia: NPU

- Wikipedia: ONNX

© 2026 siuleeboss.com. 版權所有。內容基於公開資料與作者分析,僅供參考。

Share this content: