AI成本優化是這篇文章討論的核心

📌 一分鐘掌握核心

- 💡 核心結論: AI 競爭軸心已從「模型能力」轉向「推理成本」,280 倍降價實測數據證明技術紅利轉向

- 📊 關鍵數據: 2027 年 AI 市場規模上看 9900 億美元,推理成本年降 40 倍,企業 IT 預算將重分配

- 🛠️ <行動指南> 採用模組化架構、評估 MoE 模型、追蹤 quantization 技術,預算重新配置至 inference optimisation

- ⚠️ 風險預警: 訓練成本反升 2.4 倍/年,過度消耗 token 可能抵消單價優勢,vertical-specific model 將重構人力需求

AI 成本崩盤 280 倍:2026 年企業將被迫重新思考everything

AI 成本暴跌 280 倍:背後的技術驅動力是什麼?

根據 Stanford AI Index 2025 報告,GPT-3.5 等級的推理成本在 2022 年 11 月到 2024 年 10 月間整整跌了 280 倍。這數字太瘋狂——等於你的 AI 助理從每天燒掉 20 美元變成年只需 2 美分。

但關鍵在第二層次:訓練成本反而在狂飙。頂尖模型的訓練支出每年膨脹 2.4 倍,像 OpenAI、Anthropic 這些玩家砸錢越來越大手筆。2026 年的矛盾現象是:教 AI 拉的第一次大便(training)越來越貴,但讓它不斷跑推理(inference)反而便宜到荒唐。

Pro Tip: 關注 quantization(量化)技术与 MoE(Mixture of Experts)架構。從 FP16 到 INT4 的跳躍讓模型體積縮小 4 倍,記憶體佔用腰斬,這才是成本崩盤的核心動力,不是單純的晶片升級。

專家見解: Stanford AI Index 共同主席 Jack Clark 指出,『280 倍的降幅幾乎是 ekonomisk 奇蹟,但绝大多数企業尚未將此轉化為戰略優勢。』真正的機會不在於買到更便宜的 API,而是重建內部推理管線,將 batch size 優化與 speculative decoding 導入日常部署。

數據佐證:Epoch AI 研究顯示,達到 GPT-4 在博士级科学问题上的性能,成本每年下降 40 倍。这意味著同一水平的 AI 能力,每过一年就只需前一年的四分之一價格。

為何 2026 年企業更關注「推理成本」而非模型能力?

先問一個反直覺問題:如果你的 AI 模型能力提升 10 倍但成本只降 2 倍,你選哪個?2026 年的答案是——要便宜的。因為商業場景回本計算非常殘酷:AI 功能要量產到百萬級用戶,單次 inference 成本差幾分錢,總支出就能差出數千萬美元。

Forbes 分析指出:『訓練建立了 AI 繁榮,但推理才是真正的經濟前沿。』這句話點破本質:訓練是一次性的大型資本支出,推理是持續的營運成本。企業最終要面對的是每月賬單,而不是學術榜單排名。

根據 Gartner 預測,2026 年全球 AI 相關支出將達到 2.52 兆美元,年增 44%。這個天文數字背後,企業終於學到一个功課:不要為了極端場景過度配置模型規模。與其用 GPT-4 處理客服問答,不如用小型化的 Domain-specific 模型,latency 更低、成本更可控。

案例佐證:AZ Innovate Hub 的 CTO 指南显示,2025 年第四季企业正通过三个axis降低成本:雲端策略、neocloud OpEx 模式、以及硬體優化。典型方案包括使用 quantized models 把 GPU memory footprint 降低 60%,同时将 batch inference 吞吐量提升 3 倍。

Pro Tip: 關注「inference optimization」这个新兴vendor类别。不是买更便宜的 GPU,而是通过 compiler-level optimizations(如 TensorRT-LLM、vLLM)把同一hardware的 tokens/sec 推高到极限。

專家見解: former OpenAI policy director Jack Clark 警告,『成本下降带来的 democratization 意味着竞争门槛降低,也会加剧 token consumption 的 exponential growth——这就是所谓的 LLM Cost Paradox:更便宜的模型可能因为使用量暴增而让你破产。』

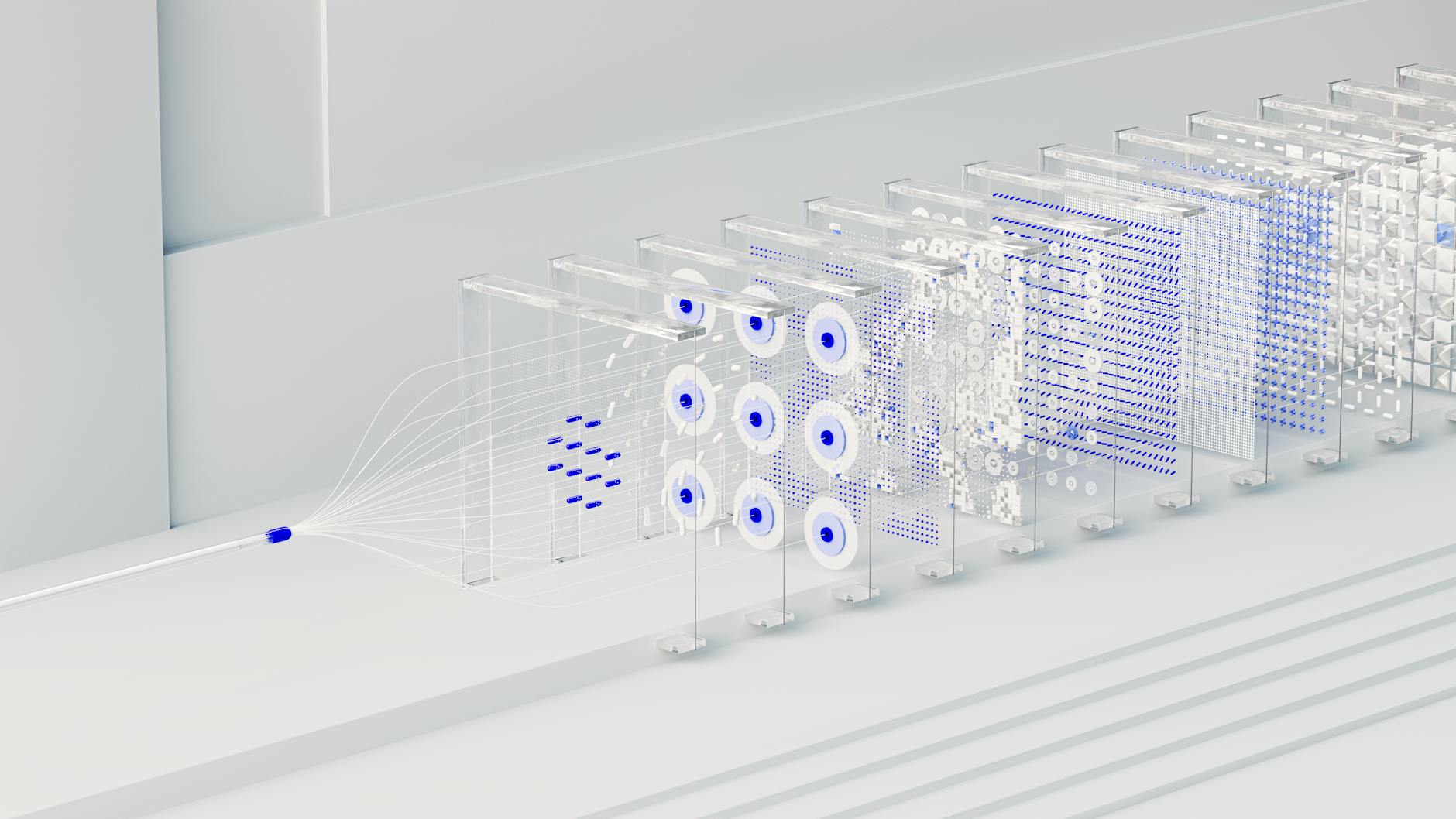

模組化 AI 如何重塑未來部署架構?

2026 年最大的架構轉向是: abandoning the monolith。不再想著訓練一個萬能模型,而是組裝一個生態系統。Modular AI 成為 buzzword,但核心思想很簡單:把大模型拆成可重用的 skills、agents、workflows。

Spring AI 的 Agent Skills 示範了這種思維:domain knowledge on demand,更新 agent behavior 不需要改程式碼,項目之間可以共享 skills,还能在不同 LLM provider 之間無痛切換。這听起来像软件工程的最佳实践,但在 AI 领域,它直接影響部署成本和敏捷性。

General Robotics 的 GRID platform 就是具体实现:統 simulation、AI models、deployment workflows 成一個 plug-and-play 系統,用 reusable skills 加速機器人開發。这類方案让企业能快速迭代,而不必每次从头训练。

具体收益:reusable skills 让同一个 NLP 模块能在客服、合規、銷售三個場景重複使用,不需要分別訓練三個獨立模型。Modular 公司的 26.1 版本強調 developer velocity,把跨 hardware 部署的複雜性抽象化,這對於 2026 年要同時管理 GPU、TPU、NPU 的企業是剛需。

Pro Tip: 模組化不只是技術選擇,更是成本控制策略。當 inference 按 token 計費時,把工作流拆成多個 specialized agents,每個都選用最便宜的模型,總成本可能比單一大模型低 60% 以上。

千億美元市場:成本下降將如何引爆新興垂直領域?

Bain & Company 的預測很鮮明:AI 市場將從 2023 年的 1850 億美元,一路沖到 2027 年的 7800-9900 億美元,年增率 40-55%。但的数字背后是 cost-driven adoption:只有變便宜,才會從『錦上添花』變成『基礎設施』。

Vertical-specific AI 是最大贏家。醫療、金融、製造、教育的 AI 應用,過去因為 customization 成本太高而卻步,現在 inference 成本暴跌,意味著可以為醫院訓練專用 LLM,為銀行部署 fraud detection agent,成本都变得可承受。

更重要的是人力需求重構。Advisor Perspectives 警告:『更便宜的 AI 解決方案將可能令於人力需求上產生重構。』这可不是演算法取代人类的陈词滥调——而是具体到『客户服务中心从 100 人減到 30 人,加上 5 個 AI 管理員』的計算。

Statista 的数据显示 2026 年 AI 市场规模约 3470 亿美元,但 Gartner 的 2.52 兆美元包含了所有 AI-enabling 支出。差异在定义——無論如何,都指向同一个趋势:企业正在把 AI 从『试点项目』拨到『核心预算』。

Risk warning: 当你看到『更便宜的 AI』广告时,必须检查三个隐藏成本:1) Fine-tuning 和部署的工程人力 2) 数据 pipeline 的运维开销 3) 快速增长的 token 消耗带来的意外账单。LinkedIn 上的『Inference Paradox』文章指出,虽然 per-token 价格下降,但总支出可能因 usage explosion 而上升。

結局:你的 2026 AI 策略該怎麼寫?

老實說,多數企業的 AI 策略還停留在 2022 年——追求更大參數量、更高 benchmark 分數。但市場信號已經明確:inference cost 的 collapse 正在重新定義價值鏈。

你的行動清單应该是:

- 成本建模: 把 AI 支出拆分為 training、fine-tuning、inference、ops,計算 inference cost per token 的 floor price。

- 架構重評: 評估 modular/agent-based 方案是否比 monolith 更省錢,哪怕初期複雜度更高。

- vertical-specific 投入: 在一個核心業務流程(如客服合規 review)部署 specialized model,驗證 ROI。

- 供應鏈談判: 與雲端/vendor 協商 inference pricing 時,用量化後的 cost per outcome 代替 per-token metric。

2026 年不會屬於『最聰明』的 AI,而是屬於『最懂省錢』的企業。280 倍的降價幅度不是终点,而是起点——接下来還有 1000 倍、10000 倍。那些提前重構部署架構、拥抱模組化的玩家,將在市场 2027 年衝擊兆美元關口時,佔据成本和敏捷性的雙重优势。

FAQ

AI 推理成本下降是否意味著 AI 模型能力也在同步提升?

不一定。推理成本下降主要来自硬件优化、量化技术和架构效率提升,与模型能力提升不直接挂钩。事实上,许多小型化模型(如 7B 参数的 Llama)通过优化可以在特定任务上达到大模型效果,但成本仅为 1/100。

企業應如何在 2026 年重估 AI 部署策略?

企业应将重点从模型选型转向推理管线优化:评估 quantized models、采用 MoE 架构、实施 modular skills 复用,并与供应商协商以 outcome-based 定价代替 token-count 计价。

模組化 AI 是否適合所有企業場景?

模組化特别适合需要多场景复用、快速迭代、以及成本敏感的生产环境。但对于极端高性能需求或安全性至上的单一场景, monolithic models 仍有其价值。关键是根据业务用例灵活选择。

📞 準備好了嗎?

如果你的企业正面临 AI 成本失控或想规划 2026-2027 年的 AI 转型,我们 siuleeboss.com 团队可以提供深度咨询。

延伸閱讀與驗證數據來源

- Advisor Perspectives – AI Needs to Get Cheaper, Not Smarter

- Stanford AI Index 2025 Report (官方數據來源)

- Bain & Company – AI’s Trillion-Dollar Opportunity

- Gartner – Worldwide AI Spending Will Total $2.5 Trillion in 2026

- Epoch AI – LLM inference prices have fallen rapidly

- Modular – Release 26.1

- Spring AI – Agent Skills for Modular Reusable Capabilities

Share this content: