在人工智能(AI)蓬勃發展的時代,人們不僅關注技術突破,更重視其安全性和倫理影響。Anthropic,一家由 OpenAI 前成員創立的 AI 公司,以「安全第一」的理念,致力於開發可靠且可信賴的 AI 模型,其代表作 Claude 正逐漸在業界嶄露頭角,挑戰 ChatGPT 和 Gemini 的地位。本文將深入探討 Anthropic 的發展歷程、Claude 的獨特優勢以及它對 AI 發展的潛在影響。

Anthropic 的崛起:安全 AI 的希望之光?

Anthropic 成立於 2021 年,由 OpenAI 的前成員 Dario Amodei 和 Daniela Amodei 兄妹領導,他們認為 OpenAI 逐漸偏離了初衷,將盈利和技術突破置於 AI 安全之上,因此選擇離開並創立 Anthropic,專注於打造安全的 AI 系統。Anthropic 致力於「研究並開發人工智慧系統的安全與可靠性」,並在公司結構設計上融入「公共利益公司」和「長期利益信託」的概念,以確保在面對潛在 AI 風險時,能夠優先考慮社會和公共安全利益。

Anthropic 成立後迅速獲得大量資金支持,包括來自 FTX 的 5 億美元和亞馬遜的 80 億美元。這些資金讓 Anthropic 在硬體、資料中心和模型訓練上有了更大的投入,並與亞馬遜和 Google 建立了緊密的合作關係。然而,這也引發了外界對 Anthropic 是否會被亞馬遜「功能性收購」的疑慮,Dario 則強調,與亞馬遜和 Google 的合作關係是平衡的,確保了公司的獨立性。

Claude 的演進:從詩意到實用的 AI 明星

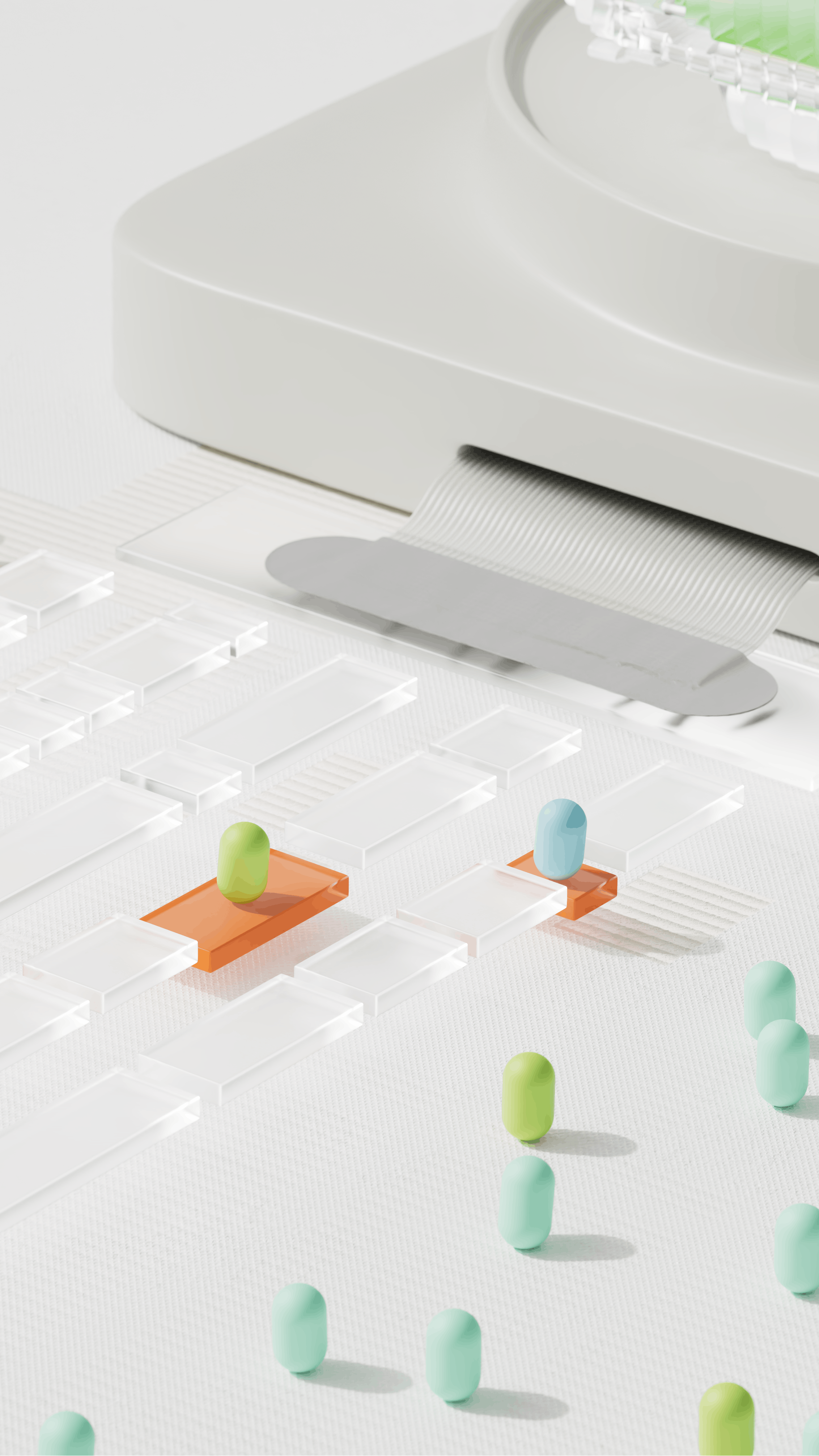

Anthropic 推出的大型語言模型 Claude,被視為與 ChatGPT 和 Gemini 競爭的重要對手。Claude 2 以「憲法式 AI」為核心概念,嘗試運用一份「憲法」做為倫理與行為守則,讓模型能夠自我評估和調整,以達到「有益、無害、誠實」的目標。Claude 3 更是推出 Opus、Sonnet 和 Haiku 三個不同規模的模型,其中 Opus 在多項基準測試中超越了 GPT-4 和 Gemini Ultra。Claude 3.5 和後續版本在程式碼撰寫、多步驟工作流程、圖表解讀等方面都有顯著進步,並已推出企業版服務和 iOS App,顯示 Anthropic 強烈的市場擴張意圖。

Claude 在技術社群中受到不少肯定,被認為在程式撰寫速度和邏輯連貫度上具有優勢。然而,它仍然存在一些挑戰,例如在特定領域的內容辨識度和邏輯推斷力方面可能比不上 GPT-4 等競品。此外,Anthropic 也面臨著版權爭議,被音樂出版商指控 Claude 侵犯歌詞版權。這些挑戰提醒我們,AI 的發展需要在技術創新和倫理規範之間取得平衡。

Anthropic 的商業結構與願景

Anthropic 註冊為特拉華州的公共利益公司,其董事會需要平衡股東利益與公共福祉。他們還設立了「長期利益信託」,由無財務利益的成員管理,以確保公司在面對「災難性風險」時優先考慮安全,而非利潤。

Dario Amodei 對 AI 的未來充滿樂觀,他預測 AI 將在 2026 年達到通用人工智慧(AGI),解決癌症、傳染病等問題,甚至延長人類壽命至 1,200 年。他認為,AI 投資將帶來無與倫比的回報,創造一個「天才國度」。

Anthropic 的前景與未來動向

Anthropic 將繼續提升 Claude 的性能,使其在各個領域都能展現

相關連結:

Share this content: