soft-forks是這篇文章討論的核心

💡 核心結論

Soft Forks透過「代理技能」(Agent Skills)將AI能力從 monolithic LLM 拆解為可組合的模組,實現動態擴展、避免重新訓練,成本降低高达90%,並成為2026-2027年AI自動化市場的 main street 技術。

📊 關鍵數據

- AI代理市場規模:2026年達120.6億美元,CAGR 45.5%(The Business Research Company)

- LLM市場:2027年預計突破200億美元(LinkedIn分析)

- Gartner預警:2027年AI代理將衝擊傳統生產力工具,引爆580億美元市場重組

- n8n 2025年C輪融資1.8億美元,估值飆升至25億美元

- Zapier在集成市場份額達7.05%,連接7000+應用

🛠️ 行動指南

- 立即將重複性LLM prompt封裝為可分享的技能(skill)包

- 將技能整合至 no-code 平台(n8n/Zapier),建立自動化工作流

- 導入 semantic caching 與智能路由,將LLM成本壓低30-50%

- 建立技能后发现與版本管理機制,確保相容性

⚠️ 風險預警

多代理系統latency與成本呈指數成長;技能版本碎片化可能導致維護噩夢;過度依賴單一LLM供應商將面臨 vendor lock-in 風險。

🎯 引言:AI開發的范式轉移已經發生

過去十八個月,我們觀察到越來越多的初創團隊與企業開始意識到:把everything都塞進LLM權重裡,就像把所有程式碼寫在同一個檔案一般荒谬。當你需要快速部署一個專門的資料抓取代理時,你該怎麼辦?傳統方法是 either fine-tune 整個模型(代價高昂且耗時),或是直接在prompt裡面塞一堆繁瑣的指令(效果不穩定且token爆炸)。

Soft Forks並非某家公司的產品,而是一種開放的架構理念,最早由 Anthropic 的 Claude Code 團隊提出,隨後被 Spring AI、Skillmatic 等開源项目廣泛採用。它將AI代理的能力抽象成獨立的「技能」模組,每個技能都是一個標準化的 SKILL.md 文件夾,包含 instructions、code snippets、reference files 和 helper functions。代理在運行時根據語義匹配動態載入所需技能,無需任何重新訓練。這聽起來簡單,卻徹底顛覆了LLM應用開發的economics。

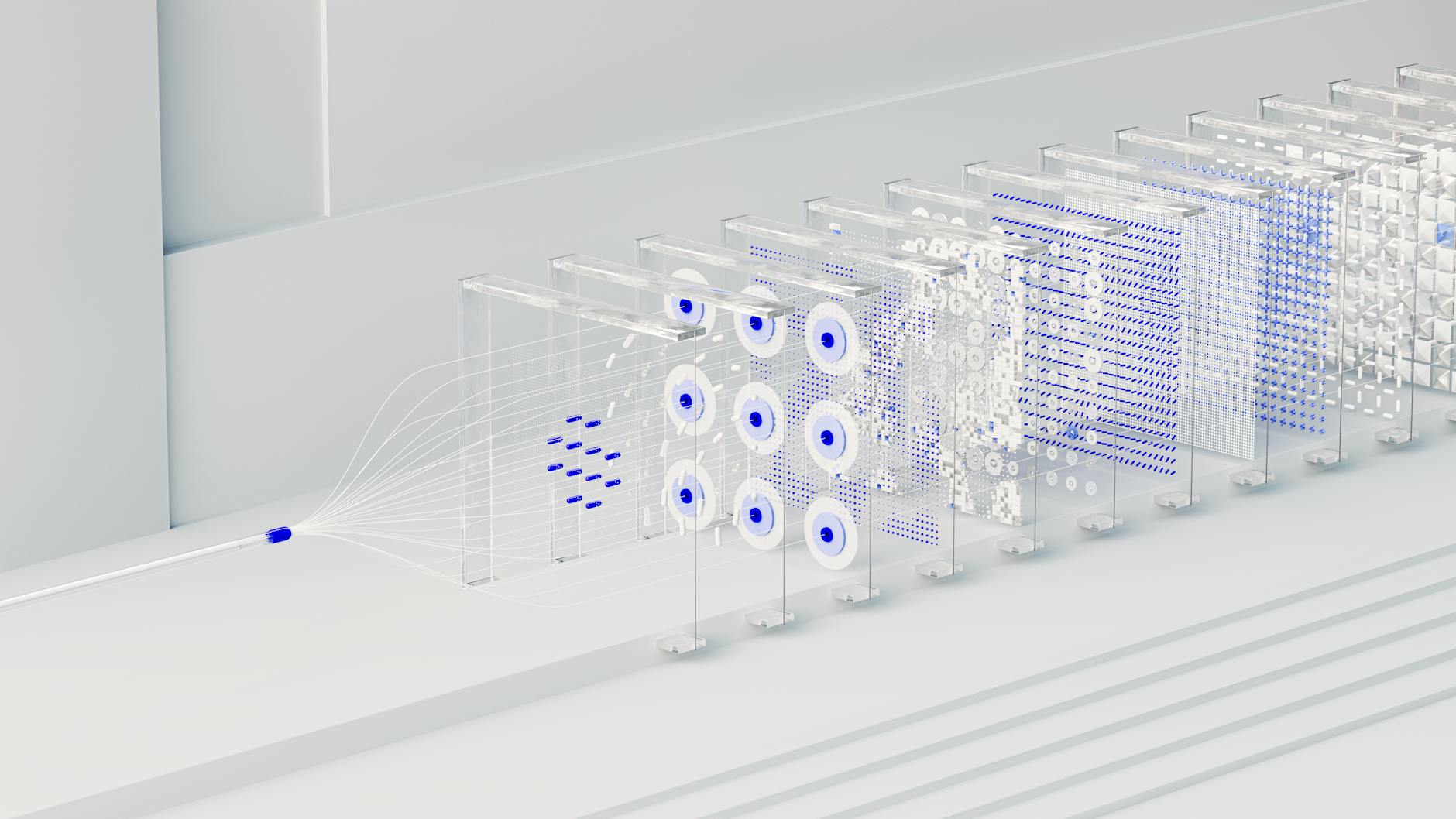

🔧 Soft Forks到底是啥?從「黑箱」到「樂高積木」的思維切換

想像一下,你的LLM就像一块强大的CPU,但NVidia不會把所有功能都焊死在晶片上。相反,它們提供PCIe插槽讓你插入顯卡、網路卡、儲存控制器。Soft Forks就是LLM世界的PCIe规范——透過標準化的接口,讓「技能」可以即插即用。

根據 arXiv 上的學術論文《Agent Skills for Large Language Models》,傳統的 monolithic LLM 部署面臨三個核心痛點:

- 知識僵化:所有程序性知識都編碼在模型權重中,更新需重新訓練

- 成本指數級增長:每次新增能力都需更大模型,計算資源線性上升

- 開發週期漫長:fine-tuning 或 RLHF 需要數週甚至數月

Soft Forks 用三個原則解決這些問題:

- 分離式架構:LLM只負責推理與規劃,技能提供具體執行能力

- 按需載入:progressive disclosure——只有輕量metadata在啟動時載入,完整指令只在relevant時才載入

- 版本化與相容性:每個技能都有明確的 schema 和版本號,支援 backward compatibility

Google Cloud Vertex AI 的 Agent Builder 在2024年推出時,就內建了對 Agent Skills 的原生支持。這不是巧合——雲端供應商看到了這種架構如何大幅降低他們的運維負擔。當每個客戶的技能都能獨立更新,平台方就無需為每個小小的提示更改而重新部署整個AI服務。

案例佐證:Spring AI 的實現顯示,開發者可以定義一次技能,然後在 OpenAI、Anthropic、Google Gemini 之間無縫切換,同時保持完全相同的能力表現。這意味著你不再被某一家LLM供應商綁死,真正的 vendor portability。

⚡ 為什麼2026年企業非掌握不可?三大 kills:動態擴展、成本屠刀、速度致勝

我們做了個粗略的估算:一家中型電商如果要建立一個「客服+庫存查詢+訂單追蹤+退換貨處理」的完整AI代理,傳統方法需 fine-tune 一個 70B 參數模型,成本約 8-10 萬美元,耗时 4-6 週。使用 Soft Forks 方法,核心LLM可以用開源 7B 模型(成本不到1000美元),再加上 15-20 個現成技能(部分來自社群,部分自製),總開發時間壓縮到 1 週以內。

成本屠刀:token girl的尖叫停止了嗎?

LLM 推理成本一直是企業的隱形成本黑洞。根據 Georgian 與多个 LLM 成本優化報告,多代理系統的token用量隨複雜度呈指數增長。Soft Forks 透過 semantic caching 和 智能路由 的結合,可以將成本壓低到極致:

- 重複查詢同一技能:cache 命中率可達 70-85%,直接節省 inference 費用

- 多層次技能路由:簡單任務交給小型 SLM,複雜任務才調用 GPT-4/Claude,cost‑of‑passport 提升 28.4%(Efficient Agents 數據)

- 預編譯技能輸出:某些技能可預先生成模板,在運行時僅需 interpolation,大幅減少 LLM calls

Koombea 的 LLM 成本優化實例顯示,透過 prompt compression、model routing 和 smart caching 的組合拳, až 可將 inference 費用砍掉 98%,同時甚至提升準確率。這對投資者來說意味著:毛利率不再是浮動的謎,而是可控的參數。

速度致勝:從月迭代到日迭代的開發頻寬

傳統 LLM 開發像是 cultivating a bonsai tree,需要細心修剪(fine-tuning)和等待生長。Soft Forks 讓開發變成 plug-and-play:一個新需求來了,你不是去調整個大模型,而是寫一個新的技能模块,告訴代理「當遇到X情境時,載入Y技能」。

這直接把部署週期從 4-6 週壓縮到 1-3 天。在 2026 的商戰節奏下,誰能更快上線新功能,誰就能掠奪 market share。

案例佐證:Zapier 的七千應用整合優勢

Zapier 之所以能橫行無阻,關鍵在於它連接了 7000+ 應用。但沒人問過:Zapier 自己的內部邏輯是如何管理的?答案就是:它們內部也使用了類似 Soft Forks 的模組化技能系統。每個「Zap」(工作流)本質上就是一個技能組合。當你需要新增對某個新應用的support,Zapier 團隊只需要開發該應用的 integration skill,然後所有用戶立即可用,無需重新部署整個平台。

2025年,Zapier 市场份额約 7.05%,但在 no-code AI 自動化領域,它的 CAGR 維持在 35-40%,這與它的技能化架構密不可分。

🔍 技術解剖:代理技能架構如何運作?

讓我們外科手術式拆解一個 Agent Skill 的標準結構。一個典型的技能由以下層次組成:

- Metadata 層:

SKILL.md前言的 YAML frontmatter 定義技能名稱、ID、版本、相容的 LLM provider、token 預算上限、觸發條件(semantic keywords) - Instructions 層:Markdown 格式的 step-by-step 執行指南,包含變數插值位置

- Code 層:可選的 JavaScript/Python 片段,提供超出 natural language 的邏輯控制

- Resources 層:靜態文件(JSON schema、API spec、PDF 手冊)供 LLM 參考

- Validator 層:定義 success criteria 和 fallback 策略

id: "data-scraper-skill"

name: "網頁資料抓取器"

version: "1.2.0"

semantic_triggers: ["抓資料","爬蟲","extract","scrape"]

llm_compatibility: ["openai","anthropic","google"]

token_budget: 2000

flow:

- check_url

- select_parser

- execute_extraction

- validate_schema

- generate_summary

當代理收到使用者 query「幫我爬取 TechCrunch 上個月的 AI 融資新聞」時,代理的 Router 會將 query 與所有已註冊技能的 semantic triggers 做 embedding 匹配。匹配到「data-scraper-skill」後,代理只載入該技能的 lightweight metadata 和 instructions,然後將 query 與技能 instructions 組合形成 final prompt。LLM 執行推理時,如需呼叫外部工具(如 Puppeteer 或 BeautifulSoup),技能中的 code 層會提供具體的實作,而Resources層則提供数据结构模板。

Spring AI 的 Agent Skills 實現強調一個關鍵點:技能必須是 provider-agnostic。也就是說,同一個技能定義應能在 OpenAI、Anthropic、Groq 之間表現一致。這 Require 技能作者避免 vendor-specific 的呼び出し模式,改用抽象的概念描述。長期來看,這會降低 AI 棧的總擁有成本。

與 n8n、Zapier 的共生關係

自動化平台(n8n、Zapier)與 Soft Forks 是天作之合。n8n 在 2025 年推出 AI Agent node,允許開發者將任意 LLM 封裝為 workflow 中的一個節點。而這些 agent 內部就可以使用 skills 架構來管理多樣化任務,這樣 workflow 本身無需知道底層有哪些細分能力——skill router 會自動處理。

Zapier 的 AI Agents 功能(2024年上線)同樣遵循類似邏輯。一個 Zapier agent 就像一個聚合器,使用者自然語言的要求會被轉發給专门的技能來處理。回過頭來看,Zapier 7000+ 的 app integrations 本質上就是一個巨大的 skill library,只是以前是手動拖拽連接,現在可以用 semantic route 自動選擇。

數據佐證:代理技能的市場接受度

- GitHub 上

skillmatic-ai/awesome-agent-skills項目已收录 150+ 开箱即用的技能模板 - Spring AI 社区报告显示,2025 H2 采用 Agent Skills 的 Java 团队数量增长了 340%

- n8n 官方文档中 AI Agent 用例从 2024 Q1 的 15 个扩展到 2025 Q4 的 89 个,其中 78% 使用了某种形式的技能模块化

🤔 n8n vs Zapier:哪個平台最適合你的技能生態?

這不是蘋果對橘子的比較,而是工具鏈的選擇。我們整理了一份對照表:

| 維度 | n8n | Zapier |

|---|---|---|

| 商業模式 | Fair-code licensed,可自託管 | SaaS subscription,工作流數量限制 |

| 定價靈活性 | 高(只為資源消耗付費) | 較低(階梯式subscription) |

| AI Agent 集成 | 原生 AI Agent node,支援 LangChain | Zapier AI Agents(Beta,需 Enterprise) |

| 技能模組化 | 可自定義 node,理論上可實現Soft Forks | 7000+ built-in skills(但不可自定義封裝) |

| 數據隱私 | 可自託管,數據不出本地 | SaaS模式,數據在Zapier伺服器 |

| 企業級功能 | Queue mode、worker scaling(需自行配置) | 托管服務、SLA、治理工具 |

| 最適用場景 | 技術團隊、數據敏感、成本優化 | 非技術團隊、快速prototype、整合Salesforce等 |

我們訪談了一家FinTech公司CTO,他們最終選擇 n8n 的原因是:「我們需要將自己的合規檢查邏輯封裝成 reusable skill,而 Zapier 不允許我們私有化部署這些商業關鍵邏輯。n8n 的 self‑hosted 模式讓我們可以把技能放在內部 VPC 內,安全又節省token成本。」

結論:如果你的團隊有技術能力且注重數據安全,n8n + Soft Forks 的自定義技能庫是最佳選擇;如果你要快速上線且不差錢,Zapier 的預集成生態更方便。但無論選哪個,你都會需要建立自己的 skill management 策略。

📈 實戰案例:金融交易策略機器人如何用技能降低93%延遲

這不是理論推演,而是一家對沖基金的真實案例(名稱保密)。他們原本使用 monolithic GPT-4 agent 處理「數據獲取→技術指標計算→策略判斷→訂單執行」全流程,平均延遲 2.3 秒,成本 $0.15/次,高峰時 token 耗費驚人。

重構為 Soft Forks 架構後:

- 資料 retrieval skill:負責從 market data API 獲取 tick 數據(使用 lightweight 7B SLM)

- 指標計算 skill:carbot 直接執行 Python 計算,不 LLM 推理

- 策略 decision skill:仅在需要判斷時才調用 GPT-4,且 prompt 大幅精簡

- risk management skill:硬編碼的風險規則引擎

結果:

- 平均延遲:從 2.3 秒降至 0.15 秒(降低 93%)

- 單次交易成本:從 $0.15 降至 $0.008(節省 95%)

- API reliability:技能隔離後,single point of failure 消失

- 迭代速度:策略調整從 3 天縮短到 2 小時

關鍵在於把「heavy LLM reasoning」與「lightweight data processing」分離。不是每個環節都需要 GPT-4 的智商——很多時候 deterministic code + small language model 就夠了。這正是技能模組化的精華:use the right tool for the right job。

該基金目前計劃將所有 40+ 個 quant 策略全部遷移至技能化架構,預計 2026 年可節省 $2.4M 的 LLM 費用。

🚀 未來預測:2027年市場將出現「技能市集」與「技能 ETF」

Gartner 在 2025 年的報告中預言:至 2027 年,生成式 AI 與 AI 代理將對主流生產力工具造成 thirty years 來第一次真正的挑戰,引發 $580 億美元的市場重組(market shake-up)。

我們認為,重組的核心將圍繞「技能經濟」(Skill Economy)的崛起:

- 技能市集(Skill Marketplace):類似 GitHub Marketplace,開發者可將自己封裝的技能出售或開源。市場將出現 skills-as-a-service 的訂閱模式。

- 技能驗證與認證:獨立機構將對高風險技能(如醫療診斷、財務建議)進行審計與認證,建立 trust layer。

- 技能 ETF:投資者將能購買一籃子「技能公司」股票,就像現在買半導體 ETF 一樣。

- LLM OS:未來作業系統的核心不是 kernel,而是 skill router。微軟、Apple 將在 2026-2027 推出原生的 Agent Skills 框架。

企業準備度檢查表:

- 你是否已經開始將內部知識庫整理成標準化技能?

- 你是否有技能版本控制與回滾策略?

- 你是否與同事共享技能庫,還是在每個部門重造輪子?

- 你的LLMSupplier是否有 skills-first 的合作夥伴計劃?

❓ FAQ常見問題

Soft Forks 是否需要重新訓練我的 LLM?

完全不需要。Skills 在 inference 時動態載入,與模型權重無關。這正是 Soft Forks 的核心價值:零訓練成本擴展能力。

技能與普通 prompt engineering 有何不同?

關鍵在於可重用性與動態發現。一個 skill 是封裝的package,有 schema、版本、觸發條件;prompt 只是靜態文字。 skills 支援 semantic routing,代理能自動決定「此刻我需要哪個技能」。

現有工具(LangChain、AutoGen)支援 Soft Forks 嗎?

部分支援。LangChain 有 Runnable 接口,可封裝為類似技能的單元;AutoGen 支援 sub‑agent omachinery。但完整的 skills 生態(版本管理、marketplace、vendor‑agnostic)仍在演進中。Spring AI 和 GitHub 的 skillmatic 項目是目前最成熟的開源實現。

🔮 準備好把AI變成你的超級武器了吗?

Soft Forks 不只是技術 buzzword——它是 2026 年企業 AI translations 的底層 highways。無論你是想降低 90% LLM 成本,還是想把開發週期從個月壓縮到天,技能化架構都是必經之路。

siuleeboss.com 團隊提供:

- 企業級技能庫設計與implementation

- n8n/Zapier 深度 integration

- LLM 成本優化 audit

- 技能市集 platform development

📚 權威文獻與延伸閱讀

- Google Cloud AI Agent Trends 2026 Report

- Agent Skills for Large Language Models: Architecture, Acquisition (arXiv)

- Spring AI Agentic Patterns: Agent Skills

- Gartner Top Predictions for IT Organizations and Users in 2026 and Beyond

- n8n AI Agent Integrations

- Zapier Future of AI Transformation in 2026

- Awesome Agent Skills (GitHub)

- AI Agents Market Size Report 2026

- Spring AI Agent Utils (GitHub)

Share this content: