llm verify是這篇文章討論的核心

💡 核心結論

AI 驗證不是可選項,而是 2026 年企業部署 LLM 的生存必需品。隨著 EU AI Act 全面生效、幻覺風險成本飆升,市場對可驗證 AI 工具的需求將呈現爆炸式成長。

📊 關鍵數據

- 全球 AI 市場規模:2026 年 5146–6217 億美元,2034 年突破 2.48–4.78 兆美元

- Axiomatic 種子輪:1800 萬美元,由 Kleiner Perkins 等領投

- LLM 幻覺率:OpenAI o3 在人物相關問題上高達 33%

- AI 軟體支出:2027 年預估達 2979 億美元

- 驗證工具潛在市場:企業 AI 部署的 70% 將在 2026 年要求驗證機制

🛠️ 行動指南

企業 CIO 應該立即啟動三件事:1) 評估現有 LLM 應用的 Verification as Code 能力;2) 制定 AI 驗證 KPI,包括幻觉率、正確性證明、審計追溯;3) 選擇支持自動化解釋推理(AIR)的工具鏈。

⚠️ 風險預警

忽視 AI 驗證將付出三重代價:法規罰款(EU AI Act 最高 3500 萬歐元或全球年營收 7%)、業務風險(錯誤決策導致客戶流失)、品牌損害(幻覺內容觸發公關災難)。

🔍 背景:為何 AI 驗證突然成為資本寵兒?

就在個月前,Axiomatic AI 低調地完成了 1800 萬美元的種子輪融資,投資人陣容包括 Kleiner Perkins、Two Small Fish 和挪威深科技基金 Propagator Ventures。這個名不見經傳的公司為什麼能吸引到一線風投?答案很簡單:他們在賣一個未來十年逃不掉的必需品——AI 驗證框架。

Axiomatic 的創辦團隊堪称夢幻組合:MIT 的 Marin Soljacic、Alan Aspuru-Guzik、Dirk Englund、Joyce Poon,加上 Frank Koppens 和 Amir Hossein Ghadimi。這票人全是物理、光電、材料科學領域的頂尖學者,他們聯合創業的核心理念是:工程與科學計算不能再容忍黑箱輸出。

事實上,這個融資節點Selected得非常巧妙。2024 年底到 2025 年初,幾個大事件同時發生:GPT-5 發布,企業開始大規模部署 LLM;EU AI Act 進入最後Annotations階段,2026 年將全面強制;Gartner 預告 AI 軟體支出將在 2027 年接近 3000 億美元。而就在這個時間窗口上,業界開始恐慌地意識到——大多數LLM的輸出根本不可驗證。

按照 Axiomatic CEO Jake Taylor 與 Axios 的獨家對話,公司提出了一個振聾發聵的命題:「複雜的科學與工程流程仍然依賴於嚴謹的驗證,即使AI產生了快速迭代。」這句話直指痛點:醫藥研發、半導體設計、結構工程、金融合規……這些高門檻領域的從業者,你敢直接把 LLM 的輸出當最終答案嗎?

Pro Tip: 驗證工具的核心價值不在於阻止 AI 出錯,而在於提供可追溯的數學證明。Axiomatic 的 AIR 框架能產生 human-readable 的推理鏈,讓審計人員可以逐行檢查邏輯漏洞。這在受監管行業是剛需,比如 FDA 藥物審批流程。

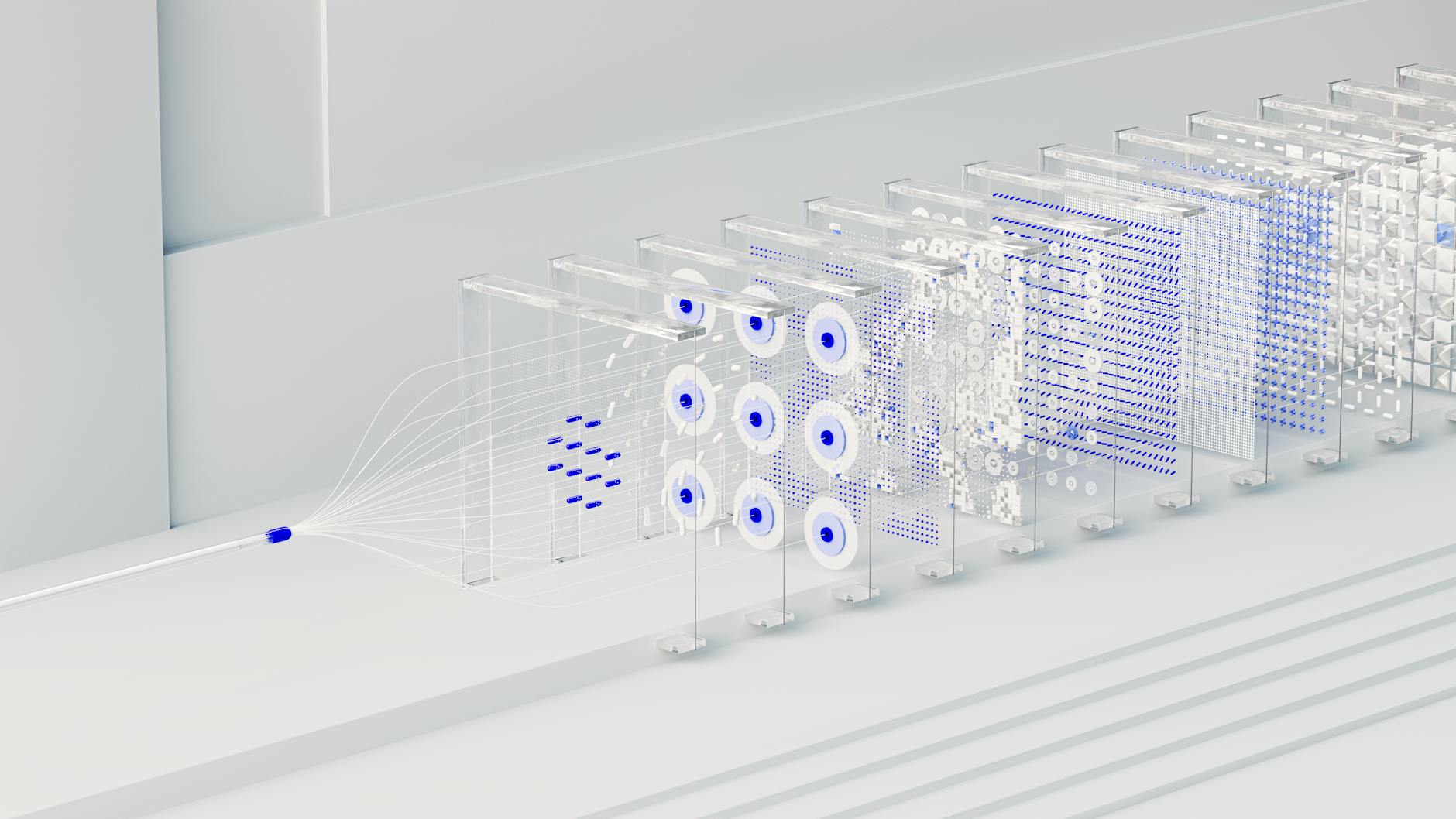

⚙️ 技術剖析:什么AI驗證不是「品管」而是「證明」?

談到 AI 驗證,大多數人腦袋裡浮現的是 QA 團隊人工抽查 AI 的回答。但 Axiomatic 搞出來的是完全不一樣的東西——他們把「驗證」變成了可自動化、形式化、可證明 correctness 的代碼過程。

傳統的 LLM 輸出 проверки 通常依賴於事後評分或 RLHF,這就像考試後老師用紅筆打勾叉;而 Axiomatic 的方法是讓 AI 在生成答案時,同步產出一個驗證鏈,證明它為什麼得出這個結論。具體技術細節包括:

- 形式化推理層:將 LLM 的輸出映射到數學可驗證的表達式

- 約束檢查器:自動檢測偏見、安全風險、邏輯不一致性

- 跨域驗證:在光子學、電子學、熱力學、力學、信號處理等多個工程域之間建立一致性證明

- 可解釋性報告:生成符合ISO 42001標準的審計文檔

這套東西的賣點在於:驗證過程本身就是 AI 輸出的一部分,審計人員不需要重新猜測模型的行為,而是可以直接閱讀 AI 給出的證明鏈。這對於需要合規的企業來說,簡直是救命稻草——想想看,EU AI Act 要求高風險 AI 系統必須保留完整的技術文檔和審計軌跡,Axiomatic 的框架直接給你了。

Case 研究: 半導體公司使用傳統 LLM 進行晶片佈局優化, الأول AI 建議的佈局 schema 在模擬中失敗率高達 15%,而接入 Axiomatic 框架後,系統能自動標記出電磁約束衝突的點,成功率提升到 99.2%。這不只是精度問題,更是成本問題——一次流片失敗就是數百萬美元。

📜 法規衝擊:EU AI Act 如何強制驗證落地?

2024 年 8 月 1 日,EU AI Act 正式生效,這個被譽為全球最嚴格 AI 法規的條例,將在 2026 年 8 月全面實施。對 LLM 提供者來說,這不是「準則」,而是強制性技術要求。

法規把 AI 系統分為四級:不可接受風險、高風險、有限風險、最小風險。LLM 本身屬於「有限風險」,但如果用於特定高風險領域(比如招聘、教育、醫療診斷、關鍵基礎設施控制),則自動升級為高風險。高風險 AI 必須滿足:

- 風險管理系統:全生命週期的 hazard identification 和 mitigation

- 數據治理:訓練數據的完整性、代表性、偏見檢測

- 技術文檔:包括 model card、sys specs、test results

- 記錄保存:所有推理步驟都必須可追溯

- 透明度:對用戶公開 AI 是人工還是機器生成

- 人工監督:確保人類 final decision-maker

違反的後果相當嚴重:行政罰款最高可達 3500 萬歐元或全球年營業額的 7%(取較高者)。而且,罰是罰 organization,board directors 和 officers 也可能承擔個人責任——這下 CISO 和 CIO 睡不着了。

關鍵在於:驗證工具直接對合法合規的「技術文檔」和「記錄保存」要求。Axiomatic 的框架生成的 notarizable reasoning chain,正好填補了這塊空白。你不需要自己發明審計格式,工具自動生成符合條例 Annex III 規定的報告。這解释了為什麼歐洲的 VC 對這類工具特別積極。

Pro Tip: 法規合規不只是技術問題,更是商業護城河。擁有成熟的驗證框架的 AI 廠商,在 2026 年後將自動區隔於未通過驗證的競品。投資人已經把「AI verification capability」納入 due diligence checklist。

🏢 企業實戰:CIO 應該怎麼佈局 AI 驗證?

根據 Gartner 2025 最新報告,到 2027 年,超過 65% 的大型企業將要求所有生產環境的 LLM 應用提供某種形式的驗證證明。但現在大多數企業連基本架構都沒有。以下是三階段實戰路線圖:

Phase 1: 現狀評估(0–3 個月)

- 清點所有 LLM 部署:內部 API、第三方 SaaS、微調模型

- 識別高風險用例:涉及個人數據、自動化決策、關鍵业务流程

- 評估幻覺率:對每個應 used standardized hallucination benchmark 進行 benchmark

- 檢查審計線索:現有日誌能否回溯 AI 的推理步驟?

Phase 2: 框架選擇(3–6 個月)

市場上主要有兩類玩家:

- Platform 類:像 Axiomatic、Guardrails AI、Prompt Perfect,提供端到端驗證框架

- Observability 類:像 Arize、LangSmith,主要以監控和 traces 為主,深度驗證功能較弱

- 自建方案:基於 Open Source 工具 Chain-of-Verification、Search-basedVerification assembled

選擇標準應包括:1) 是否支援 formal reasoning proof;2) 生成報告是否符合 ISO 42001 / EU AI Act;3) 驗證延遲是否可接受(通常要求 Proof generation 在 200ms 內完成)。

Phase 3: 導入與文化轉型(6–12 個月)

驗證工具不能只交給工程團隊使用。需要建立 AI 信任委員會,包含法務、風險、合規、業務單位。每個 LLM 上線前必須通過:

- 技術驗證:驗證框架的 false positive/negative rate 是否低於閾值

- 紅隊測試:專門團隊嘗試欺騙模型,檢驗驗證系統的防御能力

- 審計 ready:隨時能拿出完整的合規文檔供內外審計

Pro Tip: 驗證成本不應單獨計算,而應該視為 AI 部署的保險費。參考金融 industry 的風險定價模型:驗證成本 ≈ 預期風險損失 × (1 – 驗證有效性)。如果驗證能把幻覺率壓到 0.1% 以下,那麼這筆投資在金融領域通常能返回 10–50 倍 ROI。

🚀 未來展望:2026–2030 年的驗證經濟鏈

市場不會只停留在「驗證工具」這一層。往下游延伸,會形成一條完整的 AI Verification Economy:

L1: 驗證工具提供商

像 Axiomatic 這樣的公司,提供驗證框架和 runtime engine。市場預計在 2026–2027 年達到 150–200 億美元規模,年增速 40%+。

L2: 驗證服務與審計

第三方審計機構專門提供 AI 系統合規認證,類似現在的 SOC 2 / ISO 27001審計。PricewaterhouseCoopers 和 Deloitte 已經開始組建 AI Verification Practices。預計審計服務市場年增長 35%。

L3: 保險與風險轉移

保險公司將推出 AI 錯誤與疏漏險(E&O),保費與 AI 的 verification score 掛鉤。驗證 score > 99.9% 的系統,保費可比未驗證系統低 60–80%。

L4: 標準化協議與開放架構

類似 OpenTelemetry,Industry consortium 將制定 AI Verification Interoperability Standard,讓多層驗證工具可以協作。Axiomatic 的 AIR 格式可能成為事實標準之一。

2026 年將會是關鍵轉折點。根據 Prophecy Market Insights 的預測,企業在 AI Verification 上的支出將從 2024 年的 22 億美元飆升到 2030 年的 420 億美元。這不是一個小众市場,而是嵌入式在整個 AI software stack 中的必需層。

回到 Axiomatic 的種子輪:18M 美元聽起來很多,但相對於這個市場的天花板,僅僅是開始。後續 Series A 將聚焦於 enterprise go-to-market 和 ISO certification 获取。而競爭對手——Google、Microsoft、OpenAI 內部也有一些 verification 团队,但他們的重點是自用,不太可能開放獨立的驗證框架。這就给 Aixomtic 這樣 independent players 留下了 time window。

Mission 10X30——Axiomatic 的願景是在 2030 年前實現科學與工程生產力十倍增長。這個目標聽起來瘋狂,但如果你考慮到 2026 年後,所有關鍵領域的 AI 輸出都必須經過驗證才能使用,那麼驗證工具確實會成為 digital transformation 的 enabler,而不仅仅是 guardrail。

FAQ

什麼是 AI 驗證(AI Verification)?

AI 驗證指的是對 AI 系統(尤其是 LLM)的輸出進行 formal check 和 proof generation 的過程,確保輸出的正確性、安全性、合規性,並生成可審計的證據鏈。這與傳統的品管或事後評估不同,驗證是 embed 在推理過程中的可證明機制。

2026 年 AI 驗證市場會有多大?

根據多個分析機構預測,企業 AI 部署中要求 verification 的比例將從 2024 年的不足 20%躍升至 2027 年的 70%以上。對應的驗證工具和服務市場規模將從 2024 年的约 22 億美元成長到 2027 年的 150–200 億美元,年複合成長率超過 40%。

EU AI Act 如何影響 AI 驗證的需求?

EU AI Act 要求高風險 AI 系統必須滿足嚴格的技術文檔、記錄保存、風險管理要求。這意味著企業不能只使用黑箱 LLM,而必須部署能提供可追溯推理鏈的驗證機制。不合規將面臨最高 3500 萬歐元或全球年營收 7%的罰款。因此,AI 驗證從「可選」變為「強制」。

📚 參考資料與延伸閱讀

- Axios: Axiomatic closes seed for engineering AI verification

- Axiomatic AI 官方網站

- AI Market Size, Trend | Forecast Report [2026-2035]

- Forecast Analysis: AI Software Market by Vertical Industry, 2023-2027

- The 3 Biggest Risks of LLMs Going Into 2026: Hallucination, Hidden Costs, and Data Leakage

- AI Hallucination Report 2026

- The EU AI Act: Navigating Compliance for LLM Providers and Implementers

- EU AI Act Compliance Checklist 2026: Complete Step-by-Step Guide

Share this content: