Google TPU 協議是這篇文章討論的核心

💡 核心結論

Meta 與 Google 的 TPU 交易不僅是簡單的晶片採購,而是 AI 時代基礎設施權力的重新分配。Google 正透過 TPU 從「雲端服務商」轉型為「硬體供應商」,直接挑戰 NVIDIA 的霸主地位。

- 這筆交易可能使 Google TPU 成為 NVIDIA GPU 之外的最大單一代工订单

- Meta 透過多元供應鏈策略,降低對 NVIDIA 的依賴,強化自身 AI 模型訓練自主權

- 台積電將成為最大受益者,CoWoS 封裝需求將持續吃緊至 2027 年

- ASIC 市場將在 2027 年迎來 explosive growth,Global AI Server Compute ASIC 出貨量預估將從 2024 年翻三倍

🔍 自動導航目錄

算力戰爭進入新紀元:我們觀察到什麼?

根據 The Information 獨家報導並經 Reuters 與 Yahoo Finance 證實,Meta Platforms 與 Alphabet(Google)正在洽谈一項價值數十億美元的 AI 芯片合作协议。這不是普通的企业采购,而是 AI 基礎設施领域的一次深度捆绑。

從表面上看,Meta 將租賃 Google 自研的 TPU(Tensor Processing Unit)用於大模型訓練,並可能購買這些芯片部署在自己的數據中心。但實際上,這反映了當前科技巨頭面對 NVIDIA H100/H200 供不應求的困局時,正在ifactoring 的供应链重构蓝图。

根據 NVIDIA 官方財報,2025 年 Q1 收入 441 億美元,Q2 收入 467 億美元,年增率分別為 69% 和 56%。然而與此同時, Jensen Huang 在CES 2026 坦言 H200 在中國市場的需求依然強勁,全球供應鏈仍面臨長達 1.5 年的短缺期(TSMC 預測)。

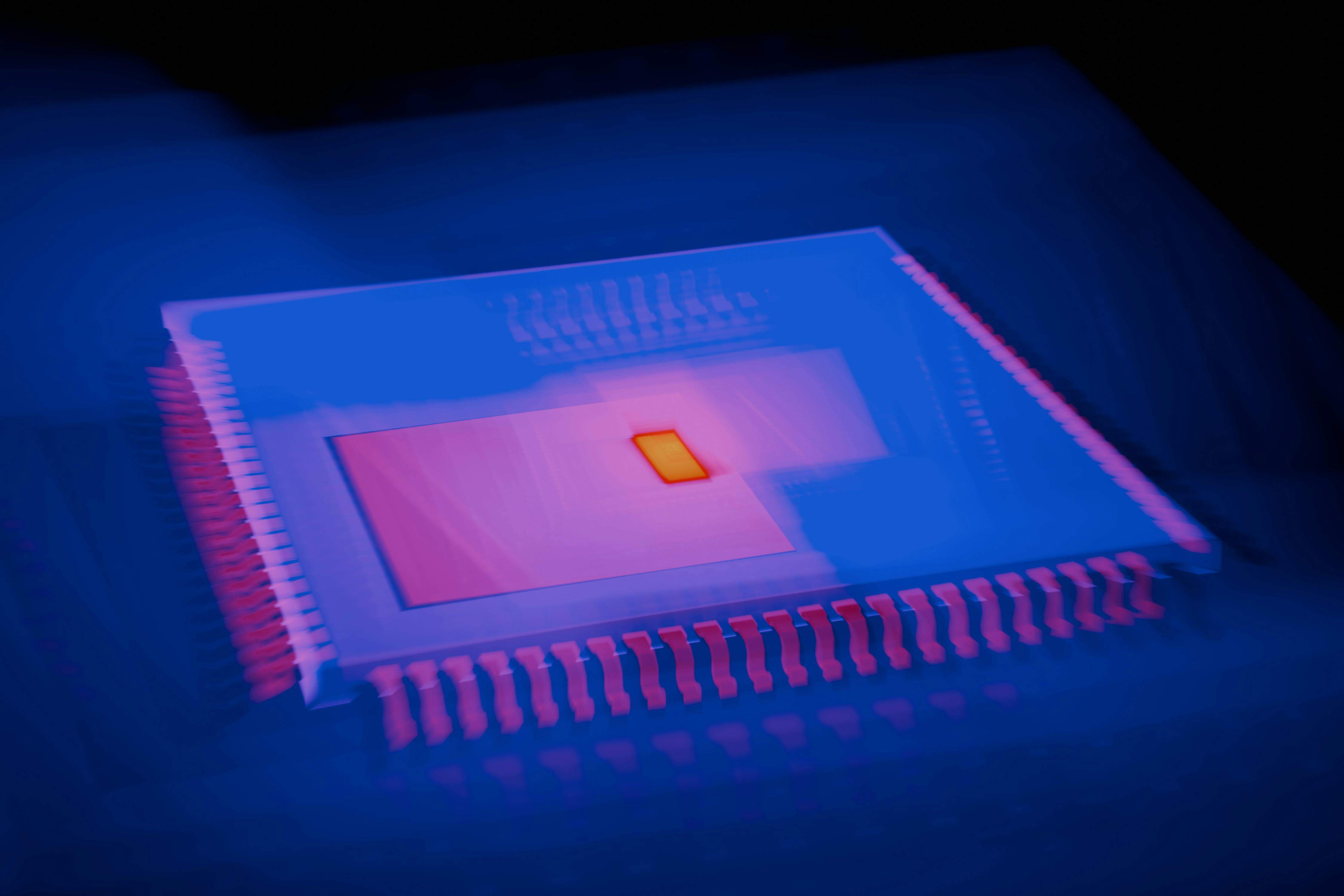

Google TPU 能做到什麼讓 NVIDIA 緊張的事?

Google 的 TPU 歷史可追溯至 2016 年,但真正讓市場正視的是 2024 年 12 月發布的 Trillium TPU(第六代)。根據 Google Cloud 官方部落格,Trillium TPU 已正式商用(GA),並用於訓練 Gemini 2.0 —— Google 最強大的 AI 模型。

從技術規格來看,Trillium TPU v6 在 AI 訓練、微調和推理方面都有顯著提升。更有業內分析(SemiAnalysis)指出,Google 即將推出的 TPU v7(Ironwood)可能成為 CUDA 生態的潛在威脅。這對於長期以 CUDA 軟體護城河為主導的 NVIDIA 而言,無疑是敲響了警鐘。

token 成本 通常比同級 GPU 低 15-20%,但這取決於軟體生态的成熟度。然而,Google 正面臨軟體生態的挑戰 —— 開發者習慣 CUDA 後,遷移至 TPU 需要重寫代碼,這解釋了為何 TPU 雖然技術領先但市場份額不如 GPU。

但這次 Meta 交易的不同之處在於:Google 將 TPU 出售給客戶部署在客戶自己的數據中心,而非僅限於 Google Cloud 租賃。這標誌著 TPU 商業模式的重大轉變 —— 從「雲端服務附加品」變成「獨立硬體產品」。

Meta 的「去 NVIDIA 化」战略佈局:真的可行嗎?

Meta 並非僅僅是被動應對 GPU 短缺,而是推行了一套多重供應鏈策略。早在 2023 年 12 月,Meta 就公開部署 AMD Instinct MI300X GPU 作為 inference 工作負載的替代方案。根據 X 平台業內分析師整理時間線,Meta 與 AMD 的合作關係持續深化,AMD MI300X 目前負責 Llama 3/4 的圖像編輯、AI 貼紙等 inference 任務。

更關鍵的是,Meta 自身也開發了第二代 AI 芯片 MTIA(Meta Training and Inference Accelerator)。根據 Meta AI 官方部落格,MTIA 系列是專為 Meta 獨特工作負載定制的高效能架構,已实现对部分推薦模型訓練和 inference 的支援。然而,MTIA 主要針對邊緣 inference,對於大規模 LLM 訓練,CPU/GPU/TPU 仍然是主力。

這就解釋了為何 Meta 需要與 Google 簽署 TPU 協議:它在試圖打造一個三層供應鏈体系 —— 訓練用 TPU/GPU 混合集群, inference 用 MTIA 與 AMD MI300X 搭配,再加上與 NVIDIA 談判獲取最佳價格。這種策略既能確保供應鏈安全,又能利用供應商之間的競爭壓低价格。

台積電 CoWoS 封裝飢渴:2026 年供應鏈脆弱點

AI 芯片競爭的本質是半導體製程與封裝技術的競爭。當前所有高端 AI 芯片(NVIDIA H100/H200、Google TPU、AMD MI300X)都依賴台積電的 CoWoS(Chip on Wafer on Substrate) 封裝技術。然而,CoWoS 產能本身就是最大的瓶頸。

根據 Morgan Stanley 與野村證券的產業調查,台積電 CoWoS 產能利用率在 2025-2026 年持續接近滿載。野村證券更指出,台積電下一代 CoPoS(Chip on Panel on Substrate)技術可能延遲至 2029-2030 年才會量產,這直接影響 NVIDIA Rubin Ultra GPU 的推出時間表。

Meta 如果大量採購 TPU,將進一步加劇 CoWoS 供不應求的狀況。台積電 2026 年後端資本支出可能轉向 WMCM(晶圓級多晶片模組)及 SoIC(系統級集成電路)等其他技術,但短期內無論哪家客戶都必須排隊等候。

Counterpoint Research 的數據印證了這一點:Global AI Server Compute ASIC 出貨量預計在 2024-2027 年間翻三倍。Broadcom 目前以 60% 市占率領導 AI Server ASIC 設計,Google TPU 則是出貨量的骨幹。若 Meta 加入 TPU 大單,Google 的 ASIC 份額將進一步膨脹。

2027 年 AI 芯片市場預測:三足鼎立還是寡頭壟斷?

根據 Allied Market Research,AI 芯片市場規模將從 2024 年的 449 億美元成長至 2034 年的 4,609 億美元,年複合成長率(CAGR)約 29.5%。但這數字背後隱藏著結構性變化:custom ASIC(包括 TPU、MTIA 各類自研芯片)將逐步蠶食 GPU 份額。

我們可以預見 2026-2027 年的格局:

- NVIDIA:Blackwell 系列(B200/GB200)在超高端訓練市場仍有優勢,但客户開始要求价格折扣以抗衡替代品。

- Google:如果 TPU v7/v8 在性能上能達到甚至超越 H200/B200,並成功將產品外部銷售,將形成 雲端巨頭 vertical integration 的新模式。

- AMD:MI300X 在 inference 市場取得初步成功,但要進入訓練市場需要更多軟體生態投資。

常見問題

Meta 為何要簽署 TPU 協議而不是繼續向 NVIDIA 買 GPU?

主要原因是供應鏈風險管理。NVIDIA H100/H200 當前供不應求,Lead time 長達數月。Meta 的 AI 訓練需求極大(Llama 5 即將推出),必須提前鎖定算力來源。此外,MTIA 和 TPU 配合使用可能降低 15-30% 的训练成本。

Google TPU 的軟體生態能否與 CUDA 競爭?

這是 Google 最大的劣勢。CUDA 生態已有十數年累積,數百萬開發者。TPU 需要 through JAX 或 TensorFlow,遷移成本高。然而 Google 正在大力投資軟體工具鏈,若 Meta 這樣的頭部客戶帶動效應,可能加速 TPU 軟體成熟。

這筆交易對台積電的營業收入有何影響?

直接影響有限,因為 TPU 本來就由台積電代工。但 Meta 需求增加意味著 Google TPU 出貨量上升,間接增加台積電 CoWoS 封裝訂單。台積電 2026 年 AI 相關營收可能因此上修 5-8%。

行動呼籲

AI 基礎設施的 Power Shift 正在發生。作為企業決策者或技術投資者,你需要:

- 重新評估 AI 芯片供應鏈風險,不要把所有雞蛋放在 NVIDIA 籃子裡

- 關注 Google TPU 生態發展,2026 年可能出現外部銷售突破

- 密切追蹤台積電 CoWoS 產能擴張時間表,這將是芯片短缺周期的關鍵轉折點

參考資料

- Reuters: Meta in talks to spend billions on Google’s chips, The Information reports

- Yahoo Finance: Meta, Google discuss TPU deal as Google targets Nvidia’s lead

- Google Cloud Blog: Trillium TPU is GA

- Meta AI: Next Generation Meta Training and Inference Accelerator

- Allied Market Research: Artificial Intelligence Chip Market Size, Share & Report

- Counterpoint Research: AI Server Compute ASIC Shipments to Triple by 2027

- McKinsey: AI power: Expanding data center capacity

- OpenAI: Announcing The Stargate Project

- Tom’s Hardware: Nvidia says its H100/H200 GPUs are not sold out

Share this content: