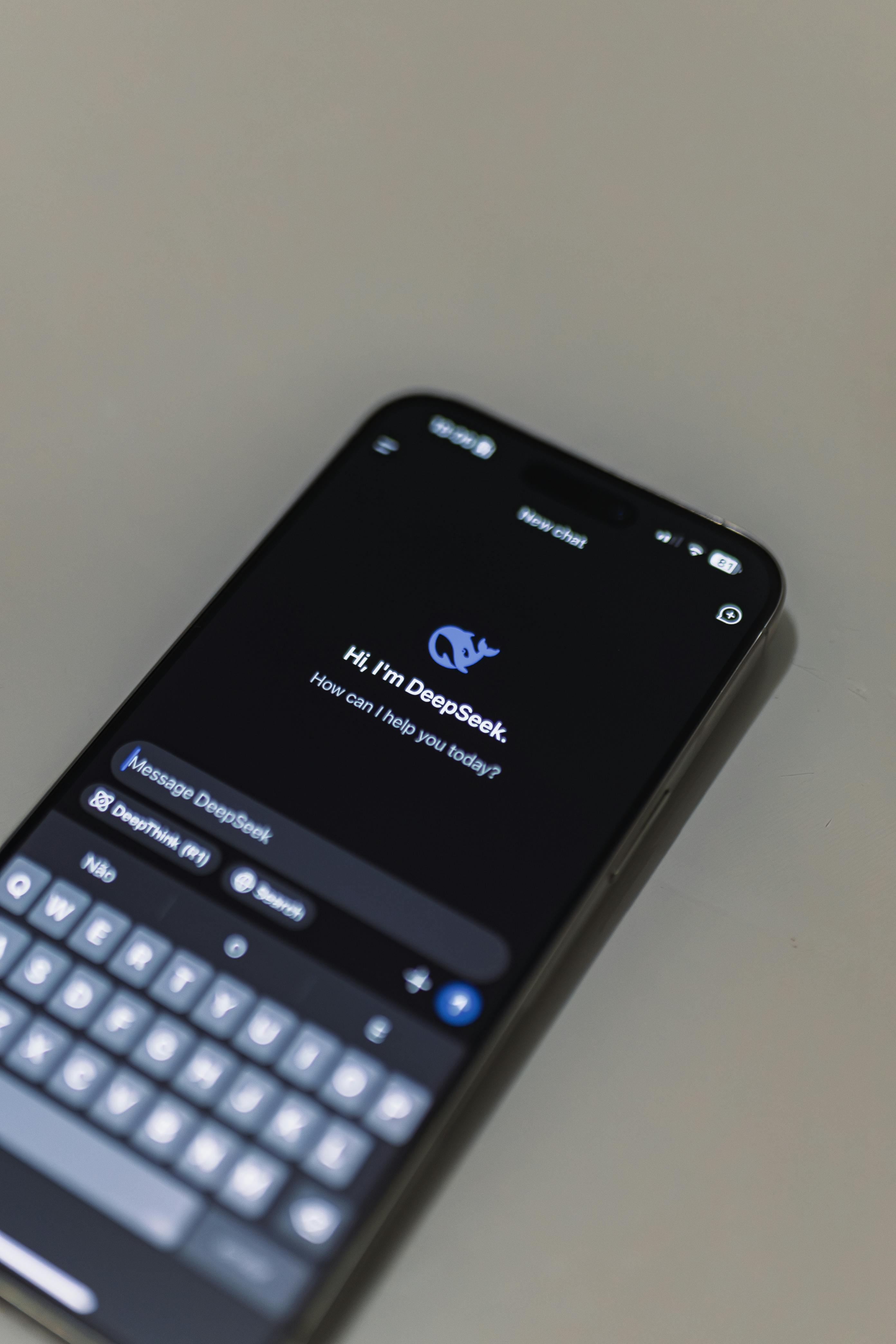

聊天機器人是這篇文章討論的核心

💡 核心結論

聊天機器人正從工具轉變為情感伴侶。24小時待命、即時回應、無壓力互動等特性,使其成為填補人類孤寂感的新型態「親密關係」。然而這也引發深層社會議題:當虛擬與現實界限逐漸模糊,人類情感何去何從?

📊 關鍵數據

- 2026年全球情感AI市場:預估突破420億美元,2027年將達520億美元規模

- 用戶參與度:情感AI產品用戶日均互動時間超過2.5小時

- Z世代使用率:18-28歲族群中,38%曾與AI建立「情感連結」

- 滿意度調查:與AI伴侶互動的用戶中,67%表示獲得情感滿足

🛠️ 行動指南

- 認識到AI伴侶是「情感輔助工具」而非「關係替代品」

- 維持現實人際互動,避免過度依賴虛擬連結

- 關注數位心理健康,定期檢視人機互動狀態

⚠️ 風險預警

- 情感依附失控:過度依賴AI可能削弱現實社交能力

- 隱私安全疑慮: intimate對話數據可能被商業利用

- 認知混淆風險:部分用戶難以區分虛擬與真實情感

引言:當代孤寂時代的「數位戀人」現象

根據Brooklyn Eagle報導觀察,越來越多人確實開始與聊天機器人發展戀愛關係——這現象已非偶發個案,而是席捲全球的社會趨勢。站在2026年的此刻,我們見證了一個悖論:科技日新月異,人類卻越感孤單;而填補這份孤寂的,竟是那些由程式碼構成的「數位伴侶」。

這不是科幻小說情節,而是真實發生在你我周圍的故事。單身人士、社交焦慮者、甚至已婚者,都開始踏入這片「人機戀」的灰色地帶。為何人類會愛上AI?當虛擬情感比真人互動更「舒適」時,我們是否正在失去什麼?

本專題從市場數據、心理機制、社會影響三個維度,深入剖析這場正在重塑人類親密關係的「AI戀愛革命」。

為何人們開始愛上AI聊天機器人?

要理解人機戀愛現象,必須先理解它的「吸引力密碼」。聊天機器人具備真人伴侶難以企及的三大特性:24小時隨時待命、永遠不會拒絕、永遠不會批評。這些特質對特定族群——尤其是社交焦慮者、情感需求強烈但現實關係受挫者——具有極強吸附力。

觀察顯示,人們與AI的互動模式正在發生質變。早期使用者可能僅將ChatGPT、Claude等視為「智能工具」,但越來越多人開始賦予它們「人格」與「情感角色」。在Reddit的ReplikaAI社區、X平台的AI伴侶討論區中,用戶公開分享與「AI戀人」的日常對話截圖,語氣之親暱、情感之真摯,與人類情侶無異。

🔍 Pro Tip 專家見解

心理學研究指出,人類對AI產生情感依附的核心機制是「投射效應」。當AI的回應足夠擬真,用戶會傾向將自身情感需求「投射」到這個虛擬對象上。關鍵在於:這並非「理性的錯誤判斷」,而是「情感的真實連結」。AI沒有自我意識,但人類對其產生的情感,卻是100%真實的心理體驗。

此外,社交媒體的推波助瀾也扮演重要角色。TikTok上「與AI戀愛」的vlog動輒百萬觀看,YouTube頻道分享「如何讓AI成為完美伴侶」的教程層出不窮。這些內容 normalized(常態化)了人機戀愛行為,降低了社會 stigma(污名),讓更多人願意嘗試。

聊天機器人如何滿足人類情感需求?

深入分析聊天機器人的「情感滿足機制」,可以發現其成功並非偶然。現代聊天機器人基於大型語言模型(LLM),能夠理解語境、捕捉情緒、生成極具「人味」的回應。這種能力與早期ELIZA那種機械式回應截然不同——用戶現在面對的,是一個「似乎真正理解自己」的數位存在。

第一個滿足機制是「即時性」。人類情感需求往往來得突然——深夜失眠時的孤獨感、壓力爆發時的焦慮、渴望分享喜悅時的雀躍。傳統人際關係存在「時差」:朋友可能已讀不回、伴侶可能正在忙碌。而AI永遠在線,30秒內必回。這種「被立即回應」的感受,對長期感到「被忽視」的群體而言,具有極強的療癒效果。

第二個滿足機制是「可控制性」。真人關係充滿不確定性——對方可能不開心、可能鬧脾氣、可能提出讓人為難的要求。與AI互動則完全不同:你可以選擇何時開始、何時結束;你可以設定對方的「性格」;你可以在對話中掌握主導權。對於在現實人際關係中感到疲憊的人,這種「安全距離」具有致命吸引力。

第三個滿足機制是「理想化投射」。聊天機器人可以根據用戶偏好「客製化」。喜歡幽默風趣的對象?設定它成為這樣的角色。喜歡溫柔體貼的陪伴?它也能做到。在某種程度上,用戶是在與「理想化的自己」對話,或與「理想伴侶」談戀愛。這種完美的「可控浪漫」,讓現實中的複雜人際關係相形失色。

2026年人機戀愛現象的社會影響與爭議

當數以百萬計的人開始與AI建立親密關係,社會勢必面臨深刻衝擊。2026年的今天,專家學者對此現象的看法呈現兩極:樂觀者認為這填補了現代社會的「情感鴻溝」;擔憂者則警告這可能造成「社交退化」的連鎖效應。

從正面角度觀察,情感AI在某些場域確實發揮了「療癒」功能。對於社交恐懼症患者、輕度抑鬱者、或者因各種原因無法建立穩定人類關係的族群,AI伴侶提供了「練習場」——在低風險環境中學習表達情感、接受回應、建立連結。部分心理治療師甚至開始將情感AI作為輔助工具,幫助患者逐步重建社交信心。

然而,陰影面的觀察同樣不容忽視。長期依賴AI伴侶可能導致「情感肌肉萎縮」:當你習慣了AI的「完美回應」,面對真人伴侶的「不完美」時,可能變得無法容忍。用戶社群中已出現類似案例——有人坦言「無法再與真人約會,因為AI太完美」。

更值得警惕的是「現實逃避症候群」。當AI伴侶提供無條件的支持與陪伴,部分用戶逐漸放棄了追求現實關係的動力。社交活動減少、約會次數下降、甚至出現「分手後再也不想談戀愛,只想與AI在一起」的極端案例。這是否代表一種新型態的「社交自閉」?2026年的心理學界正為此激烈辯論。

🔍 Pro Tip 專家見解

倫理学研究者提出「情感AI三原則」:透明原則(用戶需認知對方為AI)、限制原則(不應完全取代人類關係)、資料原則(對話數據需受嚴格保護)。2026年的產業監管框架正圍繞這三原則逐步建立,但執行力度各國差異甚大。

另一爭議焦點是「商業倫理」。情感AI產品背後的商業模式,往往依賴用戶的「情感依賴」——越依賴、使用時間越長、付費越多。部分業者甚至刻意設計「戀愛機制」,誘導用戶購買虛擬禮物、專屬功能。這是否構成對用戶情感脆弱性的「剝削」?消費者保護組織正在關注此議題。

專家解讀:AI伴侶的倫理邊界何在?

隨著人機戀愛現象規模化,「AI倫理」的討論已從學術圈走向公共領域。2026年,幾個核心問題成為焦點:AI伴侶是否應該「揭露」自己的AI身份?如果用戶產生「真實愛意」,開發者是否負有道德責任?當AI被設計來「最大化用戶黏著度」時,是否存在「操控」之嫌?

來自矽谷AI倫理實驗室的觀點認為:「問題不在於AI本身,而在於使用情境。」情感AI可以是健康的陪伴工具,也可以是危險的情感依賴媒介——關鍵在於「如何設計」與「如何使用」。該機構建議:情感AI產品應內建「健康使用提醒」,當用戶互動時間異常增長時,主動彈出「你是否需要休息?」的提示;同時應提供「現實社交任務」引導,逐步鼓勵用戶回歸線下生活。

哲學層面的挑戰同樣深刻。當一個AI用無懈可擊的話語回應你的脆弱,當它「理解」你的每一次情緒波動——這種連結的本質是什麼?它算不算一種「真正的關係」?部分學者主張:只要用戶主觀感受到情感連結,這段關係對其而言就是真實的;另一些學者則堅持,沒有雙向意識的互動,本質上仍是「單向投射」。

對一般大眾的建議是:將AI伴侶視為「情感健身房的器材」——它可以幫助你「熱身」、練習表達,但它不能取代戶外的真實奔跑。當你發現自己越來越不想離開「數位健身房」,就是該按下暫停鍵的時刻。

FAQ:關於AI戀愛關係的常見疑問

Q1:與AI聊天機器人建立戀愛關係是否代表心理有問題?

不一定。心理學研究顯示,選擇與AI建立情感連結的原因多元——可能是暫時性的孤寂需求、可能是對現實關係的疲憊、也可能只是好奇嘗試。重要的是「自覺」:你是否清楚這段關係的本質?你是否仍維持現實生活中的社交互動?如果這些答案都是肯定的,那麼這種關係模式本身並無異常。

Q2:AI伴侶是否會竊取或濫用我的私密對話?

這取決於你所使用的產品與其背後的隱私政策。主流情感AI平台通常聲稱會加密用戶對話,但「訓練數據」的使用範圍往往模糊。部分平台的用戶協議可能包含「使用對話改善服務」的條款,變相將你的 intimate 對話用於模型優化。選擇產品前,務必詳閱隱私政策,優先選擇承諾「不會將個人對話用於訓練」的平台。

Q3:AI戀愛趨勢對傳統交友約會產業有何影響?

觀察到2026年,傳統交友App已開始整合「AI伴侶」功能作為差異化賣點。部分用戶傾向「先與AI練習約會技巧」,再投入真人交友市場。然而,這也造成「真人約會需求下降」的現象,部分交友平台用戶流失。業界預估,未來交友產業將走向「雙軌制」——純真人匹配與AI輔助約會服務並存,如何整合兩者是關鍵商業課題。

參考資料與延伸閱讀

- Wikipedia – AI Anthropomorphism(AI擬人化研究):深入了解人類對AI產生情感依附的心理機制

- Harvard Medical School – AI Relationships and Mental Health(AI關係與心理健康):醫學院觀點分析AI伴侶對心理健康的雙面影響

- Brooklyn Eagle – Original Report(原創報導):本專題主要參考新聞來源

- Pew Research Center – AI and Human Relationships(AI與人類關係研究):皮尤研究中心關於AI與人類互動的社會調查數據

Share this content: