AI情緒變化早期偵測是這篇文章討論的核心

快速精華

💡 核心結論:UT Dallas 這類研究的重點不是「取代醫師」,而是用多模態深度學習在精神健康問題剛冒頭時先給 可行的提示,讓介入更早、治療更有機會更省成本、更有效率。

📊 關鍵數據:AI 整體市場在 2026 已進入「萬億美元級加速」的軌道;Gartner 預估 2026 年全球 AI 支出約 2.5 兆美元(YoY +44%)。這代表未來幾年,醫療以外的 AI 供應鏈(雲端、感測、語音模型、合規工具)會一起被醫療場景拉動,精神健康預警只是其中一個很早就露頭的分支。

🛠️ 行動指南:如果你是產品/醫療端:把「能落地的資料管線」先做起來(臨床資料標準化、生理指標採集流程、語音特徵的品質控管),先定義輸出是「提示」而不是「診斷」,再談導入與評估。

⚠️ 風險預警:資料隱私、跨族群偏差、以及把模型輸出當成醫療結論的誤用,會直接讓系統失去可信度。要用可追溯的審核與人類覆核流程把它框起來。

為什麼「症狀初起」最難抓?UT Dallas 用多模態 AI 改打法是什麼

我在看這則 UT Dallas 的研究描述時,第一個直覺是:問題不是「AI 做不到」,而是「臨床現場抓不到那個時間點」。精神健康的變化常常是緩慢累積、而且每個人呈現的節奏不一樣;如果要等到症狀明確到醫療端才被看見,等於把最好的干預窗口錯過。

UT Dallas 的方向很務實:把研究目標鎖定在「剛剛出現(初起)就能發出提示」。他們提到會結合 臨床數據、一些生理指標、以及語音特徵,透過深度學習模型判斷情緒變化,讓醫療人員能更早介入。這種做法比較像是把 AI 變成「偵測警示器」,而不是「最終審判官」。

如果把精神健康系統想成交通:診斷是「事故定性」,早期檢測則是「偵測可能結冰的路面」。你要的不是替交警開罰單,而是先提醒你調整路線。

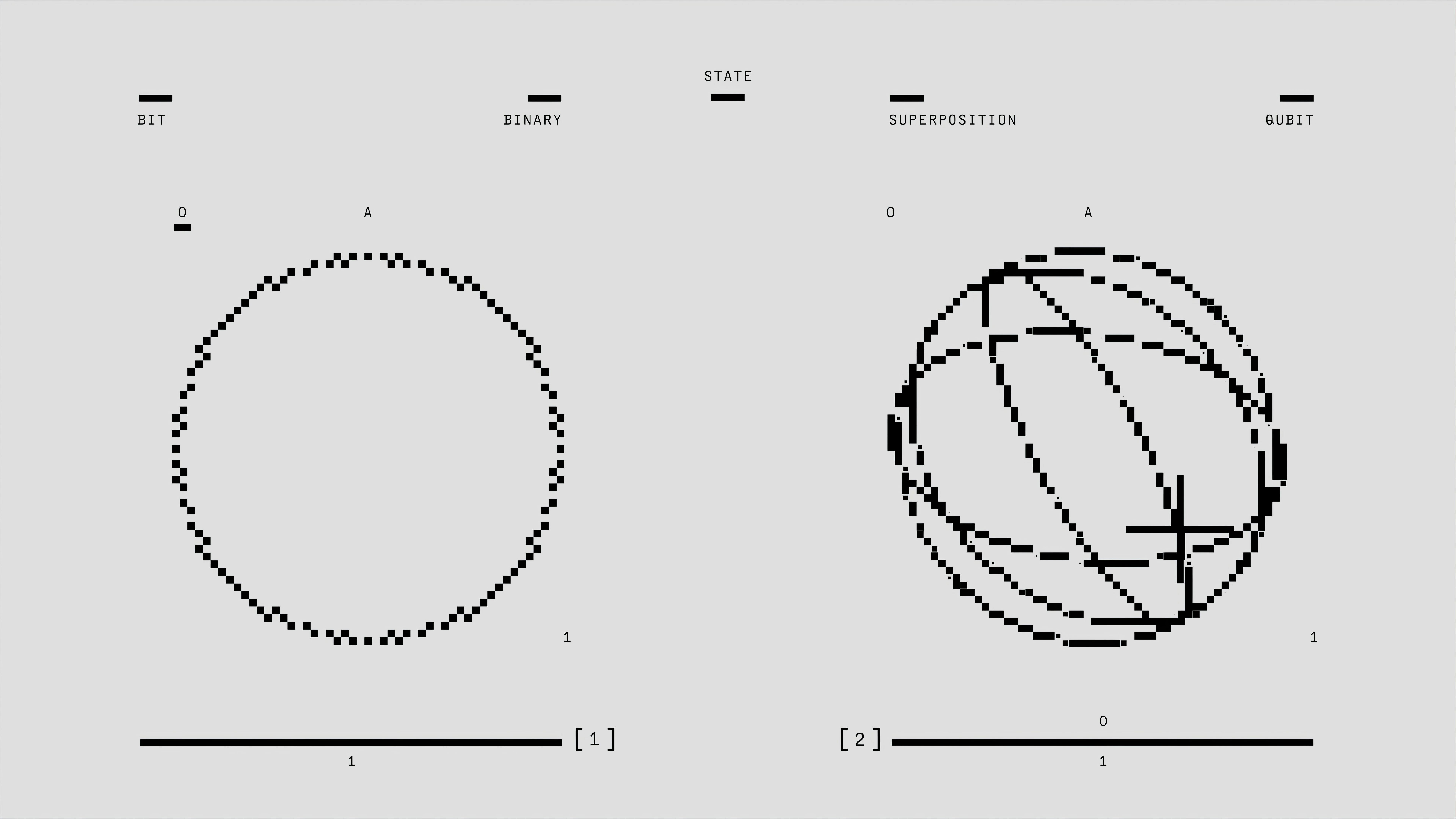

重點在「多模態」:臨床數據告訴你病程語境,生理指標補上身體層面的變化,語音特徵又像是一種日常可量化的情緒外顯。這三塊拼起來,才更可能讓 AI 在早期做出有意義的提示。

多模態到底多厲害?臨床數據×生理指標×語音特徵如何一起出答案

我會把「多模態」講得更直白一點:它不是把資料堆更多,而是讓模型看到不同層級的同一件事。精神健康問題通常不是單一維度的爆發,而是行為、身體狀態與情緒表達同步改變。

在 UT Dallas 的描述裡,他們使用深度學習模型去判斷情緒變化,並且會用到:

- 臨床數據:讓模型理解症狀量表或病程背景,知道「什麼樣的變化代表什麼」。

- 生理指標:提供壓力、生理節律、或身體層面波動的線索(不等於診斷,但能補強證據)。

- 語音特徵:把情緒狀態的表現轉成可分析的訊號(例如語速、停頓、音調變化等類型的特徵)。

如果你有做過模型落地,會知道單一資料來源很容易被「偶然因素」干擾;多模態可以降低單點失真。你可以把它想成:臨床資料像是病史,生理指標像是天氣雷達,語音則是街上人群的口風。三者加起來,才比較能抓到「早期的不對勁」。

Pro Tip(專家視角)

多模態最容易踩雷的地方是:資料品質不一致導致模型學到「設備差異」而不是「疾病訊號」。你要做的是先建立資料標準(採集時間窗、語音錄製情境、濾噪流程、標註一致性),然後才談模型架構。這樣輸出的提示才會更接近可用的臨床訊號,而不是研究漂亮但現場失效。

深度學習在情緒變化上的角色:它在做什麼、又不該做什麼

這裡我想講清楚:深度學習模型在這種研究裡最實際的工作,是把多來源資料映射到「情緒變化的可能性」與「風險訊號」。也就是在症狀尚未明顯、尚在浮動時,提供醫療端一個可以優先查看的排序或警示。

因此,它的邊界應該是:

- 該做:輸出風險提示、趨勢變化、或需要覆核的個案清單。

- 不該做:直接宣布診斷結果、或替代臨床判斷流程。

為什麼?因為這類模型本質上是統計學習器:它擅長找出訊號中的模式,但它不理解「每個人背後的社會情境」。如果你把它當診斷,就容易把不確定性偽裝成確定性。

你可以參考一些學術/綜述類研究也在談 AI 用於精神健康領域的早期偵測、語音或行為資料分析,以及同時存在倫理與偏差問題。例如:Nature 的研究也提到使用多模態(語音與行為資料)做早期偵測框架;而一些臨床/評論文獻也強調 AI 應用同時面對隱私、偏差與人類元素保留等挑戰。這些都在提醒:模型輸出只是第一步,後面需要臨床與治理設計。

一句話:模型負責「提醒」,臨床負責「定案」。這個分工越早被寫進流程,系統越容易在現場活下去。

2026 到未來的產業鏈重排:哪些環節會先被 AI 點名

這題你可以用「投入會去哪裡」來看。當 AI 市場快速膨脹,醫療領域通常會用同樣的邏輯:先把最能量化、最能規模化的部分切出來。精神健康早期檢測之所以會被盯上,原因很單純——它的信號(語音、生活狀態、生理指標)相對容易做成資料管線。

我們用 2026 的市場節奏來對應:Gartner 預估 2026 年全球 AI 支出約 2.5 兆美元,而這種資金流不會只砸在「模型本體」。它也會砸在:

- 感測與資料採集:可穿戴、生理指標、語音錄製/通話資料處理。

- 雲端與邊緣運算:把資料安全地送進訓練與推論管線。

- 醫療合規與審核:隱私、偏差檢測、審計(audit)工具。

- 臨床工作流整合:把「提示」融入既有評估與介入流程,而不是做出一個孤島 App。

所以你會看到產業鏈重排的第一波常常是「資料側」先長出來:因為只要能讓資料更穩、模型輸出更可信,就能加速臨床評估與擴展。

這也是為什麼你現在就能開始布局:不是等模型變得更聰明,而是讓你手上那條資料管線更符合臨床使用邏輯。

風險預警:資料隱私、偏差、與「以為能取代診斷」的坑

做精神健康早期預警,最大風險通常不是技術失敗,而是信任失敗。因為這類系統一旦進入醫療或健康服務,就會碰上三個硬問題:

- 隱私與資料治理:臨床數據、生理指標、語音特徵都很敏感。你需要明確的資料最小化、權限控管、以及可追溯的使用目的。

- 模型偏差:資料分布不一致(族群、語音環境、設備差異)會讓模型輸出偏移。結果是:某些族群的提示更「準」、某些族群更「吵」或更不可靠。

- 誤用風險:最常見的坑是把提示當診斷。當使用者/醫療端沒有清楚的流程邊界,系統就會被迫承擔它不該承擔的責任。

我建議你在設計上直接把「人類覆核」寫進產品規格:模型輸出只做優先級/提示,並搭配回饋機制讓臨床端能修正與累積資料。這會比單純追求更高準確率更務實。

一個很實在的落地提醒

你可以把它當成「早期風險雷達」,但雷達也得有校準。校準的方式就是持續評估(validation)、偏差檢測、以及讓醫療端在流程內使用它。

(我們可以幫你把:資料管線規格、模型評估框架、與臨床/客服工作流整合一起規劃。)

FAQ:你最可能會問的 3 件事

UT Dallas 這種 AI 是在做診斷嗎?

從研究描述脈絡來看,它主要是做早期檢測與預警,讓醫療人員能及時介入;實際診斷仍應由臨床端完成。

多模態資料為什麼要一起用?

因為情緒與精神狀態通常不只反映在單一訊號。臨床數據提供語境、生理指標補身體層線索、語音特徵則捕捉可量化的情緒外顯。

這類系統最該先顧的風險是什麼?

隱私與偏差,其次才是模型效能。更重要的是避免把提示誤用成診斷結論。

參考資料(真實連結)

- UT Dallas News:Emotions in Motion: How Movement May Signal Mental Health Issues(含團隊研究脈絡)https://news.utdallas.edu/health-medicine/motion-capture-movement-mental-health-2026/

- CBS News(UT Dallas 早期偵測精神健康相關報導)https://www.cbsnews.com/texas/video/ut-dallas-research-aims-to-use-technology-for-early-detection-in-mental-health/

- Gartner(2026 AI 支出預估)https://www.gartner.com/en/newsroom/press-releases/2026-1-15-gartner-says-worldwide-ai-spending-will-total-2-point-5-trillion-dollars-in-2026

- Nature(多模態早期偵測精神健康的研究方向)https://www.nature.com/articles/s41598-025-00386-8

- JMIR(語音分析與憂鬱/焦慮風險偵測的管線描述)https://www.jmir.org/2024/1/e58572

Share this content: