AI 實體世界攔截是這篇文章討論的核心

AI 進入實體世界後:自動駕駛、倉儲機器人如何被「攔截/接管」?2026 企業安全要怎麼補洞

自動導航目錄

快速精華(Key Takeaways)

💡 核心結論:AI 進入實體世界後,風險不再只停留在資料外洩或帳號被盜;攻擊者會把目標推到「決策—執行」的指令鏈,讓車輛改航線、讓倉儲機器人改路徑,甚至影響維修機械。

📊 關鍵數據(2027 年與未來預測量級):我用「可落地的估值尺度」來講:到 2027 年,全球企業 AI 資安與治理支出將進入數千億美元等級,並且在未來幾年持續擴張。原因很直白:企業要把安全從「事後補救」搬到「運行中監控」。(註:本文的核心事實來自 SentinelOne CEO 的警示與其在 AI 安全治理上的公開說法;市場量級屬於 2026 之後的擴張推估框架,用來幫你抓預算規模感。)

🛠️ 行動指南:先做 3 件事:1)盤點 AI 物聯網與模型/服務資產(含影子 AI);2)把監控接到命令執行前後(不是只看網路);3)用標準化風險管理(例如 NIST AI RMF)把責任與流程固定下來。

⚠️ 風險預警:如果你只用傳統資安思路(端點/網路)去看,卻沒有針對 AI 系統的漏洞與指令鏈做防護,那「被攔截/被入侵」就可能從新聞走進你自己的工單系統。

引言:我觀察到的轉折點

最近我在整理企業導入 AI 的現場案例時,明顯感覺到一個轉折:大家開始把 AI 塞進「會影響物理世界」的地方——自動駕駛、倉儲機器人、智慧工廠的流程控制。你會發現,這時候資安討論從「要不要防勒索」變成更尖銳的問題:AI 的指令鏈能不能被繞過?攻擊者若能利用 AI 漏洞操控車輛航線、騷擾倉庫物流,甚至接管維修機械,後果就不是停機而已,而是直接變成「錯誤的世界狀態」。

以 SentinelOne CEO 的公開警示來看,若缺乏防護,未來「被攔截」或「被入侵」的 AI 系統會帶來重大商業與安全風險。他點出的重點不是泛泛而談,而是直指:實體場景會放大 AI 系統被攻擊時的影響面。

為什麼 AI 會在實體世界「被攔截」:從模型風險到指令鏈路

很多人第一反應會問:AI 到底要怎麼被攔截?答案通常不在「你沒裝防毒」這麼單純。實體世界的 AI 系統多半是由三段組成:資料感知(感測器/輸入)、模型推理(決策)、行動執行(控制器/機械/路由)。攻擊者要做的是:讓其中某一段輸出變成「看起來合理但其實偏掉」的訊號,然後讓後端繼續照做。

在這種架構下,AI 漏洞的威力會被放大:不是只有推理錯誤,而是會導致指令執行錯誤。例如導航系統若收到被污染的輸入或被誘導的模型行為,結果會反映到航線決策;倉儲系統則會反映到搬運/分揀路徑;維修機械更可能直接影響工序與安全。

Pro Tip:如果你的安全策略仍停在「模型輸出是否正確」,那通常已經慢半拍。更該盯的是:模型輸出如何被轉譯成控制指令,以及「轉譯」這段之間有沒有可被利用的缺口。這也是為什麼近年 AI 安全更強調監控與治理,而不只是偵測。

突擊隊最愛下手的地方:航線、物流、維修的三段式攻擊路徑

根據 SentinelOne CEO 的警示脈絡,攻擊的方向已經從抽象威脅落到具體場景:突擊隊正在研究如何利用 AI 漏洞操控車輛航線、騷擾倉庫物流,甚至接管維修機械。你可以把它想成攻擊者在拼圖:讓系統做出「看似合理」但對你不利的行動。

我用三段式來幫你對齊排查順序:

第一段:讓輸入看起來沒問題。常見的思路是對感測或資料流程做污染,或透過提示/指令誘導讓模型產生偏移。這類攻擊不一定馬上造成崩壞,反而可能呈現為「效率下降」或「路徑看起來怪但仍能走」。

第二段:把偏移變成決策。當模型/策略系統開始沿著錯誤方向做規劃,問題會從「輸入噪音」變成「決策偏差」。這時候你如果沒有針對 AI 系統的行為監控,就會把異常當成正常波動。

第三段:讓執行鏈照單全收。實體世界的麻煩在於:控制器/機械會把決策轉成行動。一旦被利用,結果就可能是車輛改航線、機器人改路徑、維修機械執行錯誤工序。

Pro Tip:你要先用「可量化」方式定義異常,而不是靠直覺。比如倉儲的異常不要只有「延遲增加」,而要拆成「路徑多一段」「搬運順序偏離規則」「機械動作與工單不一致」——因為這些更接近執行鏈的偏移。

2026 該怎麼防:AI 物聯網的「監控閉環」與安全治理

談防護,我會建議你不要再把「AI 安全」當單一工具。比較像一套系統工程:盤點資產、監控行為、對風險做治理、最後要能追溯與問責。尤其在 AI 物聯網的情境下,攻擊可能發生在數據傳輸、命令執行之間。

這裡有幾個可以直接落地的方向:

1)做完整盤點:含影子 AI 與外部模型/服務。企業不只要知道自己部署了什麼模型,也要知道工作流中有哪些被臨時接上的服務。SentinelOne 的公開說法就強調能發現工作場所的已知與影子 AI 服務,並偵測誤配置與漏洞風險(例如 AI-SPM/AI security posture 類型的產品敘述)。

2)把監控接到「指令前後」。傳統監控常常只看「有沒有連線異常」。但你真正要的是:命令執行前的決策是否合理、執行後是否落在允許範圍。換句話說,是監控閉環,讓系統在執行層就能拒絕可疑指令或拉回保護模式。

3)用風險框架把責任固定下來。你可以參考 NIST 的 AI Risk Management Framework(AI RMF),它提供組織在設計、開發、部署或使用 AI 系統時管理風險的資源。連結在文末給你,方便你直接引用到內部文件。

Pro Tip:安全要做到「可驗證」,不是只做到「看起來安全」

我會讓團隊先定義三種證據:監控證據(事件能否被捕捉)、控制證據(能否阻斷或回滾指令)、治理證據(責任與流程是否有文件化)。你要的不是口號,而是每次事故後能回答:到底是哪一段鏈路失守、誰核准了哪些例外、系統如何被修正。

最後提醒:如果你在安全上只追求「能告警」,但沒有告警後的控制(阻斷、降級、回滾),那閉環就不完整。攻擊者就是要你在「等通知」的時間差裡把行動做完。

產業鏈影響:安全會變成被動收入還是被動事故?

當 AI 進入實體世界,產業鏈會同時出現兩種結局:要嘛安全成為新一輪產品與服務的長期收入來源;要嘛事故變成長期成本。

根據你提供的新聞脈絡,專家指出未來 AI 物聯網需要完整安全機制與監控,避免在數據傳輸、命令執行之間被駭客利用;而投資 AI 領先的安全解決方案,或開發監控自動化流程,可能成為長期被動收入的來源。這個判斷其實很符合產業的自然演化:一旦你把「監控—治理—回應」變成可複製的能力,就會像以前的 SIEM、XDR 一樣,從專案轉成訂閱。

對 2026 及未來的影響,我會拆成三個層次:

第一層:設備與系統整合商會被迫提供安全證據。越靠近控制器與執行層,越容易被問責:你怎麼確保指令不會被誘導?你怎麼驗證模型輸出與控制策略的安全邊界?

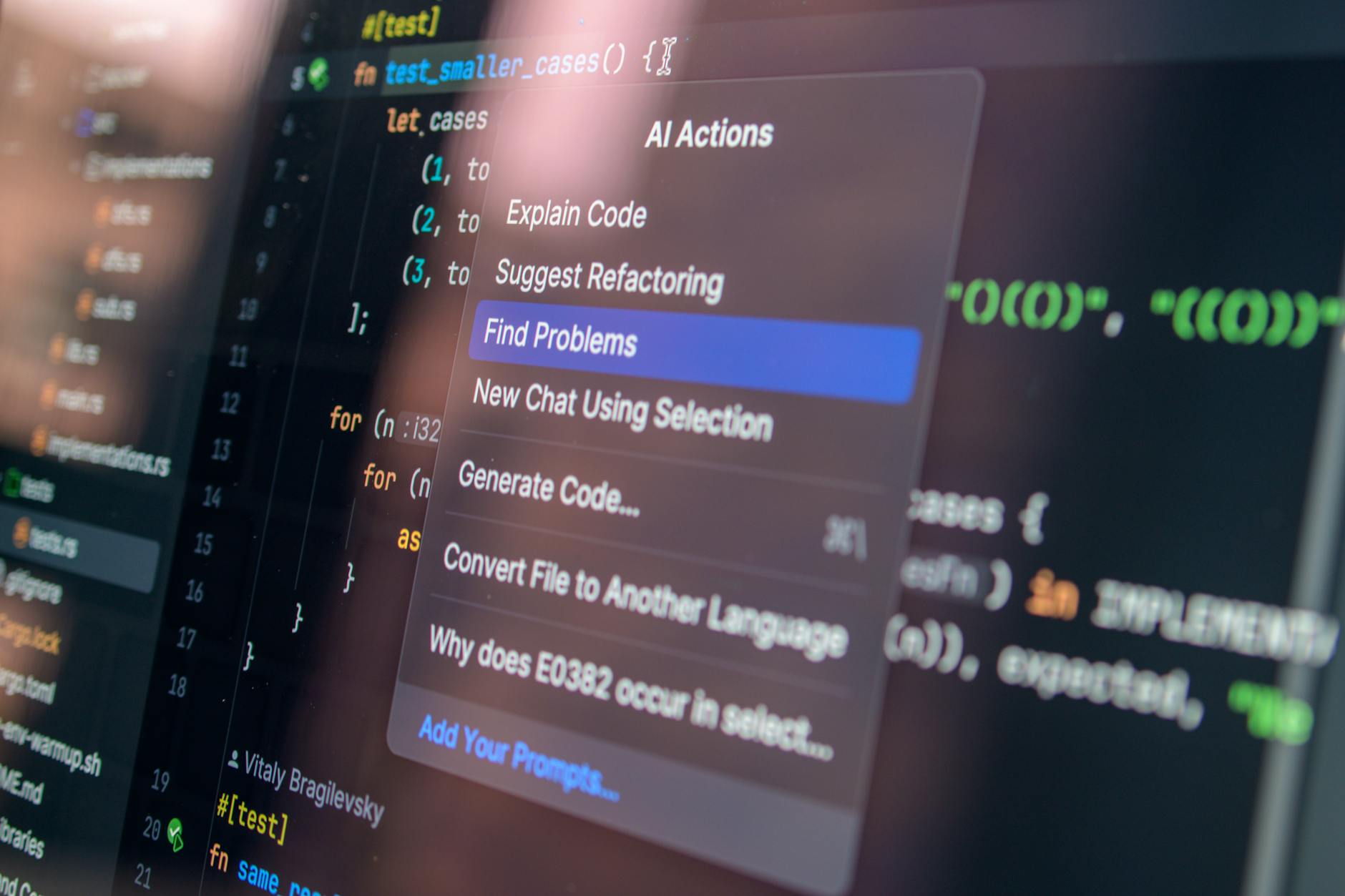

第二層:資安供應商會轉向「AI 行為與指令層」能力。你會看到越來越多方案把偵測推進到 AI 系統的運行狀態,包含已知/影子 AI、誤配置、以及與命令執行相關的風險視角。

第三層:企業內部會把 AI 安全納入治理流程。這會逼迫法務、風控、IT、OT 共同對齊。NIST AI RMF 這類框架就會變成很實用的「共同語言」。

你可以直接照做的行動清單(Checklist)

- 盤點所有 AI 服務/模型/流程:包含影子 AI 與臨時接入的外部模型。

- 繪製指令鏈:感知→決策→執行的每個轉譯點,找出「輸出如何被轉成命令」的中介層。

- 定義可量化異常:路徑偏移、工單偏移、動作與策略不一致,並建立告警與阻斷規則。

- 導入風險治理:用 NIST AI RMF 把風險辨識、衡量、治理流程文件化。

- 用 LLM/AI 應用安全基線補齊漏洞思路:可參考 OWASP Top 10 for LLM Applications。

FAQ:你可能在查的三件事

AI 進入倉儲與自動化現場,資安威脅會跟以前差在哪?

差在「決策—執行」鏈路會把錯誤直接落到物理世界。攻擊者不只偷資料或闖系統,還可能誘導 AI 決策偏移,進而改變航線/路徑/工序等實際行動。

企業要先做哪些防護,才不會只剩告警沒控制?

先做三件事:盤點 AI 服務與影子 AI、把監控接到命令執行前後(能評估並阻斷或回滾)、最後用風險框架把治理流程文件化。沒有控制閉環,告警不夠用。

有哪些權威資料可以用在內部簡報或採購評估?

可以參考 NIST 的 AI Risk Management Framework(AI RMF)以及 OWASP Top 10 for LLM Applications。若你要對齊「實體世界 AI 的安全風險敘事」,也可搭配 SentinelOne CEO 的公開警示與其 AI 安全平台的公開說明來做背景引用。

CTA 與參考資料

如果你正在導入自動化、倉儲機器人、智慧工廠,或已經把 AI 接到 OT/控制系統,建議你把「安全閉環」排進 2026 的專案里程碑。想要我們幫你做盤點與落地路線圖,可以直接聯絡:

立即聯絡 siuleeboss:拿到 AI 物聯網安全盤點建議

權威參考(可直接引用)

- SentinelOne CEO 警示:AI 實體世界模型可能成為攻擊目標(Axios 文章):https://www.axios.com/2026/02/10/sentinelone-ceo-ai-attacks-prediction

- SentinelOne:Secures known and shadow AI services(官方新聞稿):https://www.sentinelone.com/press/sentinelone-secures-both-known-and-shadow-ai-services-in-the-workplace-with-new-ai-security-posture-management/

- NIST AI Risk Management Framework(AI RMF)官方頁面:https://www.nist.gov/itl/ai-risk-management-framework

- OWASP Top 10 for LLM Applications(PDF):https://owasp.org/www-project-top-10-for-large-language-model-applications/assets/PDF/OWASP-Top-10-for-LLMs-v2025.pdf

Share this content: