Marvell 1.6T DSP是這篇文章討論的核心

💡 核心结论

Marvell 不是下一个 Nvidia——它是 AI 基础设施的”隐形 plumbing”,靠着 1.6T 光學 DSP 和定制化 ASIC,在数据中心连接市场悄悄吃掉 Broadcom 的地盘。2026 财年营收 81.95 亿美元(+42%),数据中心占比已达 74%,这个数字在 2027 年还会加速。

📊 关键数据

- 2027 市场规模预测:AI 芯片市场预计达 4000 亿美元(AMD CEO Lisa Su),AI 基础设施投资到 2027 年可能突破 1 万亿美元(New Street Research),整个半导体产业在 2030 年达到 1 万亿美元(McKinsey)。

- Marvell 自身轨迹:2026 财年数据中心营收超过 60 亿美元(+46%),Q4 单季 22 亿美元,毛利率 operating leverage 明显。CEO Matt Murphy 预告 2027 年每季增长都会加速。

- 产品里程碑:1.6T 光学 DSP 开始客户送样,2nm 工艺 Celestial AI 光子集成技术(收购价 32.5 亿美元)将在 2029 年贡献 10 亿美元营收目标。

- 竞争格局:Broadcom 占定制 AI 芯片市场 70%,但 Marvell 在 800G/1.6T 光學模块和 DPU 市场正以每年 50%+ 速度扩张。

🛠️ 行动指南

- 投资窗口:关注 Marvell 2026 Q3-Q4 财报,数据中心 segment 是否维持 70%+ 营收占比。

- 技术验证:追踪其 1.6T DSP 在 Google、Meta 超大规模数据中心的部署进度,2026 下半年 OFC 展会是重要指标。

- 供应链切入:若 TSMC 3nm/2nm 产能继续告急,Marvell 凭借 Celestial AI 的光子集成可能获得差异化优势。

- 风险对冲:将 Marvell 与 Broadcom、Nvidia 组成 AI 基础设施 triad,分散单一公司执行风险。

⚠️ 风险预警

- HBM 内存短缺正在从 GPU 蔓延到整个 AI 基础设施, Automotive 与工业用芯片可能被排挤(KPMG 2026 报告)。

- 地缘政治:Marvell 在印度、以色列的生产据点面临出口管制不确定性。

- 估值陷阱:虽然相对 Broadcom 的 20 倍 PE 差距存在,但 Marvell 的 50% 增长能否持续到 2027 仍待观察。

- 技术路线博弈:Nvidia 的 NVLink、AMD Infinity Fabric 与以太坊阵营(如 Marvell)的标准之争,客户可能不会 all-in 某一方案。

从 GPU 狂热到基础设施现实:AI 钱潮正在流向哪里?

观察 2026 年第一季度的 AI 产业动态,会发现一个微妙但重要的转变:当所有人都盯着 Nvidia Blackwell GPU 的出货量时,真正的瓶颈已经悄悄转移到网络带宽、内存带宽和能效比这些不起眼的 infrastructure 层面。这就像建造高速公路时,所有人都去抢购最好的卡车(GPU),却忽略了路灯信号系统和加油站(网络与内存)实际上决定车流的效率。

Marvell Technology (NASDAQ: MRVL) 这家总部位于 Santa Clara 的芯片公司,正在这个基础设施层面悄悄构筑护城河。它的产品线覆盖了从光學 DSP、SerDes、交换机到 DPU 的完整 connectivity stack。根据 Marvell 投资者简报,这个 portfolio 已经支撑起”业界最全面的 AI 数据中心连接解决方案”(the industry’s most comprehensive portfolio of AI data center connectivity solutions)。

为什么会发生这种转移?根源在于 LLM 训练与推理的网络需求已经超出传统数据中心设计。一份 IETF 草案文件明确指出,部署大规模 LLM 推理服务需要高效网络管理与硬件协同,以最大化系统吞吐量并最小化用户感知延迟。简单说,当 GPT-4 级别的模型分发到数千个节点时,网络不再是配角,而是决定 AI 产能的上游限制因素。

Pro Tip:理解 AI 基础设施的 tri-level 架构

Think of AI data centers as having three layers:

- Compute Layer: Nvidia GPUs, AMD MI300X, custom ASICs — the brain.

- Memory Layer: HBM3e stacks, LPDDR5X — the short-term memory.

- Connectivity Layer: This is Marvell’s playground. 1.6T optical DSPs, 400G/800G/1.6T switches, DPUs — the nervous system.

当第二层(内存)的 HBM 供应紧张时,第一层的 GPU 会 idle 等待数据;当第三层(网络)带宽不足时,加速器的利用率会暴跌。Marvell 直接命中第三层的痛点。

从市场数据来看,这不仅仅是理论推演。根据 Deloitte 2026 半导体展望,全球半导体销售额在 2025 年增长 22% 后,2026 年将加速至 26%,达到 9750 亿美元的历史峰值,主要由 AI 基础设施驱动。而 New Street Research 更进一步指出,AI 相关的数据中心资本支出到 2027 年可能突破 1 万亿美元,其中网络设备、冷却系统、电力设施等非 GPU 支出占据相当比例。

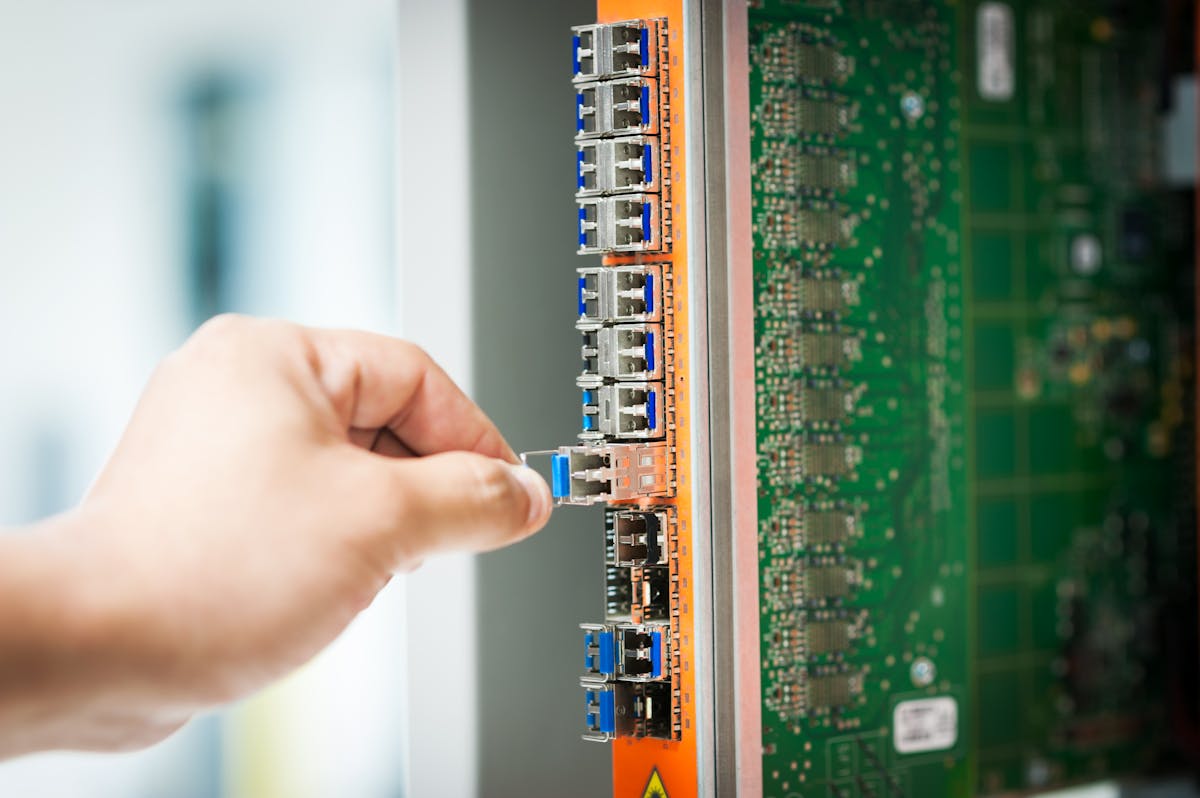

Marvell 的 1.6T 光學大法:为什么每颗 AI 芯片都需要它的 DSP?

返回搜索结果时会看到 Marvell 在 2026 年初密集发布 1.6T 光学 DSP 平台。关键在于,这不仅是产品迭代,而是从 800G 向 1.6T 的跨代跃迁。Ara T 作为业界第一颗 8x200G 接收端重定时光学 DSP,能效比提升显著,直接降低超大规模数据中心的运营成本。

为什么需要 1.6T?答案是 LLM 模型的跨节点通信强度。以训练一个万亿参数模型为例,GPU 集群需要在数千个节点间同步梯度。如果网络带宽不足,同步时间可能超过计算时间,导致整体训练效率低下。这就是所谓的 通信边界 (communication-bound) 问题。光学 DSP 的核心作用是将电信号转换为光信号,在光纤中实现超高速、长距离传输,减少信号衰减与延迟。

Marvell 的布局特点在于端到端覆盖——从芯片级 DSP、SerDes、到板级交换机、再到系统级 AEC(有源电连接)解决方案。这种垂直整合让客户(如 Google、Microsoft)可以从一个供应商获得整套连接方案,简化供应链。例如,Marvell 的 ColorZ 800G 可插拔模块(第二代)搭配 Libra 2nm 相干 DSP,已经进入客户样品阶段。

对比竞争对手 Broadcom,Marvell 的优势在于更专注的 connectivity 组合,而非 Broadcom 的广泛收购带来的规模效应。Trefis 分析指出,两家公司在 AI stack 上技术重叠度高达 80%,但估值差距达到 20 倍。这意味着市场可能低估了 Marvell 在定制 AI 芯片(ASIC)市场的增长潜力。目前 Broadcom 占定制 AI 芯片市场约 70%,但 Marvell 凭借 Avera Semiconductor(原 GlobalFoundries 的定制 ASIC 部门)和 Inphi 整合,正在吞噬剩余 30% 中的份额。

Celestial AI 收购案解析:32.5 亿美元买下的光子未来

2025 年 12 月 Marvell 宣布以 32.5 亿美元收购 Celestial AI(10 亿现金 + 22.5 亿股票),被视为继 Cavium、Aquantia、Inphi 之后最战略性的一笔交易。Celestial 的核心是 Photonic Fabric —— 一种专为 AI 计算系统设计的光互连技术平台,能够实现计算、网络和内存之间的超低延迟、高带宽连接。

想象一下:传统 AI 数据中心中,GPU 与 GPU 之间通过 Copper 线缆或 800G 光学模块传递数据,功耗与延迟是一大痛点。Celestial 的光子集成技术可以将这些连接直接集成到硅片中,大幅减少信号转换损耗。对于训练 GPT‑4 级别的 LLM 而言,这意味着训练时间可能从数周缩短到数天。

Marvell CEO Matt Murphy 将此视为”加速下一代数据中心规模互连的战略举措”。根据交易条款,Celestial AI 被要求达到 2029 年贡献 10 亿美元年营收的目标,这相当于 Marvell 总营收的 12%+。若达成,将是大规模收购后首次成功整合的里程碑。

Pro Tip:看懂”String-of-Pearls”收购策略

Matt Murphy 自 2016 年接任 CEO 后,玩的就是”珍珠项链”策略:不搞一次吃掉大公司的豪赌,而是精准收购技术小巨头(如 Cavium 的服务器 CPU、Inphi 的高端 DSP、Celestial AI 的光子集成),再将它们有机整合到 Marvell 的数据基础设施平台。这种策略的成败取决于两点:

- 文化融合:Simplicity 是 Murphy 常挂嘴边的词,精简产品线,聚焦高增长工作负载。

- 技术协同:Marvell 能否将 Celestial AI 的光子技术与现有的 1.6T DSP 组合,推出真正差异化的产品?

数据中心 segment 占比 74% 背后的增长引擎

Marvell 2026 财年总营收 81.95 亿美元,同比增长 42%,其中数据中心业务贡献了约 74%,即 60.6 亿美元,同比增长 46%。更令人瞩目的是,这一增长发生在”后继乏力”的担忧之中——2025 年 Marvell 股价曾从 52 周高点下跌超过 30%。

这背后有几个关键动力:

- Auto Ethernet 业务剥离:2026 年初 Marvell 将汽车以太网业务以 25 亿美元出售给 NXP,精简后更聚焦数据中心。虽然短期营收受影响,但长期让分析师更清晰看到核心增长。

- Azure 合作深化:Marvell 的 ThunderX2 ARM 服务器 CPU 已部署于 Microsoft Azure,同时 DPU 产品在 Azure 的云基础设施中获得采用。这种超大规模客户背书至关重要。

- Switch 51.2 Tbps 爬坡:超高密度交换机开始量产,应对 10 万+ GPU 集群的 east-west 流量需求。

- 光学模块 800G/1.6T 转型:从 400G 向 800G 的量产,同时 1.6T 样品已送测客户,技术领先 Broadcom、博通等对手约 6-12 个月。

从数据可见,AI 基础设施市场规模在 2026 年已经超过 1000 亿美元基准线(Mordor 预测为 101.17B,Bain 的 AI 总市场更高),而且增长曲线并未放缓。这意味着 Marvell 的数据中心 segment 增长(46%)与整体市场(约 50-60%)基本同步,但考虑到其在 1.6T 光学和 DPU 细分市场的份额仍在扩张,有机会在 2027-2028 年取得超额收益。

2027 年市场量级推演:半导体进入 2 万亿美元时代?

关于 2027 年的预测,不同机构给出的数字差异明显,但共识是:AI 将推动半导体进入量级跃迁。McKinsey 统计,2024 年全球半导体产值约 6300-6800 亿美元,到 2030 年将到达 1 万亿美元。Deloitte 更进一步指出 2026 年已达 9750 亿美元,年增 26%,甚至 2036 年可能触及 2 万亿美元。

这种量级增长背后有三个引擎:

- AI 芯片本身:AMD CEO Lisa Su 预测 AI 芯片市场到 2027 年达到 4000 亿美元。

- 数据中心资本支出:除了 GPU,还有网络交换机、冷却系统、电力设施、内存等,New Street 模型显示整体可能达 1.2 万亿美元。

- 边缘与汽车:自动驾驶、智能工厂的边缘 AI 芯片需求也在爆发,PwC 报告指出 automotive HPC 与传感器芯片需求将持续增长。

对于 Marvell 而言,这意味着其覆盖的connectivity stack(网络、光學、DPU)将受益于整体蛋糕变大,而不必只在定制 AI 芯片(ASIC)市场与 Broadcom 硬碰硬。Broadcom 目前占定制 AI 芯片约 70% 份额,但 Marvell 的策略是通过”先连接,再计算”——让客户先采用其光學 DSP 和交换机,再逐步导入定制 ASIC 设计服务。

Pro Tip:识别 Marvell 的”相邻市场扩张”路径

Marvell 的 playbook:

- Phase 1: 提供标准光學 DSP 和交换机给云厂商(easy to adopt)。

- Phase 2: 基于标准产品积累信任后,切入定制 ASIC 设计(higher margin, stickier)。

- Phase 3: 将 Celestial AI 的光子集成作为差异化,构建”性能护城河”,让客户迁移成本提高。

这是典型的”land and expand”打法,类似微软的 Azure 策略。

但风险同样不可忽视。KPMG 2026 半导体高管调研显示,尽管行业信心处于历史高位,供应链稳定性、能源安全 和 人才短缺 是最主要担忧。特别是 HBM 内存的短缺可能从 GPU 蔓延到整个 AI 基础设施,Marvell 的 1.6T 光学模块也需要配套的先进封装产能,而这被 TSMC、Samsung 的 3nm/2nm 产能紧张所限制。此外,地缘政治因素(如美国出口管制)可能影响其在中国市场的销售。

FAQ

Marvell 的主要竞争对手有哪些,差异化在哪里?

主要对手包括 Broadcom(定制 AI 芯片、交换芯片)、Nvidia(网络技术如 NVLink)、博通、思科等。Marvell 的差异化在于端到端连接 portfolio:从芯片级 DSP 到系统级交换机,再到光子集成技术,覆盖面更全。特别是在 1.6T 光學 DSP 领域,领先 Broadcom 约 6-12 个月。

Celestial AI 收购对 Marvell 的长期影响有多大?

32.5 亿美元的收购价相当于 Marvell 市值的约 10%,压力不小。交易要求 Celestial 在 2029 年贡献 10 亿美元营收,这意味着每年约 40% 的有机增长。若成功,将显著提升 Marvell 在下一代 AI 数据中心的光互连份额,并可能打开新的利润率区间。若失败,将成为拖累。

现在投资 Marvell 的时机合适吗?

从估值角度,Marvell 相对 Broadcom 仍有一定折价,但近期股价已因 AI 预期上涨约 20%。关键观察点:2026 下半年 1.6T 产品的客户采用率、数据中心订单能否维持每季加速、以及毛利率是否因产品组合优化而提升。建议在财报后调整仓位,避免追高。

参考资料来源

- The Motley Fool: Prediction: Massive AI Infrastructure Growth Could Send Marvell Soaring

- Marvell Q4 FY2026 Earnings Release

- Marvell to Acquire Celestial AI Press Release

- Deloitte 2026 Semiconductor Industry Outlook

- McKinsey: The underestimated size of the semiconductor industry

- eMarketer: AI market expected to surge to almost $1 trillion by 2027

- Trefis: Marvell vs. Broadcom: Same AI Stack, 20x Valuation Disparity

- KPMG: AI-Boom Drives Semiconductor Industry Confidence to Near-Record Levels

Share this content: