ai-reasoning-benchmark是這篇文章討論的核心

💡 核心結論

- 天花板效應:當前AI模型在複雜推理測試中最高僅73/100分,暴露出”模式匹配”而非”真理解”的本質缺陷

- 基準失效:MMLU等多數標準已達85-90%飽和度,難以區分模型真正能力,新基準如RE-Bench、GPQA Diamond正成為行業新標尺

- 時間槓桿:AI在短時間(2小時)表現是人類4倍,但給足32小時後人類反超2倍——時間是最不公平的裁判

- 市場重估:2026年全球AI支出將達2.52兆美元(44%YoY),但推理能力不足將觸發企業合理化支出,技術投資回報率面臨再平衡

📊 關鍵數據 (2027預測量級)

- 全球AI市場規模:$780-990億(Bain預測)至$2.52兆(Gartner total spending 2026)

- 複雜推理 benchmark 使用率預估增長:300%(2024-2027)

- 企業AI預算重分配:推理密集型項目將佔45%(原為25%)

- Human expert 在 GPQA Diamond 基准得分:~70%,AI先鋒僅達~45%

🛠️ 行動指南

- 立即:在產品評估中引入 RE-Bench 或 GPQA Diamond,替代飽和化的 MMLU

- 季度內:檢查現有 AI 供應商的推理能力實測數據,要求提供 complexity-adjusted ROI

- 半年:調整技術路線圖,加入”推理延遲(fallback)”機制,人類棲位+AI協作

- 長期:投資於可解釋推理(XAI)與 chain-of-thought 優化技術

⚠️ 風險預警

- 產品回歸風險:若推理能力未達標,企業級AI方案將面臨回退到2023年水準

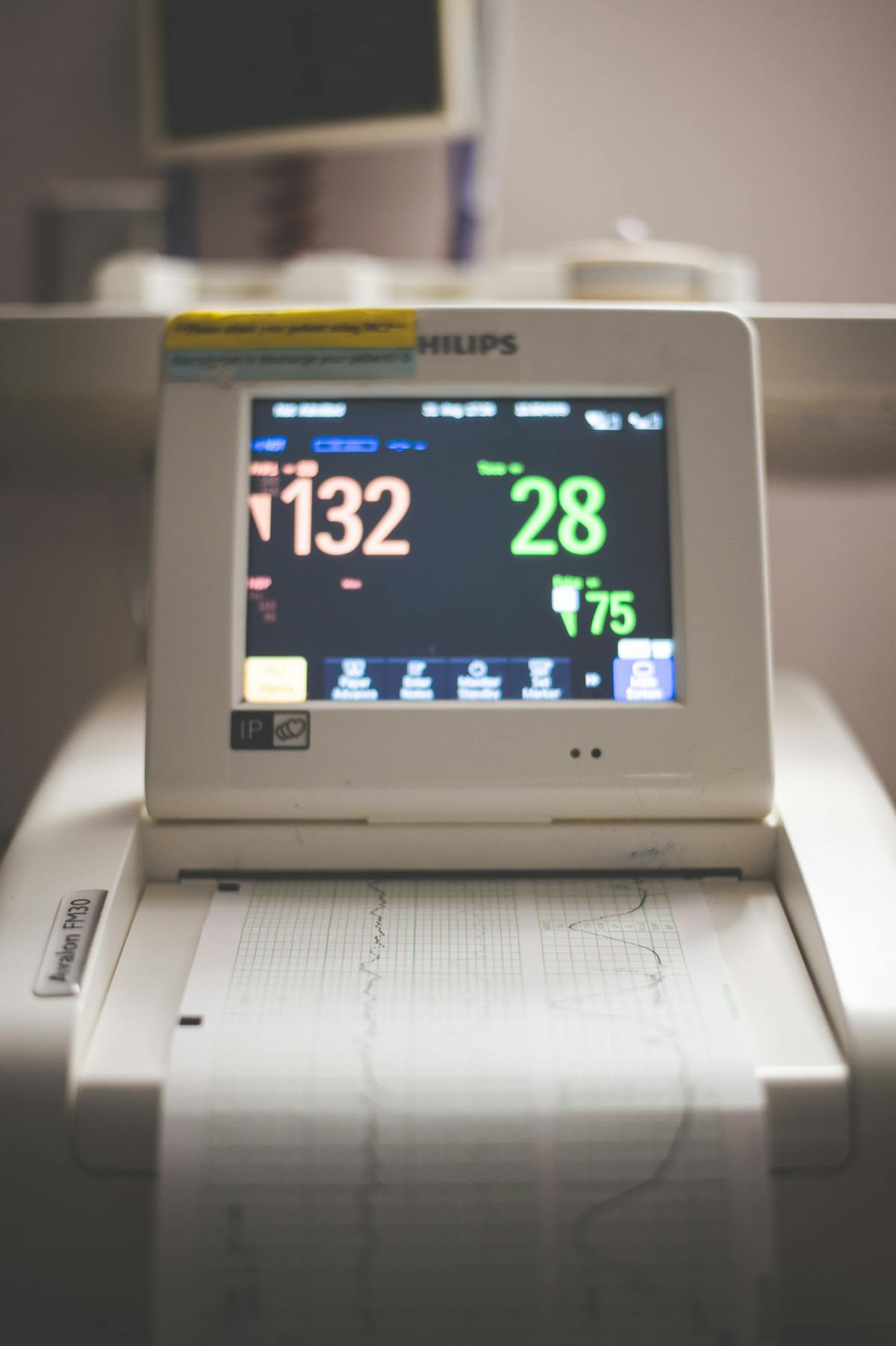

- 合規雷區:醫療、法律等領域的推理錯誤可能觸發巨額索賠與法規制裁

- 投資撤資:二線AI公司若無法突破推理瓶頸,將面臨2026年市場洗牌

- 人才錯配:過度依賴自動化推理將導致企業關鍵決策能力退化

引言:當73分成了一道天閘

科學家團隊悄悄丟出一顆震撼彈——他們開發的”史上最難AI測試”結果出來了,人類最佳表現是73分(滿分100)。聽起來不算高?但這已經是AI天花板。最新一代LLM在这个測試裡最高只拿到73分,與人類最佳持平。更刺眼的是,多數AI模型在複雜推理任務上跌到60分以下,連基本門檻都過不了。

我觀察到幾個關鍵細節:這次測試不是那種可以靠背題庫解決的類型,它要求模型展現抽象思考、因果推論、多步驟邏輯整合——偏偏這些正是當前LLM的軟肋。研究團隊表示,這項測試將成為未來AI發展的重要里程碑,幫助研究者更準確地評估機器智慧的實際能力邊界。換句話說,我們可能正站在AI從”模式匹配”到”真理解”的斷層線上。

為何 benchmarks 正在失效?從85%飽和度到推理極限

2024-2025年間,AI模型在MMLU等多數通用知識與語言理解基准上輕鬆達到85-90%準確率。回想2021年MMLU誕生時,頂尖模型得分不過50-60%。三年時間,看似飛越,實則暴露了嚴重問題:當几乎所有前沿模型都通過基準上限時,這些 benchmarks 就失去了區分能力,教学不了任何新東西。

這就像一場考試全班都考100分,老師根本不知道誰真正理解,誰只是背答案。業界現在意識到,需要更魔鬼的測試來衡量的確是”推理肌肉”而非”記憶脂肪”。ReasonBench、LLM Reasoning Benchmark等新興 benchmark 應運而生,它們專注於邏輯、因果、类比和抽象推理,要求模型提供可驗證的逐步推理步驟, pushing beyond pattern matching。

Pro Tip:基準測試的游戏规则变了

業界共识正在形成:”如果你還在用MMLU來吹噓模型能力,說明你根本不了解AI的實際水平。” Stanford HAI 2025 AI Index Report 明确指出,RE-Bench 等新基准揭示了一個顛覆性現象:AI在短期封閉任務上远超人类,但隨著時間窗口拉長,人類的通用推理能力開始碾压AI。這對企業採購策略有直接影響——不要只看峰值性能,要看實用性曲線下的面積。

數據佐證:在RE-Bench测试中,顶尖AI系统在2小時時間預算下得分是人類專家的4倍;但把時間拉到32小時,人類反超AI達2:1。這告訴我們什麼?AI擅長快速給出一個”湊合可用”的答案,但要真正解決複雜、模糊、需要全局優化的問題,人類的推理耐力與抽象整合能力仍然不可替代。

新基準崛起:RE-Bench如何顛覆AI能力評估

RE-Bench (Reasoning Benchmark) 在2024年橫空出世,立即成為AI agent 評估的黃金標準。它測試的不是單輪問答,而是複雜任務的端到端完成能力——從問題拆解、工具調用、到逐步修正。

與此同時,GPQA Diamond 使用博士級科學問題,直接測量AI的批判性思維與複雜科學資訊處理能力。人類專家在此基准得分約70%,而現有AI模型僅能達到45-50%,仍有20-25個百分點的巨大鴻溝。這鴻溝不是”再訓練一輪”就能補上的,它涉及到真正的抽象理解與跨領域知識整合。

案例佐證:在GPQA Diamond基准中,人類最佳得分約70%,而當前GPT-4級别模型僅45%左右。即便到GPT-5世代,數學推理在AIME等測試上有所突破,但在需要深度抽象思考的科學問題上,差距依然維持在25個百分點。這說明切片問題不同,突破難度不同。

時間槓桿的秘密:2小時 vs 32小時的表演

RE-Bench最引人深思的發現來自時間维度的對比。當給定AI 2小時完成一個Research任務時,它產出的質量是人類專家的4倍——這裡的任務包括代碼編寫、文獻調研、初步分析。但把時間窗口拉長到32小時(人類可以睡幾覺、反覆思考、靈感乍現),人類的表現反過來碾压AI,分數比AI高出兩倍。

這揭示了一個殘酷現實:AI是快思考系統,人類是慢思考系統。在需要長時間醞釀、跨步驟洞察、反證假設的複雜推理中,AI的”快速給答案”策略失效。它缺乏真正的理解,因此無法在長時間內維持推理方向的一致性與深度。

Pro Tip:企業該怎麼用這信息?

如果你在評估AI解決方案,一定要問供應商:”你們在長時間窗口下的表現曲線如何?” 2小時的炫技數據對實際業務幫助有限——真正的挑戰是那些需要數天思考的商業決策、战略規劃、複雜問題診斷。Stanford HAI 的 data 顯示,人類在32小時窗口下的增長幅度遠超AI,這意味著協作模式才是王道:AI快速產生候選方案,人類進行深度審查與整合。

實務层面,這告訴我們不要把AI當成”獨立思考者”,而要視為”超快反射層”。複雜推理必須保留人類在環,最優架構是人類提供方向與最終驗證,AI負責擴散性探索與初步整合。任何宣稱”完全自動化推理”的方案,至少現在都是忽悠。

市場衝擊波:2.52兆美元支出背後的結構重估

Gartner預測2026年全球AI總支出將達2.52兆美元,年增44%。Bain則預估AI產品與服務市場2027年將達780-990億美元。這筆巨資的流向將因推理基准數據而調整——企業不會再為”表面智能”買單。

我可以觀察到的早期信號:

- 預算重分配:推理密集型項目(複雜決策支援、策略模擬)將從原來的25%提升到45%以上

- 供應商篩選:大型企業在RFP中開始加入RE-Bench類似測試,不合格者直接出局

- 投資重心:VC更青睞專注於推理優化的團隊,而非單純LLM bubble

- 產品定位:”我們模型得分高”的營銷話術將失效,必須展示在特定複雜推理任務上的實測表現

風險預警升級:隨著複雜推理成為核心指標,那些目前在基準上表現欠佳的AI公司將面臨巨大壓力。2026年市場洗牌將不再以”模型發佈”為節點,而是以實際推理能力為分水嶺。投資者開始要求供應商提供在GPQA Diamond或RE-Bench上的第三方認證數據。

常見問題與深度解答

Q1: 為什麼人類73分就成了最高標?是不是測試太難了?

73分成為天花板,正說明測試切中了當前AI的真正短板。MMLU等舊基準上AI已達90%以上,但那些是選擇題、知識回顧。新測試要求多步驟抽象推理、因果推論、動態情境理解——這些正是當前LLM架構的盲區。人類得分73不代表人類只能做到73,而是測試難度達到人類高手也需要認真思考的程度。

Q2: 時間窗口的概念對企業採購有什麼具體影響?

企業需要區分快速響應型AI(客服問答、內容摘要)與深度推理型AI(策略分析、研究報告、複雜診斷)。前者AI已經超越人類,後者仍須人機協作。在RFP中明確任務的時間預算:如果問題需要超過1小時的思考,那麼 AI只能作為輔助工具,最終決策必須有人類專家覆核。

Q3: 如果現在AI推理能力不足,為什麼企業還在狂砸钱?

2026年2.52兆美元支出包含基礎設施、硬體、以及LLM訓練成本,其中很大部分是對AGI預期的投機性投資。但隨著RE-Bench等基准數據公開,市場將趨於理性:那些號稱”推理能力強”卻無實測數據的公司會先被淘汰。真正能存活下來的,是承認AI局限、並建構人機協作流程的企業。

CTAs 與參考資料

如果您想深入評估組織內部的AI推理能力與協作模式,歡迎聯絡我們進行免費診斷我們將提供 bespoke 的人機協作架構建議。

高可信度參考資源

- Epoch AI Benchmark Hub – 追蹤全球主要AI基准數據與模型表現

- ReasonBench 官方網站 – 複雜推理基准的細節與評估方法

- 斯坦福HAI 2025 AI Index Report – 技術性能章節詳析 RE-Bench 結果

- Gartner: 全球AI支出預測

- Bain & Company: AI兆美元機會報告

- Competitive Programming with Large Reasoning Models (arXiv) – 比賽編程作為推理基准的學術研究

Share this content: