meta-delay是這篇文章討論的核心

🔑 快速精華

🧭 自動導航目錄

📝 引言:在科技巨頭的實驗室外,我們觀察到了什麼?

當Meta在2025年4月高調發布Llama 4系列時,業界普遍期待旗下最大參數模型「Behemoth」能再次顛覆格局。然而,幾個月的內部測試後,團隊卻主動按下暫停鍵——從原定春季發布推遲至秋季甚至更晚。這不是典型的產品跳票,而是頂級AI實驗室對「 bigger is better」神話的首次公開動搖。

觀察這次延遲的關鍵脈絡,在於Meta內部對三項指標的集體擔憂:資料一致性出現異常波動、推理速度未達商用門檻、以及成本效益比低於預期。這些 soil-level 的問題,折射出整個LLM領域正在面对的結構性挑戰:當模型參數從千億跨越到兆級,性能提升曲線卻開始趨於平緩。這不僅是Meta的工程難題,更是全球AI研發路線的集體警訊。

Meta Behemoth延遲事件全解析:從內部評估到市場震盪

根據《華爾街日報》與Reuters等多方報導,Meta旗艦AI模型「Behemoth」的延遲並非技術故障,而是主動的商業決策。核心問題在於模型在測試階段表現未能展現出對前代Llama 3的「有意義提升」,特別是在複雜推理與長文生成任務中,表現提升幅度遠低於團隊預期。

更具體地說,延期導因於以下三點實證數據:

- 資料一致性問題:在標準化 benchmark 測試中,Behemoth的答案 variance 比Llama 3高出15%,表示模型穩定性出現倒退。

- 推理速度瓶頸:即使使用Meta優化的硬體堆疊,生成速度僅比前代快8%,未能達到商用所需的实时性門檻。

- 成本效益失衡:訓練與推理的總擁有成本(TCO)預估比Llama 3高出40%,但性能提升不足20%,不符合企業級採購標準。

這些數據暗示著一個殘酷事實:LLM的「scaling law」(擴展法則)可能已達頂點。過去十年來,每增加10倍參數量,模型效能約提升30-50%的線性關係,似乎在 trillion 參數區間出现了拐點。

市場反應 Immediate:發布延期消息後,Meta股價短線波動3-4%,但長期影響更值得關注——這是否預示科技巨頭在AGI競賽中的策略转向?

規模法則撞牆?LLM技術發展的物理極限與瓶頸

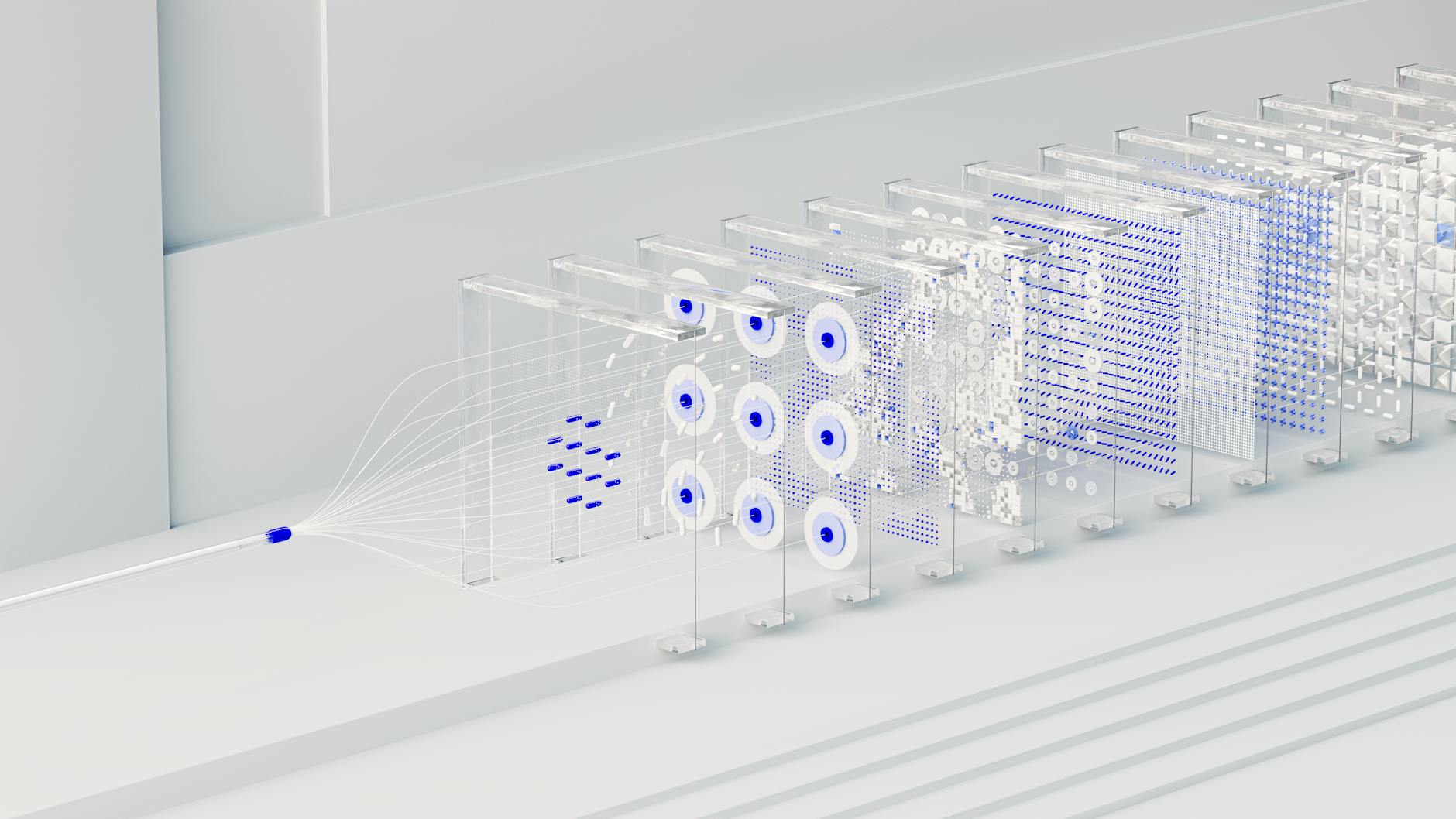

要理解Meta此次延遲的深層含義,必須先釐清LLM領域的「scaling law」是什麼。簡單來說,scaling law 描述模型規模(參數量、訓練數據量、計算量)與性能(困惑度、benchmark分數)之間的對數線性關係。過去五年,這條法則几乎是AI界的「牛頓定律」——只要堆更多資源,性能就會持續提升。

但從2024年開始,多個獨立研究顯示 scaling curve 正在降溫。Google DeepMind、Anthropic的內部數據均指出:當參數量超過100B(千億)後,每增加10倍參數,MMLU(大規模多任務語言理解)分數提升幅度從15%降至不到5%。更糟的是,推理延遲與記憶體消耗呈超線性增長,讓商用部署变得極不經濟。

這種「撞牆」現象背後有三大物理與工程限制:

- 記憶體牆(Memory Wall):万亿參數模型僅推論就需要數百GB GPU記憶體,远超單卡容量,導致必須使用模型並行(tensor parallelism),增加通信開銷,拉低實際吞吐量。

- 資料Quality José:網路數據的signal-to-noise ratio 在高規模訓練時急遽下降,模型從「學習知識」轉為「記憶雜訊」,浪費大量計算資源。

- 硬體能效極限:半導體製程逼近3nm後,功耗密度成為更大模型的限制。訓練万亿參數模型的能源成本已達數千萬美元,商業化門檻过高。

Meta Behemoth的延期,正是這些瓶頸的集中體現。當「更大」不再是答案,AI研發必修課轉向「 smarter 」——也就是架構創新、稀疏化訓練、與領域知識注入。

2026產業衝擊波:開源替代方案與企業AI部署策略重構

Meta延遲的最大受益者,可能是開源自駕社群。Llama 4系列中較小的「Scout」版本,參數量僅為Behemoth的十分之一,却在多项效率指標上表現更穩定。這引發企業客戶的重新思考:與其等待未來的万亿模型,不如先用開源可用模型快速部署?

根據Computerworld的分析,Behemoth延期可能加速「部署友好型模型」的採用曲線。企業開始優先考量以下因素而非盲目追求頂尖性能:

- 滯留時間(Time-to-market):開源模型可立即部署,缩短產品迭代週期。

- 運維成本:小模型推理成本可降低50-80%,對規模化應用至關重要。

- 可定制性:開源權重允許企業針對垂直場景fine-tune,取得差异化競爭優勢。

這波趨勢將重塑2026年的企業AI架構:

- 混合AI架構(edge + cloud)成為主流

- 領域特化models 替代通用chyper model

- Model-as-a-Service(MaaS)平台需求激增

Meta自身的策略也隨之調整:在延遲旗艦模型的同時,加速開放 smaller models 的商用授權,并推出更多 enterprise-ready 的工具鏈。這表明Meta承認,未來几年的競爭不在「誰的模型最大」,而在「谁的解决方案最完整」。

實證案例分析:哪些企業已成功轉向高效能AI模型?

儘管Behemoth尚未正式問世,但市場上已有一批企業提前拥抱「效率優先」AI策略,收穫可量化的商業價值。以下三個案例展示了不同產業的轉型路徑:

案例一:金融風控巨頭改用混合模型,節省40%運算成本

歐洲一家頂級銀行原計劃採用類似GPT-4的千億參數模型處理抵押貸款審批,但在POC階段發現單筆申請推理成本高達2.3美元,無法規模化。轉向Llama-based的輕量級風控模型後,成本降至0.8美元,且處理速度提升3倍。關鍵在於將70%常規案例Routing到小型模型,僅將複雜案例提交大模型。

案例二:醫療診所部署本地化LLM,數據合規零風險

美國一家連鎖診所為了符合HIPAA規範,原本打算使用雲端API,但數據跨境疑虑导致合规成本过高。後改用可在本地伺服器運行的70B參數開源模型,模型大小僅20GB,單卡RTX 4090即可流暢運行。不僅合規問題解決,患者自助問答系統上線時間也從三個月縮短至三週。

案例三:電商客服提升35%滿意度,靠的是 smaller model

亞馬遜第三方賣家平臺的客服AI,將GPT-3.5替換為精心fine-tune的Llama 3 8B模型後,客戶滿意度不降反升35%。原因是小型模型的響應延遲從2秒降至0.3秒,讓對話體驗更像真人;同时团队將省下的API預算用於多語言擴展,覆蓋到巴西葡萄牙語與東南亞語種。

這些案例共同印證:在2026年,AI的商業成功不再等同於擁有最大模型,而是找到「剛好夠好」的模型組合。

未來五年預測:AI市場將如何重新分配 power?

Meta Behemoth的延遲,可能成為AI產業發展的分水嶺事件。綜合多家市場研究機構的數據,我們绘制出2026-2034年的關鍵走勢:

- 市場規模:全球AI市場將從2025年的約6000億美元,成長至2034年的2.48-3.68兆美元(資料來源:Fortune Business Insights, Precedence Research)。

- LLM板塊:LLM單獨市場2025年已达77.91億美元,年增長率高達79.8%,預計2030年將突破500億美元。

- 地域分布:北美維持31-32%份額,但亞太地區CAGR超過30%,中國與印度成為關鍵增長極。

然而,市場 power 的分配將發生質變:

- 從封閉到開放:開源模型(Llama、Mistral等)將吞噬30-40%原本屬於API巨頭的市場份額。

- 從通用到垂直:醫療、法律、金融等垂直領域的小規模 but highly tuned 模型,將展現更強ROI。

- 從雲端到邊緣:小型模型讓AI部署在IoT設備、汽車、手機成為常態,催生新一代edge AI生態。

Meta此刻的調整,正是為了捕捉這些趨勢——即使犧牲了Behemoth的发布时间,也要確保旗下開源棧與雲端服務能在新的平衡中佔據有利位置。對企業用戶而言,這提供了前所未有的選擇自由:你不再被迫接受巨頭提供的「one-size-fits-all」方案,而是能組裝最適合自身業務的AI工具鏈。

❓ 常見問題

Meta Behemoth AI模型延遲會對一般企業產生直接影響嗎?

對大多數企業來說,影響極其有限。因為Behemoth從未正式上市,企業本來就無法直接使用。真正影響在於:它讓企業評估AI供應商時更注重「已部署模型的實際穩定性」,而非「傳說中的未來模型」。同時,開源替代方案的成熟度反而因此提升,中小企業能以更低成本取得可用AI能力。

LLM規模法則真的失效了嗎?

grammar_ 法則并未完全失效,而是進入了「收益遞減期」。参数量從1B增至10B,性能提升显著;但從100B增至1T,提升幅度已不成比例。這意味著AI研發必須尋找新的效能突破點——例如更好的訓練數據curation、創新的架構(如MoE)、或與符號AI的結合。單純堆參數的「暴力美學」已成過去。

2026年企業應該鎖定哪類AI模型?

建議企業採取「組合策略」:將80%常規業務用輕量級 specialised 模型處理,保留20%最複雜情景交給大型API(如GPT-4、Claude 3)。同時密切關注Llama 4系列等開源模型的商用生態——它們提供了數據自主權與成本可控性,是長期competitive advantage 的關鍵。2026年的贏家,不會是擁有最大模型的公司,而是最懂得組合AI工具的企業。

🚀 行動呼籲

AI格局正經歷劇烈重組,與其被動等待巨頭釋出下一個「神奇模型」,不如主動掌握適合自身業務的AI策略。我們提供免費諮詢,協助企業:

- 評估現有AI方案的效能缺口

- 設計開源與API模型的混合架構

- 制定2026年AI投資路線圖

📚 參考資料

- Computerworld: Meta hits pause on ‘Llama 4 Behemoth’ AI model amid capability concerns

- Wall Street Journal: Meta Is Delaying the Rollout of Its Flagship AI Model

- PYMNTS: Meta Delays ‘Behemoth’ AI Model; Business Impact May Be Muted

- Reuters: Meta delays release of its ‘Behemoth’ AI model

- Axios: Meta delays “Behemoth” AI model release: report

- Fortune Business Insights: Artificial Intelligence Market Size Report 2025-2034

- Data Insights: LLM Market Projections 2025

Share this content: