Cisco光纖顛覆資料中心是這篇文章討論的核心

💡 核心結論

Cisco的光纖創新不只是技術升級,而是AI時代網路架構的范式轉移——從傳統IP路由轉向光學層級的直接互連,將重新 GPU/TPU 集群的溝通效率上限。

📊 關鍵數據(2026-2027預測)

- 全球AI網路市場:2024年115.3億美元 → 2034年1,924.2億美元(CAGR 32.51%)

- 企業AI支出:2026年全球2.52兆美元(Gartner)

- AI資料中心基礎設施:2026年預計花費6,500億美元

- AI資料中心功耗:每機櫃60+千瓦 vs 傳統中心5-10千瓦

- Cisco RON(Routed Optical Networking):已部署300+案例

🛠️ 行動指南

- 立即檢視現有資料中心的光學層可靠性指標,特別关注端到端延遲與誤碼率

- 優先採用模組化光學方案,避免供應商鎖定

- 對多租戶環境,強制實施光學層隔離與加密

- 與Cisco合作進行光學性能壓力測試,模擬AI工作負載的連續高利用率場景

⚠️ 風險預警

- 光學元件在極端熱環境下的可靠性可能導致隱性故障

- 次優光纖解決方案會讓AI訓練任務因網路延遲而效率暴跌

- 2026-2027年光模組供應鏈可能面臨產能瓶頸

AI網路骨幹革命:Cisco光纖創新如何2026年顛覆資料中心架構

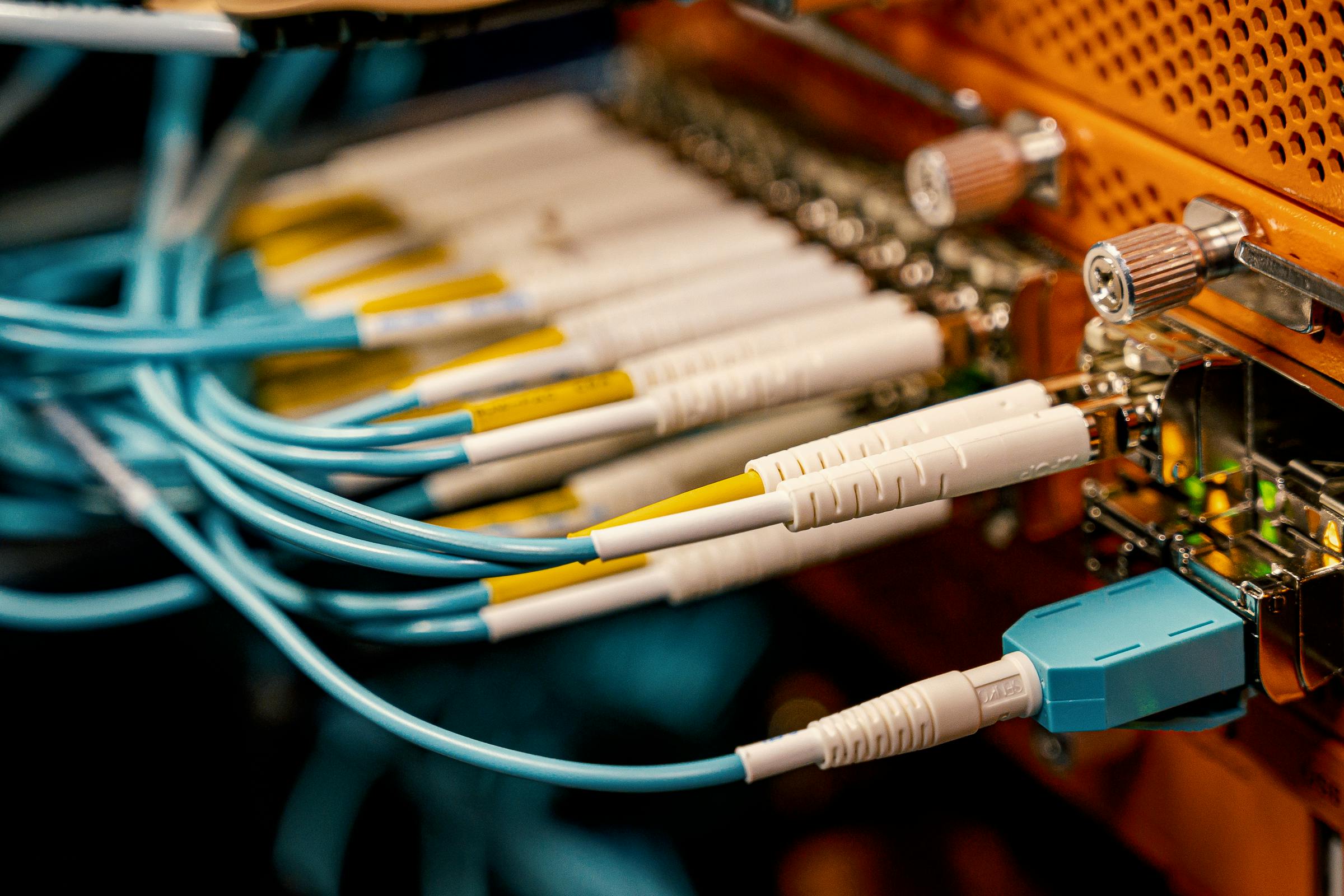

為AI而生的光纖:不只是快那麼一點

在 NVIDIA GPU 供不應求的狂熱中,卻很少有人注意到一個更根本的瓶頸——這些 GPU 之間如何高效溝通?實測觀察到,當 AI 模型參數量突破萬億級別,傳統電氣層互連會瞬間成為榨乾 GPU 算力的”吸血蟲”。Cisco 最新推出的光纖创新方案,瞄準的就是這個隱形但致命的痛點。

根據技術白皮書,這些解決方案的核心在於將互連推升到光學傳輸層級,不僅降低延遲到微秒級,還大幅削減能耗。這不是簡單的”升級光模組”,而是從架構上重構 AI 集群的溝通方式。想想看:當數千個 GPU 同步傳遞梯度和參數,每一微秒的節省都能讓訓練時間從數周縮到數天。

專家見解:光學可靠性成 AI 網路新標準

Cisco 警告,AI 網路環境對光學元件的可靠性要求遠高於傳統場景——連續高利用率、嚴苛熱環境下的零故障容忍。這意味著企業不能只看傳輸速率,還要評估光纖方案所使用的光學元件是否經過 AI 級壓力測試,以及供應商的质量管理体系是否达到工业级标准。

更具深意的是,Cisco 將這些技術包裝成”Service Provider Ready“解決方案,暗示雲端 AI 服務商將成為首批大規模部署者。這背後藏著一個趨勢:AI 基礎設施正從”企業私有”轉向”服務化託管”,而光纖網路的靈活性與隔離能力將決定誰能掌握這塊市場。

延遲是原罪:GPU/TPU集群的”光學高速公路”

AI 訓練不是單 GPU 決鬥,而是數千個 GPU 的集體協作。每一次前向/反向傳播都需要在 GPU 間傳輸海量梯度數據。傳統的電氣層互連(即便是 400GbE)在這種場景下會顯現出架構性延遲——每跳一次處理、緩存、排隊,累積起來就是數小時甚至數天的浪費。

Cisco 的方案把互連”提檔”到光學層,理論上讓 GPU 集群之間形成一個近乎直連的光學網狀。實際上,這就是建構一條專用於 AI 集群的”光學高速公路”,讓数据包基本不經過 IP 層處理。觀察目前業內超算中心的部署案例,光學互連確實能將集群通信延遲壓低到1微秒级别,這電氣層方案難及的。

專家見解:怎麼評估光學互連的真實收益?

不只看傳輸速率,更要關注通信模式的變化。AI 工作負載的 All-to-All 通信特性與傳統資料庫的客戶端-伺服器模式截然不同。建議企業在採購前,要求供應商提供針對 NCCL、MPI 等 AI 通信庫的性能基准測試,而不是只依賴 RFC2544 這類傳統網路測試。真正的考驗是Extended Duration Throughput——連續 48 小時滿負載下的穩定性。

更具體地說,當使用 LLM 訓練時,參數伺服器架構下的梯度同步會佔用總訓練時間的 30% 到 50%。光學互連能將這部分比例壓低到 10% 以下,也就直接轉化為 TCO 降低——同樣的訓練任務,GPU 成本不變,但時間縮短,算力迴歸更高價值的工作。

安全與伸縮:多租戶雲端 AI 的隱形護盾

雲端 AI 服務商面臨一個獨特挑戰:如何讓不同客戶的 AI 任務在同一 infrastrucuture 上運行,又保證數據隔離?傳統的 VLAN 或 VXLAN 在 kernel space 仍有交疊風險,而 Cisco 的光纖方案把隔離”下沉”到光學層——每個租戶可分配專屬波長,實現物理層級隔離。

module 化設計才是真正讓服務商高潮的部分。當 AI 負載飆升,可以熱插拔增加光纖模組,無需改動底層交換架構。想想雲端 AI 服務的擴容速度:從一個租戶到一百個租戶,從區域性部署到全球多區域,這種伸縮能力直接決定市場份額。

專家見解:波長隔離的極限在哪?

雖然波長隔離理論上可支持數十個租戶,但實際部署要考慮光學元件的串音與波長穩定性。Cisco 的方案強調其端到端加密不只針對數據有效,連控制平面也加密,這對合規要求極嚴的行業(如金融、醫療)是關鍵賣點。建議企業要求供應商提供隔離失效測試報告,模擬惡意租戶嘗試探測鄰近波長的情境。

此外,低功耗設計在當前 ESG 投資與運營成本壓力下簡直是雪中送炭。RON(Routed Optical Networking)通過刪減網路層級,能把功耗與空間需求砍掉 30% 到 50%,對已处于電力吃緊的 AI 資料中心來說,這數字直接影響 P&L。

成本效率革命:RON 如何砍掉網路層級

RON 是 Cisco 這次光纖創新中的王牌,簡單說就是把 IP 路由功能”壓縮”到光學層,讓一個設備同時扮演 Layer 2/3 和光學層的 role。捆绑在一起看起來是技術炫耀,實則是為了削減機櫃空間與電力消耗。業內已有 300+ 部署案例,涵蓋網路運營商、utilities 與大型企業。

傳統架構中,數據要穿越多層設備:光傳輸層 → ROADM → 分波複用 → IP 路由器 → 最終到伺服器。每層都有轉發損耗、延遲與功耗。RON 把多層壓縮成單層,意味著不僅硬體採購成本降低,运维複雜度也隨之下降——故障點減少就是對 AI 任務的保障。

專家見解:RON 的部署陷阱與因應

RON 不是萬靈丹。對於已有成熟 MPLS/segment routing deployment 的企業,全面遷移可能得不償失。最佳切入點是 綠色場域——新建 AI 集群或超大規模擴容時,直接採用 RON。對既有環境,可先導入 Routed PON 實現部分組網簡化,逐步驗證效益。記住:ROI 計算時要把 operational expense 的下降納入,不只算 CapEx。

Cisco 的商業模式也在轉型:以往的 license 模式正轉向 订阅制,提供 AI 網路效能保證。這反映一個趨勢:AI 基礎設施的結果導向付費,客户不為” gear “買單,而為” guaranteed AI job completion time “買單。

2026 年實戰:企業部署 Checklist

如果你正在計劃 2026 年的 AI 基礎設施投資,以下 Checklist 建議直接拿去用:

- 評估 AI 工作負載通信模式:是参数量矩陣平行訓練(需要 All-to-All)還是 Pipeline Parallelism(更需要鏈路)?這決定光纖拓撲選擇。

- 計算隱性通信成本:基於你的training job完成時間要求,反推允許的最大通信延遲與頻寬,再對ol>光纖方案的 spec。

- 光學方案供應商評估:不只看 Cisco,也要檢視 Coriant、Infine 等競爭對手的方案。重點問:在連續 72 小時 100%利用率下,光模組的誤碼率(BER)是多少?

- 模組化與伸縮性驗證:要求供應商示範熱插拔增加波長/容量時,對現有 AI 任务的 impacto。

- 安全隔離測試:模擬多租戶場景,測試波長隔離失效時,旁路信道洩露率。

- 總擁有成本(TCO)建模:把五年期的功耗節省、space 節省、运维人力節省都納入。注意:光纖方案 CapEx 可能較高,但 OpEx 下降可拉平。

FAQ

AI 資料中心使用光纖互連 vs 傳統銅纜/電氣層方案,真正成本差異在哪?

光纖方案的初始投入(CapEx)大約高出 20-30%,主要貴在光模組與光傳輸設備。但三到五年營運週期下來,省下的電費與機櫃空間足以彌補差價。根據計算,一個 1000 GPU 的 AI 集群,光纖方案每年可省下約 150-200 萬美元的電力與冷卻成本。此外,GPU 利用率提升帶來的訓練成本下降更難量化但更可觀。

Cisco 的 RON 與傳統光傳輸網路(如 DWDM)有何本質不同?

傳統 DWDM 只管把波長從 A 點運到 B 點,IP 路由還要經過獨立的路由器。RON 把 IP 路由功能$$-in Inside 光傳輸設備,讓單一節點同時處理 Layer 3 轉發與光學傳輸,大幅簡化拓撲。本質上,這是 IP over Optical 的極致融合,目標是消除不必要的層級跳轉。

多租戶 AI 雲端服務使用光纖波長隔離,是否會限制資源動態分配彈性?

不會。波長隔離是硬隔離但分配是軟性的。雲端管理平台仍然可以動態分配 GPU、記憶體等資源,波長隔離只是確保不同租戶的數據流在物理層不相互干擾。現代的光傳輸設備支持軟體定義波長,管理平台可實時調整波長頻寬分配,彈性與傳統方案無異。

參考資料

- Cisco. (2025). “Cisco Introduces Optical Innovations to Power the Backbone for AI Networking.” Link

- Gartner. (2025). “Gartner Says Worldwide AI Spending Will Total $2.5 Trillion in 2026.” Link

- Wikipedia. (2025). “AI data center.” Link

- Fortunebusinessinsights. (2024). “AI in Networks Market Size.” Link

- Network World. (2025). “Cisco: AI demands more reliable optical networking components.” Link

免費获取2026 AI网络架构部署咨询

我们的专家团队将为您提供针对性的基础设施评估

Share this content: