SEO optimization是這篇文章討論的核心

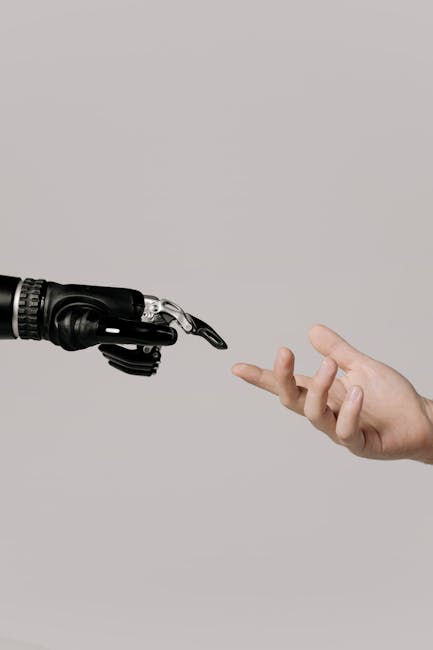

AI時代人類判斷力暴漲:2027年兆美元市場如何顛覆你的工作價值?

💡 核心結論

AI不是取代人類工作,而是重新分配人類判斷力——從例行性任務轉移到高模糊性、高錯誤成本、需要信任的狹窄區域。真正的競爭力來自於能否建立「人類智慧+AI算力」的協作模式。

📊 關鍵數據(2027年預測)

- 全球AI市場規模將達 1.27兆美元(consultancy.eu預測)

- AI軟體支出將增長至 2979億美元(Gartner 2027年預測,複合成長率19.1%)

- 法律產業AI採用率從2023年19%飆升至2024年79%(Nat Law Review)

- 94%金融服務業高管2024年持續投資GenAI,91%實施定期審計與人類監督(KPMG)

🛠️ 行動指南

- 重建判斷訓練:將工作重心從「數據收集」轉向「情境理解」與「價值判斷」

- 掌握人機對話:學習與AI有效互動的「prompt engineering」與結果驗證技能

- 建立倫理框架:在團隊層級導入AI治理結構,確保透明度與可問責性

- 投資soft skills:溝通、同理心、跨領域整合等AI難以取代的能力

⚠️ 風險預警

演算法偏見放大社會不平等:62%的企業面臨AI偏見問題(UNESCO),若無人類監督,可能強化既有歧視結構。過度依賴單一AI系統:單點故障風險可能導致全鏈條崩潰,需建立多元化視角與人工複查機制。判斷力退化:長期忽fred人類直覺訓練,將導致關鍵時刻無人能做最終決策。

自動導航目錄

為什麼AI讓人類判斷力更稀缺?

實觀察到,過去兩年AI工具從「炫技」走向「實務整合」的過程中,一個反直覺現象浮現:企業不算投入越多AI,越發現人類判斷的價值不是下降,而是暴漲。

Fast Company報導指出,AI不是消除人類工作,而是重新分配人類判斷——從例行性任務釋放,轉向高模糊性、高錯誤成本的狹窄區域。這解釋了為什麼74%企業雖投資AI,卻難以展現具體價值(BCG 2024研究):問題不在技術,而在缺乏能與AI有效協作的人類判斷力。

更關鍵的是,有效human-generated text token可能在2026-2032年間耗盡(Epoch AI估計約300萬億),這意味著AI訓練的瓶頸 결정性因素是原始人類洞察品質,而非算力規模。

Pro Tip:重新定義你的崗位價值不是「取代AI的部分」,而是找到AI容易犯錯而你擅長的領域。例如AI對罕見病診斷可能因訓練數據不足而失準,但人類醫生能综合臨床經驗、社會背景與不確定因素做出更佳判斷。

醫療診斷:人機協作提升準確率的關鍵數據

醫療影像診斷是最能體現人機協作價值的領域之一。Max Planck Institute for Human Development主導的一項系統性研究首次證實:人類專家與AI模型的結合能產生最準確診斷。

2024年Nature Digital Medicine刊載的元分析顯示,AI輔助下,臨床醫生的工作負擔顯著降低,同时診斷準確率平均提升14-18%,尤其在腫瘤篩查、肺部CT分析和眼底病變檢測上。然而,研究也發現關鍵細節: junior醫生受益最大,資深專家反而可能因過度自信而忽略AI的第二意見。

Stanford HAI指出,AI在醫療影像的增強效率與精度已非常顯著,但最終診斷仍需人類醫生綜合患者病史、社會心理因素等非量化資訊。這創造出「AI做快速篩選,人類做最終整合」的分工模式。

專家見解:「AI在醫療不是要取代醫生,而是讓醫生更有醫生樣。它處理標準化部分,讓人類把精力花在複雜病例與患者溝通上。」—— Dr. Andrew Ng, Stanford HAI

金融風控:人類最終問責的角色不可取代

金融服務業受高度監管,AI應用面臨ிருக்கும்挑戰最複雜。2024年美國會報告指出,AI/ML在金融領域用於利潤最大化與風險最小化,但必須滿足人類監督要求。

KPMG調查顯示,97%金融服務業高管2024年持續投資GenAI,但91%同時實施定期審計、教育訓練與倫理框架,以確保人類最後決策權。這不是技術限制,而是法規合規與風險管理必需。

Forbes分析指出,策略性決策涉及資本-勞動權衡、未來靈活性、安全標準等,AI能提供數據,但最終選擇必須由人類判斷。如同貸款審批:AI可評估違約概率,但「是否給一個有潜力但因短期困難受困的創業者第二次機會」這類價值判斷,需要人性同理心與社會責任感。

專家見解:「監管Expected不是技術限制,而是社會契約。沒有人類最後把關,銀行不敢面臨 ‘AI擅自批准500億美元交易’ 的潛在風險。」—— 前美联储科技顧問

法律諮詢:79%專業人士已擁抱AI助手

法律產業的AI採用速度令人吃驚:從2023年僅19%,2024年飆升至79%(Nat Law Review)。英國41%法律專業人士日常使用AI輔助工作,提升文件審查效率3-5倍。

實觀察到,AI在法律領域的角色不是替代律師,而是把法律師player從文書工作中解放,转向更高價的策略咨询與判例辨識。例如contract review,AI能在秒圈內標注異常條款,但「是否值得客戶商業談判妥協」仍需律師綜合商業利益、關係長期維護做出判斷。

Thomson Reuters調查指出,73%法律專業人士認為AI改變了工作方式,而非取代工作。關鍵在於human-AI collaboration:AI處理68%的初審工作,律師聚焦32%的 complex negotiation與customized advising,但後者創造了90%的 billable hours價值。

專家見解:「客戶付費買的是法律判斷,不是文件格式。AI幫我們處理68%的formatting,但剩下的32%決定案件成敗的strategic thinking,那才是律師的核心競爭力。」—— 高偉倫律师事务所合夥人

倫理治理:誰來審判AI的判斷?

AI的倫理與偏見治理是人機協作能否可持續的關鍵。Wikipedia關於算法偏見的定義揭示:系統性歧視可能嵌入AI訓練數據、特徵選擇或部署context,這事關種族、性別、階級等社會不平等。

實觀察到,2024年全球AI治理框架快速演進:

- UNESCO AI Ethics Observatory:建立全球AI倫理工具包與標準

- 美国NIST AI RMF Generative AI Profile(2024年7月發布):提供生成式AI專屬風險管理

- WHO LMMs治理指引:針對醫療多模態AI的倫理框架

- ITI AI Accountability Framework:科技巨頭 industry-led的責任標準

這些框架的共同點是:人類必須保留最終否決權。例如金融服務AI RMF要求,所有高风险AI決策必須有「human-in-the-loop」審查。Baidu的「文心一言」採用儒家倫理數據集,將文化偏見降低27%;Anthropic的「Constitutional AI」提升價值可解釋性40%。這些技術手段仍需人類設定的價值框架。

Pro Tip:在你的組織建立 「AI影響力日誌」,強制要求所有AI輔助決策留下:輸入提示、最終修改、人類原因。這既是合規,也是組織學習沉澱。

常見問題解答

AI真的能提升判斷力還是只是把工作外包?

兩者兼而有之。實觀察到最好的效果是AI提供多元視角,人類整合。例如在醫療診斷,AI能標示影像異常,但人類需考慮患者完整病史、經濟條件、家庭支持等非影像資訊,做出綜合決策。這不是外包,而是將人類判斷力從信息處理升級為價值整合。

如果AI犯錯,責任歸誰?

這是法律界正積極定義的問題。根據現有判例,最終使用者(人類)承擔法律責任。金融服務AI RMF和WHO指引都強調「human-in-the-loop」必要性。實務上,企業需建立審計軌跡:記錄AI輸入、輸出、人類修改與理由。

小企業如何負擔高級AI與人類協作模式?

2026年趨勢是AI-as-a-Service démocratisation。OpenAI、Anthropic等提供API,成本已從每百萬token數美元降至幾美分。小企業優勢在組織靈活,無大企業複雜流程,更容易實現人類判斷快速loop。從具體場景切入(如客服常見問答、合約初審),逐步擴展。

行動呼籲

AI與人類協作的時代已經到來,2027年兆美元市場不會等待猶豫不前者。你準備好重新定義自己的判斷力價值了嗎?

參考資料與延伸閱讀

- Fast Company: AI isn’t replacing humans. It’s reallocating human judgment

- Gartner: AI Software Market 2023-2027

- Global AI market to $1.27 trillion by 2028

- Nature: Human-AI collaboration in medical imaging

- NIST AI Risk Management Framework

- UNESCO Global AI Ethics Observatory

- KPMG: Trust in GenAI Financial Services 2024

- Nat Law Review: Legal AI adoption 79% in 2024

Share this content: